基于关键点检测的摔倒识别

该工程基于PaddleDetection实现人员摔倒识别。先通过特定命令预测视频关键点,得到json结果文件和可视化视频;再用source.py中代码判断摔倒,输出摔倒帧对应时间,还会在视频检测框左上角标注结果并保存为output.mp4,示例中检测到78帧摔倒。

基于PaddleDetection的人员摔倒识别

本工程是基于PaddleDetection人员关键点预测的摔倒识别案例

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

关于PaddleDetection的使用详情请参考github链接 PaddleDetection

1 获取视频关键点预测结果

在PaddleDetection下使用如下命令预测视频结果(相关模型可以从github中model_zoo获取):

python deploy/python/det_keypoint_unite_infer.py --det_model_dir=output_inference/ppyolo_r50vd_dcn_2x_coco/ --keypoint_model_dir=output_inference/hrnet_w32_256x192/ --video_file=./pose_demo/test.mp4 --device=gpu --save_res=True登录后复制

预测完成后会在当前目录下得到预测结果json文件:det_keypoint_unite_video_results.json, 即此处使用的kpts_results.json文件.

在output目录下得到预测结果可视化文件:test.mp4, 即此处的video.mp4文件.

2 根据关键点结果判断是否摔倒

执行最下面命令行的命令,对关键点预测结果kpts_results.json做摔倒逻辑的判断,摔倒帧对应时间会打印显示。同时会在视频上对应时间的检测框左上角打印fall_down结果,结果视频保存为output.mp4。

逻辑判断代码在source.py文件中In [1]import osimport sysimport cv2import numpy as npimport jsonimport collectionsfrom source import check_fall_down, videovis登录后复制 In [3]

#1)脚本第一个参数为关键点预测结果json文件jsonf = "kpts_results.json"with open(jsonf, "r") as rf: kpts_data = json.load(rf)print("all data length: {}".format(len(kpts_data)))#2)如果需要视频打印摔倒文字,关键点可视化结果文件放在同路径videof = "video.mp4"#3)读取关键点结果后放入判断文件fallframes = check_fall_down(kpts_data)#4)根据检测的摔倒帧在视频显示videovis(videof, kpts_data, fallframes)登录后复制 all data length: 468fall_down frames: 78time: 5.5s, fall down detectedtime: 6.0s, fall down detectedtime: 6.5s, fall down detectedtime: 7.0s, fall down detectedtime: 7.5s, fall down detectedtime: 8.0s, fall down detectedtime: 8.5s, fall down detectedtime: 9.0s, fall down detectedtime: 9.5s, fall down detectedtime: 10.0s, fall down detectedtime: 10.5s, fall down detectedtime: 11.0s, fall down detectedtime: 11.5s, fall down detectedtime: 12.0s, fall down detectedtime: 12.5s, fall down detectedtime: 18.0s, fall down detectedtime: 18.5s, fall down detectedtime: 19.5s, fall down detectedtime: 20.5s, fall down detectedtime: 21.0s, fall down detectedtime: 21.5s, fall down detectedtime: 23.5s, fall down detectedtime: 25.5s, fall down detectedtime: 26.0s, fall down detectedtime: 29.5s, fall down detectedtime: 30.0s, fall down detectedtime: 32.0s, fall down detectedtime: 32.5s, fall down detectedtime: 33.0s, fall down detectedtime: 35.0s, fall down detectedtime: 35.5s, fall down detectedtime: 36.0s, fall down detectedtime: 38.0s, fall down detectedtime: 38.5s, fall down detectedprint fall down result in video: video.mp4fps: 12, frame_count: 468登录后复制

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

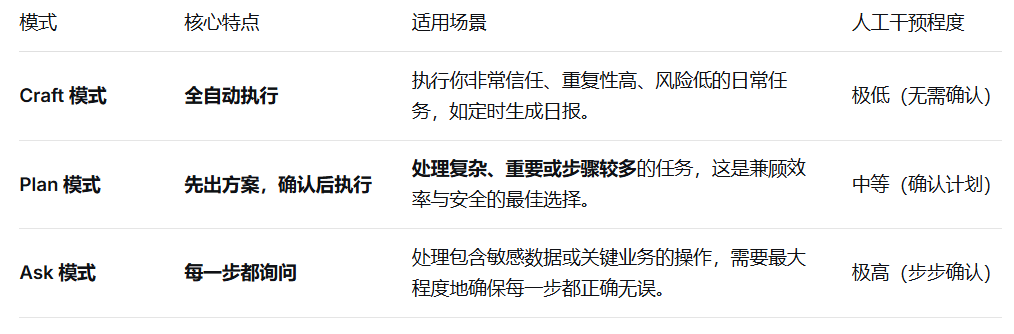

说一下WorkBuddy 的 Plan 模式

如何切换到 Plan 模式 想体验这种更可控的方式?操作很简单。在 WorkBuddy 主界面的右下角,你会看到一个“安全模式切换”的下拉菜单,从中选择“Plan”选项即可完成切换。 核心使用流程 光说概念可能有点抽象,咱们直接看个例子。假设你手头有个任务:“把桌面上‘项目报告’文件夹里所有Exce

滴滴出行开放打车 Skill,“龙虾”叫车全程不需要切换 App

滴滴出行全网首发语音打车Skill,一句话智能叫车全攻略 近日,滴滴出行正式上线了一项创新的语音交互功能:全面开放打车Skill。这意味着,用户只需通过语音指令,即可完成从叫车到行程追踪的全流程,真正实现“动口不动手”的便捷出行体验。 整个操作过程,包括目的地搜索、车型比价、下单确认、查看订单状态等

阿里千问 AI 眼镜接入蚂蚁 GPASS:语音解锁共享单车、停车缴费

当AI眼镜学会“跑腿”:语音解锁单车,无感支付停车费 近来,智能穿戴领域的一个新动向值得关注:阿里旗下的千问AI眼镜,正式接入了蚂蚁集团的GPASS平台。这可不是一次简单的功能叠加,它意味着,诸如共享单车骑行、停车缴费这一系列高频的“AI办事”功能,开始从手机屏幕转移到了你的眼前。 简单说,借助GP

Workbuddy注册额外积分

角色定位与核心任务目标 明确了基本定位后,我们直接切入核心:作为一名专业的文章优化师,我的核心职责在于,将那些带有明显AI生成特征的文本,深度重塑为拥有个人特色与行业洞见的优质内容。 换句话说,这项任务的关键在于实施一次“精准的换血手术”。你必须严格保证原文所有的事实依据、核心观点、逻辑框架,以及每

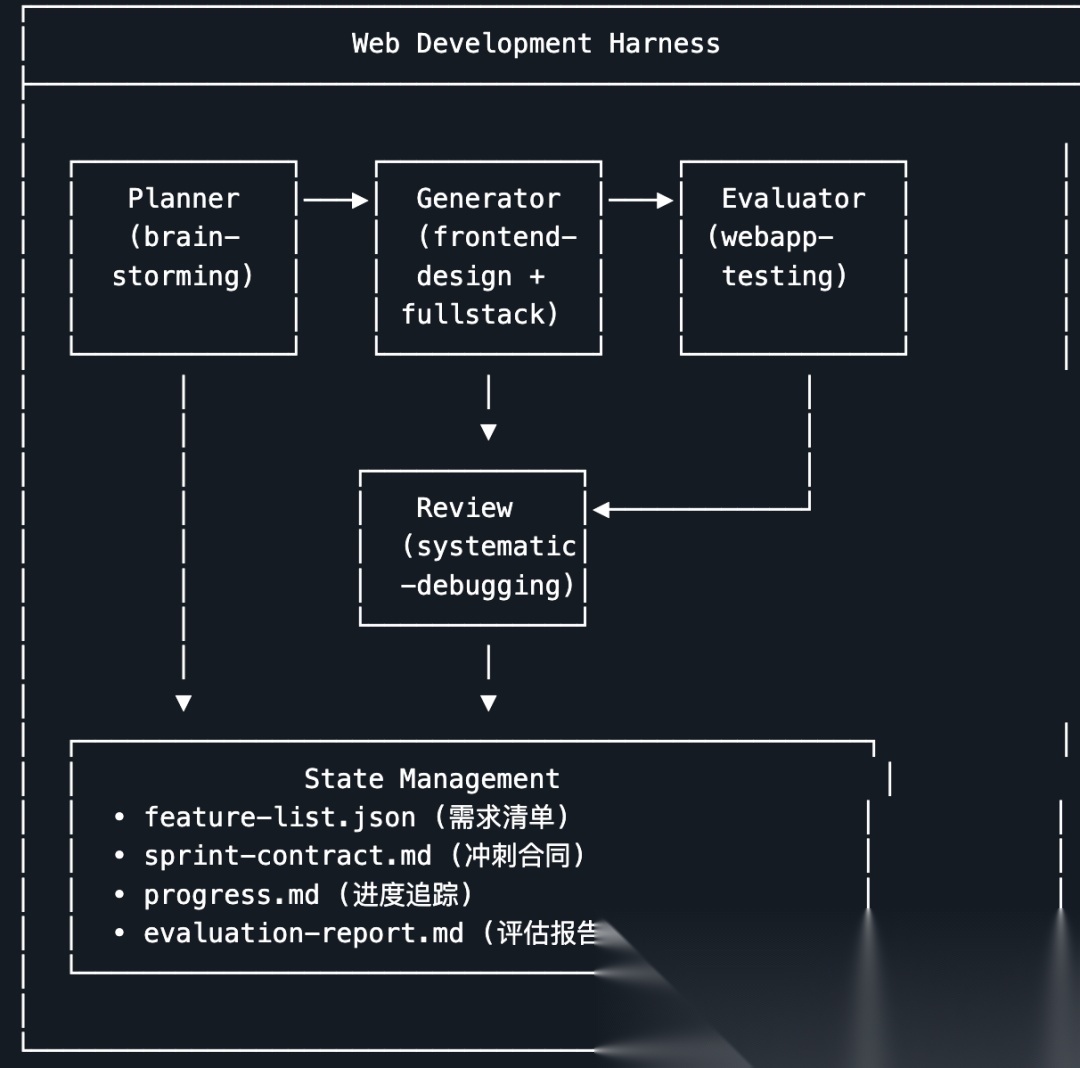

我把 Anthropic 的 Harness 工程思想做成了一个 Skill

用AI写代码,难在哪儿? 用AI生成代码本身并不难,真正的挑战在于让它稳定地交付一个真正可用的东西。这篇文章,我们就来聊聊Anthropic工程团队是如何破解这个难题的,以及我如何将这套方法论落地成了一个可以复用的实战工具。 用 AI 写代码有多难?不是写不出来难,是让它稳定交付可用的东西很难。这篇

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程