变分掩码扩散模型:优化并发标记预测的依赖关系处理

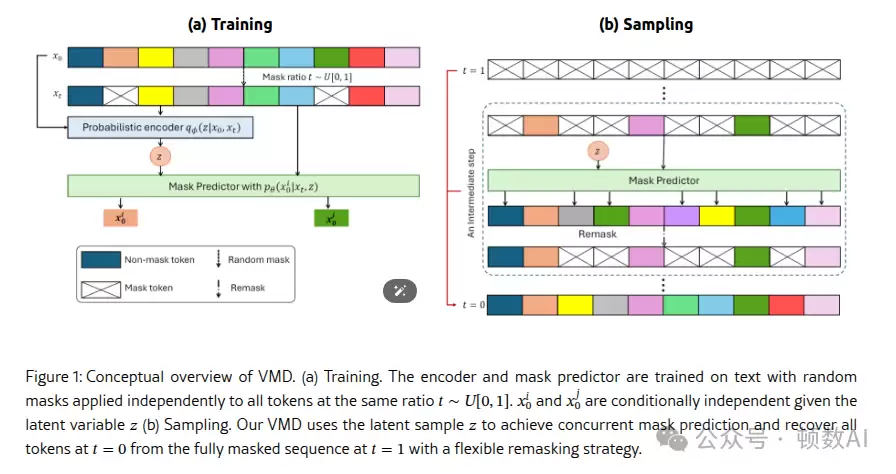

变分掩码扩散(VMD)模型通过引入潜在变量,成功解决了标准掩码扩散在并发标记预测中无法有效捕捉依赖关系的问题。在合成数据、数独谜题和文本数据上的实验都证明了VMD的有效性,特别是在标记间依赖关系重要的场景中。

1. 研究背景与问题定义

基于扩散的大型语言模型(DLLMs)作为自回归模型(ARMs)的重要扩展,正在成为生成式AI领域的重要创新方向。与传统ARMs按预定顺序逐一生成标记的方式不同,DLLMs提供了并发标记生成、更高输出多样性、增强全局一致性以及更好的生成文本可控性等优势。近期的突破性模型如LLaDA、Mercury和Gemini Diffusion都凸显了DLLMs的潜力。

然而,当前的掩码扩散模型(MDM)存在一个关键限制:无法有效捕捉并发预测的标记之间的依赖关系。这导致在标记间依赖性较强的推理任务中性能下降。例如,在预测"A poker hand that consists of two English words is: a a"的后续两个词时,合适的预测应为"high card"、"two pair"、"full house"或"straight flush"。这些词对之间存在强依赖关系,但MDM在并发预测时会独立采样,无法考虑这种依赖性,从而可能产生不合理的组合。

2. 变分掩码扩散(VMD)模型

为解决上述问题,研究者提出了变分掩码扩散(Variational Masked Diffusion, VMD)框架,通过引入潜在变量来建模并发预测期间的联合标记分布。VMD的核心思想是:通过潜在变量模型捕捉任意联合分布,而不仅仅是可因式分解的分布。

图片

图片

2.1 基本变分公式

VMD的基本公式为:

pθ(x0i|xt) = ∫pθ(x0i|xt,z)p(z)dz

其中z是全局潜在变量,不依赖于标记位置i。这使得模型能够在标记之间建立联合分布。条件于潜在变量z,标记可以独立采样,但边缘化潜在变量后,能够从正确的联合分布中获得样本。

训练目标函数(NELBO)为:

-log pθ(x0) ≤ ∫(0→1) (1/t)

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

小米开源机器人VLA模型技术解析与应用指南

Xiaomi-Robotics-0是什么 如果需要一个能够“感知环境、理解语言、并执行物理操作”的智能核心,那么小米最新开源的Xiaomi-Robotics-0,无疑是这一领域的一次重大突破。作为拥有47亿参数的首代机器人VLA(视觉-语言-动作)大模型,其设计理念极具巧思:它采用一种混合架构,清晰

北大联合谷歌推出AI学术插图生成框架PaperBanana

PaperBanana是什么 对于广大AI科研工作者而言,绘制符合发表标准的论文插图是一项耗时费力的挑战——既要精确表达复杂的模型架构与算法流程,又要满足NeurIPS、ICLR等顶级会议的视觉审美要求。如今,这一难题迎来了创新的解决方案:PaperBanana。 这是由北京大学与Google Cl

字节跳动Seed2.0通用模型系列详解与应用

Seed2 0是什么 近期,字节跳动旗下Seed团队正式发布了全新的Seed2 0大语言模型系列,这一动作在人工智能领域引发了广泛关注。该系列阵容完备,包含三款通用智能体(Agent)模型——Pro版、Lite版和Mini版,以及一款专精于编程的Code模型。 此次版本迭代的核心在于模型综合能力的全

字节跳动Seedance 2.0 AI视频生成模型详解

Seedance 2 0是什么 在AI视频生成技术快速发展的今天,每一次重大升级都意味着创作门槛的进一步降低。字节跳动最新推出的Seedance 2 0模型,正是这一浪潮中的前沿代表。它被定义为新一代的AI视频生成引擎,其核心优势在于强大的“多模态参考理解”与“高效一体化创作”能力。 通俗地讲,用户

Mistral AI发布Voxtral Transcribe 2语音转文本模型

Voxtral Transcribe 2是什么 在语音转文本领域,竞争日益白热化。近期,Mistral AI推出的Voxtral Transcribe 2系列模型,为市场注入了新的活力。该系列包含两款针对性产品:Voxtral Mini Transcribe V2专注于批量音频转录,支持包括中文在内

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程

热门话题

热门话题