HuggingFace趋势第一:AutoDeco实现端到端模型自动调参解码

由腾讯AI Lab的王琥研究员及其团队领衔,联合香港中文大学(深圳)唐晓莹教授及其博士生王志超,提出了一个巧妙的解决方案。他们推出了名为AutoDeco的全新架构,旨在彻底告别手动调整解码参数的"手工作坊"时代。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

对于大语言模型的研究者们来说,可能都曾面临一个共同的困扰:针对不同任务和不同模型,都需要手动调整解码超参数(如temperature和top-p)。这个过程不仅耗时耗力,而且一旦模型或任务发生变化,过往的经验便瞬间失效,一切又得从头开始。

这种繁琐的试错过程,在许多研发团队的日常沟通中屡见不鲜,正如下图所示所展示的那样:

图1:研发人员手动调整解码参数的日常写照。

一个深刻的问题随之而来:为何不能让模型自己学会如何解码,从而实现真正的"端到端"生成?

事实上,各大模型厂商的API文档也印证了这一难题。以DeepSeek为例,其最新文档明确建议针对不同场景设置截然不同的temperature值,这使得单一的静态参数设置显得捉襟见肘。

图2:不同任务需要不同的解码参数,这使得静态设置难以应对复杂多变的现实需求。

近期,腾讯AI Lab的王琥研究员带领团队,联合香港中文大学(深圳)唐晓莹教授及其博士生王志超,给出了一个优雅的答案。他们推出了名为AutoDeco的全新架构,旨在彻底终结手动解码的"手工作坊"时代。这项研究《The End of Manual Decoding: Towards Truly End-to-End Language Models》,通过让模型动态预测并控制自身的解码参数,向着真正端到端的语言生成迈出了关键一步。

论文链接: https://huggingface.co/papers/2510.26697代码链接: https://github.com/Zacks917/AutoDeco模型链接: https://huggingface.co/collections/Jadeislaw/autodeco

图3:AutoDeco位居Hugging Face Daily Papers榜首

当前,尽管LLM本身已高度集成,但生成过程的"最后一公里"——解码,仍然是一个独立于模型之外的、不可微分的僵硬环节。研究团队形象地将其比作"手动挡变速器":无论引擎多么强大,换挡操作依然依赖人工进行。

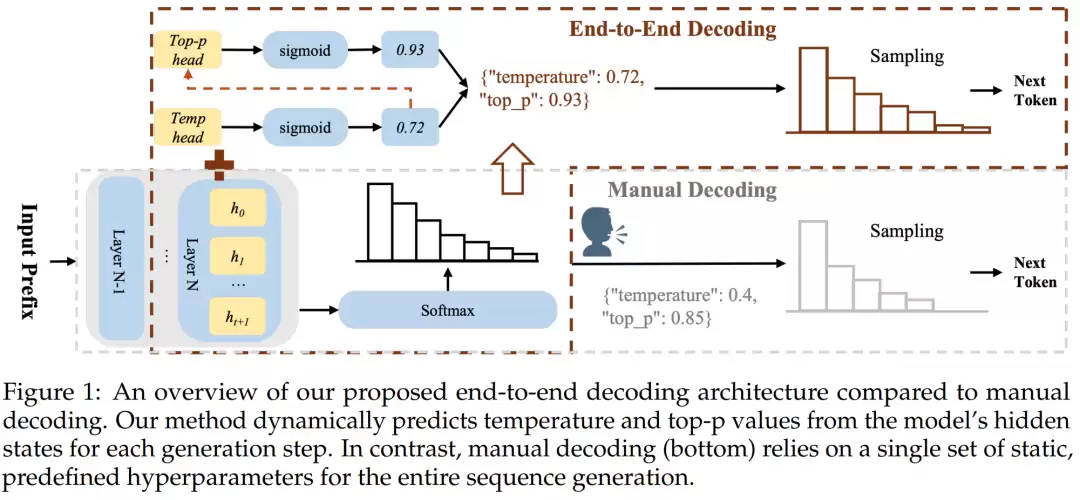

AutoDeco的核心思想,就是为LLM装上"自动挡"。它通过在标准Transformer架构中引入两个超轻量的预测头,让模型在生成每一个token时,都能根据当前的上文信息,动态地预测出最适合下一步生成的temperature和top-p值。

图4:AutoDeco(上)与传统手动解码(下)的对比。AutoDeco将解码参数的预测无缝集成到模型的前向传播中,实现了动态自适应调节。

核心挑战与技术突破:如何训练一个没有"标准答案"的任务?

设想很美好,然而,一个关键的挑战摆在研究团队面前:如何训练这些预测头?在训练数据中,并不存在每一时刻"正确"的温度和top-p标签,这使得监督学习无从谈起。

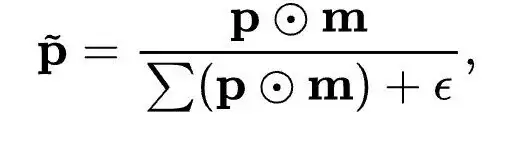

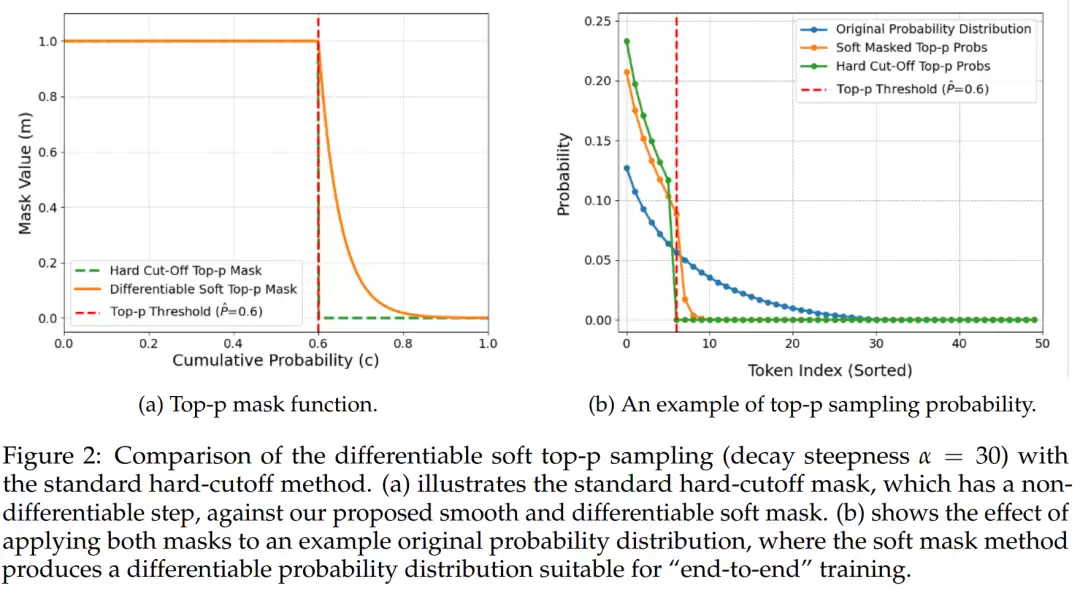

为此,团队提出了一种创新的、完全端到端的训练策略。他们设计了一种新颖的"软性top-p"机制,巧妙地替代了传统top-p采样中不可微分的"硬截断"操作。该方法分为三步:

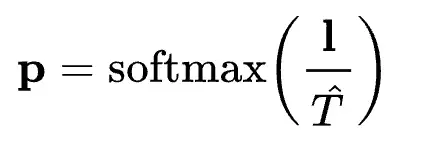

(一)温度缩放:首先,使用模型预测的温度对原始logits l进行缩放,得到初始概率分布p。

(二)掩码生成:接着,计算概率的累积分布c,并使用模型预测的top-p值

生成一个平滑的、可微分的掩码m。其核心思想是,对于累积概率小于

生成一个平滑的、可微分的掩码m。其核心思想是,对于累积概率小于

的token,掩码值为1;对于超出部分的token,掩码值通过一个指数衰减函数平滑地趋近于0。

的token,掩码值为1;对于超出部分的token,掩码值通过一个指数衰减函数平滑地趋近于0。

其中α是控制衰减程度的超参数。

(三)最终概率分布:最后,将掩码应用到初始概率上并重新归一化,得到最终的可微分概率分布p。

图5:可微分的soft top-p(橙色线)与传统的hard top-p(绿色线)对比。Soft top-p的平滑特性打通了从最终生成损失到解码参数预测头的梯度路径。

这一设计的巧妙之处在于,它使得从最终的"下一个词预测"损失到解码参数预测头的梯度能够顺畅回传。如此一来,模型便可以在标准的Next Token Prediction任务中,通过优化最终生成结果来"倒逼"自己学会如何动态调整解码策略,整个过程无需任何额外的标注数据。

AutoDeco的惊人表现:三大亮点

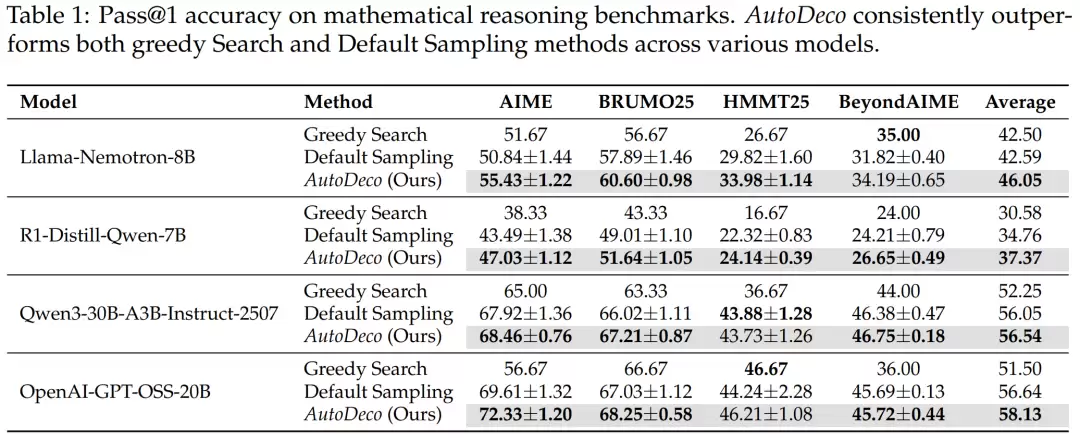

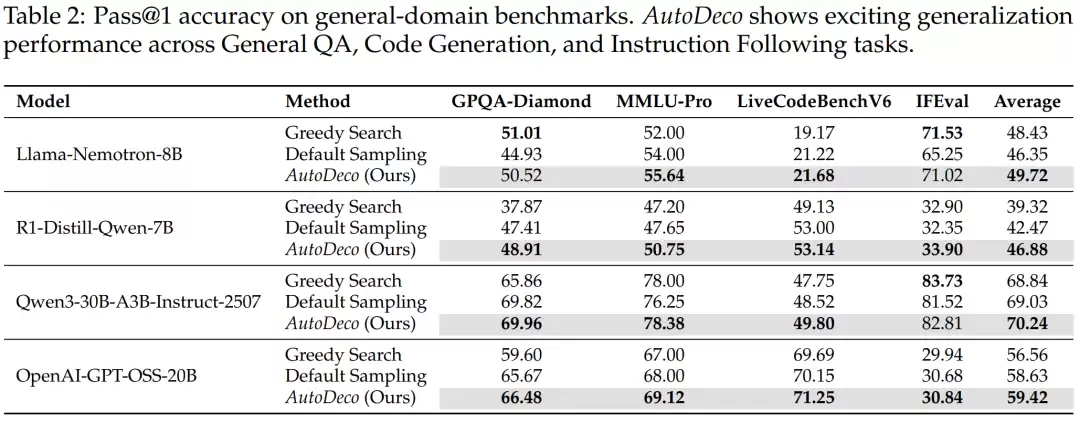

通过在Llama、Qwen、Deepseek等多个主流模型系列上的广泛实验,AutoDeco展现了其强大的能力:

卓越的性能与泛化能力

实验结果表明,AutoDeco不仅稳定超越了传统的Greedy Search和Default Sampling等基线方法,其性能甚至能媲美、乃至超越了利用测试集进行精细调优的"神谕"基线。

图6:AutoDeco在多个数学和通用任务benchmark上均取得了SOTA性能,展现了其强大的泛化能力。

极致的效率与易用性

AutoDeco的预测头设计极为轻量,其带来的额外推理延迟通常仅为1.7%,内存开销也几乎可以忽略不计。对于开发者而言,接入AutoDeco模型仅需修改几行代码,即可享受"免费"的性能提升。

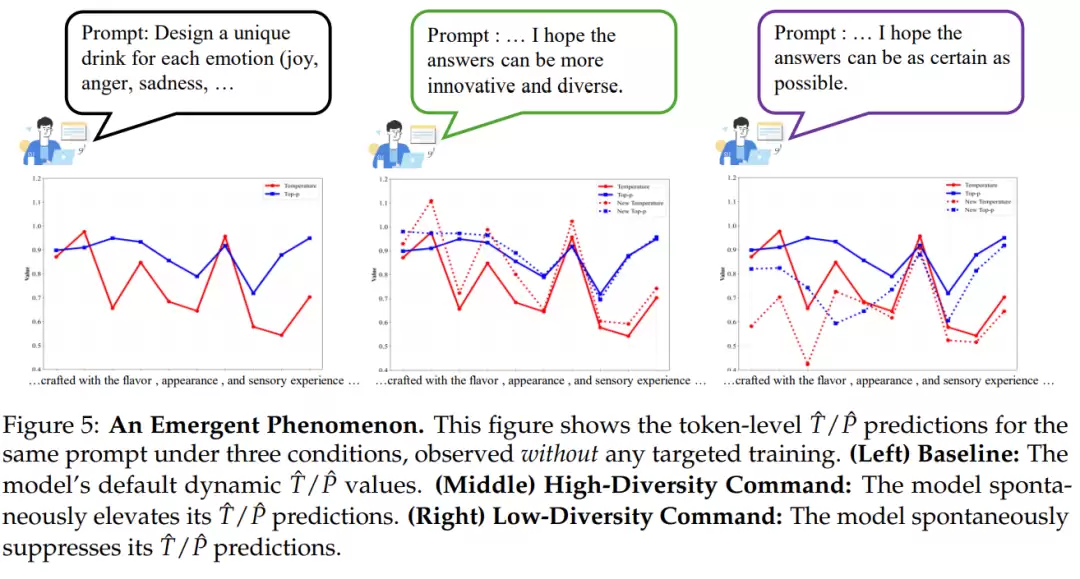

"言出法随":开创性的自然语言控制能力

研究中最令人兴奋的发现之一,是AutoDeco涌现出的"通过自然语言控制解码"的能力。用户可以直接在prompt中通过自然语言下达指令,如"我希望答案更有创意",模型便能"听懂"并自主地调高其预测的temperature和top-p值,整个过程清晰可见。

图7:在不同指令下,AutoDeco预测的T/P值变化。从左至右分别为:基线、高创造力指令(T/P值自发升高)、高确定性指令(T/P值自发降低)。

当然,作者坦言这种能力还不够完善,还做不到非常精准的控制。他们猜测要实现细粒度、高精度的自然语言控制解码无法仅仅通过微调AutoDeco模块做到,而是需要全参数微调模型,这也被他们列为了Future work的重点。因此,作者没有放出带有自然语言控制能力的AutoDeco heads权重。

AutoDeco在发布后迅速吸引全球AI社区的关注,在Twitter等社交平台上引发了顶尖学者、开发者和企业家的广泛热议和高度评价。

图8:大模型社区对AutoDeco的广泛热议和高度评价。

目前,该团队已将论文、代码以及在多个主流模型上训练好的AutoDeco heads全面开源,包含适配于Deepseek V3.1、Qwen3-235B、GPT-OSS-120B等生产级大模型的版本。正如研究人员在分享中所说,这项工作旨在将研究者和开发者从繁琐的调参工作中解放出来,共同迈向一个更智能、更自动化的AGI新时代。

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

关停 Sora 后 OpenAI 转身收购 TBPN 播客,亲自下场做媒体

OpenAI关闭Sora后战略转向:收购TBPN播客,深度布局内容生态 四月初的科技界新闻不断,一则来自科技媒体9to5Mac的报道引发了行业的强烈关注。OpenAI在近期宣布正式收购知名科技商业播客品牌The Browser Pane。这一战略动作紧随其视频应用Sora的停止运营之后,被外界普遍视

今年美国科技行业裁员规模创 2023 年以来新高,开年至今已裁逾 5 万人

4 月 3 日消息 据《商业内幕》当地时间 4 月 2 日报道,一股实质性的冲击波正在职场蔓延——AI 对就业的影响,已经从讨论变成了现实,而科技行业无疑站在了浪潮的最前沿。 裁员数据创下新高 数据不会说谎。根据 Challenger, Gray & Christmas 的统计,2026 年开年至今

工信部发布防范 OpenClaw(“龙虾”)开源智能体安全风险“六要六不要”建议

工信部发布“六要六不要”,为OpenClaw(“龙虾”)开源智能体安全风险划出红线 近日,工业和信息化部网络安全威胁和漏洞信息共享平台发布了一份重磅文件,针对当前热门的OpenClaw(因其图标酷似龙虾,业内常昵称为“龙虾”)开源智能体,提出了清晰的安全使用指引——“六要六不要”。这份建议可不是空穴

荣耀 CEO 李健:荣耀机器人全栈自研,将聚焦消费市场

荣耀CEO李健详解机器人战略:全栈自研,聚焦三大核心消费场景 荣耀春季旗舰新品发布会圆满结束后,关于公司未来发展的蓝图更加清晰。在随后的媒体沟通会上,荣耀CEO李健不仅公布了年度销售目标,更首次系统性地阐述了荣耀在机器人领域的完整战略规划与市场布局。 在探讨机器人业务发展方向时,李健明确了荣耀的坚定

别只盯着“上门装龙虾赚26万”!看懂OpenClaw背后的“意图入口”大战

别再只关注“上门装龙虾赚26万”!深度解读OpenClaw背后的“意图入口”新战争 最近科技行业的热潮,充满了戏剧性的现实色彩。一只“红色龙虾”AI智能体搅动了整个市场:有人通过提供安装服务,收取每次五百元,短短几天就赚取二十六万元收入;腾讯大厦前甚至排起长队,大家竞相领取免费的安装体验权限。这场全

- 日榜

- 周榜

- 月榜

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程