英伟达GB300刷新MLPerf纪录:10分钟训完4050亿参数AI模型

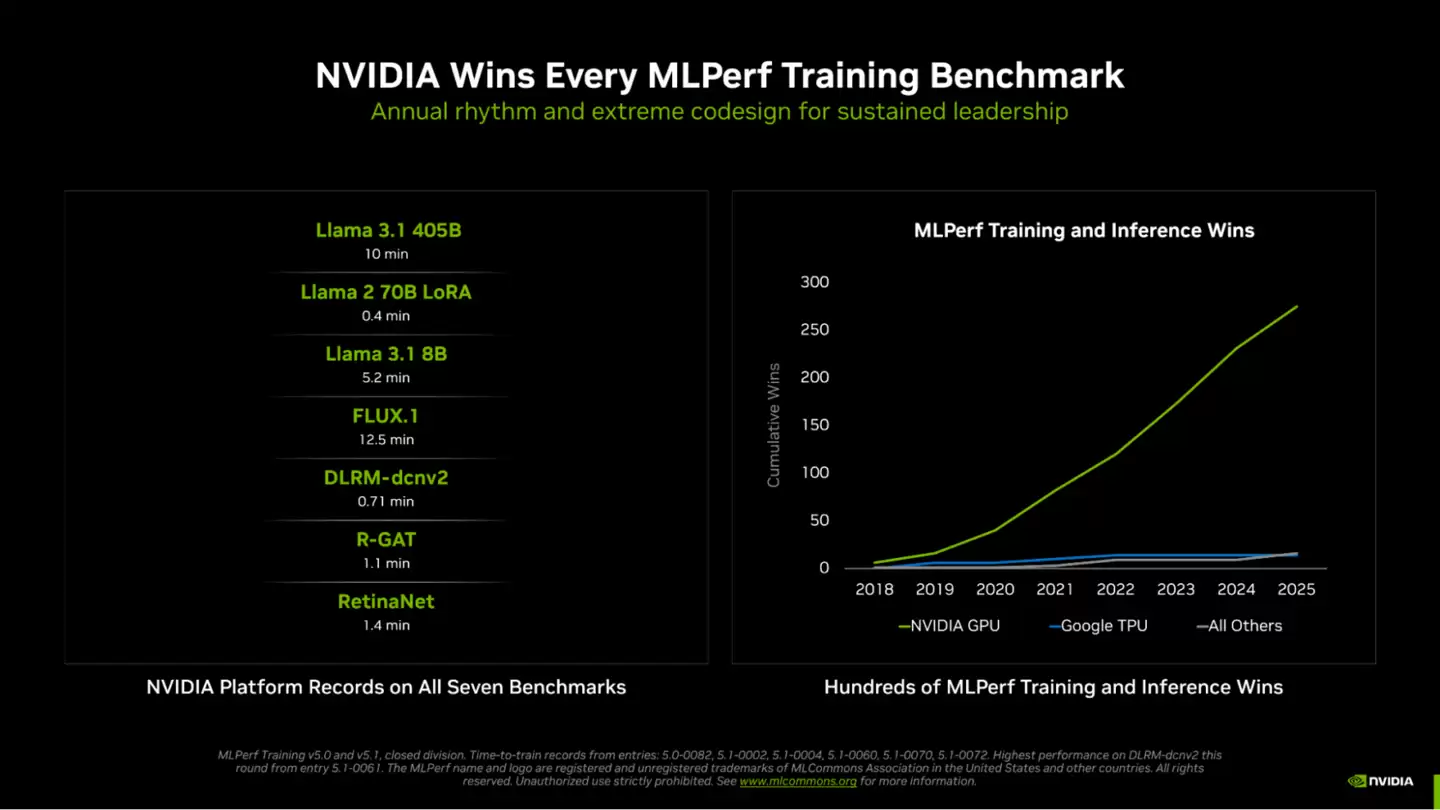

11月13日最新消息,科技媒体Wccftech于昨日(11月12日)发布的报道披露,在最新一轮的MLPerf AI训练基准测试中,英伟达基于Blackwell Ultra架构打造的GB300 NVL72平台表现惊人,一举包揽全部7个测试项目的桂冠,取得了压倒性的全面胜利。

根据该媒体报道,本次测试中最引人注目的成绩是,GB300 NVL72平台仅耗时10分钟,就高效完成了拥有4050亿参数的Llama 3.1大模型的完整训练任务。

除了这项突破,该平台在其他关键测试项目中也表现出色——仅用0.4分钟即可完成Llama 2 70B模型的LoRA微调,而训练Llama 3.1 8B模型也只需要5.2分钟。

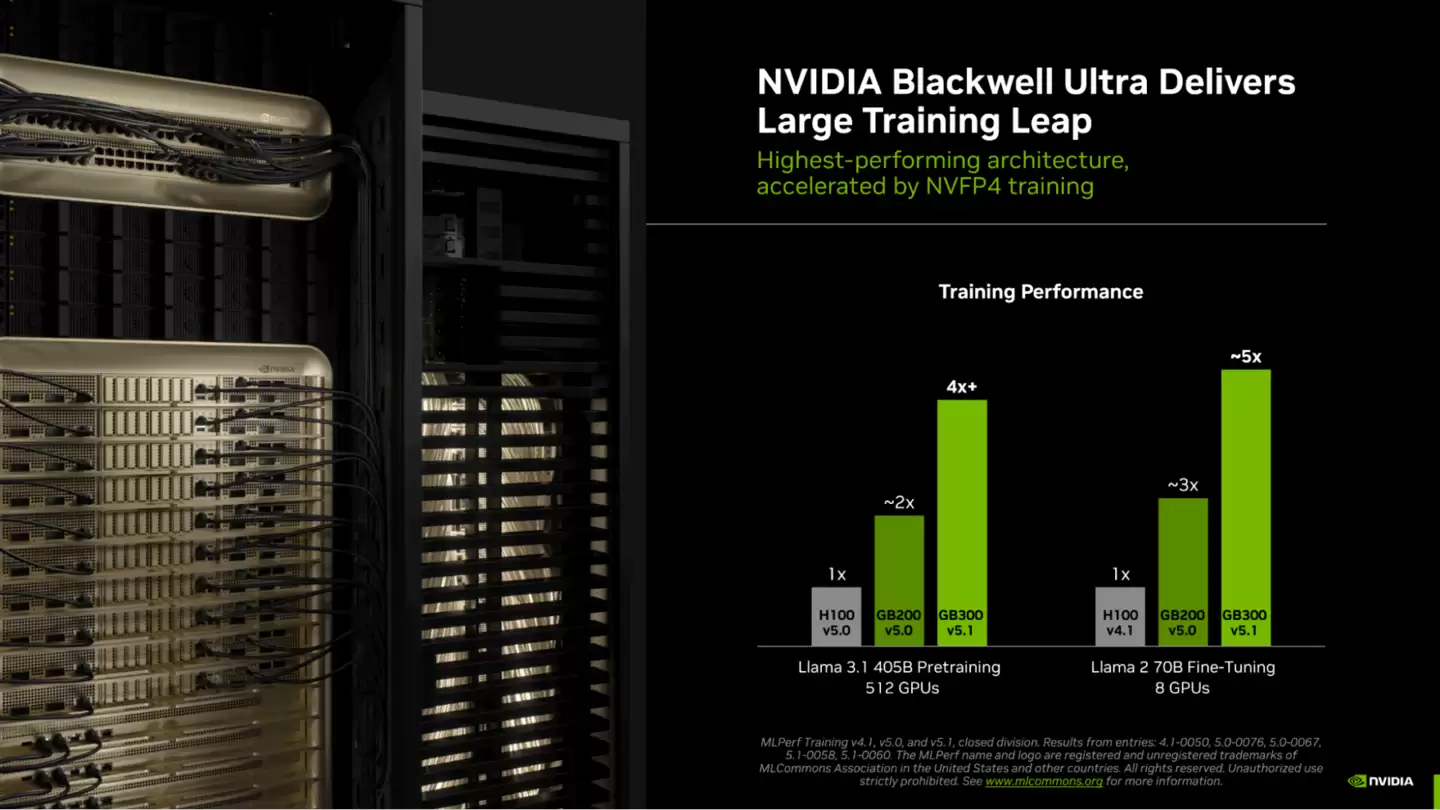

与上一代产品相比,Blackwell Ultra架构实现了性能的巨大飞跃。测试数据显示,在Llama 2 70B微调任务中,8块GB300 GPU提供的整体性能,达到了同数量H100 GPU的5倍。

而在更具挑战性的Llama 3.1 405B预训练任务中,GB300的性能表现也达到了H100的4倍以上,并且比同样基于Blackwell架构的GB200快了近2倍。

报道分析认为,这一性能突破的背后,是英伟达在软硬件协同创新上的深厚积累。硬件方面,GB300 NVL72系统集成了速率高达800GB/s的Quantum-X800 InfiniBand高速网络,并为每块GPU配备了279GB的HBM3e高带宽内存,使得整个系统的总内存容量达到了惊人的40TB。

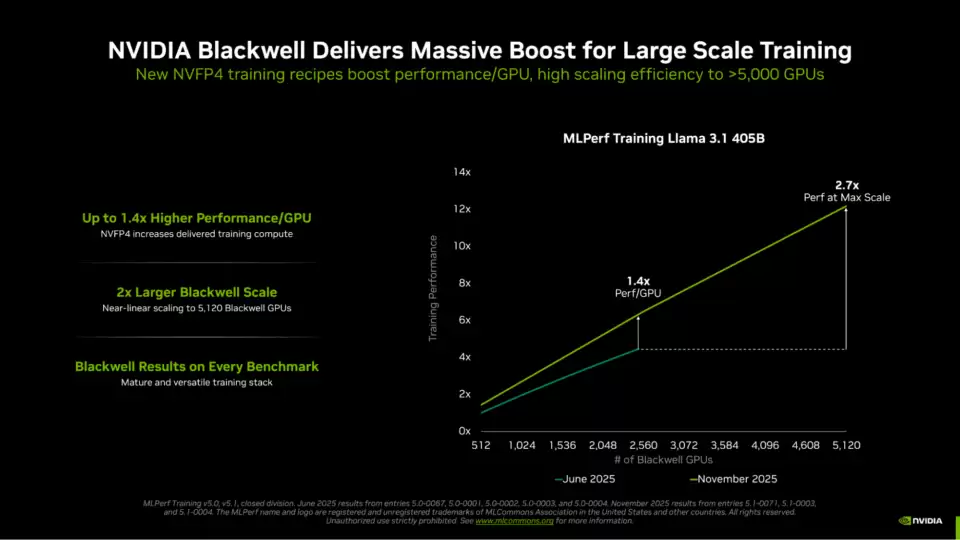

在软件层面,全面采用FP4精度的量化策略成为了提升效率的关键。英伟达通过在模型训练的每一层都应用FP4精度,将计算速度提升至FP8的两倍,而全新的Blackwell Ultra架构更是将这一优势进一步扩大到了3倍。

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

银河通用LDA模型全谱系数据跑通Scaling Law

近期,具身智能领域迎来密集突破,两大技术路线相继发布重要进展。 先是Generalist AI推出GEN-1模型,凭借卓越的数据效率与闭环控制性能,刷新了多项操作记录,引发行业广泛关注。短短两周后,另一重要参与者Physical Intelligence发布了新模型π 0 7,其核心聚焦于“组合与泛

Llama 3 GGUF模型加载报错层数不匹配的快速修复方法

在llama cpp或text-generation-webui中加载Llama 3的GGUF模型时,如果遇到“层数不匹配”或“量化版本不兼容”的错误提示,不必过于焦虑。这类问题通常源于模型文件的网络结构深度(如n_layers值)与加载器预期不符,或是量化等级超出了当前运行环境的支持范围。遵循以下

赛博朋克霓虹夜景设计教程 Canva可画轻松制作

做赛博朋克风格海报,最怕的就是霓虹灯不够亮、夜景没层次、整体感觉太平淡。如果你在Canva里也遇到了类似问题,别急着换模板,问题很可能出在图层叠加的逻辑、色彩对比度,或者少了那么点“动”起来的细节。下面这几个步骤,能帮你把海报的视觉冲击力拉满。 一、启用高对比度霓虹配色方案 赛博朋克的灵魂,就在于那

Karpathy LLM Wiki本地部署教程 有道云笔记与Claude Code实践指南

你的手机里是不是存了几百篇“稍后再看”的文章?笔记软件里是不是躺着上千条收藏,落满了数字灰尘,再也未曾打开。 别不好意思,这几乎是数字时代每个人的通病。每天面对海量的行业报告、技术文章和灵感碎片,我们总在重复“收藏即遗忘”的动作。标签、文件夹、搜索功能,在信息量突破某个临界点后,便彻底失灵了。我们以

Claude技能编写避坑指南:从入门到精通实战教程

设计Claude Skills时,许多开发者容易陷入一个认知误区:认为功能越全面、指令越“智能”,最终效果就越好。然而实践往往证明恰恰相反。以下七个常见的设计陷阱,正是导致技能输出不稳定、难以复用的根本原因。我们将以具体的“Figma UI设计审计”技能为例,深入剖析如何有效避开这些陷阱,从而构建出

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程

热门话题

热门话题