企业AI智能体强化:OpenAI最新微调实践详解

在2025年举行的QCon+AI NYC大会上,OpenAI的研究员Will Hang与Wenjie Zi联袂登场,带来了一场关于企业级智能体优化策略的深度探讨。他们重点介绍了一种名为Agent RFT的创新方法,这是一种专门为工具使用型智能体设计的强化微调技术,能够显著提升智能体在复杂多步骤任务中的综合表现。

这场分享的核心,在于揭示如何让AI智能体更高效、更可靠地使用工具完成任务。

Agent RFT本质上是一种基于强化学习的模型微调方案,其目标不仅仅是让智能体学会调用工具,更是让它在长期的决策序列中学会规划,优化效率与成本。

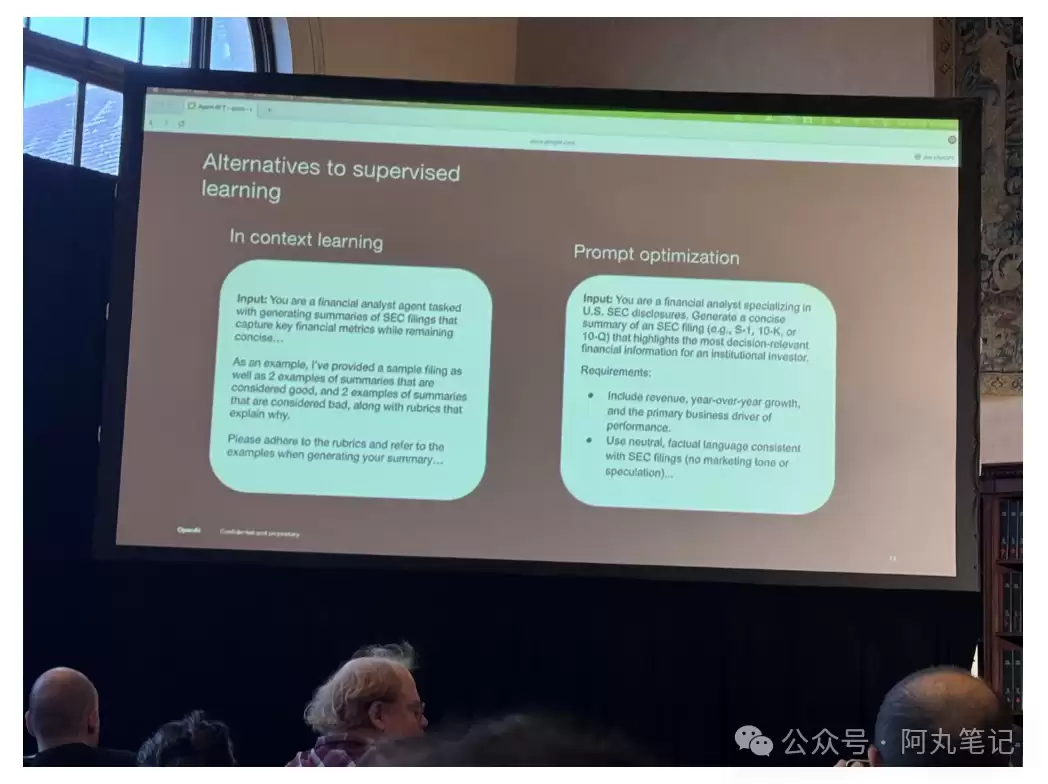

从提示词优化到模型微调的渐进路径

在演讲中,Hang强调了一条实用的改进路径:在考虑修改模型权重之前,应该先从优化提示词和任务设计入手。

图片

图片

他列举了多个实际案例,例如简化需求描述、添加防护机制以防止工具误用、改进工具描述、优化工具输出质量等。这些看似微小的调整,往往能让智能体做出更明智的下游决策。

尽管这些优化方法通常能带来立竿见影的效果,但在那些需要跨工具交互、进行一致性多步骤推理的复杂任务上,其提升可能会遇到瓶颈。此时,就需要考虑更深层次的模型微调方案。

微调方法的选择:从监督学习到强化学习

Hang将微调选项描述为一个连续谱系:

• 监督微调:当输入到输出存在可预测的映射关系,且目标是模仿一致的风格或结构时,这种方法非常有效。

• 偏好优化:通过成对比较来调整输出,使其更接近人类偏好的响应。OpenAI的Direct Preference Optimization指南将其描述为通过比较模型输出来进行微调的方法,目前主要限于文本输入和输出。

• 强化微调:这种方法更适用于需要模型在较长轨迹中发现策略,而非简单复制单一演示完成模式的任务。

警惕奖励破解!解决评分器中可能存在的任何边缘情况。连续奖励比二元奖励效果更好。—— Will Hang, OpenAI

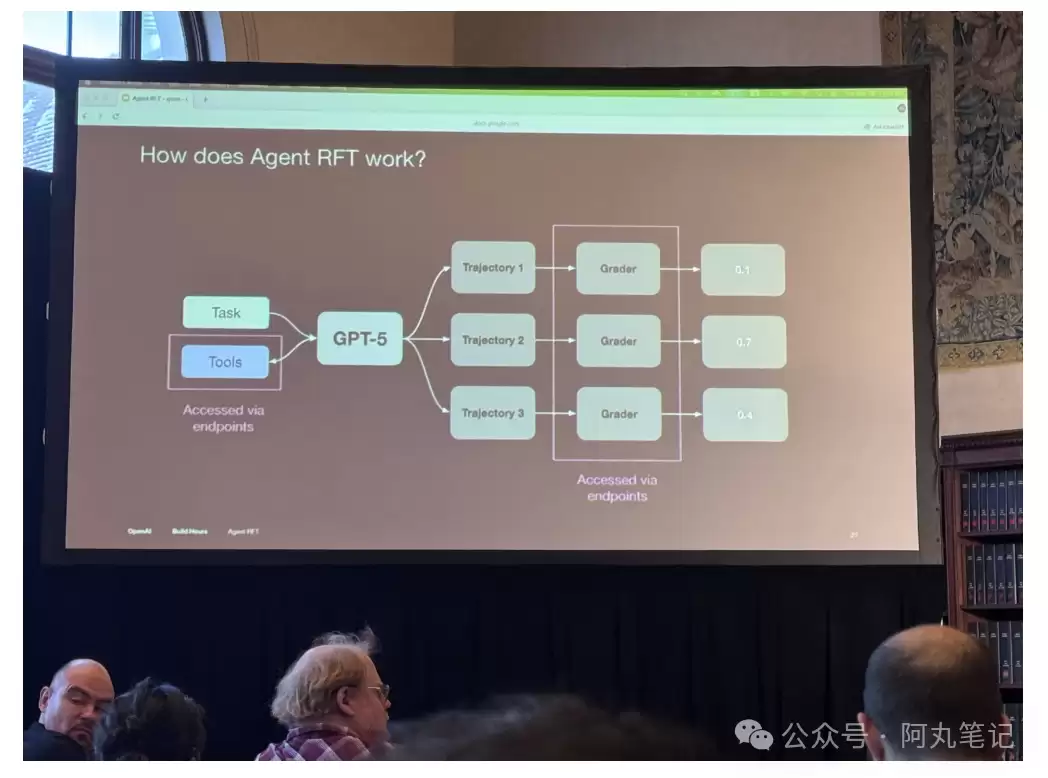

Agent RFT:为工具使用型智能体量身定制

Agent RFT是强化微调技术在工具使用型AI智能体上的专门适配。

图片

图片

在训练过程中,模型会探索不同的策略,并从评分器获得学习信号。OpenAI的文档将这一循环描述为:采样候选响应、使用自定义评分器进行评分、基于这些分数更新模型。

Hang特别强调了跨完整轨迹的信度分配,这意味着包括工具选择和工具调用结构在内的早期决策,都可以基于下游结果得到强化或抑制。

他将AI智能体定义为一个能够通过工具与外部世界交互的系统,而不仅仅是响应用户提示。

工具生态与评分器设计

Hang描述了多种工具使用场景,包括编程智能体的终端工具、客户支持场景中的内部业务系统、文档搜索或检索引擎端点等。

他特别强调,工具输出会流回同一个上下文窗口,因此工具调用、工具输出、推理标记和最终响应共同构成了一个单一的多步骤轨迹。

在这一工作流中,评分器成为核心组件。演讲中介绍了多种评分风格,包括简单匹配器、基于模型的判断器、基于代码的评分器、端点评分器,以及组合多种评分器来共同优化准确性和延迟。

超越准确性的运营属性优化

除了答案准确性,Agent RFT还关注那些仅靠准确率无法捕捉的运营属性。

Hang描述了使用Agent RFT来减少不必要的工具调用、强制执行工具调用预算、减少超长轨迹的长尾分布,这些都能有效降低不可预测的延迟并改善用户体验。

幻灯片展示了训练轨迹,显示推理标记和工具调用在训练过程中逐渐减少,这与智能体能够学会使用更少的步骤达到相似或更好任务结果的观点一致。

实际应用案例:金融领域的智能文档检索

Wenjie Zi在演讲的后半部分分享了具体用例和平台设置细节,包括一个面向金融领域的示例。

在这一场景中,模型必须在受限的工具调用预算下,从大型文档语料库中定位相关内容。智能体使用搜索、列表和文件读取工具,然后由评分器对最终答案进行评分。

Zi特别强调,即使对于数值答案,也使用基于模型的评分器,以减少因表面格式差异、单位或微小变化导致的假阴性结果。这种方法能够更准确地评估答案的正确性。

跨领域的应用价值

Zi还描述了在智能编程和其他领域的更广泛示例,重点关注具有多种工具、隔离执行环境和奖励设计的环境,这些设计需要平衡正确性、流程和效率。

报告的结果强调了改进的规划能力、减少的长轨迹尾部,在某些情况下还出现了向并行工具调用的转变,以减少顺序轮次。

对于希望深入了解的开发者,可以查阅OpenAI的强化微调和模型优化文档。

本文基于InfoQ对QCon+AI NYC 2025大会的报道整理,原文作者Andrew Hoblitzell为Salesforce高级技术团队成员。

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

Claude代码助手插件解决编程中断难题

对于深度依赖Claude Code进行开发的用户而言,最令人沮丧的体验莫过于在终端中“盲开”:你永远无法知晓当前对话的上下文容量还剩多少,只能被动等待系统提示耗尽,导致所有精心构建的对话逻辑和代码成果瞬间归零。 就在近期,一个典型的开发场景几乎让项目进度停滞:在编写一个复杂的批量交互脚本时,与Cla

谷歌Gemma 4大模型本地部署安装配置完全指南

4月3日凌晨,谷歌DeepMind向开源AI社区投下了一枚重磅冲击波:Gemma 4正式发布。 这个拥有310亿参数的模型,性能提升堪称“暴力”。在数学竞赛基准上,它从上一代的20 8%直接跃升至89 2%;编程能力方面,LiveCodeBench得分从29 1%飙升至80%。更关键的是,它采用了A

Linux CUPS打印系统高危漏洞可零点击获取root权限

近日,Linux生态系统中一项基础且至关重要的服务——打印服务CUPS被披露存在高危安全漏洞。根据网络安全媒体cyberkendra的报道,攻击者无需任何身份凭证,即可通过远程方式执行恶意代码,并最终获取系统的最高root权限。 这组漏洞由安全研究员Asim Manizada在人工智能工具的辅助下发

手机运行Gemma 4模型实测与可行性分析

昨天看到一条消息,说有人在 iPhone 17 Pro 上运行 Google 最新发布的 Gemma 4 模型,推理速度超过了每秒 40 个 token。第一反应是:这可能吗? 要知道,Gemma 4 是 Google 在 4 月 2 号刚发布的开源模型家族中的旗舰款。其参数量最大的 31B 版本在

大模型训练合成数据生成的十大实用策略

合成数据,这个曾经被视为“辅助工具”的技术选项,如今正快速演进为驱动大模型开发与迭代的核心基础设施。对于任何致力于长期模型训练、优化和持续升级的团队而言,构建高质量的合成数据能力已成为一项战略性任务。 背后的驱动力非常现实:获取大规模、高质量的训练数据始终是AI团队面临的主要瓶颈。数据或许存在,但面

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程

热门话题

热门话题