让大模型学会检索:4万亿token教你优化动态RAG性能

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

新智元报道

编辑:LRST

【新智元导读】动态检索增强生成(Dynamic RAG)通过自适应判断「何时检索」来缓解大语言模型的幻觉问题,但现有方法普遍依赖模型内部信号(logits、entropy、attention等),而LLM本身的信号校准较差,即常对错误答案「自信满满」。近日,来自伊利诺伊大学芝加哥分校、纽约大学、与蒙纳士大学的联合团队提出QuCo-RAG,首次跳出「从模型自己内部信号来评估不确定性」的思维定式,转而用预训练语料的客观统计来量化不确定性,在多跳QA基准上对OLMo系列模型实现5-14个EM点的显著提升,并且有效性成功迁移至Llama3、Qwen2.5、GPT4.1/5等预训练数据未公开的模型。

当检索增强生成(RAG)从静态走向动态,一个核心问题浮出水面:何时该触发检索?

现有方法的答案是:看模型内部信号。FLARE看句子中的token生成概率,DRAGIN看entropy和attention,ETC看entropy的一阶二阶差分,SeaKR看FFN内部状态……

但这一范式存根本性缺陷:LLM通常校准能力很差,经常对错误输出表现出高置信度。

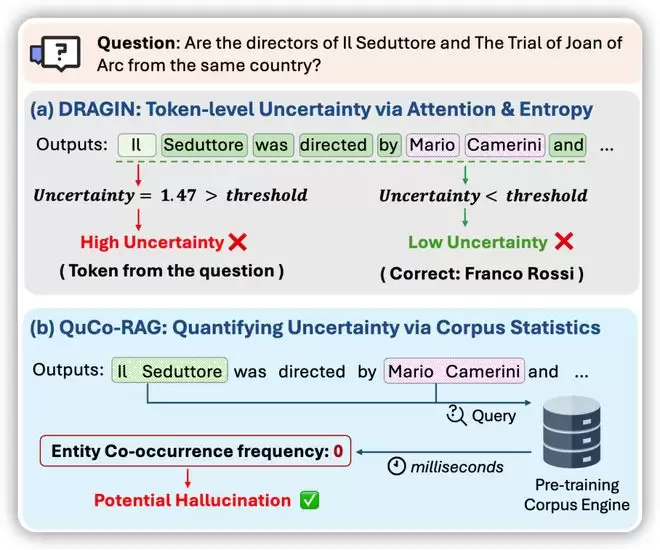

DRAGIN vs QuCo-RAG对比。(a)DRAGIN依赖模型内部信号,错误地将问题中的「Il」标记为高不确定性,却对幻觉出的错误导演名显示低不确定性。(b) QuCo-RAG通过预训练语料中的零共现检测,正确识别出幻觉。

DRAGIN在生成错误的导演名「Mario Camerini」时显示低不确定性(Uncertainty < threshold),却对问题中的普通token「Il」报出高不确定性(Uncertainty = 1.47 > threshold)。

这就是所谓的「自信地胡说八道」(confident hallucination)——模型不知道自己不知道,内部信号完全失效。

更根本地,近期理论工作(Kalai & Vempala, 2024)证明:对于罕见事实,即使是完美校准的模型也必须产生幻觉以维持统计一致性。

那么,有没有一种方法,能绕过这些不可靠的内部信号?

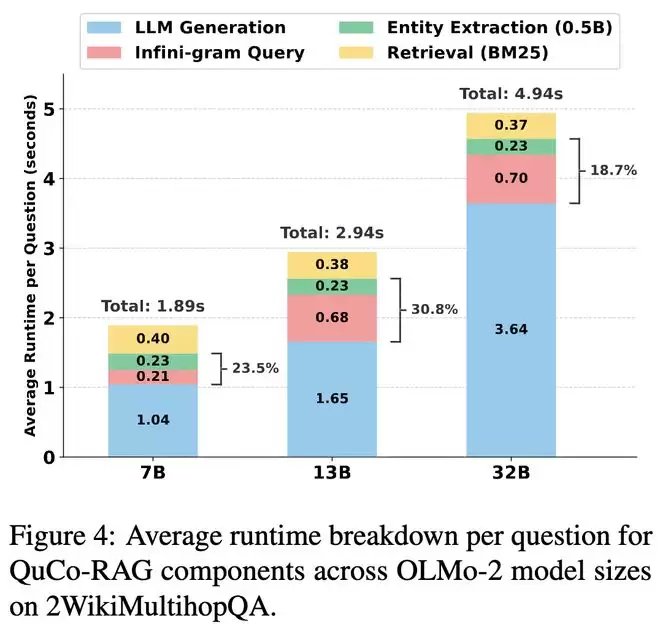

伊利诺伊大学芝加哥分校、纽约大学、与蒙纳士大学的联合团队提出QuCo-RAG,首次跳出「从模型自己内部信号来评估不确定性」的思维定式,转而用预训练语料的客观统计来量化不确定性,在多跳QA基准上对OLMo系列模型实现5-14个EM点的显著提升,并且有效性成功迁移至Llama3、Qwen2.5、GPT4.1/5等预训练数据未公开的模型。

论文链接:https://arxiv.org/abs/2512.19134

开源代码:https://github.com/ZhishanQ/QuCo-RAG

QuCo-RAG的核心洞察是:LLM的事实知识本质上由预训练语料塑造。

低频实体 = 长尾知识风险:如果一个实体在预训练语料中很少出现,模型就难以可靠地记忆关于它的知识。

零共现 = 幻觉高风险:如果两个实体在整个预训练语料中从未在同时出现,那么模型声称的它们之间的关系就缺乏任何证据支撑——这几乎必然是幻觉。

更重要的是,这种因果关系是不对称的:

共现 ≠ 正确(两个实体可能以不同关系共现)

零共现 ≈ 幻觉(模型无法可靠地生成训练数据中从未见过的实体关系)

基于这一洞察,QuCo-RAG从「主观内部置信度」转向「客观语料统计」,通过Infini-gram引擎对4万亿token的OLMo-2预训练语料进行毫秒级查询,实现精准的检索触发。

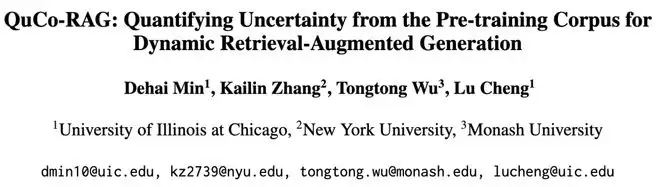

QuCo-RAG框架总览。两阶段检测:生成前知识评估(检查实体频率)+ 运行时声明验证(检查实体共现)。

QuCo-RAG通过两阶段检测机制量化不确定性:

第一阶段:生成前知识评估(Pre-Generation Knowledge Assessment)

在模型开始生成之前,系统首先「诊断」输入问题:

提取问题中的关键实体(如Silas Hardy、Lee Mantle);

查询每个实体在4万亿token预训练语料中的出现频率;

如果平均频率低于阈值(默认1000次),触发检索;

核心逻辑:低频实体代表「长尾知识」,模型很可能没有可靠记忆。

第二阶段:运行时声明验证(Runtime Claim Verification)

在模型生成过程中,系统持续监控每个生成的句子:

使用轻量级0.5B模型提取知识三元组(头实体, 关系, 尾实体);

查询头尾实体在预训练语料中的共现次数;

如果共现次数为0,触发检索并重新生成;

核心逻辑:零共现意味着模型正在「无中生有」——编造训练数据中从未出现过的实体关系。

毫秒级语料库查询

如何在4万亿token的语料库上实现实时查询?

QuCo-RAG利用Infini-gram引擎——一个基于后缀数组的索引系统,支持对万亿级token语料库的毫秒级频率和共现查询。

轻量级三元组提取器

为了最小化开销,团队从GPT-4o-mini蒸馏了一个专用的0.5B三元组提取模型,基于Qwen2.5-0.5B-Instruct微调。

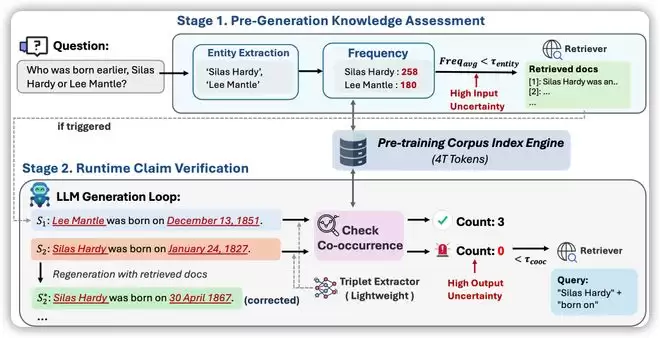

QuCo-RAG各组件运行时间分解。LLM生成占主导(55-74%),Infini-gram查询仅占18-31%,证明语料库检测引入的开销适度。

实验结果

全面领先,迁移能力惊人

OLMo-2全系列5-12点提升

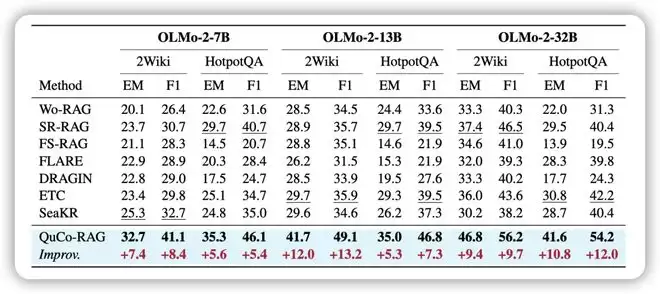

QuCo-RAG在所有模型规模和数据集上均取得最佳性能,EM提升5-12点。

在2WikiMultihopQA和HotpotQA两大多跳QA基准上,QuCo-RAG在OLMo-2全系列模型(7B、13B、32B)上全面超越所有baseline:

OLMo-2-7B:+7.4 EM (2Wiki), +5.6 EM (HotpotQA)

OLMo-2-13B:+12.0 EM (2Wiki), +5.3 EM (HotpotQA)

OLMo-2-32B:+9.4 EM (2Wiki), +10.8 EM (HotpotQA)

而基于内部信号的方法(FLARE、DRAGIN、ETC、SeaKR)表现极不稳定,有时甚至不如简单的单轮检索(SR-RAG)。

主实验为什么选择OLMo-2?

QuCo-RAG的核心是利用预训练语料的统计信息。但一个关键问题是:如何验证「语料统计」这个信号源本身是有效的?

这就需要一个「匹配语料」设置——即模型的预训练数据必须完全公开,才能精确计算实体频率和共现统计。

OLMo-2是目前满足这一条件的高性能代表性开源模型:

提供完整的4万亿token预训练语料

性能与Qwen2.5等主流模型相当

覆盖7B/13B/32B多个规模

这使得OLMo-2成为验证QuCo-RAG核心假设的理想测试平台。

跨模型迁移:代理语料库同样有效

一个关键问题:如果模型的预训练数据不公开怎么办?

研究团队验证了一个重要假设:网络规模的预训练语料库之间存在大量重叠。

因此,使用OLMo-2的语料库作为「代理语料库」,同样可以有效指导其他模型。

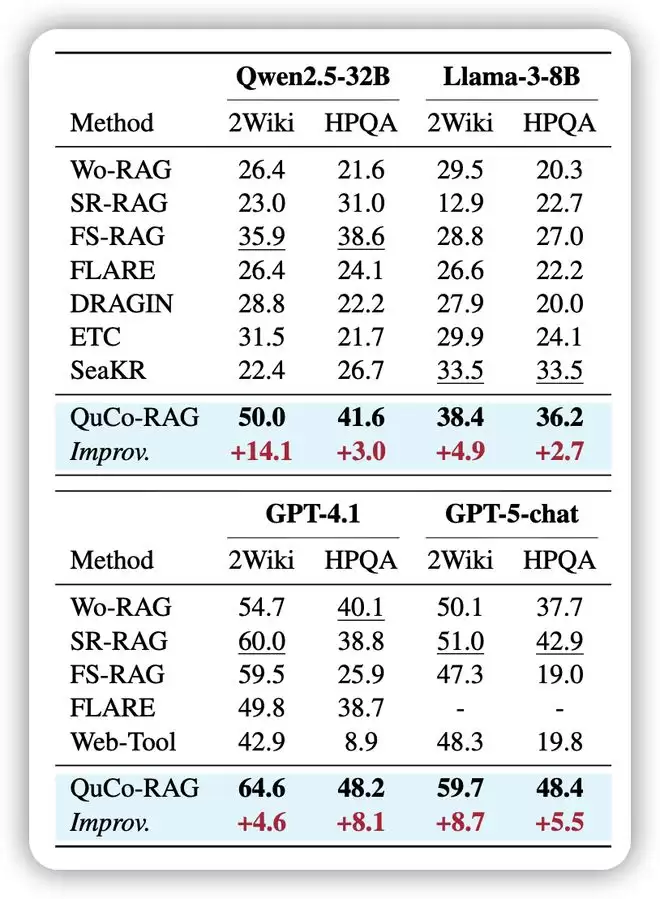

QuCo-RAG在Qwen2.5、Llama-3、GPT-4.1、GPT-5等模型上均实现显著提升。

关键发现:

Qwen2.5-32B:2WikiMultihopQA上提升14.1 EM

GPT-5-c h a t:2WikiMultihopQA上提升8.7 EM

相比之下,GPT模型自带的Web搜索工具反而低于不检索基线(可能因为网络噪声)

效率分析:更少检索,更高性能

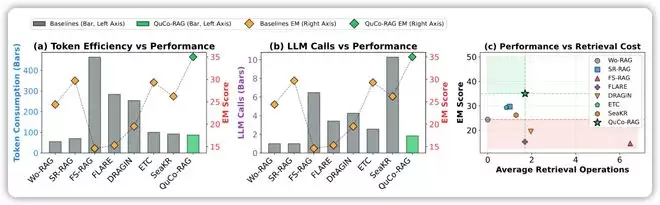

效率-性能权衡分析。QuCo-RAG以最少的token消耗和LLM调用次数达到最高EM。

QuCo-RAG实现了「精准狙击」式的检索:

平均每个问题仅触发1.70次检索

token消耗仅87个,LLM调用仅1.84次

而FS-RAG和DRAGIN消耗2-4倍的token,性能却大幅落后

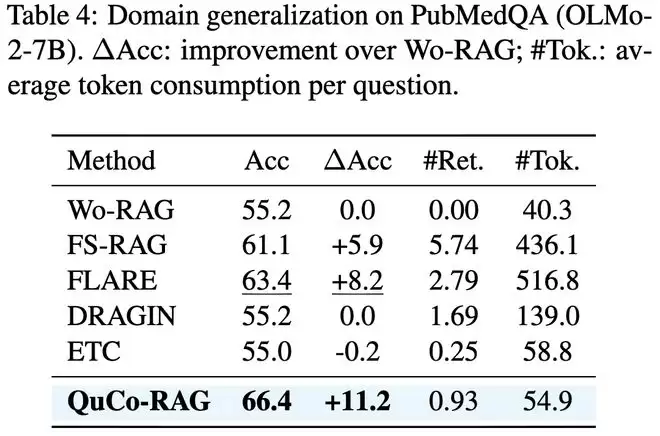

领域泛化:生物医学问答同样有效

在PubMedQA生物医学问答基准上,QuCo-RAG同样表现出色:

QuCo-RAG在PubMedQA上达到66.4%准确率,超越Wo-RAG 11.2个百分点。

内部信号方法在这个专业领域暴露出两种失败模式:

过度检索:FLARE平均2.79次检索,token消耗516。显著高于它在通用领域的检索次数和token消耗。

检索不足:DRAGIN和ETC触发检索的次数显著低于它在通用领域的检索次数。Acc表现与不检索基线持平。

QuCo-RAG则两者兼顾:平均0.93次检索,54.9个token,最高准确率。

深度分析:为什么实体频率分析有效?

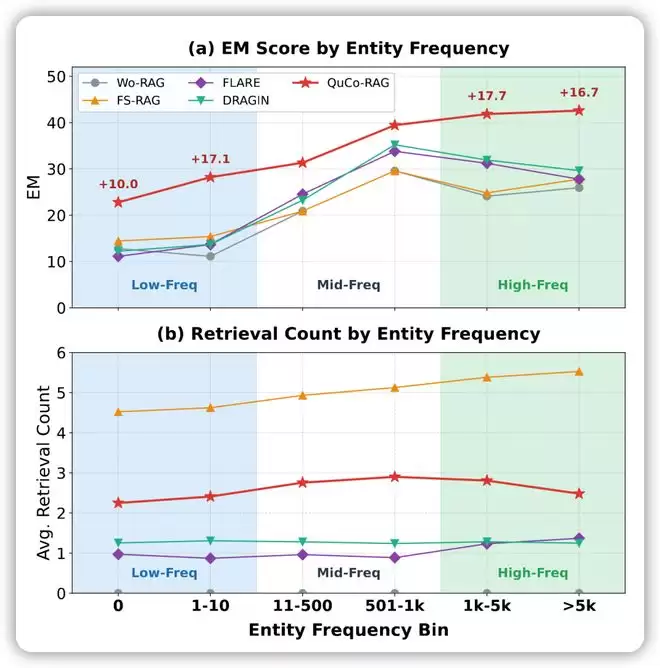

按实体频率分层的性能分析。低频区QuCo-RAG优势明显,高频区优势依然保持。

研究团队按实体在语料库中的出现频率将问题分组,揭示了有趣的规律:

低频区:模型缺乏知识,但内部信号无法识别这种知识缺陷

中频区:模型处于「部分学习」状态,熵等内部信号变得相对有效

高频区:实体频率 ≠ 事实频率——即使实体常见,它们的特定关系可能罕见

这最后一点尤为重要:高频实体让模型「过度自信」,但QuCo-RAG通过共现检测捕捉到模型对熟悉实体的错误关系声明。

深远影响与未来方向

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

工信部发布防范 OpenClaw(“龙虾”)开源智能体安全风险“六要六不要”建议

工信部发布“六要六不要”,为OpenClaw(“龙虾”)开源智能体安全风险划出红线 近日,工业和信息化部网络安全威胁和漏洞信息共享平台发布了一份重磅文件,针对当前热门的OpenClaw(因其图标酷似龙虾,业内常昵称为“龙虾”)开源智能体,提出了清晰的安全使用指引——“六要六不要”。这份建议可不是空穴

荣耀 CEO 李健:荣耀机器人全栈自研,将聚焦消费市场

荣耀CEO李健详解机器人战略:全栈自研,聚焦三大核心消费场景 荣耀春季旗舰新品发布会圆满结束后,关于公司未来发展的蓝图更加清晰。在随后的媒体沟通会上,荣耀CEO李健不仅公布了年度销售目标,更首次系统性地阐述了荣耀在机器人领域的完整战略规划与市场布局。 在探讨机器人业务发展方向时,李健明确了荣耀的坚定

别只盯着“上门装龙虾赚26万”!看懂OpenClaw背后的“意图入口”大战

别再只关注“上门装龙虾赚26万”!深度解读OpenClaw背后的“意图入口”新战争 最近科技行业的热潮,充满了戏剧性的现实色彩。一只“红色龙虾”AI智能体搅动了整个市场:有人通过提供安装服务,收取每次五百元,短短几天就赚取二十六万元收入;腾讯大厦前甚至排起长队,大家竞相领取免费的安装体验权限。这场全

openclaw安装配置

一、系统要求 在开始安装 OpenClaw 之前,请务必确认您的计算机满足以下最低配置要求。这如同搭建房屋前检查地基,是确保后续安装流程顺利、软件稳定运行的前提。更高的硬件配置将为复杂任务处理和流畅体验提供有力保障。 操作系统:支持 Windows 10 及以上版本、macOS 最新稳定版,以及主流

自研第一个SKILL-openclaw入门

自研第一个SKILL:手把手教你开发openclaw自定义技能 当你成功构建好openclaw之后,如何让它真正“智能”起来?关键在于为其开发SKILL——这些技能是openclaw的“内功心法”,决定了它能帮你做什么、做多好。 本文将带你亲自动手,从零开始开发你的第一个openclaw自定义技能,

- 日榜

- 周榜

- 月榜

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程