英伟达重塑AI单用户性能:2万Tokens/秒,能耗骤降千倍

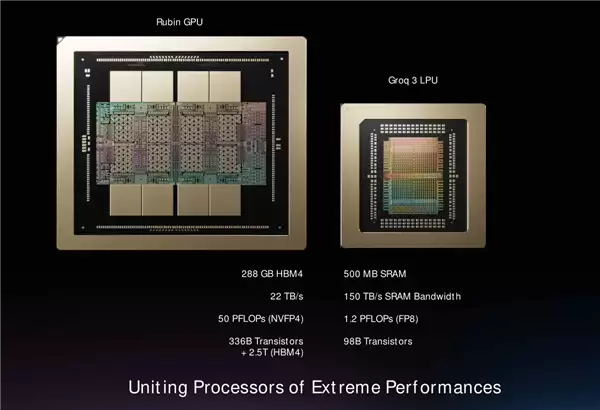

3月23日消息,如果说前几年的AI重点是训练,那么现在的重点是推理,NVIDIA上周的GTC大会上已经发布了全新的LPU芯片,就是要重塑AI推理。

在GTC大会期间,NVIDIA首席科学家Bill Dally跟谷歌首席科学家Jeff Dean两位大神有了一番精彩的深度访谈,其中Dally就谈到了NVIDIA在做的一些研究进展。

AI推理对延迟的要求很高,Dally指出目前的瓶颈已经不是算力本身,瓶颈在通信开销上,NVIDIA正在研究片上通信的静态调度,将会彻底取消路由开销、排队和仲裁,通信速度接近光速本身。

目前的技术方案中,芯片从一角到另一角的延迟有几百纳秒之多,NVIDIA的技术方案可以做到30纳秒。

片外通信中,之前的方案是一步步提高带宽速率,现在做到了400Gbps甚至800Gbps,但这样的带宽也带来了复杂的信号处理及纠错机制,但速度如果从400Gbps降低到200Gbps,复杂问题反而会消失,只做序列化延迟的话,几个时钟周期就能完成。

Dally表示他有信心未来AI推理可以做到单用户每秒10000到20000Token的推理速度——作为对比,大家要知道目前很多人用在大模型AI推理速度,普遍在100Token每秒以内,甚至每秒60Token以上的速度就算高速了。

Dally表示做到这样的速度前提是用对了架构,他还以NVFP4精度做了例子对比,用这种精度做一次乘加运算需要消耗10飞焦的能量,但HBM4从外部读取数据大约消耗15皮焦能量,差距是1000倍以上。

改用SRAM缓存的话,读取数据的能耗也会变成10飞焦了,跟计算过程的消耗一个级别。

不过SRAM也不是没代价的,芯片成本比HBM还会高的,GTC大会上NVIDIA发布的LPU芯片LPU30也只能集成500MB SRAM缓存,跟GPU集成的288GB HBM4不是一个量级的。

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

国产内存新架构突破30TB带宽实现自主供应链

随着人工智能技术从模型训练大规模转向实际应用部署,AI算力的需求重心正发生深刻变化。一个关键的行业转折点已经到来:单纯追求算力峰值不再是唯一焦点,内存带宽与延迟正成为制约性能提升的新瓶颈。如何构建高带宽、低延迟、高能效的内存子系统,已成为全球AI芯片行业必须攻克的核心挑战。近期,国内科技企业在这一前

Edge浏览器网页捕获功能使用教程 截取全屏与区域截图详解

Edge浏览器内置了强大的网页截图功能,无需安装插件。可通过右上角菜单、快捷键Ctrl+Shift+S、网页右键菜单、开发者工具命令或地址栏常驻按钮启动。支持截取整个长网页或自定义选定区域,截图后可直接编辑保存。

千度手机版官网免费入口手机端专用访问链接

千度是一个免注册、无广告的教育信息服务平台,提供资料库、文苑、课栈等核心板块。平台内容涵盖广泛学习资料,支持离线缓存与语义搜索,移动端设计简洁,无广告干扰。所有资源免费开放,不收集用户敏感信息,无商业化会员体系,注重隐私保护与内容纯粹性。

ES文件浏览器复制文件内容到剪贴板详细步骤教程

使用ES文件浏览器复制文件时,需先开启剪贴板悬浮按钮。长按文件可呼出菜单进行复制,也可批量选择多个文件一并复制。如需复制文件路径,则需长按文件进入属性页面,手动复制路径文本。若使用平板或外接键盘,还可通过Ctrl+C快捷键快速完成复制操作。

如何设置鼠标连点器的固定点击间隔秒数

鼠标连点器通过设定毫秒级点击间隔实现精准自动化操作。用户需将目标秒数换算为毫秒值进行设置,并可配置热键、点击按键与固定坐标。建议正式使用前进行测试验证,并注意避免间隔过短或安全软件拦截,以保障运行稳定。

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程

热门话题

热门话题