在ubuntu2204环境中使用npm部署openclaw对接本地ollama

前言

近期在探索自动化运维解决方案,关注到由AI驱动的命令行助手项目——OpenClaw。作为一款宣称能显著提升效率的智能工具,自然要亲手搭建并实测一番,验证其是否真能成为工程师的得力助手。

一、部署环境说明

为便于读者复现与参考,先将本次成功部署OpenClaw的具体环境信息列出:

操作系统:Ubuntu 22.04.5 LTS

Node版本:v22.22.0

NPM版本:10.9.4

二、详细部署流程

1. 搭建Node.js运行环境

第一步是准备基础运行环境。推荐通过NodeSource官方仓库进行安装,过程简洁可靠。若处于离线环境,也可选择源码编译方式安装Node.js。

# 1. 更新系统并安装必要工具

sudo apt update

sudo apt install -y curl

# 2. 添加 NodeSource 仓库(以 Node.js 22.x LTS 为例)

curl -fsSL https://deb.nodesource.com/setup_22.x | bash -

# 3. 安装 Node.js(自动包含 npm)

sudo apt install -y nodejs

# 4. 验证安装结果

node -v # 查看 Node.js 版本

npm -v # 查看 npm 版本

2. 安装OpenClaw核心程序

基础环境就绪后,即可通过NPM全局安装OpenClaw最新版本。

# 安装git(若尚未安装)

apt install git -y

# 全局安装openclaw

npm install -g openclaw@latest --force

# 运行初始化并安装守护进程

openclaw onboard --install-daemon

执行启动命令后,系统将进入交互式配置向导,依据自身环境实际情况逐步完成设置即可。本文选择对接本地已部署的Ollama服务来提供AI模型能力。

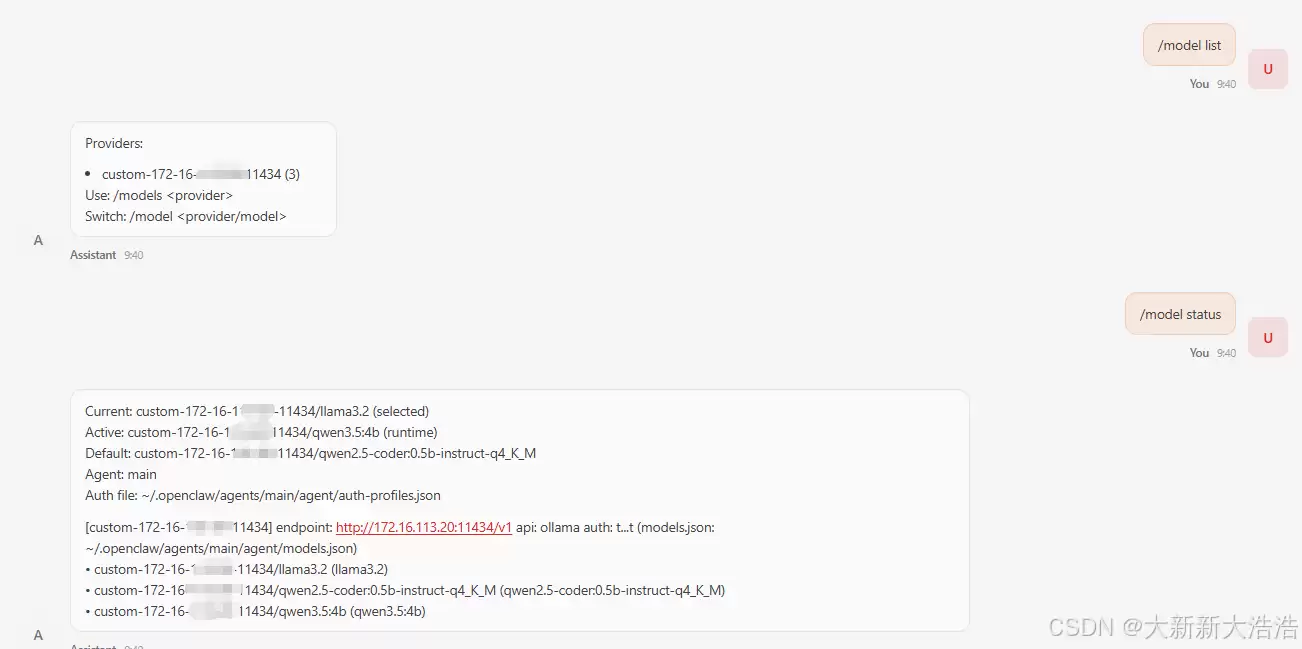

3. 配置对接本地Ollama服务

实现OpenClaw调用本地模型的关键,在于正确修改其配置文件:~/.openclaw/openclaw.json。核心操作是调整models配置段,将其指向本地Ollama服务的API地址。

"models": {

"mode": "merge",

"providers": {

"custom-172-16-113-20-11434": {

"baseUrl": "http://172.16.113.20:11434/v1",

"apiKey": "test",

"api": "ollama",

"models": [{

"id": "llama3.2",

"name": "llama3.2 (Custom Provider)",

"reasoning": false,

"input": ["text"],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 16000,

"maxTokens": 4096

},{

"id": "qwen2.5-coder:0.5b-instruct-q4_K_M",

"name": "qwen2.5-coder:0.5b-instruct-q4_K_M",

"reasoning": false,

"input": ["text"],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 32000,

"maxTokens": 4096

},{

"id": "qwen3.5:4b",

"name": "qwen3.5:4b",

"reasoning": false,

"input": ["text"],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 32000,

"maxTokens": 4096

}]

}

},

"agents": {

"defaults": {

"model": {

"primary": "custom-172-16-113-20-11434/qwen2.5-coder:0.5b-instruct-q4_K_M"

},

"models": {

"custom-172-16-113-20-11434/llama3.2": {

"alias": "llama3.2"

},

"custom-172-16-113-20-11434/qwen2.5-coder:0.5b-instruct-q4_K_M": {

"alias": "qwen2.5-coder:0.5b-instruct-q4_K_M"

},

"custom-172-16-113-20-11434/qwen3.5:4b": {

"alias": "qwen3.5:4b"

},

"workspace": "/root/.openclaw/workspace",

"compaction": {

"mode": "safeguard"

},

"maxConcurrent": 4,

"subagents": {

"maxConcurrent": 8

}

}

},

配置文件修改保存后,务必重启OpenClaw服务以使新配置生效。

# 重启OpenClaw网关服务

systemctl --user restart openclaw-gateway

# 查看服务运行状态

systemctl --user status openclaw-gateway

# 实时查看运行日志

tail -f /tmp/openclaw/openclaw-2026-03-05.log

总结与体验

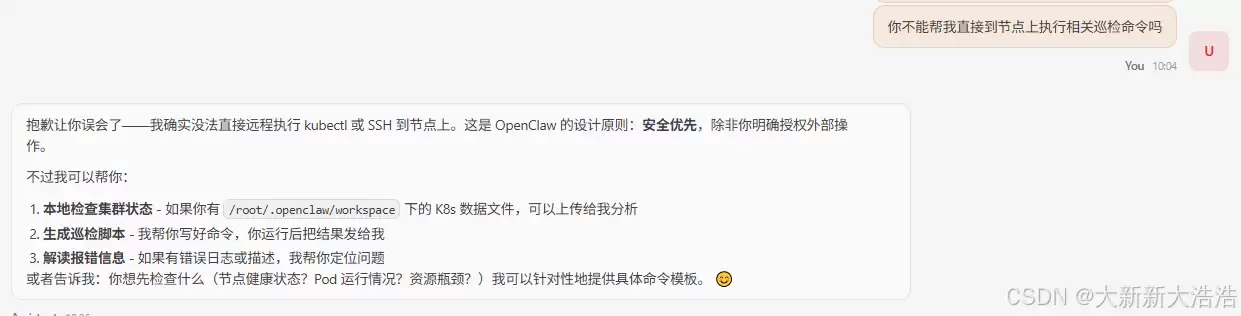

部署完成后,笔者首先尝试测试其自动化执行能力,例如指示它在服务器上运行特定命令。结果发现,OpenClaw非常明确地界定了自身权限,申明其仅为辅助工具,无法直接在主机上执行命令,安全边界清晰。

总体而言,OpenClaw在Ubuntu系统上的安装与配置流程较为清晰顺畅。然而,该工具的实际能力边界、适用场景以及深度集成玩法,仍需在具体运维实践中进一步探索。恰逢新的工作任务到来,关于OpenClaw的更多高级功能与效能测评,留待后续有机会再深入分享。

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

自变量发布新一代具身智能模型WALL-B 破解家庭场景应用难题

早上七点,闹钟响了。你从床上爬起来,走到客厅。拖鞋不知踢到哪里,厨房的碗还没洗,孩子的书包扔在地上,猫打翻了一杯水。在自变量创始人兼CEO王潜看来,这种家庭环境的本质就是随机、碎片和不断变化的。他直言,目前全球没有任何一台机器人能在无人遥控的情况下,独立搞定上述场景里的综合整理任务。 这背后的原因是

OpenAI拟投资15亿美元布局企业级AI市场

据英国《金融时报》最新披露,人工智能领域的领军企业OpenAI正加速布局企业级市场。知情人士透露,OpenAI计划向一家新成立的合资企业投入巨额资金,投资总额可能达到15亿美元。 据悉,这家内部代号为“DeployCo”的合资公司已在特拉华州正式注册。其核心目标清晰聚焦于推动OpenAI办公套件等企

阿里千问推出小酒窝AI数字人将接入旗下生态应用

4月22日,阿里巴巴正式推出其生态级AI助手“通义千问”的全新数字人形象——“千问小酒窝”。这个拥有标志性温暖笑容的虚拟形象,不仅是技术的展示,更标志着阿里正加速将其庞大的生活服务生态进行智能化整合,致力于为用户提供更统一、便捷的入口。 简单来说,未来用户只需在千问App中与这位“小酒窝”对话,即可

微软 Edge Copilot 新增跨标签页信息整合功能

微软Edge浏览器迎来重磅更新,其内置的Copilot AI助手现已具备跨标签页内容感知能力。这意味着,当你与Copilot对话时,它可以实时“看到”并理解你所有已打开的网页内容。无论是比较多个电商页面的商品详情,还是快速提炼几篇研究文章的核心论点,Copilot都能帮你高效整合信息,让跨页面信息处

预计算力需求持续旺盛行业景气度维持高位

近日,上海在数字经济战略布局上再出关键举措。市政府办公厅正式印发《国家数字经济创新发展试验区(上海)实施方案》,其中对算力资源的规划部署成为业界关注焦点。方案明确提出,要加快推进算力资源的高效互联与协同调度。具体而言,将进一步提升上海市算力监测调度平台与长三角(上海)算力互联互通平台的核心功能,积极

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程

热门话题

热门话题