Transformer与RNN合体,谷歌打下显存门槛,解锁超长上下文

谷歌再出招:为RNN引入可扩展记忆缓存,挑战Transformer的显存效率瓶颈

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

编辑|泽南

近期,谷歌在优化大模型内存效率方面持续发力,接连推出创新技术方案。

上个月,其TurboQuant研究成果在业界引发广泛关注,该技术声称能将大模型推理中消耗大量显存的KV Cache压缩数倍,一度引发市场对未来硬件内存需求的重新评估,相关讨论热度至今未减。

本周,谷歌团队再次发布一篇重磅论文,聚焦于解决大模型处理长文本序列时的核心难题——内存瓶颈问题。此次研究的技术路径与之前截然不同,旨在从模型架构层面寻求突破。

研究团队独辟蹊径,通过对经典循环神经网络(RNN)架构进行机制创新,为其赋予了“可动态增长的记忆容量”。这项技术探索了一条融合Transformer与RNN各自优势的新路径,旨在实现性能与效率的更好平衡。

简而言之,该方法有望显著提升AI模型处理超长上下文序列的能力,同时大幅降低推理阶段对计算资源和显存的需求。这一特性被许多业界专家视为实际生产部署中梦寐以求的关键改进,消息公布后立即获得了高度关注。

Transformer架构的挑战与RNN模型的局限性

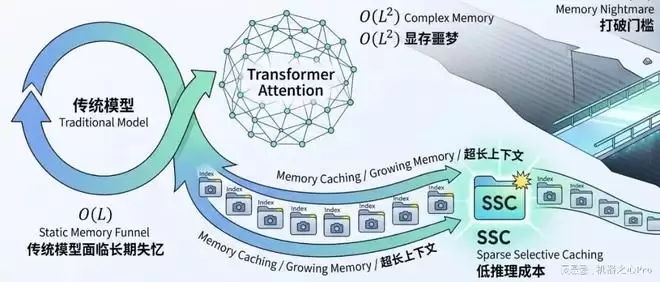

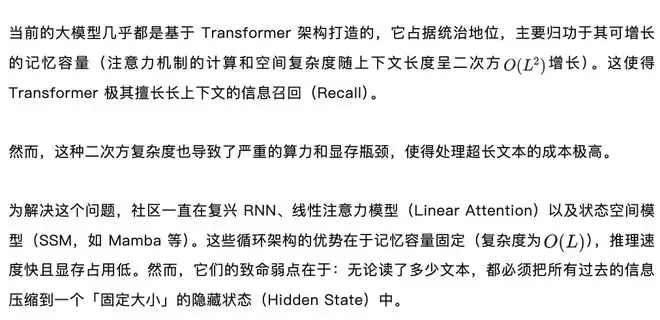

当前,绝大多数主流大语言模型都基于Transformer架构构建。其统治地位的核心来源于注意力机制所带来的强大记忆容量——模型能够访问并关联上下文中的所有标记。这使得Transformer在需要长距离信息依赖和精准召回的任务上表现卓越。

然而,这一优势也伴随着显著的代价:注意力机制的计算复杂度和内存占用随序列长度呈二次方增长。这导致在处理超长文本时,算力消耗和显存需求急剧上升,成本变得非常高昂。

为了突破这一效率瓶颈,学术界和产业界一直在探索替代架构,例如复兴循环神经网络(RNN)、研究线性注意力模型以及开发如Mamba之类的状态空间模型。这些循环类架构的核心优势在于其固定的记忆状态和线性的计算复杂度,因而在推理速度和内存占用上更具效率。但它们的固有缺陷同样突出:无论输入多长的历史信息,都必须被压缩到一个固定维度的隐藏状态中。

这种“信息压缩”过程不可避免地会导致部分细节丢失,使得此类模型在需要从极长文档中进行密集、精确信息提取的任务上,性能通常落后于Transformer。

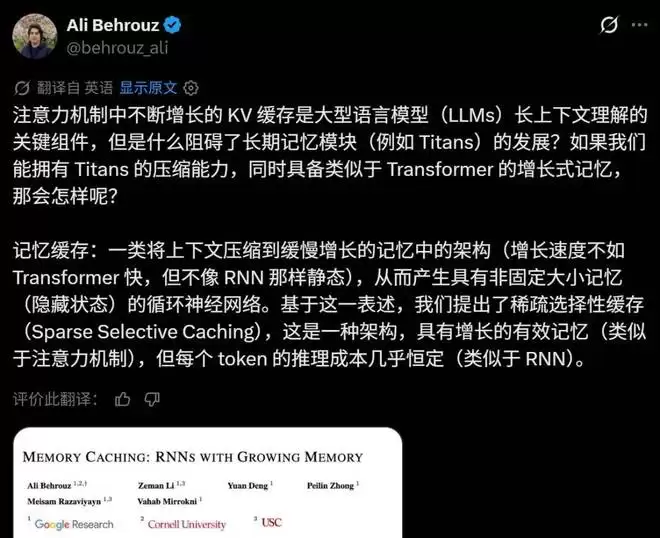

创新解决方案:为RNN集成“记忆缓存”机制

为了打破上述僵局,Google Research团队提出了一项名为“记忆缓存”(Memory Caching, MC)的创新技术。该方法的核心理念直观而有效。

论文:《Memory Caching: RNNs with Growing Memory》论文链接:https://arxiv.org/abs/2602.24281

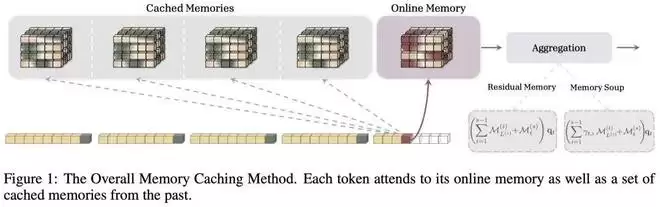

从架构演进的视角来看,存在一个技术光谱:一端是缓存每个标记的Transformer(无压缩),另一端是仅维护单一隐藏状态的传统RNN(完全压缩)。而“记忆缓存”技术则开创了介于两者之间的新范式——它将成组的标记信息压缩后缓存为长期记忆单元,并在需要时进行高效检索。

可以这样类比:Transformer为每个单词保留了独立的“笔记”,而传统RNN只有一页不断擦写的“草稿纸”。记忆缓存技术则允许RNN拥有一个“活页夹”,定期将重要的“草稿内容”存档为不可更改的页面。当模型需要追溯历史信息时,不仅能查看当前的草稿纸,还能快速翻阅存档的活页,从而大幅提升信息检索的准确性和完整性。

三种关键技术变体:从增长成本到恒定成本

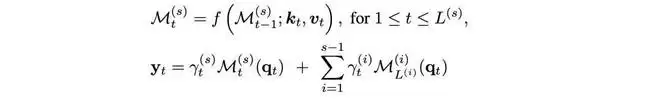

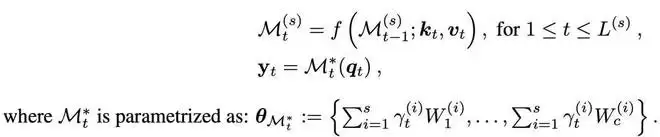

在验证过程中,研究团队设计了三种主要的MC实现变体,其核心区别在于如何整合与利用缓存的历史信息。

1. 门控残差记忆(Gated Residual Memory):该方法利用当前查询从历史缓存中检索相关信息,然后通过类似注意力机制的池化操作来融合这些信息。这使得模型的有效记忆容量能够随着上下文增长而扩展,但相应地,每个标记的解码成本也会增加。

2. 记忆汤(Memory Soup):这种变体选择在记忆权重层面进行融合,而非针对特定查询的输出。它首先对历史记忆的权重执行注意力池化,然后基于池化后的综合记忆进行一次检索。同样,其有效记忆随序列增长,解码成本也随之上升。

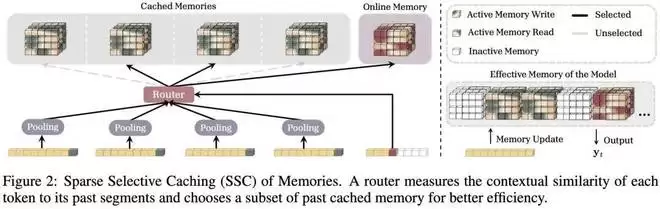

3. 稀疏选择性缓存(Sparse Selective Caching, SSC):前述两种方法似乎印证了“没有免费午餐”的定律——必须在增长的有效记忆和恒定的解码成本间权衡。

为此,作者提出了SSC变体。它借鉴了混合专家模型的思路,在序列维度上稀疏地激活并选择过去缓存记忆的一个子集。通过这种设计,模型在保持有效记忆容量增长的同时,能够将每个标记的解码成本控制在相对恒定的水平。

实际性能评估:实验数据揭示效果

那么,记忆缓存方法的实际效能究竟如何?

首先,MC具备良好的通用性,可以作为一个即插即用的框架,灵活集成到多种现有的循环架构中,例如线性注意力模型或作者之前提出的Titans深度记忆模型。

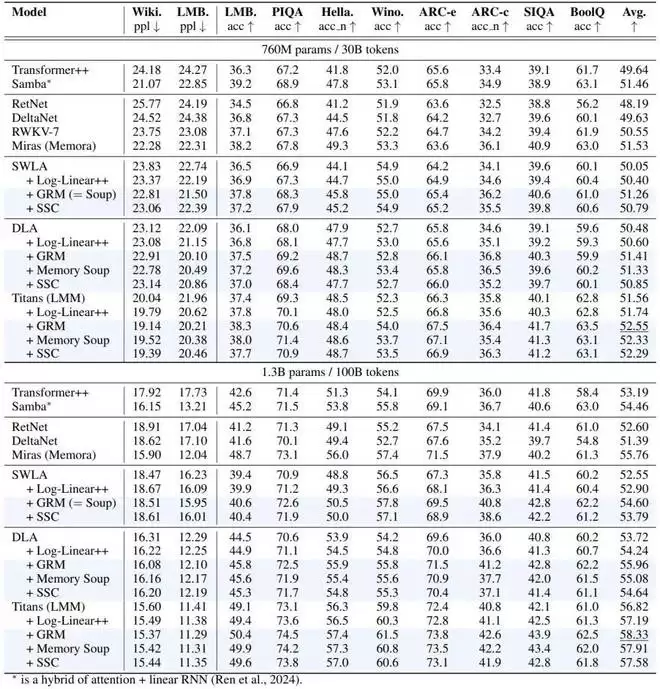

实验数据证实了其显著的有效性:

(模型在语言建模和常识推理任务上的性能对比。)

研究团队在13亿参数规模的模型上进行了广泛测试,包括语言建模、密集型召回任务、长上下文理解以及“大海捞针”等基准评估。结果显示,引入MC机制的模型相比基础循环模型,性能获得了普遍且显著的提升。具体表现在:

长上下文处理能力增强:在语言建模和长文档理解任务中,搭载MC的循环模型性能全面优化。

逼近Transformer性能:在最能体现模型记忆能力的“上下文内精确召回”任务中,加入MC的模型超越了其他先进的循环架构,显著缩小了与Transformer的性能差距。

承认现有上限:论文也客观指出,尽管MC极大改善了RNN类模型的信息召回短板,但在对记忆精度要求极端严苛的纯粹密集召回任务上,Transformer架构目前仍保持着最高的性能上限。

总结与展望:新路径开启,行业格局或生变

总而言之,这项研究基于一个巧妙而优雅的算法洞察——缓存历史状态快照,成功应对了一个长期困扰非Transformer架构的理论与实践难题。它使得RNN、状态空间模型等替代架构在实用化与高性能化的道路上迈出了坚实一步。

尽管在极限召回精度上尚未完全超越Transformer,但一条清晰且富有潜力的新技术路径已然展现。随着循环类架构的持续演进与优化,Transformer在长上下文处理领域一家独大的市场格局,很可能迎来新的挑战与变革。

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

Ager.fun

Ager fun是什么 想看看自己小时候的可爱模样,或是白发苍苍时的慈祥神态吗?现在,这不再只是想象。Ager fun就是这样一个由开发者打造的AI工具,它的玩法很简单:你上传一张自己的照片,它就能借助先进的AI技术,为你生成从婴儿到百岁老人,横跨整个人生阶段的模拟图像。本质上,它为你提供了一面“时

Botme.io

Botme io是什么 简单来说,Botme io是一个专为快速构建AI聊天机器人而生的平台。它的诞生,源于一个直接的需求:让非技术背景的小企业主和网站管理员,也能在几分钟内拥有一个属于自己的智能客服。这个工具的核心使命很明确——用可负担的成本和极简的设置,来提升客户互动效率。本质上,它通过自动应答

句无忧

句无忧是什么 在内容为王的时代,一句不慎就可能让精心策划的营销活动前功尽弃。这时候,一个可靠的“文案安检员”就显得至关重要。句无忧,正是为此而生的一款AI工具。它由专业团队打造,核心使命就是帮用户快速揪出文案中的那些“雷区”——无论是违禁词、极限词还是敏感词,都能被它精准识别。 它的服务场景覆盖极广

Ghost AI

Ghost AI是什么 说到处理邮件,很多人的第一反应可能就是头疼。面对每天涌入收件箱的几十上百封邮件,分类、回复、归档……简直是场持久战。这时候,一个得力的助手就显得至关重要了。Ghost AI,正是为此而生的一款AI驱动的电子邮件助手,由GhostAI公司开发。它的目标很明确:帮专业人士和所有对

有道速读

有道速读是什么 面对海量文档需要快速理清头绪?有道速读,正是网易有道为此场景量身打造的一款AI阅读助手。它直击用户从文档中迅速提取、定位和汇总核心信息的需求,提供了一站式的论文与文档速读方案。对于那些需要在短时间内消化大量文本的人来说,这无疑是个得力工具。值得一提的是,网易有道作为国内智能学习领域的

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程

热门话题

热门话题