DeepSeek 全系模型上线讯飞开放平台:首发精调,限时免费

DeepSeek 全系模型上线讯飞开放平台:首发精调,限时免费

2月10日,讯飞开放平台带来一则重磅消息:DeepSeek-V3和DeepSeek-R1模型现已全面上线。这不仅仅是简单地上架两个模型,而是为开发者提供了一套完整的“组合拳”——支持通过公有云API直接调用,也允许一键部署专属模型。更值得关注的是,平台首发了DeepSeek大模型的精调服务,这意味着开发者能够根据自己的业务场景数据,深度定制出更聪明、更贴合业务需求的专属模型。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

官方介绍中有一个亮点,那就是DeepSeek R1的蒸馏模型精调服务。这项技术基于优质的开源小模型进行蒸馏优化,效果颇为显著。怎么说呢?它能在保持强大逻辑推理能力的前提下,让模型的推理速度提升3倍以上,而部署成本则大幅下降80%。最终呈现的结果,是一个能力不减、但体态却更加轻盈的模型,对于追求效率与成本平衡的团队而言,这无疑是个好消息。

当然,市场推广的诚意也直接给足了。即日起到3月10日,DeepSeek推理API将免费开放试用。此外,讯飞开放平台承诺提供从模型训练、部署调试到场景优化的全流程云服务,并给出了高达99.97%的服务等级协议(SLA)保障。这相当于为开发者的落地应用上了一道保险。

那么,具体如何调用和开始精调呢?方式很清晰:

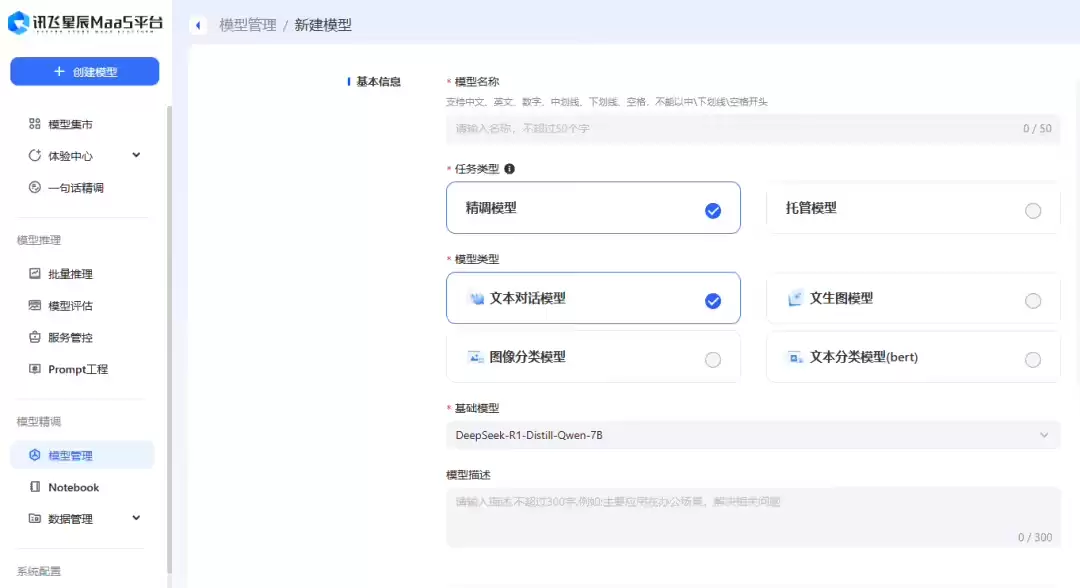

- 首先,登录星辰MaaS平台,进入模型集市,找到目标模型点击「精调」入口。

- 接着,填写并提交申请表单,待审核通过后,便可点击「创建模型」。随后,选择对应的基础模型,上传自己的数据集,提交训练任务即可启动专属模型的打造过程。

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

Llama 3 科研论文润色_学术词汇表加载对模型体积的增加量

部署Llama 3科研润色系统时,如何控制学术词汇表带来的体积增量? 如果你正在为Llama 3部署一套科研论文润色系统,加载一个专用的学术词汇表来提升术语准确性,几乎是必选项。但随之而来的问题是:这个操作会给模型体积带来多大影响?答案是,这完全取决于你选择哪种加载方式。不同的策略,带来的存储开销差

微信消息情感陪伴:OpenClaw设定人设实现沉浸式聊天

一、通过Config yaml注入基础人设参数 想让OpenClaw在微信里变成一个“有血有肉”的长期伙伴?最根本的方法,就是直接修改它的核心配置文件。这种方式相当于为AI设定了一个“出厂人格”,一旦配置完成,每次启动都会自动加载,并且在整个对话生命周期中保持稳定。配置文件中的参数会被记忆模块持久化

Canva可画在线设计工具官网 Canva网页版入口直达

Canva可画:在线设计工具的官网入口与核心体验解析 Canva可画官网入口为https: www canva cn,提供简洁直观的网页版设计体验:无需下载、分类清晰、操作即时反馈、参数双模式调节;海量中文模板、AI生图 改写 抠图 排版、跨端同步、协作管理及本土化适配。 从零开始的创意工作,常常

llama.cpp量化部署实战_4bit压缩显存占用技巧

一、选择合适量化方案并确认GGUF格式支持 想在消费级硬件上跑大模型,第一步往往就卡在显存或内存不足上。问题的根源通常是原始FP16格式的模型权重太“占地方”。别急,通过llama cpp进行4-bit量化,能显著压缩模型体积,让部署成为可能。这里,我们重点聊聊实操步骤。 llama cpp本身支持

HermesAgent数据岭回归:Anomaly集成实战

HermesAgent数据岭回归:Anomaly集成实战 在利用Hermes Agent进行岭回归建模时,如果发现模型的稳定性和预测精度总被一些“不速之客”——异常值——所干扰,这通常意味着数据中潜藏着未被识别或处理的离群点。别担心,这并非无解。下面这五条将异常检测机制无缝集成到岭回归流程中的操作路

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程

热门话题

热门话题