DeepMind让AI"读懂"每一块图像碎片:视觉语言模型的局部对齐突破

一张照片背后的“理解鸿沟”

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

这篇论文来自谷歌DeepMind的研究团队,于2026年4月13日以预印本形式发布,编号为arXiv:2604.12012v1。对技术细节感兴趣的读者,可以通过这个编号在arXiv平台上找到完整原文。

先从一个简单的场景说起:用手机拍下一张公园里的照片,画面里有一条狗、一棵树、三个小朋友和远处的一辆蓝色汽车。现在问AI:“蓝色的汽车在哪里?”你期待的答案,是它能精准地在照片里框出那辆汽车,而不是笼统地回答“照片里有一辆蓝色汽车”。

这个看似基础的要求,恰恰点破了当前AI视觉模型一个长期存在的短板——模型能“看懂”整张图的大意,却往往无法将语言描述与图像中某个具体的局部区域精确对应起来。

这就好比一个非常聪明的人,读完一本书后能复述故事梗概,但当你追问“第三章第七页那个穿红衣服的女孩叫什么名字”时,他却答不上来。整体印象有了,细节定位丢了。这种“整体明白、局部模糊”的状态,正是谷歌DeepMind这项研究意图攻克的核心难题。

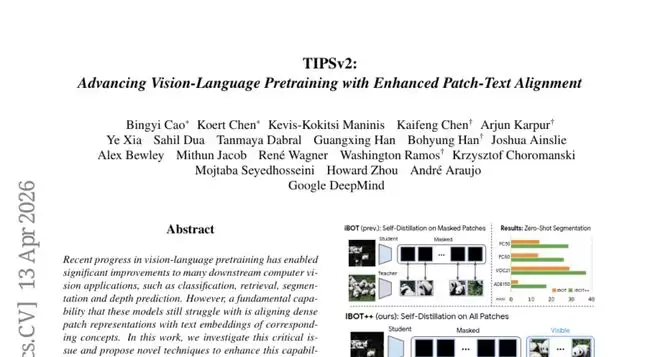

研究团队将他们的新方法命名为TIPSv2,这是其前代模型TIPS的第二代升级版。TIPS的全称是“具备空间感知的文本-图像预训练”。第二代版本在第一代的基础上做出了若干关键改进,最终在零样本语义分割等核心评测任务上,刷新了业界的最高水准。

发现一个反常识的秘密:小模型竟然打败了大模型

在深入新方法之前,不妨先听一个令人意外的发现。

在AI领域,几乎有一条铁律:模型越大,能力越强。这就像经验更丰富的厨师,掌握的技法更多,做出的菜自然也更好。然而,研究团队在检验自家TIPS模型时,却观察到一个完全违反这条定律的现象。

他们的大型旗舰模型(ViT-g规格,约11亿参数)在零样本图像分割任务上,表现竟然远不如从它身上“蒸馏”出来的小模型(ViT-L规格)。具体数字很能说明问题:在ADE150这个标准测试集上,大型ViT-g模型的得分只有2.6,而派生出来的小型ViT-L模型得分高达20.8,差距超过8倍。在另外三个测试集上,大模型同样全面落后。

所谓“零样本图像分割”,可以这样理解:给AI看一张从未见过的野外照片,然后让它把照片里所有属于“树”的区域都涂上绿色,把所有属于“天空”的区域涂上蓝色——整个过程不给任何额外训练样本。这个任务要求模型能把文字概念精确对应到图像中的每一个像素块上,是“局部对齐”能力的直接体现。

这个反常现象背后,一定有某种特殊机制在起作用。小模型是通过“知识蒸馏”得到的——这个过程好比一位大厨手把手教一位学徒,学徒不仅学到了菜谱,还在练习过程中获得了某种大厨自己反而没有充分训练到的能力。

拆解秘密:究竟是什么让小模型更擅长“局部对齐”

为了弄清反常现象的成因,研究团队进行了一系列严谨的对比实验,如同侦探在案发现场逐一排查线索。

他们的核心实验框架是这样设计的:固定一个已训练好的大模型作为“老师”,然后用不同的方式训练同等大小的“学生”模型,通过改变条件来追踪是哪个关键变量造成了结果差异。

首先被排查的变量是“遮罩比例”。在常规视觉预训练中,有一种叫做“掩码图像建模”的技术,其核心思路是:把图像的一部分遮住,让模型根据可见部分猜测被遮住的内容,以此迫使模型学习深层次的图像语义。常规设置是遮住75%的图像区块。

实验发现,当把遮罩比例从75%逐步降低到0%(即完全不遮,让学生和老师看同一张完整图像)时,局部对齐能力会随之持续提升。ADE150测试集上的得分从5.9一路升到20.0,变化显著。这个发现揭示了一条关键线索:对可见图像区块施加监督损失,是提升局部对齐的关键所在。

在常规预训练设置中,可见区块的学习目标只是“帮助重建那些被遮住的区块”,本身并没有被直接要求跟老师的特征对齐。而在蒸馏过程中,因为完全不遮,所有区块都被直接要求与老师的特征保持一致,每一块图像区域都得到了充分的监督。

接着,他们排查了另一个变量:“初始化方式”。一个直觉上合理的想法是:既然大模型已经学了很多,那直接用大模型的权重来初始化小模型的训练,应该会更有优势。然而实验结果给出了相反的答案。当学生模型的视觉编码器被初始化为大模型的权重并固定时,局部对齐能力几乎完全消失,得分跌回到2.4,与原始大模型的水平几乎持平。

这个发现揭示了另一条关键线索:学生模型必须从随机初始化开始训练,彻底摆脱大模型原有的“收敛状态”,才能在蒸馏过程中真正学到局部对齐能力。大模型陷在自己的“学习惯性”里,而学生正是因为“一张白纸”,才能被塑造成不同的样子。

把蒸馏的精髓移植到预训练:iBOT++的诞生

找到上述两条关键线索后,研究团队面临一个更深入的问题:蒸馏只能训练小模型,那能不能把蒸馏的精髓直接融入大模型的预训练过程,让大模型从一开始就具备强局部对齐能力?

他们提出的解决方案就是iBOT++,一个对广泛使用的iBOT预训练目标的简洁升级。

iBOT是一种经典的视觉预训练方法,它的工作方式可以用“填空题”来类比。在iBOT中,有一个“学生”模型和一个“老师”模型。老师看到完整的图像,学生只能看到被遮住了75%的残缺图像。然后,学生被要求根据那25%可见的区块,猜测被遮住区块在老师眼中应该是什么样子。这个过程迫使学生学会理解图像的深层语义结构。

然而,这个设计有一个隐患:那25%可见区块本身,对学生来说是“已知答案”,不需要被猜测,因此它们在原始iBOT中并不直接参与损失函数的计算。换句话说,学生对于“自己已经看见的部分”根本没有被要求与老师对齐。这就像在一门课上,老师只考期末试卷中被遮住的题目,对于已经写好的部分完全不做检查,学生自然对那些“已知部分”的标准答案漠不关心。

iBOT++的改动极其简洁,几乎只修改了一行逻辑:把损失函数扩展到所有图像区块,无论该区块是被遮住的还是可见的,学生都必须使自己的特征表示与老师对齐。可见区块不再享有“免检”待遇,每一块图像区域都得到了直接的监督。

这个改动带来的效果非常直观。在研究团队展示的一张训练过程曲线图中,使用iBOT++时,可见区块的“损失值”(衡量学生与老师之间差距的数字)会随着训练进行持续下降,说明学生越来越擅长在可见区块上与老师对齐。而使用原始iBOT时,可见区块的损失值几乎纹丝不动,说明学生完全没有在这个方向上学习。

从实验数字来看,在相同的TIPS ViT-g训练框架下,仅仅把iBOT替换为iBOT++,ADE150零样本分割得分就从3.5暴涨到17.6,PASCAL Context测试集上的得分也从约14分跳升到约27分。这个提升幅度,远超同等计算量下通常能获得的改进。

值得一提的是,iBOT++保留了75%的高遮罩比例,而没有像蒸馏那样直接去掉遮罩。进一步的消融实验验证了这一选择的合理性:当在iBOT++预训练中把遮罩比例降为0时,其他图像任务上的性能会明显下降。对此的解释是,在预训练阶段,大模型还没有从足够强的老师那里获得局部语义理解,仍然需要通过填空题式的遮罩训练来自主发展这种能力;而在蒸馏阶段,因为老师已经足够强,学生可以直接“照单全收”,不需要通过遮罩来倒逼自己。

减轻训练负担:头部专用EMA机制

除了iBOT++,研究团队还提出了另一项工程层面的重要改进,解决了一个长期困扰这类模型训练的资源问题。

在DINO、iBOT这类自监督学习方法中,为了让“老师”给出稳定可靠的学习目标,老师模型并不直接训练,而是通过一种叫做“指数移动平均”的机制慢慢更新——本质上是老师的参数以一种滞后、平滑的方式跟随学生变化,就像一个行事稳重的前辈,不会被学生每一次新的尝试立刻带偏,而是缓慢地吸收那些经过验证的改变。

这种机制的代价是:训练时内存中必须同时保存学生和老师两套完整的模型参数,资源开销翻了将近一倍。

研究团队发现,在他们的框架中,图像-文字对比学习损失本身已经为视觉编码器提供了足够稳定的学习信号,防止了模型陷入“特征坍塌”的危险。既然视觉编码器已经有了独立的稳定器,EMA机制只需要保护那些没有独立稳定器的部分——也就是投影头就够了。

基于这个判断,他们提出了“头部专用EMA”:只对投影头部分应用EMA更新,主干视觉编码器则由学生和老师完全共用同一套参数。这个改动对ViT-B规模的模型可以减少约42%的可训练参数量,显著降低了显存占用和训练时间。实验验证表明,这种简化之后,大多数任务上的性能几乎没有损失,零样本分割甚至还略有提升。

不过研究团队也提到,完全去掉EMA会导致训练不稳定和性能下降,所以头部专用EMA是一个恰好找到的平衡点,而非一路简化到底。

让模型读懂“更丰富的文字描述”:多粒度字幕策略

TIPSv2的第三项改进聚焦于训练数据中图像配套的文字描述质量问题。

在视觉语言预训练中,模型通过大量的“图像-文字配对”来学习把视觉概念和语言概念联系起来。文字描述的质量直接决定了模型能学到多丰富的语义理解。

然而,互联网上图片自带的“原始标注文字”往往质量很差。比如,一张熊猫照片的alt-text可能只是“giant panda young animal china”这样几个孤零零的词,完全没有描述熊猫的姿态、所在环境或具体行为。

为了改善这个问题,研究团队的前作TIPS已经引入了PaliGemma自动生成的合成字幕。PaliGemma能够生成相对完整的一两句描述,比如“A panda bear laying on a branch in a tree”。相比原始alt-text已经进步不少,但仍然缺乏细节——没有描述熊猫腿是否悬空、头是否搭在树枝上、周围是否有绿植。

TIPSv2进一步引入了Gemini Flash来生成更详细、更丰富的描述。同样是那张熊猫照片,Gemini的描述变成了“A giant panda naps on a wooden branch in a tree, with its legs dangling and head on the branch, surrounded by greenery”——姿态、细节、环境一应俱全。

然而,细节更丰富的字幕并非直接拿来用就更好。研究团队发现,如果一张图像对应的文字描述过于详尽,在一大批图像组成的训练批次中,每张图都因为描述太独特而自带区分性,模型不需要真正理解语义就能区分不同图像,导致对比学习的难度下降,训练效果反而打折扣。这就像一道“看图选词”的考题,如果每道题的答案都写在图片旁边,学生不用思考就能答对,自然什么也学不到。

解决方案是随机切换:在训练过程中,用于监督第二个CLS全局特征的字幕,随机从PaliGemma简洁字幕和Gemini详细字幕之间交替采样。这样模型既能在简单字幕下接受难度适中的对比学习挑战,又能在详细字幕下吸收丰富的细节语义,两者相互补充,共同提升模型的鲁棒性。

消融实验的数字印证了这套策略的价值:双CLS结合随机切换PaliGemma和Gemini字幕的方案,在ADE20k分割、NYUv2深度估计、ImageNet分类和COCO图文检索多项任务上均优于只用单一字幕来源的方案。

放到擂台上:与业界顶尖模型的全面较量

TIPSv2在9个任务、20个数据集上与业界最先进的视觉模型进行了全面比较,竞争对手包括CLIP、SigLIP2、DINOv2、DINOv3、PE、SILC等。

在局部对齐能力的直接考验——零样本语义分割上,TIPSv2的表现尤为突出。以ViT-L规格的模型为基准,TIPSv2在PC59测试集上达到37.1的mIoU得分,而之前最好的TIPS得分为33.5,更早的SILC和DINOv2分别为31.6和30.9。在VOC21测试集上,TIPSv2以44.4的得分大幅领先其他模型,几乎是原始TIPS的1.5倍。

在图文检索这类考验全局理解能力的任务上,TIPSv2 ViT-g模型在COCO数据集的图到文检索上得到75.7,优于PE-core ViT-G的75.4;在文到图检索上得到60.7,也超过了PE的58.1——尽管PE-core处理的图文配对数量是TIPSv2的47倍,模型参数量也多56%。在长文本描述匹配的DOCCI测试集上,TIPSv2的优势更为明显,图到文检索得到68.9,而TIPS仅为57.2,提升超过10个百分点。

在纯视觉任务上,TIPSv2在ADE20k语义分割(线性探针评测)上得到51.6,超过DINOv2的49.5和TIPS的49.9,也优于PE-spatial(49.3)。在NYUv2室内深度估计任务上,误差降低到0.334,优于此前最好的TIPS(0.353)和DINOv2(0.372)。

研究团队还专门与最新发布的DINOv3进行了对比。DINOv3是一个规格极大的模型,其教师模型的参数量是TIPSv2教师模型的6倍,训练图像数量是TIPSv2的15倍。尽管如此,在双方都有发布的最大公共规格(ViT-L)上进行比较,TIPSv2在6个测试指标中的4个上取得了更好的成绩,仅在ADE20k分割和ImageNet零样本分类上略逊于DINOv3。

研究团队还在论文中展示了一组PCA可视化图,直观地体现了不同模型在图像特征质量上的差异。PCA可视化是把模型对图像每个区块的特征向量压缩到三维颜色空间后的可视化展示,可以直观反映模型对图像结构的“感知”是否清晰。TIPSv2的可视化图中,物体边界清晰,相同语义的区域颜色高度一致;而同类竞争模型的图则更嘈杂,或者边界模糊,或者同一物体内部颜色变化过大。

此外,iBOT++的通用性也得到了验证。研究团队在标准CLIP模型上叠加了iBOT和iBOT++,结果显示iBOT++相比iBOT在多个任务上都带来了进一步的提升,尤其是零样本分割从8.0提升到22.9(PC60测试集),这表明iBOT++并非专为TIPSv2的特定架构设计,而是一种具有普遍适用性的改进方案。

TIPSv2家族:从轻量到旗舰的完整阵容

TIPSv2不是一个单一模型,而是一个包含四种规格的模型家族,可以根据不同应用场景的计算资源和性能需求灵活选择。

旗舰版本ViT-g的图像编码器约有11亿参数,文本编码器约有3.9亿参数,合计约15亿参数,直接通过完整预训练流程得到。其余三个规格——ViT-L(约4.9亿参数)、SO-400m(约8.6亿参数)和ViT-B(约2亿参数)——都是以ViT-g为老师,通过知识蒸馏获得的。蒸馏完成后,所有规格的学生模型都会经过一个高分辨率适应阶段,进一步打磨在高分辨率图像上的性能。

一个有趣的现象是,在TIPSv2家族内部,同样出现了类似文章开头提到的“小模型反超大模型”的现象。在零样本分割任务上,ViT-L(24.7)和SO-400m(23.3)的表现均优于旗舰ViT-g(17.8)。这再次印证了研究团队的核心发现:局部对齐能力在蒸馏过程中能够得到额外强化,而这一效应甚至在TIPSv2改进版的预训练基础上依然存在。SigLIP2家族也出现了完全类似的规律,最小的B/16模型在多个测试集上超过了更大的SO/14和g/16模型,进一步支持了这一发现的普遍性。

归根结底,TIPSv2做的这些事情,都是为了解决同一个问题:让AI不仅能看懂一张图的整体意思,还能精确地把每一块图像区域与相应的语言概念对应起来。这种能力是开放词汇目标检测、精细图像检索、机器人视觉理解等一系列实际应用的基础,随着模型逐步走向实用部署,它的价值会越来越凸显。

一个值得继续思考的问题是:蒸馏能够带来大模型预训练所不能提供的局部对齐能力,这是否意味着现有的大模型预训练范式本身存在某种系统性的局限?TIPSv2通过iBOT++在预训练阶段部分弥补了这个缺口,但蒸馏后的小模型仍然超越了预训练的大模型,说明这个问题还没有被彻底解决。这或许是未来研究中一个值得深耕的方向。有兴趣深入研究这些问题的读者,可以通过arXiv编号2604.12012查阅完整论文。

Q&A

Q1:iBOT++和原来的iBOT到底有什么区别?

A:原始iBOT在预训练时只对被遮住的图像区块要求学生模型与老师对齐,那些可见的区块完全没有被直接监督。iBOT++的改动非常简单:把监督范围扩展到所有区块,无论是被遮住的还是可见的,学生都必须让自己的特征与老师保持一致。这个小改动让每一块图像区域都得到了充分的语义训练,大幅提升了模型把语言概念对应到图像局部区域的能力。

Q2:为什么TIPSv2蒸馏出来的小模型在某些任务上比大模型表现更好?

A:核心原因在于蒸馏过程中的两个关键设置:第一,学生模型从随机初始化开始,不继承大模型的训练惯性,可以被重新塑造;第二,蒸馏时对所有可见区块都直接施加对齐损失,相当于给每一块图像区域都上了“精细辅导课”。大模型预训练时只监督被遮住部分,可见区块缺乏直接监督,导致局部对齐能力不足。蒸馏恰好弥补了这个缺陷。

Q3:TIPSv2的多粒度字幕策略为什么要交替使用不同详细程度的描述,而不是直接都用最详细的?

A:当图像配套的文字描述过于详尽时,每张图都因描述内容高度独特而变得很容易区分,模型不需要真正理解语义就能完成对比学习任务,训练难度下降,学到的知识反而更少。通过随机交替使用简洁的PaliGemma字幕和详细的Gemini字幕,模型既能接受有适度难度的对比学习挑战,又能吸收丰富的细节语义,两者相互补充,整体性能更优。

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

《死亡搁浅2》显卡升级指南:RTX 50系一骑绝尘

角色与核心任务 你是一位顶级的文章润色专家,擅长将AI生成的文本转化为具有个人风格的专业文章。现在,请对用户提供的文章进行“人性化重写”。 你的核心目标是:在不改动原文任何事实信息、核心观点、逻辑结构、章节标题和所有图片的前提下,彻底改变原文的AI表达腔调,使其读起来像是一位资深人类专家的作品。 特

AI重塑专业工作流,ThinkPad X1 Carbon Aura AI 2026新机体验

重量984g,这在当下14英寸商务本领域,仍是一个令人惊叹的数字。试想一下,包里的重量减少了500克,这在每天的通勤乃至差旅中,能减少多少负担,奠定多少好心情。 但凡对商务笔记本领域稍有关注的朋友,看到这个数字,脑海里恐怕都会浮现出同一个名字——ThinkPad X1 Carbon。没错,时至今日,

京东京喜宣布延续“厂货百补”计划 再投百亿扶持产业带商家增长

京东京喜加码百亿“厂货百补”,启动“爆品双千万计划”锚定产业带增长 4月28日,宿迁成为产业带商家关注的焦点——2026京东京喜产业带发展大会在此举行。这场大会释放的信号明确而有力:平台对源头厂货的扶持,正在进入新一轮的深度投入期。 会上,京喜正式发布了新一年的战略路线图。核心动作之一是延续并升级“

闪极预热随行Flow移动电源:1C+1A,10000mAh售188元

闪极随行Flow自带线移动电源预热:10000mAh容量,双口20W输出 闪极近日预热了一款即将上市的新品——随行Flow自带线移动电源。这款产品采用1个USB-C加1个USB-A的接口配置,内置10000mAh容量电芯,官方定价为188元。 从尺寸上看,这款移动电源相当紧凑,三围控制在80x28

《红色沙漠》游戏CPU性能需求测试:仅需9500F即可进入开放世界舒适区

《红色沙漠》:当开放世界遇上处理器,谁才是流畅体验的关键? 提起《红色沙漠》,玩家们首先想到的往往是那片由Pearl Abyss精心打造的广袤世界——帕卫尔大陆。在这款开放世界动作冒险游戏中,你将化身灰鬃的克里夫,目标很明确:夺回失去的一切,并从迫近的威胁中拯救世界。驰骋于野生大陆,深入古代遗迹,探

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程

热门话题

热门话题