Stable Diffusion 入门指南,Stable Diffusion WebUI本地部署教程

Stable Diffusion WebUI 本地部署:一份避坑指南

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

最近在部署 Stable Diffusion 项目环境时,发现网上很多教程都只讲了“标准流程”,但实际安装过程中,依赖版本冲突、网络问题等“坑点”层出不穷。经过几轮折腾和测试,总算总结出一套比较顺畅的部署方案。如果你也打算在本地搭建一套可用的 SD 环境,不妨跟着下面的步骤走,能省去不少试错时间。

项目地址依然是:https://github.com/AUTOMATIC1111/stable-diffusion-webui

环境准备

工欲善其事,必先利其器。一个稳定的基础环境能避免很多后续麻烦。以下是本次部署成功验证的环境配置,可以作为重要参考:

- Python 3.10.6(这个版本是关键,过高或过低都可能引发兼容性问题)

- NVIDIA RTX 4090 24GB

- Windows 11

- CUDA 12.4

部署过程

按部就班地切换目录、逐个安装依赖,过程相当繁琐。更高效的思路是脚本化。这里分享一个自动化的安装流程,能一次性搞定大部分依赖。

第一步,克隆主项目仓库:

git clone https://github.com/AUTOMATIC1111/stable-diffusion-webui.git

cd stable-diffusion-webui接着,创建一个独立的 Conda 环境来隔离依赖:

conda create -p .\Dlab python=3.10.6 -y然后,创建一个专门存放依赖库的目录:

mkdir -p repositories && cd repositories核心来了。下面这个脚本可以自动克隆并安装一系列必要的扩展仓库,省去手动操作的麻烦:

repos=(

"Stability-AI/stablediffusion:stable-diffusion-stability-ai"

"CompVis/taming-transformers:taming-transformers"

"sczhou/CodeFormer:CodeFormer"

"salesforce/BLIP:BLIP"

"Stability-AI/generative-models:generative-models"

)

for repo in "${repos[@]}"; do

IFS=':' read -r github_path local_path <<< "$repo"

echo "正在克隆并安装 $github_path..."

git clone "https://github.com/$github_path.git" "$local_path"

cd "$local_path"

pip install -e .

cd ..

done脚本执行完毕后,回到主目录,安装其他核心依赖。以下几个包的版本组合是经过反复测试的“黄金搭档”,能有效避免版本冲突:

# 安装基础依赖

pip install transformers==4.19.2 diffusers invisible-watermark --prefer-binary

# k-diffusion 必须从 git 安装最新版

pip install git+https://github.com/crowsonkb/k-diffusion.git --prefer-binary

# 回到主目录安装项目依赖

cd ..

pip install -r requirements.txt --prefer-binary

# 这些版本都是我反复测试过的,建议按照这个版本安装

pip install pytorch_lightning==1.9

pip install -U xformers==0.0.28.post2 torchvision==0.20.0 torchaudio==2.5.0 --index-url https://download.pytorch.org/whl/cu124

pip install pydantic==1.10.11

pip install wandb==0.15.12一切就绪后,使用以下命令启动服务:

python launch.py --xformers --no-gradio-queue踩坑记录

- 依赖版本冲突

这是最令人头疼的问题,尤其是 PyTorch、CUDA 和 xformers 之间的版本必须精确匹配。上文列出的版本组合是验证可行的方案,强烈建议首次部署时严格遵循。 - 网络问题

在克隆仓库和下载依赖时,稳定的网络环境至关重要。必要时需要配置科学上网或使用可靠的国内镜像源来加速下载过程。

中文汉化

对于中文用户来说,将界面汉化能极大提升操作体验。过程非常简单:

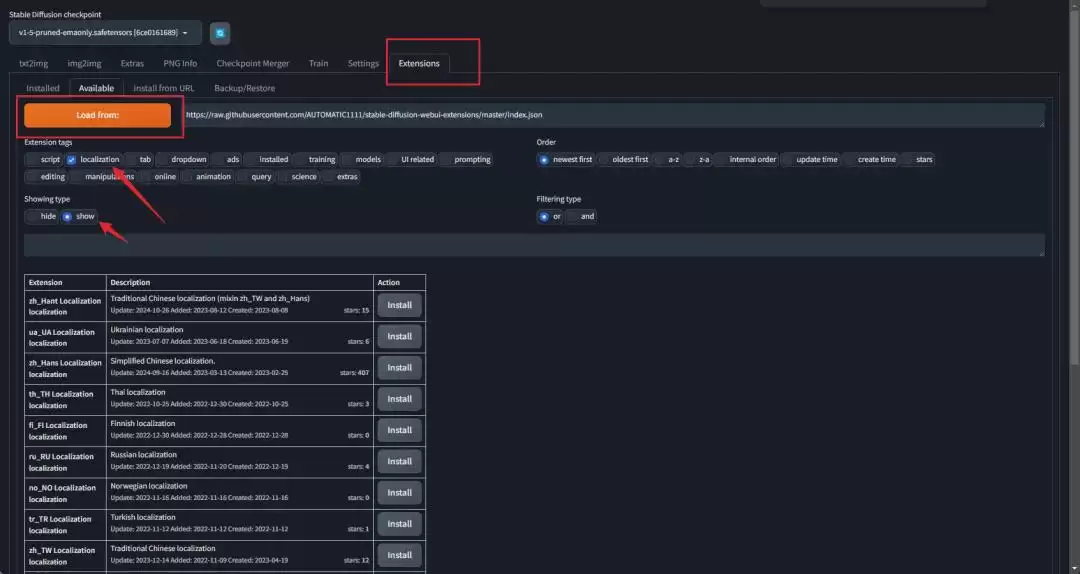

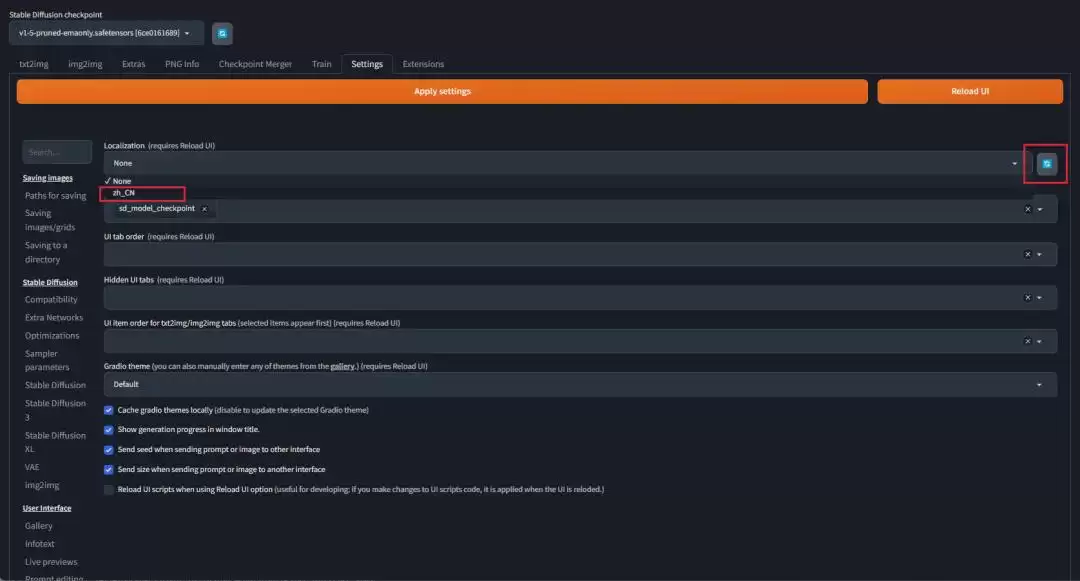

进入 WebUI 界面后,点击 Extensions 选项卡,然后选择 Load from 按钮。

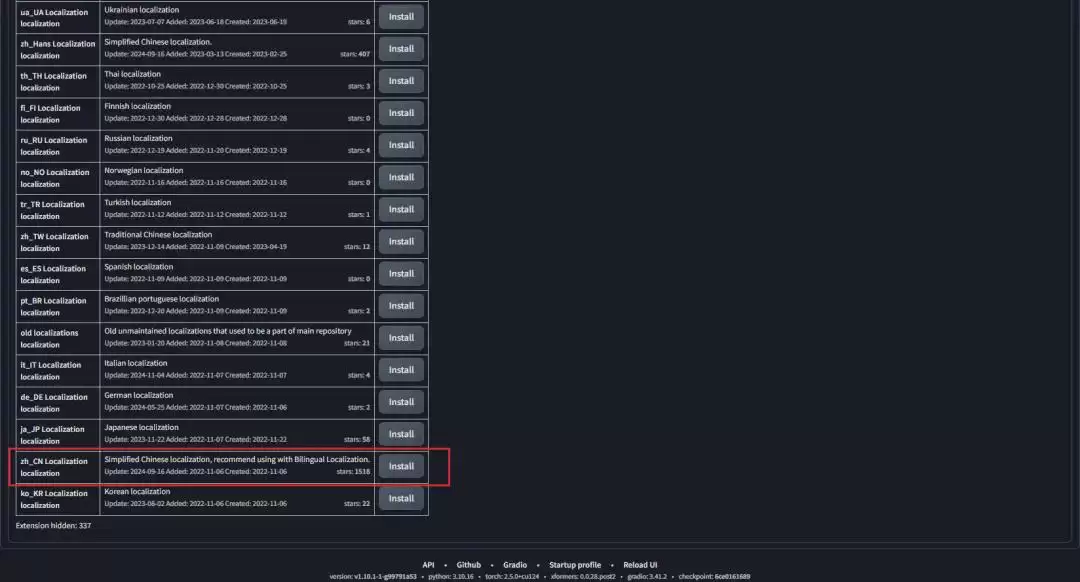

在扩展列表中找到 zh_CN Localization,点击其右侧的 Install 按钮进行安装。

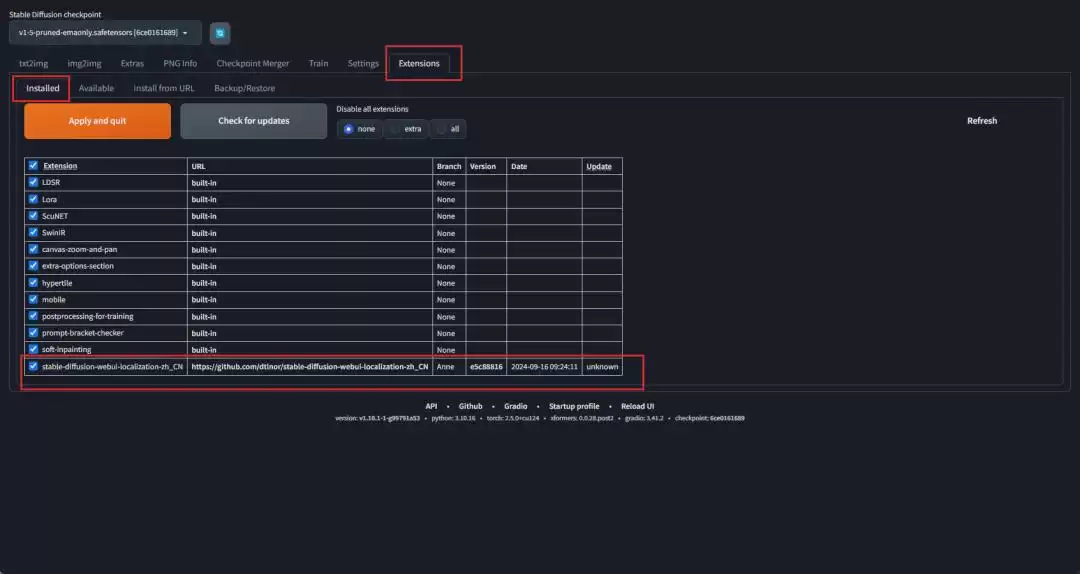

安装完成后,可以在 Installed 标签页下看到已安装的插件。

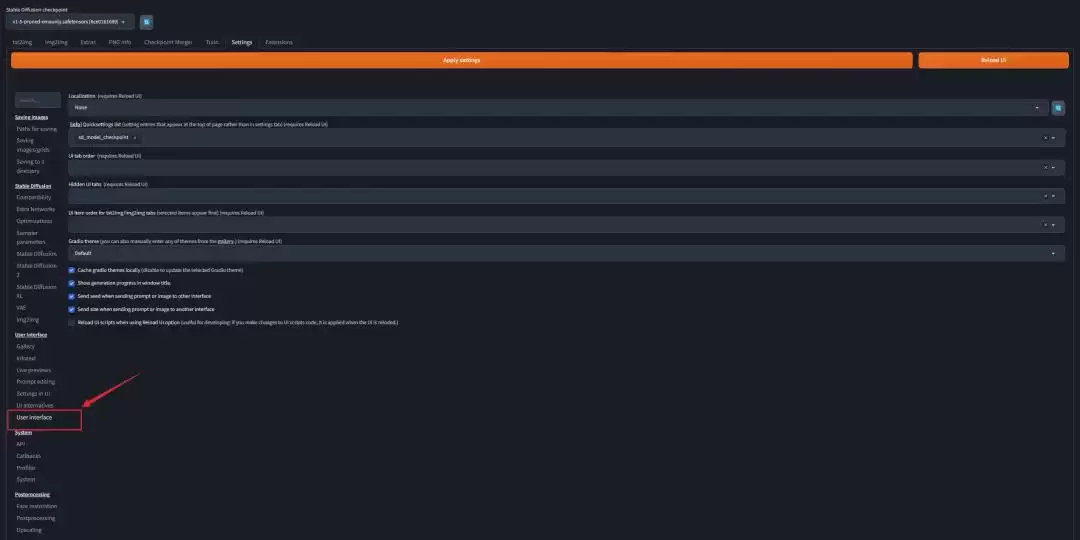

接着,切换到 Settings 页面,选择 User interface 子选项。

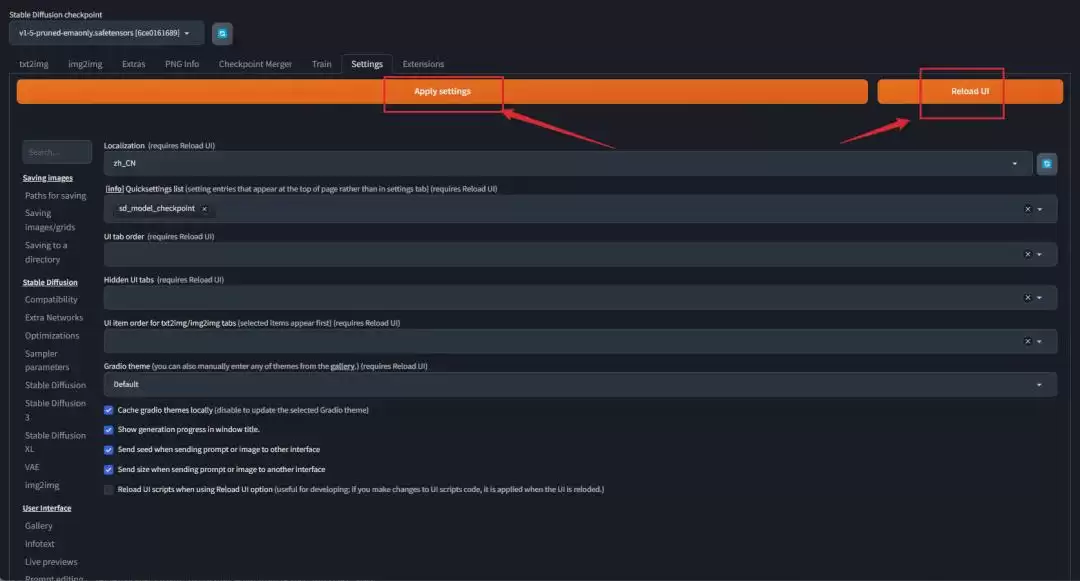

在界面语言下拉菜单中,选择 zh_CN。

最后,点击页面顶部的 Apply settings 按钮,并重启 WebUI。

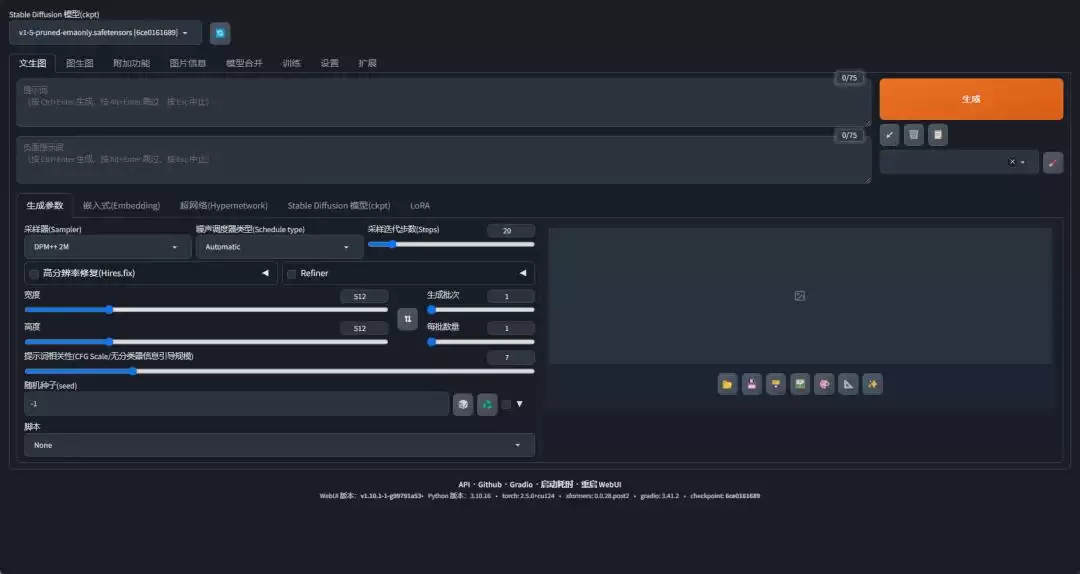

重启后,整个界面就切换为熟悉的中文了。

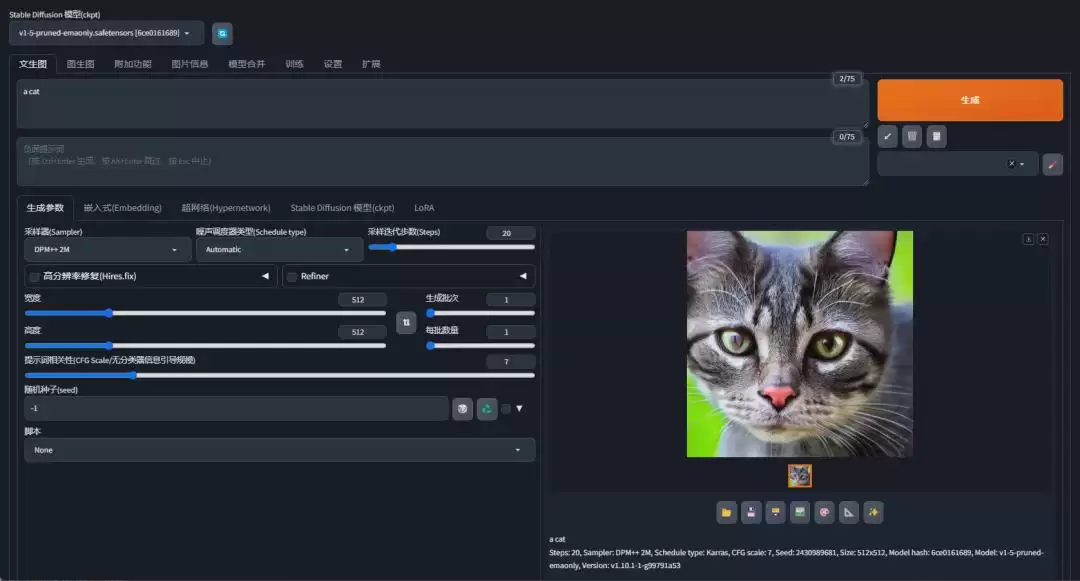

进行一次简单的图片生成测试,成功运行!至此,一个功能完整、界面友好的 Stable Diffusion WebUI 本地环境就部署完成了。

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

OpenClaw群聊管理实战:自动审核入群与关键词回复

一、配置Events事件源与路由规则 想让OpenClaw帮你自动打理群聊?第一步得确保它能“听见”群里的动静。整个系统的运转核心在于Events(事件)系统,它负责识别来自不同平台的消息,并将它们精准分发到对应的处理模块(Skill)。如果这里没配好,消息就像石沉大海,后续的自动审核和回复都无从谈

文心一言智能体与模型选择_文心4.5与DeepSeek区别

一、模型定位与适用场景差异 当你在为文心一言智能体选择核心模型时,如果对文心4 5和DeepSeek感到犹豫,这背后反映的其实是两者在根本定位、能力边界与应用场景上的显著不同。简单来说,这并非一个简单的“谁更好”的问题,而是“谁更合适”的选择。 文心4 5的定位,更像是一个全能的“多面手”。它旨在构

宝马官宣搭载阿里通义千问:国产大模型首次登陆豪车座舱,意味着什么?

宝马官宣搭载阿里通义千问:国产大模型首次登陆豪车座舱,意味着什么? 宝马若正式宣布在其豪华车型中搭载阿里通义千问大模型,这无疑是一个标志性事件。它意味着国产大语言模型首次叩开了传统豪华汽车品牌核心智能座舱的大门。那么,从技术角度看,要实现这一里程碑式的落地,具体需要打通哪些关键路径呢? 一、车端模型

Canva可画提示词生成直播背景_打造专业且吸睛的直播间

可借助Canva可画的AI提示词功能快速生成专业直播背景,包括AI推荐、手动构建五要素提示词、反向解析优质背景及调用多模态模板库四种方法 ☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 多模态理解力帮你轻松跨越从0到1的创作门槛☜☜☜ 想打造一个专业又吸睛的直播间,但苦于没有设计经验或时间?别

OpenClaw从入门到精通:5分钟打造你的专属AI助手

OpenClaw从入门到精通:5分钟打造你的专属AI助手 想快速上手OpenClaw,构建一个能跑起来的AI助手,却卡在了环境配置或复杂文档里?这感觉确实熟悉。别担心,问题通常出在几个关键环节:环境没搭对、依赖版本打架,或者核心组件没正确初始化。下面这份快速指南,能帮你绕过大多数坑,直达目标。 一、

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程

热门话题

热门话题