FlashQLA - 通义实验室开源的高性能线性注意力算子库

FlashQLA是什么

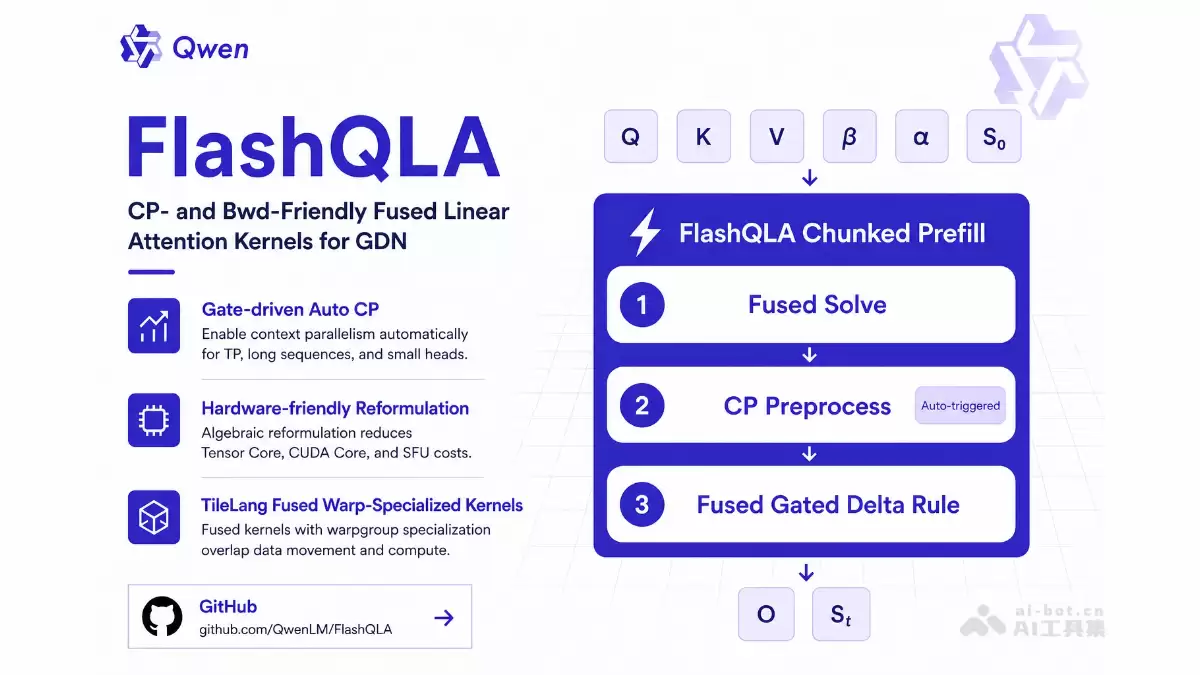

简单来说,FlashQLA是通义实验室开源的一个高性能线性注意力算子库。它基于TileLang实现,专门为优化Qwen系列模型的Gated Delta Network(GDN)注意力层而生。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

这个库的核心价值在于,它通过一系列精巧的底层优化——比如算子融合、Gate驱动的卡内序列并行(AutoCP)以及Warp-Specialized设计——在Hopper架构的GPU上,实现了显著的性能飞跃。具体来看,相较于之前的FLA Triton实现,其前向计算能获得2到3倍的加速,反向计算也有约2倍的提升。这套方案覆盖了从2B到397B的多种模型规格,无论是大规模预训练还是端侧推理,效率都能得到切实提升。

当然,要享受这些优化,环境有明确要求:需要SM90架构(即Hopper)、CUDA 12.8及以上版本,以及PyTorch 2.8+。

FlashQLA的主要功能

- 高性能线性注意力算子库:它的目标非常聚焦,就是深度优化Qwen全系列模型的Gated Delta Network(GDN)注意力层。

- 算子融合加速:对GDN Chunked Prefill的前向与反向计算流程进行了合理的算子融合与性能优化,减少内核启动和内存访问开销。

- 全规格模型覆盖:支持从轻量级的2B到庞大的397B模型,并且覆盖了TP1到TP8(张量并行)的各种部署场景。

- 双层级API接口:既提供了与FLA签名对齐的high-level API,方便快速上手;也开放了底层的fwd/bwd入口,满足深度定制需求。

- 变长序列支持:内置了varlen变长序列处理能力,能够更好地适配真实训练和推理中不均匀的数据分布,提升实用性。

FlashQLA的技术原理

- TileLang Warp-Specialized Kernel:基于TileLang构建了关键的内核融合(fused kernel)。其精髓在于warpgroup specialization设计,让数据搬运、Tensor Core计算和CUDA Core计算能够高效重叠,充分榨取硬件性能。

- 自动化卡内序列并行(AutoCP):巧妙地利用了GDN gate的指数衰减性质。在TP、长序列、小头数等特定场景下,系统会自动开启卡内序列并行,从而有效提高GPU SM的利用率,解决了传统方案并行度不足的问题。

- 滑动窗口warmup机制:针对具有衰减特性的线性注意力头,仅需6到8个chunk的预热(warmup)就能精确获得子序列的初始状态。这个机制直接跳过了修正量M矩阵的计算,大幅降低了CP预处理的开销。

- 硬件友好的代数改写:对GDN Chunked Prefill的前向和反向流程进行了代数变换与化简。在确保数值精度的前提下,有效降低了Tensor Core、CUDA Core及SFU(特殊函数单元)的硬件开销。

- 兼顾访存与并行的折中架构:没有追求极致的完全融合(fully-fused),而是将计算流程拆分为两个fused kernel,并在中间插入CP预处理。这种设计避免了在小batch或TP场景下,fully-fused kernel因并行度不足导致的GPU利用率低下问题,在访存和并行间取得了更好平衡。

如何使用FlashQLA

- 环境检查:首先确认硬件为NVIDIA SM90(Hopper架构,如H200),并确保软件环境满足CUDA 12.8+和PyTorch 2.8+的要求。

- 安装部署:从GitHub克隆FlashQLA仓库,通过pip完成编译和安装。

- 模块导入:在Python代码中,导入核心函数

chunk_gated_delta_rule。 - 数据准备:准备好输入张量q、k、v以及gate参数g、beta,务必确保各张量的形状符合接口要求。

- 执行计算:调用

chunk_gated_delta_rule函数,传入对应的参数,即可获取输出结果O和最终状态。 - 高级配置:如果需要处理变长序列,可以传入

cu_seqlens参数;若要进行状态续传,则可传入initial_state。 - 自动优化:AutoCP序列并行会根据batch大小和序列长度等条件自动触发,无需手动干预,这一点非常省心。

FlashQLA的关键信息和使用要求

- 发布方:通义实验室 / QwenTeam

- 开源地址:github.com/QwenLM/FlashQLA

- 硬件要求:NVIDIA SM90(Hopper架构,例如H200)

- 软件要求:CUDA 12.8+,PyTorch 2.8+

- 支持模型:Qwen3.5 / Qwen3.6系列(支持的头维度从64到8,对应TP1至TP8配置)

- 加速效果:前向计算2–3倍加速,反向计算2倍加速(对比基准为FLA Triton Kernel)

FlashQLA的核心优势

- 兼顾访存与并行的折中架构:通过将计算拆分为两个fused kernel并在中间插入CP预处理,巧妙地规避了fully-fused kernel在小batch/TP场景下GPU利用率低的问题。同时,这种拆分也减少了HBM反复读写中间变量的访存开销。

- AutoCP自动开启机制:该机制并非始终开启,而是设置了智能触发条件:仅在

batch_size × num_heads ≤ 40或batch_size × num_heads ≤ 56 且 seq_len ≥ 8192时自动激活卡内序列并行。这避免了不必要的冗余计算,自适应地平衡了并行度与访存代价。 - 滑动窗口warmup机制:利用GDN gate的指数衰减性质,对于60–80%的线性注意力头,仅需6–8个chunk的warmup即可精确获得子序列初始状态。此举直接舍弃了修正量M矩阵的计算,大幅降低了CP预处理开销。

- Warp-Specialized计算重叠:基于TileLang的warpgroup specialization设计,在同一个SM内实现了生产者与消费者warpgroup的协同工作。通过ping-pong结构,有效遮盖了数据搬运与Tensor Core/CUDA Core计算之间的延迟。

- 硬件友好的代数改写:通过对前向和反向计算流程进行深入的代数变换与化简,在不影响数值精度的前提下,有效降低了Tensor Core、CUDA Core及SFU的硬件开销,让计算更贴合硬件特性。

FlashQLA的项目地址

- 项目官网:https://qwen.ai/blog?id=flashqla

- GitHub仓库:https://github.com/QwenLM/FlashQLA

FlashQLA的同类竞品对比

| 对比维度 | FlashQLA | FLA (Flash Linear Attention) | FlashInfer |

|---|---|---|---|

| 定位 | Qwen GDN专用高性能算子库 | 通用线性注意力算法库 | 通用LLM推理优化引擎 |

| 技术路线 | TileLang Warp-Specialized Kernel | Triton Kernel分步实现 | CUDA Kernel预编译优化 |

| 前向加速 | 基准 | 2.95× slower | 5.33× slower (397B TP8 32K) |

| 反向加速 | 基准 | 2× slower | 不支持 / 未优化 |

| 序列并行 | 自动卡内CP (AutoCP) | 手动配置CP | 不支持GDN专用CP |

| 算子融合度 | 双fused kernel + CP预处理 | 每步独立kernel | 通用fused attention |

| 滑动窗口优化 | Gate warmup机制,免M矩阵 | 标准CP需计算M矩阵 | 无 |

| GPU利用率 | 自动提升小batch/TP场景SM利用率 | 小头数场景利用率受限 | 通用场景优化 |

| 硬件要求 | SM90 (Hopper), CUDA 12.8+ | 通用NVIDIA GPU | 通用NVIDIA GPU |

| 模型适配 | Qwen3.5 / Qwen3.6全系列 | 通用线性注意力模型 | 通用LLM推理 |

| 开源状态 | 开源 (GitHub) | 开源 | 开源 |

FlashQLA的应用场景

- 超大模型预训练:覆盖397B、122B、35B、27B等全系列Qwen模型,支持长达256K的上下文训练。能显著降低注意力层在端到端训练中的算力与时间开销,加速模型迭代。

- 端侧agentic推理:针对batch_size=1、小尺寸模型(如2B/0.8B)的chunked prefill场景,通过AutoCP机制提升小头数下的GPU利用率,从而加速端侧智能体的实时响应速度。

- 大模型线上部署:在TP(张量并行)场景下处理coding agent等长序列输入时,能有效解决chunked prefill因开不出足够大batch而导致的GPU利用率瓶颈问题,提升服务吞吐量。

- 通用GDN/线性注意力架构加速:适用于任何基于Gated Delta Network或线性注意力架构的大语言模型训练与推理,提供了一套开箱即用的高性能算子替换方案。

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

全画幅部分堆栈式CMOS 尼康Z6III单机售价12198元

尼康Z6Ⅲ:一次深思熟虑的进化 作为Z6系列的第三代产品,尼康这次交出的答卷,显然充分消化了前两代用户的反馈与市场声音。在延续系列经典优势的同时,相机在连续拍摄速度、自动对焦性能这些摄影师最关心的核心环节上,做出了显著提升,直指专业用户对高速捕捉与精准对焦的硬核需求。目前,这款备受瞩目的机型售价为1

视频照片样样精通 尼康Z8单机售价22599元

精准对焦8K视频拍摄 尼康Z 8单机售价22599元 在专业影像领域,总有一些产品能引发热议。尼康Z8便是其中之一——它将旗舰Z9的看家本领,几乎完整地“塞”进了一个紧凑轻巧的机身里。这事儿本身就挺有意思:性能没打折,坚固性和可靠性也依然在线,但体积和重量却友好得多。对于风景、野鸟、肖像乃至婚礼摄影

第 57 个世界地球日|闪回科技:以原生型 ESG 基因守护绿色地球

第57个世界地球日|闪回科技:以原生型ESG基因守护绿色地球 2026年4月22日,我们迎来了第57个“世界地球日”。今年我国的主题定为“珍爱自然资源,守护美丽中国”,从4月20日到24日,一系列宣传活动将引导全社会共同关注并参与到自然保护与生态修复中来,为全面推进美丽中国建设凝聚力量。在这个特别的

2026 轻薄办公本推荐:轻薄续航性能再平衡

2026职场笔记本新标杆:告别“偏科”,全能才是硬道理 进入2026年,职场人对办公笔记本的需求变得前所未有的清晰。日常通勤、外勤差旅、居家办公、偶尔的创意设计……多元场景并行之下,挑选轻薄本的核心诉求已然统一。大家不再盲目追求单一的性能怪兽或极致纤薄,而是将目光投向了“综合均衡度”。毕竟,市面上不

美图设计室上线夜间批量托管模式,支持无限任务并行生成

美图设计室推出夜间批量托管模式:电商作图进入“无人值守”时代 电商行业的竞争,早已不止于商品本身。当视觉成为第一生产力,批量、高效、低成本地产出高质量商品图,就成了卖家们,尤其是铺货型跨境商家,必须面对的日常挑战。熬夜赶图、人力成本高企、多平台适配繁琐……这些痛点,如今似乎找到了一个全新的解决方案。

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程

热门话题

热门话题