Yann LeCun斥像素重建弊端 携十亿资金离Meta证行业方向偏差

在近期的一次深度访谈中,图灵奖得主、深度学习先驱杨立昆(Yann LeCun)再次提出了一个颠覆性的观点:“一个无法预测自身行为后果的系统,根本算不上真正的智能体。”这一论断直指当前人工智能发展的核心争议。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

这已不是他首次挑战行业共识。此前那句引发广泛讨论的“大语言模型(LLM)是条死路”,正是出自这位AI领域的奠基者。他多次强调,现今所有主流的大语言模型都缺乏对物理世界的因果理解与行为后果预测能力,它们本质上是在复现训练数据中的语言模式,而非构建真实世界的内在模型。

更为关键的是,他将批判指向了生成式AI的基础范式:“基于像素重建的自监督学习方向是错误的。”他认为,无论是让AI逐像素预测视频下一帧,还是逐词预测下一个Token,这套方法论在应对无限复杂、充满不确定性的真实世界时,存在根本性局限。

那么,真正的出路在哪里?杨立昆全力押注了一条截然不同的技术路线:“联合嵌入预测架构(JEPA)比生成式模型更适合进行表示学习。”其核心是一个名为JEPA的框架——它从设计上就不直接生成像素或文本,而是在抽象的表示空间中进行预测与推理。

为了验证这条路径,他已离开Meta,并投入10亿美元创立了新的研究机构AMI Labs。这不仅仅是一场学术理念之争,更是一次用巨额资本和实际行动向现有技术范式发起的挑战。

AI的辉煌与歧路:当技术抽中大奖,却可能走错方向

有一种误解认为,杨立昆的离开是出于在Meta内部失势。但这低估了他一贯独立、前瞻的学术风格。正如他本人所言:“我不像一些追逐热点的研究者,我的选择基于长期的技术判断。”他的行动始终围绕着一个更宏大的智能愿景。

回顾AI发展史,这种“逆潮流而动”对他而言是常态。早在2015年,当整个业界为强化学习的突破而沸腾时,他就提出了著名的“智能蛋糕”比喻:智能的主体是自监督学习,监督学习只是糖霜,而强化学习不过是顶上的樱桃。当时这一观点备受冷遇,但十年后,以GPT为代表的自监督学习浪潮席卷全球,恰恰印证了他的远见。

如今,当全球资本和研发力量疯狂涌入大语言模型时,他又提出了一个更为终极的目标:构建能够理解并模拟物理规律的“世界模型(World Model)”。

在他看来,当前AI与人类智能的核心差距在于物理世界的理解与预测能力。一个青少年仅需约20小时练习就能掌握安全驾驶的基本要领,而现有的自动驾驶系统即便被投喂数百万小时的视觉数据,仍难以实现可靠的L3/L4级自动驾驶。根本原因在于,人类天生具备对行为后果的直觉预测能力,而大语言模型仅仅掌握了语言层面的统计相关性。

因此,他发出了那个直指本质的质问:“我无法认同,一个不能预测自身行为影响的系统,能被称作真正的智能体。”尽管行业主流声音仍在强调“扩展定律(Scaling Law)的潜力尚未见顶”,并将“世界模型”的构想视为理论空谈,但杨立昆的整个研究生涯表明,他从不依赖外界的认同来指引方向。

生成式AI的固有缺陷:为什么AI生成的视频总是“模糊”的?

杨立昆与主流生成式AI路线的根本分歧,源于一段早期研究中的挫败经历。

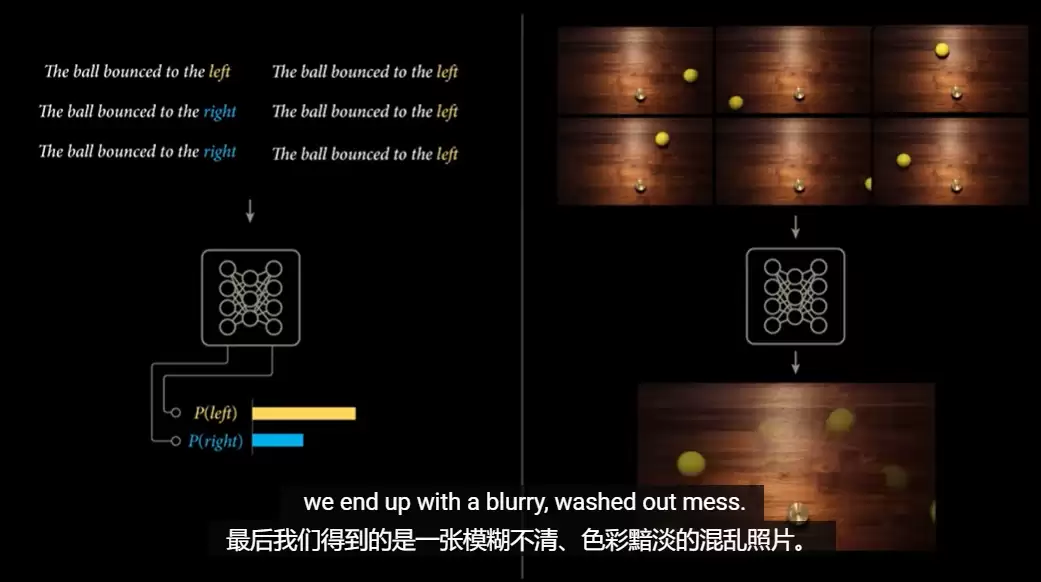

在Transformer架构诞生之前,他和团队曾尝试过一个直观的思路:让AI观看视频,并像预测文本一样,逐像素地预测下一帧画面。然而,他们遭遇了一个无法解决的难题——无论模型如何优化,其生成的未来帧永远模糊不清,缺乏清晰细节。

背后的原因其实清晰可循。他常举一个例子:在训练数据中,一个弹起的球可能向左运动,也可能向右运动。面对相同的当前帧,未来存在多种合理可能。如果模型被强制要求输出一个“确定无误”的像素级下一帧,其最稳妥的策略就是对所有可能性取平均——将向左和向右的画面在像素层面进行混合。其结果必然是一张模糊、发灰、细节丢失的图像。

这远非问题的全部。语言模型预测下一个词,只需从一个数万词汇的离散词表中做出选择。但一张高清视频帧包含数百万个像素,每个像素有256种可能的颜色值,这使得下一帧的可能性空间是一个天文数字,远超宇宙中的原子总数。你无法像为每个词设置一个“输出神经元”那样,为每一种可能的画面配置输出路径。

基于这些深刻的教训,杨立昆得出了明确结论:“像素级重建是一个错误的方向。”那么,AI模型是否必须是生成式的?他的答案是否定的。

他提出了一条新路径:放弃让模型猜测每一个像素。应该先让AI学会“抽象”和“理解”,在一个高维的表示空间里进行预测。因此,他彻底转向,其核心思想是让AI先学会“如何表示世界”,过滤掉冗余的感官细节,将视频帧压缩成蕴含语义的数学向量(即嵌入),然后在这个抽象的向量空间里捕捉真正重要且可预测的信息,例如物体的轨迹、速度和相互作用。

这就是JEPA(联合嵌入预测架构)的核心理念。与传统的生成模型疲于应付所有像素细节不同,JEPA专注于场景中那些稳定、可预测的抽象特征。其工作流程是:通过两个编码器,分别将当前帧和未来帧(或同一帧的不同视角)映射到表示空间,然后训练一个“预测器”,学习从当前表示预测未来表示的映射关系。

他有一个生动的比喻:训练一个模型逐像素预测行车记录仪视频,它会将大量计算资源浪费在预测路边树叶的随机摇曳上——这些是难以预测的噪声。而JEPA的思路是,只关注车辆、行人、车道线、交通信号等对决策至关重要的、具有规律性的高层次信息。

一场豪赌:押注一个避免“表示崩溃”的未来

JEPA的思想渊源其实有迹可循。杨立昆回溯了自己30年前在贝尔实验室的里程碑工作:孪生神经网络(Siamese Network)。该网络当时用于笔迹验证,它并不生成任何签名图像,而是比较两个签名经过编码后的向量相似度。它跳过了繁琐的像素级重建,直接学习抽象的特征表示。JEPA的思路与此一脉相承:先编码,再在表示空间进行预测和比较,绝不退回原始像素。

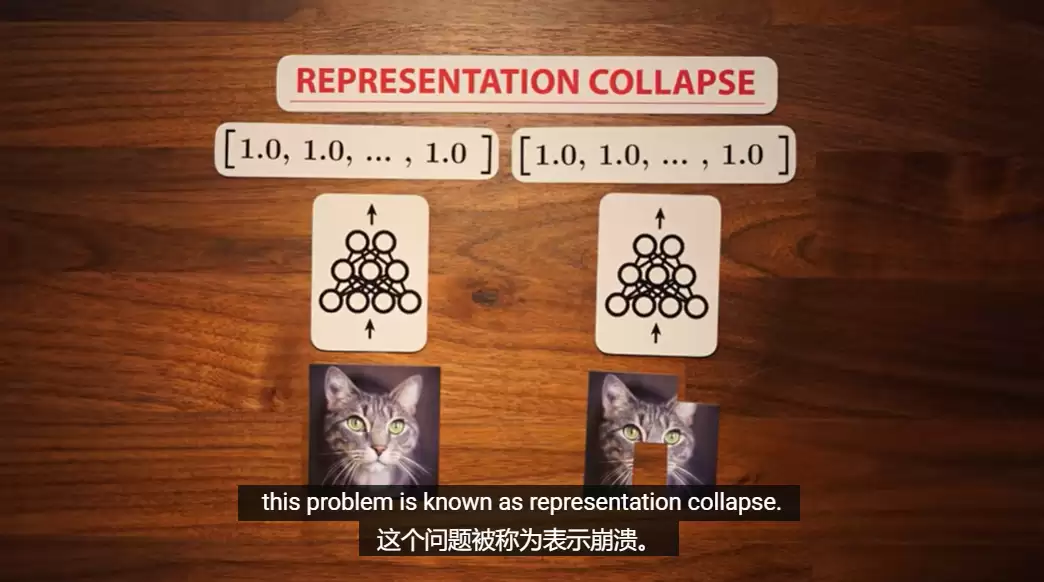

然而,这条道路布满荆棘,其中最棘手的一个挑战叫做“表示崩溃”。

什么是表示崩溃?简单来说,如果你训练两个编码器,要求它们对同一张图片的不同增强版本(如裁剪、变色)输出非常相似的向量,模型可能会找到一个“作弊”的捷径:无论输入什么图像,都输出一个完全相同的常量向量(例如全零向量)。这样,相似度损失函数确实被最小化了,但模型根本没有学到任何有意义的特征,彻底失效。

早期的孪生网络依赖对比学习来防止崩溃,即同时使用正样本(相似对)和大量负样本(不相似对),迫使模型学会区分。但这种方法在扩展到大规模数据时面临严峻挑战:所需负样本数量巨大,导致计算和内存开销呈爆炸式增长。杨立昆指出,在最坏情况下,所需的对比样本数量可能与表示维度的指数成正比。

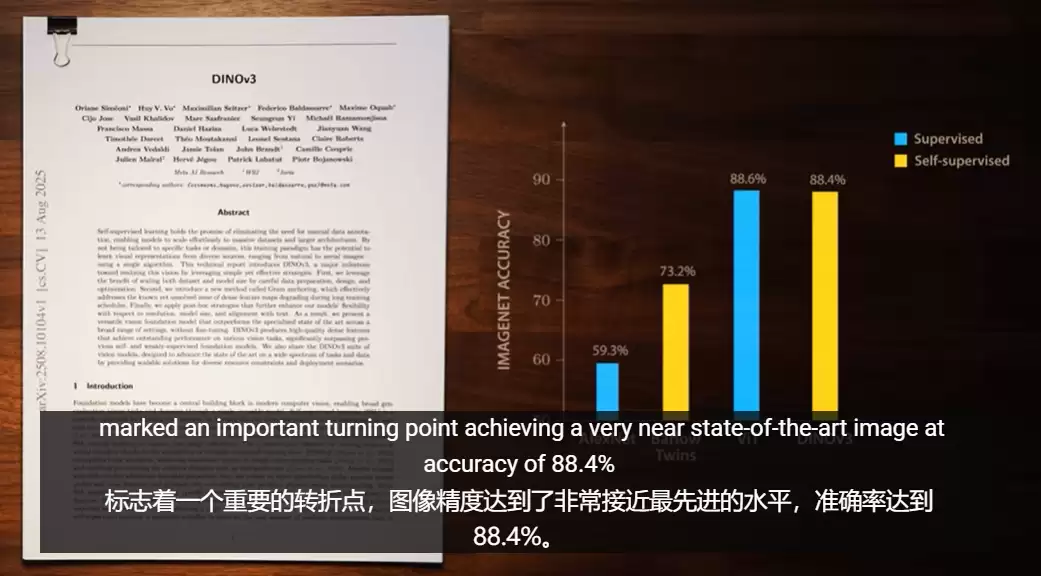

转机出现在2020年左右。他与博士后Stefan Deny共同提出了名为“Barlow Twins”的创新方案,其灵感源于神经科学家霍勒斯·巴洛在1961年提出的假说:生物视觉系统通过减少神经元响应之间的冗余信息来高效编码世界。这种方法巧妙地规避了表示崩溃问题。Barlow Twins在ImageNet图像分类基准测试中达到了73.2%的top-1准确率,比2012年开创性的AlexNet模型高出超过10个百分点。

此后,杨立昆团队又推出了更简洁的变体VicReg,效果同样卓越。而Meta巴黎的团队沿着这个方向持续迭代,最终推出了大名鼎鼎的DINO系列自监督视觉模型。

2025年8月发布的DINOv3,在ImageNet上取得了88.4%的惊人准确率。其研究论文中有一句振奋人心的结论:这是自监督学习模型首次在图像分类任务上,与使用大量人工标注数据的弱监督乃至全监督模型性能持平。

更令人印象深刻的是DINO模型展现出的强大语义理解能力。例如,给定一张包含人手的图片,提取手部区域的嵌入向量,然后计算该向量与图像所有其他区域的相似度并进行可视化,DINO能够极其精准地将手部轮廓从复杂背景中分割出来。同样的方法应用于球体、猫咪或书本,都能获得清晰的对象分割图。这强有力地证明,模型在没有接受任何像素级标注的情况下,已经自发学习到了高质量的、对象级别的语义表示。

这些里程碑式的进展,让杨立昆更加坚信自己的判断:基于联合嵌入的自监督学习路径,比传统的生成式重建路径,更适合学习对物理世界进行高效、鲁棒的表示。

“做空”LLM的思考者:一场关乎AI本质的赌局

作为一位与当前行业热潮“逆向而行”的思考者,杨立昆说了一句在硅谷可能不太中听的话:“我无法理解,一个没有预测自身行为后果能力的系统,怎么能被称为真正的智能体。”

他并非全盘否定大语言模型所取得的巨大工程成就和应用价值,但他尖锐地指出:语言模型之所以能在文本领域取得突破,是因为语言本身是离散的、符号化的,一个有限的词表就能将其基本涵盖。然而,真实物理世界是连续的、高维的、充满不确定性的,没有任何有限的“词表”能够穷尽世界的所有可能状态。因此,将“下一个Token预测”这套在离散符号系统中成功的方法论,直接套用到对连续物理世界的建模上,在根本上是不匹配的。

历史仿佛正在重演。当年,所有人追捧强化学习时,他断言自监督学习才是基石,后来GPT的崛起验证了他的观点。如今,所有人都在疯狂投入大语言模型,他再次站出来,成为那个最著名的“唱反调者”。

但这一次,情况截然不同。他不仅押上了自己作为图灵奖得主的学术声誉,更押上了10亿美元的巨额资本。这不再仅仅是一场停留在论文和会议上的学术辩论,而是一场将深刻影响人工智能未来十年发展方向的终极豪赌。

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

Perplexity订阅收据查询指南:结算中心历史账单查找方法

Perplexity订阅收据由第三方支付平台管理。iOS macOS用户请在Apple账户的“购买记录”中查找;Android用户可在GooglePlay订单历史里查询;网页端用户可通过Stripe邮件中的链接登录客户门户获取历史发票。

即梦AI图文合成教程:如何添加与排版文字

即梦AI图文合成提供多种文字排版方法。文生图阶段可在提示词中用引号嵌入文字,实现图文一体渲染。智能排版助手能自动分析内容并优化布局。艺术字生成结合剪切蒙版可实现图像填充文字的高级效果。局部重绘功能则可对已有文字进行精准的位置与样式修正。

崔汉青谈具身智能发展 筑牢仿真底座加速产业落地

当智能经济的浪潮从虚拟信息空间涌向实体物理世界,一个根本性问题被推至台前:当人工智能不再仅处理文本与图像,而是要驱动机械臂精准操作、引导农机自主巡行于田间时,高质量的“数据燃料”从何而来?物理世界中复杂多变的运行逻辑,又该如何被高保真地数字化复现? 这并非空想。大模型的蓬勃发展,得益于互联网数十年积

香港科大提出渐进式学习新方法提升深度神经网络训练稳定性

人工智能训练常被视为充满复杂数学与庞大算力的领域,但其底层的一些核心挑战,其本质往往与人类学习的基本规律相通。一项由香港科技大学、萨里大学、香港大学及英伟达合作的研究,在2026年3月发布的预印本论文(arXiv:2603 05369v1)中,揭示了一个朴素而深刻的原理:让AI模型模仿人类“循序渐进

Kodiak AI折价融资致股价暴跌 盘后重挫37%

自动驾驶卡车公司KodiakAI完成1亿美元折价融资,股价盘后暴跌37%。融资以每股6 5美元进行,较市价折价近三成。公司一季度营收180万美元,但运营亏损达3780万美元,凸显资金消耗压力。业务方面,Kodiak与多家物流公司达成合作,推进自动驾驶货运试点,并计划在2026年底前实现高速公路无人驾驶运营。

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程

热门话题

热门话题