向量库检索结果匹配为何大模型仍会生成错误答案

首先明确一个核心观点:向量数据库本质上是一种高效的模糊索引工具。如果你的RAG系统仍然输出不准确的答案,先别急着质疑大模型的能力,更关键的问题可能出在检索环节——你的文本切片是否丢失了关键上下文?你提供给模型的Top-K结果里,是否混杂了太多干扰信息?

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

这并非空谈。在构建智能问答系统的实践中,一个常见且棘手的问题是:明明向量数据库返回的片段中,清晰地包含了与问题相关的关键词,但大模型参考后,依然会生成与事实不符的内容。问题的根源究竟在哪里?

起初,直觉很容易指向大模型能力不足或Embedding模型精度不够。但经过完整的链路分析后,真相往往更具体:问题就出在检索结果本身。向量搜索“找到”了相关文本,绝不等于大模型就能“答对”。

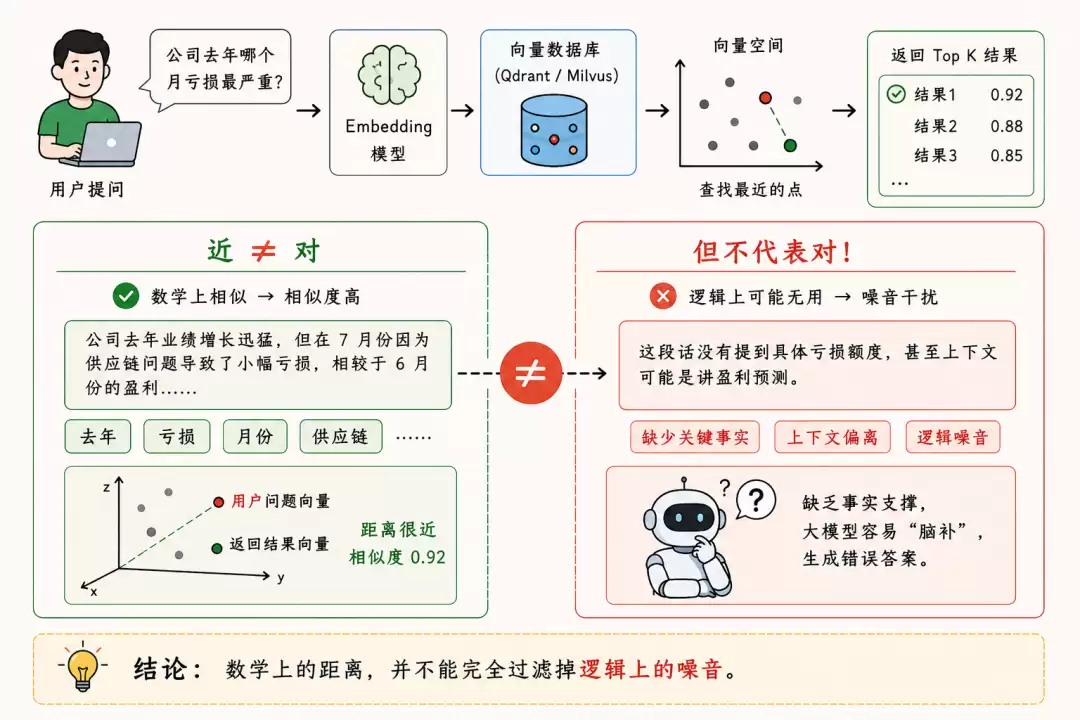

向量相似度不等于语义相关性

这是最根本的一个认知误区。向量搜索的底层是数学计算,它将文本转化为高维空间中的向量坐标。所谓的相似度搜索,就是在这个向量空间中计算距离,并返回与查询向量最接近的文本点。

但关键在于:向量空间中的距离近,并不代表语义逻辑上高度相关。

举个例子。用户提问:“公司去年哪个月份的亏损最为严重?” 向量搜索可能会以高相似度返回这样一段话:“公司去年整体业绩增长显著,但在7月份因供应链中断出现了小幅亏损,相比之下,6月份则实现了盈利……”

从数学相似度看,这段话完美匹配了“去年”、“亏损”、“月份”等关键词,得分可能很高。但如果这段文本的核心是在对比盈利情况,并未明确断言“7月是亏损最严重的月份”,那么大模型在缺乏确凿事实依据的情况下,为了完成生成任务,就很可能基于其训练数据开始“联想”或“编造”。

因此,数学上的邻近性,并不能有效过滤逻辑上的噪音和歧义。

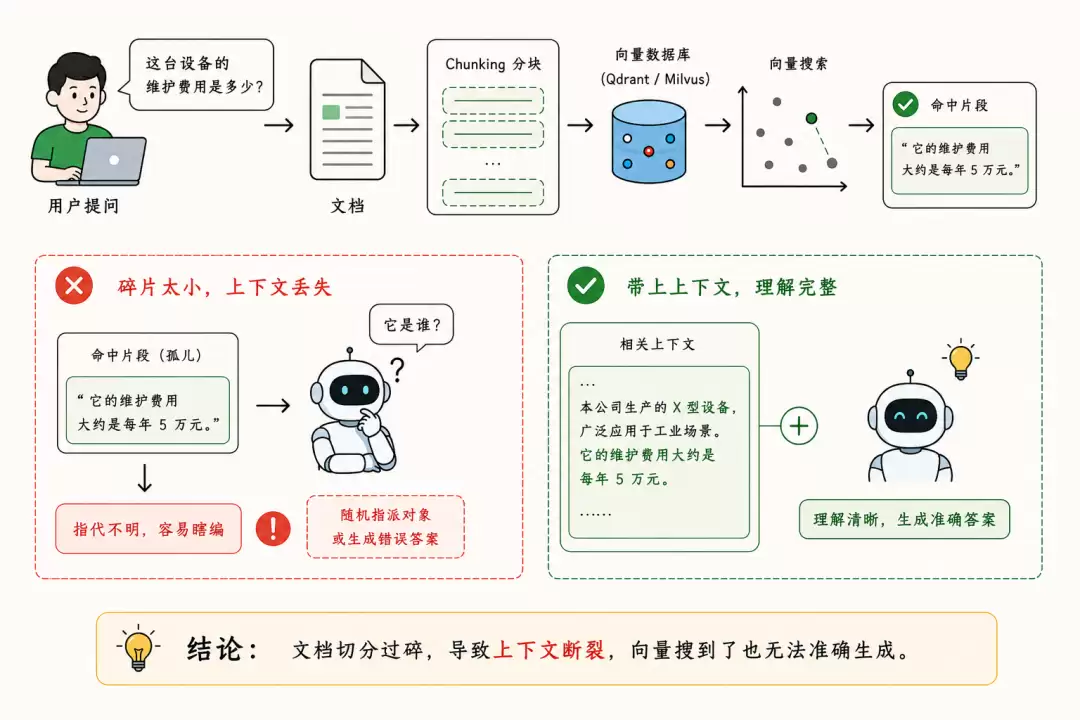

过小的文档切片导致上下文丢失

出于效率和成本的考虑,我们通常会对长文档进行分块处理。但如果你为了节省Token消耗,将块大小设置得过小(例如仅200字),就可能引发新的问题。

向量搜索可能精准命中了包含答案的那一句话,例如:“它的年度维护成本约为5万元。” 然而,当大模型看到这个独立的“切片”时,会完全困惑:“它”具体指代什么设备或项目?

如果检索未能将关键的上下文信息(例如前文明确提到的具体设备型号或项目名称)一并返回,大模型在指代不明的情况下,就可能错误地关联对象,或者直接开始虚构。这种因文档切分过细而导致的上下文断裂,是检索看似成功却无法支撑准确生成的典型问题。

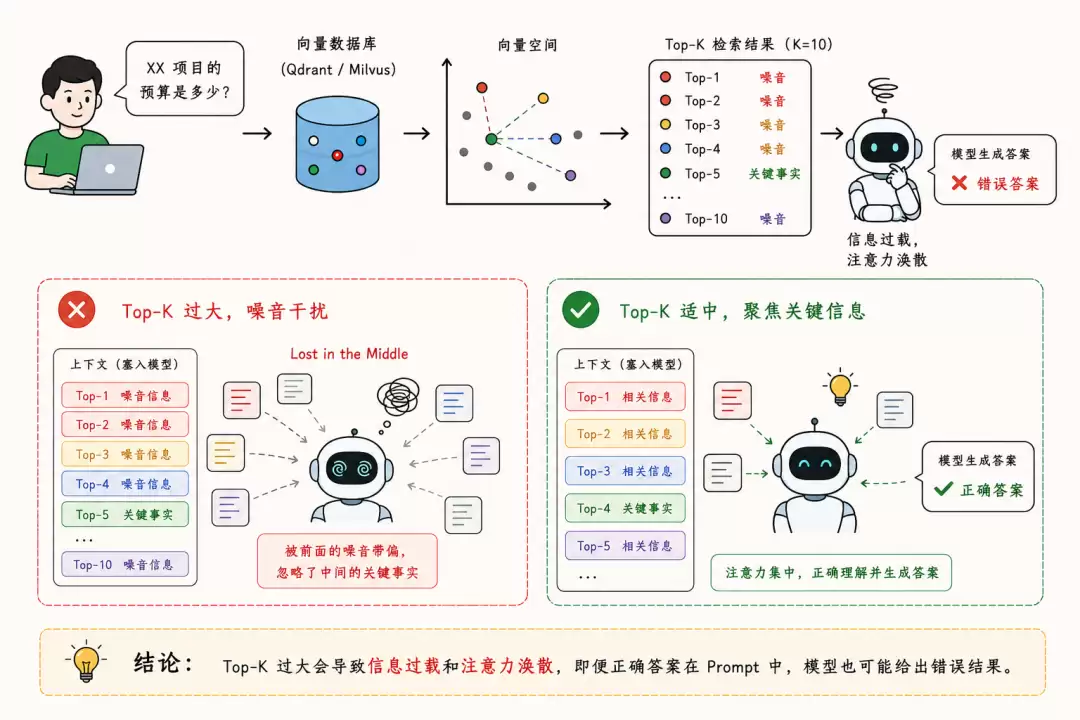

Top-K 噪音干扰模型注意力分配

另一个常见的做法是,为了提高召回率,将Top-K参数设置得很大,例如一次性给大模型输入10个甚至20个文本片段。想法看似合理:提供的资料越多,得到正确答案的概率越高?

实际情况可能恰恰相反。大模型存在一个被称为“Lost in the Middle”(迷失在中间)的现象。当输入的上下文过长,且掺杂了大量似是而非的无关信息时,大模型的注意力机制会像人一样难以集中。

它很可能被排名最靠前(如Top-1, Top-2)但实际是噪音的片段带偏方向,反而忽略了藏在后面(例如Top-5位置)的那个关键事实片段。这种信息过载直接导致,即便标准答案就在提供的上下文中,模型最终给出的回答依然是错误的。

引入 Rerank 重排器优化检索结果

既然单一的向量搜索作为粗筛环节不完全可靠,一个成熟的RAG架构就必须引入精筛环节,也就是Rerank(重排)模型。

为什么这一层如此关键?

传统的向量搜索属于“双塔模型”,它将查询和文档分别编码成固定向量,再计算余弦相似度。这种方式速度快、效率高,但难以捕捉深层的语义交互和细粒度逻辑关联。

而Rerank模型(如BGE-Reranker这类交叉编码器)则采用了不同的机制。它会把用户查询和候选文档文本拼接在一起,进行深度的、交互式的注意力计算与比对。因此,它能更精准地识别出“虽然这段话关键词匹配度高,但并未直接、完整地回答用户问题”的情况。

一个优化的RAG系统开发流程应该是:

- 首先,利用向量数据库快速召回一批(例如50个)潜在相关的文本片段。

- 然后,使用Rerank模型对这50个片段进行精准的语义相关性打分和重新排序,筛选出真正能回答问题的、最相关的3-5个核心片段。

- 最后,只将这最有把握的少量高质量片段喂给大模型进行答案生成。

通过增加重排这一步骤,能够有效过滤掉绝大部分的干扰信息,整个问答系统的回答准确率和可靠性往往会有显著的提升。

总结与建议

归根结底,向量数据库只是一个高效的模糊索引工具。当RAG系统输出效果不佳时,首要的排查和优化方向应该是检索质量,而非盲目升级大模型或调整Prompt。

请检查你的文档切片策略是否保留了必要的上下文连贯性,审视Top-K返回的结果里是不是噪音多于有效信号。请记住,喂给大模型的数据,质量永远比数量更重要。

能用3个精准、完整的片段说清楚的事情,绝对不要塞给它10个模糊、断裂的片段。如果发现向量检索召回的内容总是差强人意,不妨考虑在架构中引入Rerank重排器,这一步优化有时比花费大量时间调优Prompt更为直接有效。

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

阿伯丁大学揭秘AI时间推理机制词汇切分与内部表征作用解析

这项由阿伯丁大学和格勒诺布尔阿尔卑斯大学联合开展的研究(论文编号arXiv:2603 19017v1),揭示了一个我们日常使用AI时可能都遇到过,却未必深思的现象:当你用中文、阿拉伯语或其他非英语语言,向ChatGPT等助手询问“2024年3月15日往后推90天是什么时候”这类时间问题时,它们的表现

AI提升编程效率30%为何软件交付速度反而下降

许多企业正面临一个普遍困境:AI工具将开发者的编码效率提升了30%以上,但软件交付的整体速度与可预测性却未见明显改善,甚至出现波动。症结何在?关键在于,企业往往只聚焦于“编码”环节的优化,而忽视了测试、集成、部署与运维所组成的完整交付链路。 提升开发者的编码速度固然重要,但如果后续的测试验证与发布流

Prompt优化技巧:如何让你的提示词比代码更有价值

去年四月,Anthropic 推出的 Claude Design 产品引发了广泛关注。用户只需用自然语言描述界面或网页设计需求,几十秒内就能获得可用的高保真原型。这种将自然语言直接转化为设计稿的效率,在当时确实令人印象深刻。 大约一周后,GitHub 上出现了一个名为 open-design 的开源

智能体评估演进:从单次交互到全流程轨迹分析

过去一年,大语言模型(LLM)应用评估的重心,悄然发生了一场深刻的转变:从早期的“输出质量”,到后来的“检索质量”(RAG场景),如今正全面聚焦于“轨迹质量”(Agent场景)。这并非简单的指标叠加,而是评估对象与方法论的一次根本性升级。 设想一下,你在生产环境部署了一个智能体(Agent)系统。每

德黑兰大学揭示波斯语音频理解面临的实际挑战与难点

这项由德黑兰大学电气与计算机工程学院与基础科学研究院合作完成的研究,已入选2026年的Interspeech会议。对技术细节感兴趣的读者,可通过论文编号arXiv:2603 14456v1查阅全文。 想象这样一个场景:一位伊朗友人正为你朗诵一首优美的波斯古诗。即便不解其意,你也能被那独特的韵律和节奏

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程

热门话题

热门话题