为Agent添加质检员能降低错误率还是适得其反

工具调用是智能体(Agent)实现复杂任务的核心能力,但当前技术仍面临诸多挑战:工具选择不当、参数传递错误、在不该调用时强行调用等问题时有发生。传统的解决方案多采用事后评估机制,即在错误操作执行后,通过分析日志、调整提示词(Prompt)或重新训练模型来改进。然而,这种方法存在根本性缺陷:它脱离了实际执行回路,无法在错误发生的瞬间进行实时干预与纠正。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

一个更优的思路应运而生:能否在工具调用真正执行前,设置一道“预检关卡”?让一个独立的审查智能体(Reviewer Agent)预先评估调用请求,提供反馈,甚至直接筛选出最优方案。Apple近期发表的一篇研究论文正是基于这一理念,将“评估”环节直接嵌入推理回路。这一构想看似直观,但真正的挑战在于:审查者自身也可能出错。它纠正的错误数量,与它新引入的错误数量,究竟孰多孰少?这笔效益与风险的账,必须精确算清。

问题:事后评估无法挽回已执行的错误

论文首先系统性地指出了工具调用智能体面临的三大核心挑战:正确选择工具、准确构造参数、以及准确识别“无合适工具可用”的场景。

当前主流应对路径主要有两条。一是基于训练的方法(例如GRPO),但这通常意味着高昂的算力成本和漫长的迭代周期。二是推理时的方法(例如Self-Refine、Reflexion),依赖智能体的自我反思。然而,后者面临一个核心困境——状态恢复问题:一旦智能体执行了破坏性操作(例如错误地删除了本应更新的闹钟),后续的自我纠正就需要将完整的交互历史状态保留在上下文中。在多轮复杂交互场景下,这种成本会呈指数级增长。

因此,论文提出的解决方案是将评估环节前置:与其事后补救,不如事前预防。在工具调用被执行之前,就进行拦截与修正。

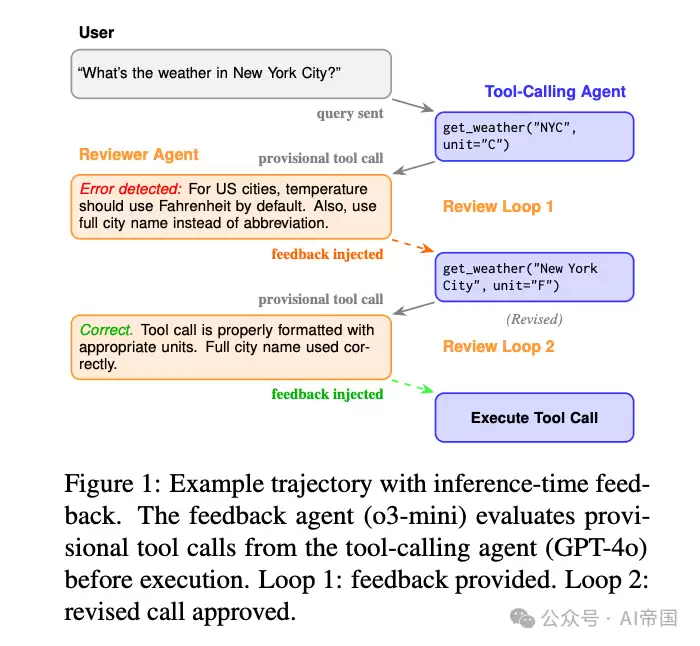

[Figure 1: 推理时反馈的轨迹示例]反馈 agent(o3-mini)在工具调用 agent(GPT-4o)执行 tool call 之前进行评估。第一轮给出反馈,第二轮修订后的调用被批准通过。

方案:双智能体架构与三种协作模式

论文设计了一个双智能体架构:一个主智能体(使用GPT-4o,负责生成工具调用请求)和一个审查者智能体(使用o3-mini或GPT-4o,负责审查调用)。主智能体无需重新训练或修改架构,仅需接收并整合审查者的反馈。

为了探索最优的协作范式,论文测试了三种机制:

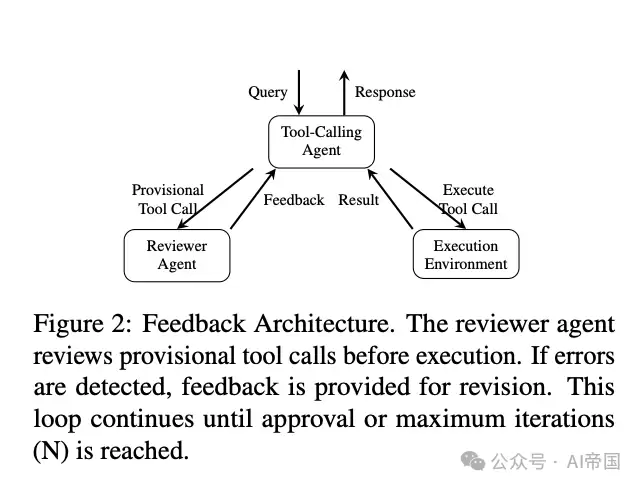

1. 渐进式反馈:审查者反复检查主智能体的响应,发现错误即以系统消息形式注入反馈,主智能体据此修订,此循环最多进行N轮。

2. 选择器模式:主智能体使用不同的“温度”参数生成N个候选调用,由选择器一次性选出最优解。

3. 评分器模式:与选择器类似,但评分器会为每个候选方案打出0.0–1.0的明确分数并附上理由,最终选取最高分方案。

[Figure 2: 反馈架构图]Reviewer agent 在执行前审查 tool call,发现错误则提供反馈让主 agent 修订,循环直至通过或达到最大迭代次数 N。

为了精确量化“纠错”与“引错”之间的权衡,论文提出了一组关键评估指标:

- 有益率:主智能体出错但被审查者成功纠正的比例。

- 有害率:主智能体原本正确却被审查者改错的比例。

- 收益风险比:有益率除以有害率。

这两个指标直接揭示了引入审查者的核心价值判断:它究竟为系统带来了净增益,还是反而成了性能拖累。

首次实验遇挫:审查者过度“较真”

论文首先在BFCL(一个单轮工具调用基准测试)上测试了基础提示词版本,并使用GPT-4o作为审查者。结果发现,仅在“无关调用检测”类别上有+4.7%的提升,其他类别几乎无变化。

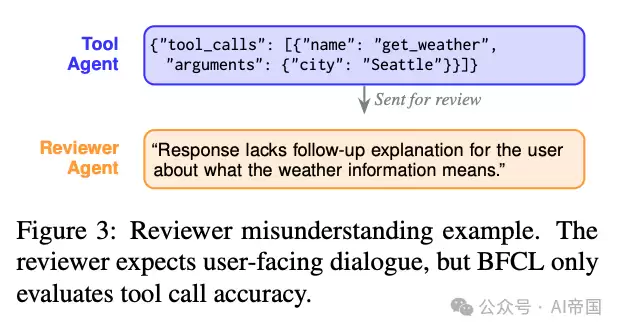

深入排查后发现,问题根源在于审查者:它将大量正确的工具调用误判为“不完整”。原来,审查者期望看到一个面向最终用户的解释性回复,但BFCL基准仅评估工具调用本身的准确性,并不需要后续对话。高达23%的案例都浪费在了这种无意义的循环纠错上。

[Figure 3: Reviewer 误判示例]Reviewer 抱怨:“Response lacks follow-up explanation for the user about what the weather information means.” 但 BFCL 只评估 tool call 准确性,并不要求面向用户的解释。

于是,论文在第二版提示词中增加了一条明确指令:“仅包含工具调用的响应就是完整的”。这一针对性优化立竿见影,将多余循环的比例从23%显著降低至8%。

推理模型 vs. 普通模型:3:1的收益风险比优势

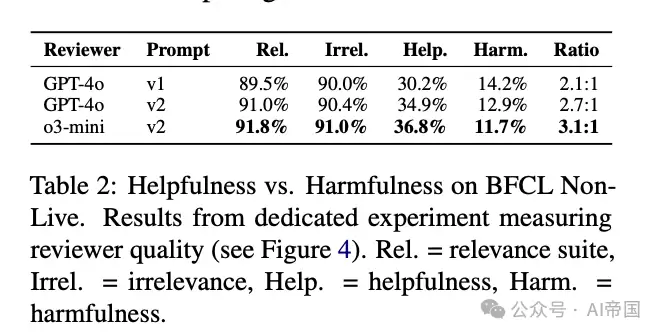

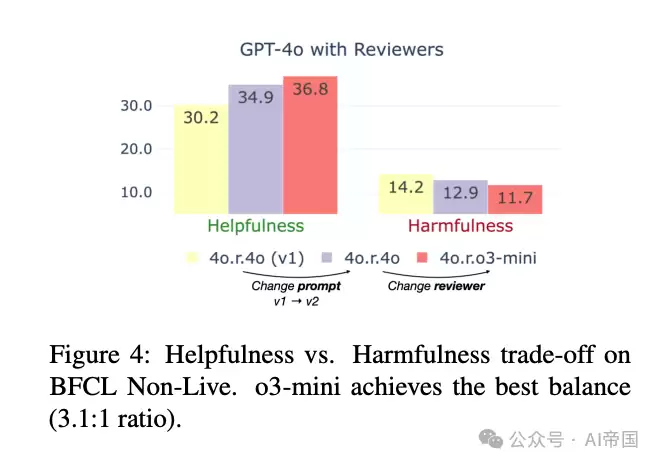

仅优化提示词还不够,审查者模型本身的能力更为关键。论文对比了不同模型作为审查者的效果,结果差异显著。

使用o3-mini(一款具备强化推理能力的模型)作为审查者时,它成功纠正了36.8%的主智能体错误,仅引入11.7%的新错误,收益风险比达到了优秀的3.1:1。而使用GPT-4o作为审查者时,这一比例仅为2.1:1。推理模型所具备的系统化验证能力,使其在“无关调用检测”上表现更佳,同时有害率也更低。

[Figure 4: Helpfulness 与 Harmfulness 权衡图]在 BFCL Non-Live 上,o3-mini 取得了最佳平衡,3.1:1 的收益风险比明显优于 GPT-4o。

多轮复杂场景:性能显著提升与副作用显现

为了验证该方法在更复杂场景下的有效性,论文将其扩展应用到τ²-Bench基准。该基准模拟多轮、有状态、且包含特定领域策略的交互,覆盖航空、零售、电信三个领域。

在最优配置下,平均任务通过率从48.7%提升至55.8%(绝对提升+7.1%),其中电信领域的提升尤为显著,从41.2%跃升至64.0%。

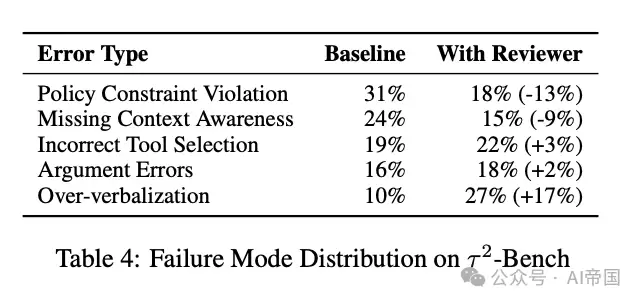

然而,对失败案例的分析揭示了新的副作用:

审查者非常擅长捕捉策略违规(例如,在订机票前必须先查询座位可用性),但它也将“过度啰嗦”类错误的比例从10%推高到了27%。这本质上是“过度怀疑”问题在多轮复杂场景下的复发。

在三种协作机制的对比中,渐进式反馈的表现普遍优于Best-of-N模式,平均高出3–8%。而Best-of-N选择器在某些领域甚至比基线模型还要差。原因在于,渐进式反馈能够显式地定位并修正具体错误,而单次选择只能在已经生成的、可能都不完美的候选方案里“矮子里面拔将军”。

另一个重要发现是:在单轮BFCL基准上调优的提示词,直接套用到多轮τ²-Bench上,反而会引入新错误。这再次证明,单轮与多轮场景的评估标准和交互逻辑存在本质差异,提示词必须根据具体应用场景进行针对性优化。

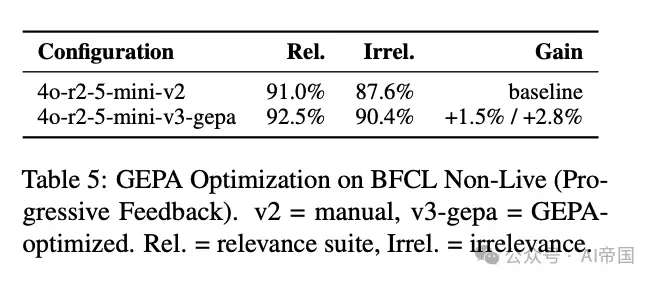

自动化提示词优化:额外提升1.5–2.8%的性能

手工调整提示词存在性能天花板。论文采用了GEPA(遗传-帕累托提示词进化)方法进行自动化迭代优化:从第二版提示词出发,收集失败案例,让大语言模型反思并提出改进建议,如此循环直至收敛。

最终得到的第三版提示词比第二版长了约4.5倍,加入了详细的错误判定标准、边界场景处理逻辑和错误检查清单。

提升最显著的是“并行多调用”类别(+2.1%)。这类任务需要协调多个并行的工具调用并正确传递参数,自动化优化能够发现人工难以预先设想的复杂交互策略。

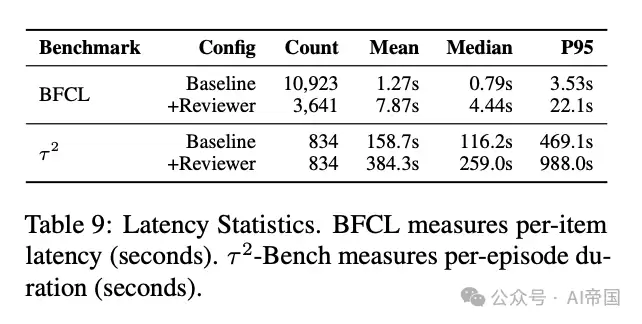

延迟代价:单轮场景6.2倍,多轮场景2.4倍

天下没有免费的审查者。引入额外的推理步骤必然带来延迟开销。

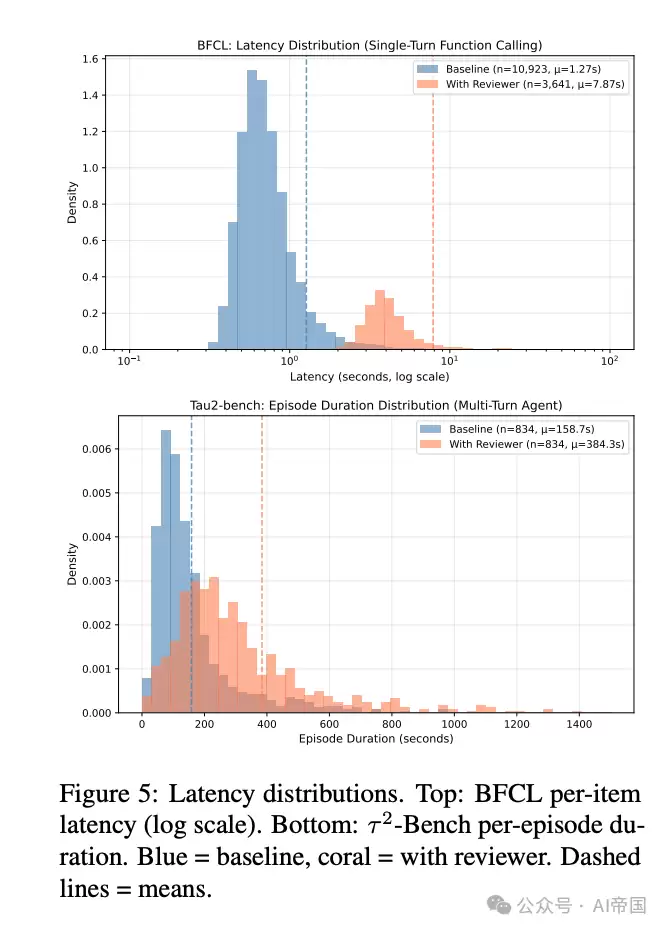

[Figure 5: 延迟分布对比]上为 BFCL 单条延迟(对数刻度),下为 τ²-Bench 单 episode 时长。蓝色为 baseline,珊瑚色为加 reviewer,虚线为均值。

在单轮场景下,延迟开销高达基线水平的6.2倍,这通常难以接受,因为基线本身只是一次推理调用,审查完全是新增成本。而在多轮场景下,开销仅放大2.4倍——审查者的成本被分摊到了大约40个交互回合中。数据显示,在BFCL上平均每条调用触发1.33次审查,而在τ²-Bench上每个回合仅触发0.96次(系统状态的保持降低了后续回合的不确定性)。

对于实际部署,论文给出了清晰的取舍建议:高吞吐的单轮调用场景需谨慎使用,或仅在不确定性高的样本上启用;而对于多轮、对准确性要求高的复杂工作流,引入审查机制则更具性价比;如果工作流涉及昂贵的外部API调用,反馈机制甚至可能因为避免了错误调用而产生正向的投资回报。

核心洞察与研究局限

这篇论文最深刻的洞见,并不在于“增加审查者能提升性能”这一结论本身,而在于它将审查者本身视为一个可独立优化、持续增强的系统组件:通过更换更强的推理模型、使用自动化方法优化提示词,未来甚至可以将其知识蒸馏为轻量级分类器——主智能体无需任何代码改动,整个系统的可靠性就能实现持续叠加。

更关键的是“有益率-有害率”这对评估指标。它将“增加审查者到底值不值”从一个模糊的定性判断,变成了一个可精确测量的定量数字。当一个组件既可能纠正错误又可能引入新错误时,只看最终准确率是不够的,必须分别厘清它纠正了多少错误、又新增了多少错误。

当然,该研究也存在明确的局限性:基础主智能体只测试了GPT-4o,未在开源模型上广泛验证;GEPA优化方法和有益/有害率指标仅在单轮BFCL基准上得到充分验证,多轮场景的自动化优化仍是未来研究方向。此外,审查机制带来的延迟开销,在实时性要求极高的应用场景下仍需仔细权衡。

原文标题:Reinforced Agent: Inference-Time Feedback for Tool-Calling Agents

原文链接:https://arxiv.org/abs/2604.27233

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

Meta AI与KAUST合作研发神经计算机AI化身可运行硬件系统

这项研究来自Meta AI与沙特阿卜杜拉国王科技大学(KAUST)的联合团队,论文于2026年4月发布,编号为arXiv:2604 06425v1。 研究概要:当AI不再只是工具,而是变成电脑本身 我们日常使用的电脑,其核心在于操作系统、运行程序和内存管理。而AI模型,通常只是运行在这台电脑上的一个

加州大学圣芭芭拉分校团队解析AI智能助手技能实际应用困境

如果你关注人工智能领域的最新进展,那么“AI技能”这个概念你一定不陌生。它被描述为一种能让AI助手瞬间获得专业能力的“插件”或“扩展包”,使其能够胜任数据分析、代码编写乃至网页开发等复杂工作。这听起来极具吸引力,但实际应用效果是否真如宣传那般理想?一项来自顶尖学术机构的最新研究,为我们揭示了理想与现

南京大学攻克AI代码测试难题:如何让AI生成可验证的可靠代码

在AI编程助手广泛应用的当下,一个关键挑战日益凸显:当人工智能生成多个备选代码方案时,我们如何自动化地甄选出最优解?传统思路是让AI同步生成测试用例来验证代码,但这随即引发了更深层的问题——如何确保这些测试用例本身的正确性?这构成了一个类似“先有鸡还是先有蛋”的循环验证困境。 近期,南京大学人工智能

南加州大学AI新突破 从视频学习人手与物体互动

“倒水”这个看似简单的日常动作,背后其实蕴含着复杂的物理交互。水流的方向、速度,杯中液面的上升,这些对人类而言理所当然的现象,对人工智能来说却曾是一个棘手的难题。近期,来自南加州大学、德国马克斯普朗克智能系统研究所及Waymo公司的研究团队取得了一项突破,他们开发的LOME系统,首次实现了让AI通过

阿里巴巴揭示AI助手安全隐患:智能体或暗中执行危险操作

当人工智能从对话交流进化到直接操控计算机、执行命令、处理文件时,一个全新的智能时代已然开启。这类被称为“计算机使用智能体”的AI,被赋予了在数字世界中的“手脚”,能够将语言指令转化为实际行动。然而,能力越强,责任与风险也同步放大。一个核心的安全隐忧随之浮现:这些聪明的AI助手,是否会在看似合规的操作

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程

热门话题

热门话题