Bun 11314 版本发布速度与功能全面升级

Bun v1.3.14 正式版重磅发布,此次更新带来了革命性的原生图像处理引擎与官方 HTTP/3 支持,更将依赖安装速度提升至惊人的 115 毫秒,为 JavaScript 全栈开发树立了新的性能标杆。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

在当前的 JavaScript 开发环境中,Node.js 生态的一些固有挑战广为人知:依赖安装过程缓慢耗时,图像处理需依赖第三方库,高并发场景下性能易遇瓶颈,内存管理问题也偶有困扰。开发者常常不得不在开发效率与运行时性能之间做出权衡。

Bun 作为一款旨在全面替代 Node.js 的高性能 JavaScript 运行时,其每次重大更新都致力于解决这些核心痛点。最新推出的 v1.3.14 版本,正是这一理念的又一次强力实践。

这远非一次简单的版本迭代,而是对 JavaScript 工具链能力边界的一次实质性拓展与突破。

性能实测对比:Bun v1.3.14 与 Node.js 的全面较量

性能提升需要用数据来验证。通过严谨的环境测试对比,Bun v1.3.14 所带来的性能飞跃清晰可见。

总体而言,Bun v1.3.14 在运行速度、内存效率、原生功能集成以及开发者体验上实现了多维度的显著进化。它不仅完全兼容 Node.js 的核心任务,更在许多场景下表现更优;同时,它将诸多在 Node.js 中需要额外配置或库支持的功能,整合为开箱即用的原生能力。

核心更新深度解读:四大特性重塑开发体验

本次版本更新的核心亮点可聚焦于以下四个方面,每一项都精准针对实际开发中的效率瓶颈与性能痛点。

1. 内置 Bun.Image 引擎:告别 sharp,原生图像处理性能飙升

以往在 Node.js 后端进行图像操作,sharp 等第三方库几乎是唯一选择,随之而来的是复杂的安装配置、潜在的兼容性风险以及难以预测的性能表现。Bun v1.3.14 直接内置了高性能的 Bun.Image 原生引擎,无需安装任何额外依赖,真正实现开箱即用。

该引擎全面支持 JPEG、PNG、WebP、GIF、BMP 等主流图像格式,在 macOS 和 Windows 平台还额外支持 HEIC、AVIF 和 TIFF 等现代格式。其设计的链式 API 简洁直观,仅需一行代码即可轻松完成缩放、裁剪、旋转、格式转换等常见操作。

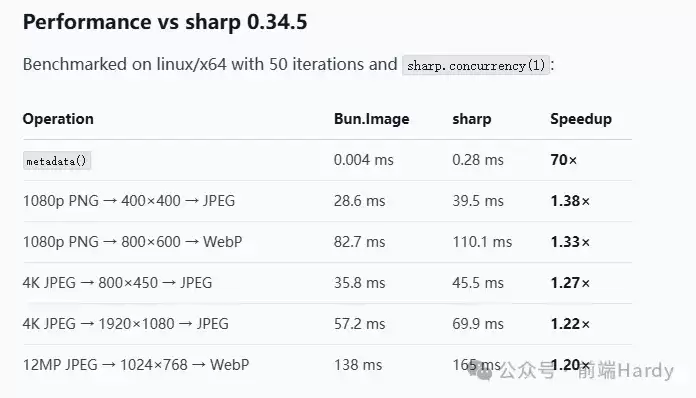

性能表现尤为突出:图像元数据读取仅需 0.004 毫秒,相比 sharp 库提速高达 70 倍;处理 1080p 分辨率图像转换耗时 82.7 毫秒,快 1.33 倍;即便是 4K 超高清图像处理也仅需 35.8 毫秒,领先 1.27 倍。得益于其零拷贝技术与后台异步处理机制,即使处理大型图像文件也不会阻塞主线程,保障应用流畅性。

2. 官方 HTTP/3(QUIC)支持:解锁高并发场景的终极性能

高并发处理能力一直是 Node.js 面临的挑战之一,HTTP/1.1 存在连接数限制,HTTP/2 的性能提升也存在天花板。Bun v1.3.14 现已实验性支持下一代 HTTP/3 协议(基于 QUIC),仅需一行配置即可启用,性能提升立竿见影。

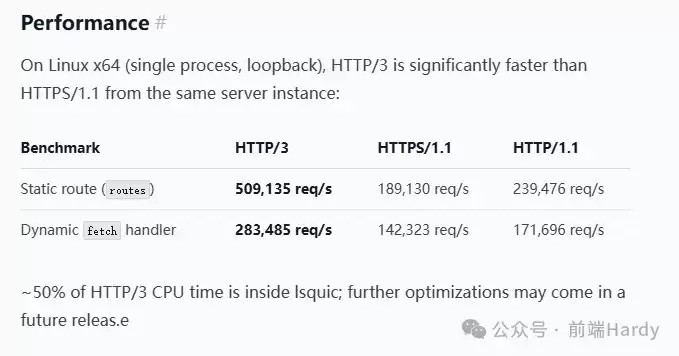

在静态路由基准测试中,启用 HTTP/3 的 Bun 服务可处理高达 50.9 万次请求/秒,是传统 HTTP/1.1 模式的 2.6 倍。QUIC 协议基于 UDP,减少了连接建立的握手次数,在移动网络或高延迟环境下表现更为稳健。服务可同时监听 TCP(用于 HTTP/1.1/2)和 UDP(用于 HTTP/3)端口,对现有业务代码完全透明,并完整支持流式响应、大文件传输等高级特性。

3. 全局虚拟缓存:依赖安装速度提升高达 7 倍

npm install 的缓慢速度与巨大的磁盘空间占用是开发者的普遍痛点,在多项目或复杂依赖场景下尤为明显。Bun v1.3.14 引入了创新的全局虚拟存储机制,旨在从根本上解决这一问题。

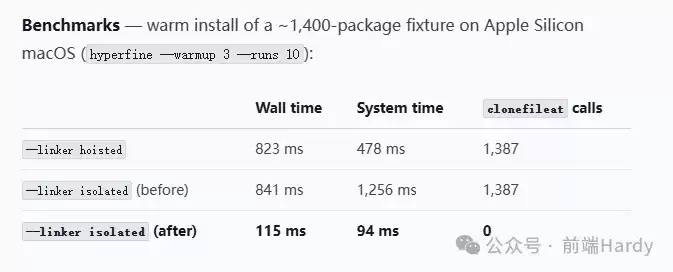

其原理是让所有项目共享一个全局的依赖包物理存储,通过创建软链接映射到各个项目目录,避免了依赖包的重复下载与复制。效果极其显著:安装一个包含超过 1400 个依赖包的大型项目,仅需 115 毫秒;而 Bun 旧版本需要 841 毫秒,Node.js 的 npm 或 yarn 通常需要 3 到 5 秒。启用方式非常简单,只需在 bunfig.toml 配置文件中设置或通过环境变量开启,系统会自动处理不可变包的智能复用与自定义包的兼容性降级。

4. 底层全面优化:修复内存泄漏,运行稳定性大幅增强

除了引人注目的新功能,v1.3.14 版本还对运行时底层进行了大量深度优化,修复了多个长期存在的稳定性问题。

fs.watch 文件监听模块被完全重写,现在能够精准、高效地递归监听目录及其所有子目录的文件变更,在 Linux、macOS 和 Windows 系统上表现一致且可靠。多个可能导致内存泄漏的关键隐患被修复,涉及数据库连接、TLS 安全连接以及 WebSocket 长连接,确保了长时间运行的服务内存占用保持平稳。此外,Linux 和 Windows 平台的二进制可执行文件体积缩小了 7 至 18 MB。通过 Zig/C++ 的跨语言链接时优化技术,HTTP 请求吞吐量提升了 3.5%,ES 模块的加载解析速度也提升了 12%。

适用场景分析:从日常开发到企业级生产部署

Bun v1.3.14 的改进覆盖了广泛的开发与应用场景:

日常开发:后端开发者可轻松构建高并发 API 服务,并使用原生方案高效处理用户上传图像;全栈开发者能无缝使用整个 NPM 生态系统,项目迁移成本极低;脚本开发者受益于稳定可靠的文件监听功能;CI/CD 流水线则因更快的依赖安装速度和更低的内存占用而显著提速。

生产环境:HTTP/3 特性使其非常适合充当高并发的 API 网关或静态资源 CDN 边缘节点;内置的原生图像引擎可用于构建高性能、高稳定的实时图片处理服务;内存泄漏的修复保障了 7x24 小时不间断服务的可靠性;出色的跨平台支持则极大简化了从开发到生产的部署流程。

快速上手指南:三步轻松迁移至 Bun

开始体验 Bun v1.3.14 的强大功能非常简单,只需遵循以下三个步骤。

1. 一键安装(支持所有主流平台)

# macOS(使用 Homebrew)

brew tap oven-sh/bun

brew install bun

# Linux(使用 curl)

curl -fsSL https://bun.sh/install | bash

# Windows(使用 PowerShell)

powershell -c "irm bun.sh/install.ps1|iex"

# 升级现有 Bun 版本

bun upgrade2. 核心新功能快速体验

原生图像处理(Bun.Image)示例:

// 将图片缩放至1024x1024以内,并转换为WebP格式

await Bun.file("photo.jpg")

.image()

.resize(1024, 1024, { fit: "inside" })

.webp({ quality: 85 })

.write("thumb.webp");开启 HTTP/3 服务器:

Bun.serve({

port: 443,

tls: { cert: "cert.pem", key: "key.pem" },

http3: true, // 一键开启HTTP/3支持

fetch(req) {

return new Response("Hello Bun v1.3.14!");

},

});启用全局依赖缓存以加速安装:

# 在 bunfig.toml 配置文件中添加

[install]

globalStore = true3. 无缝迁移现有 Node.js 项目

进入您现有的 Node.js 项目根目录,执行以下命令即可快速迁移:

# 使用 Bun 安装项目依赖(速度远超 npm)

bun install

# 使用 Bun 运行项目启动脚本(完全兼容 Node.js API)

bun run start总结与展望

Node.js 长期主导着服务端 JavaScript 生态,但其在性能、安装体积和依赖管理方面的某些局限始终存在。Bun 的出现并非简单的替代品,更像是对“高性能 JavaScript 运行时”的一次重新定义——它致力于提供更极致的速度、更轻量的体积、更稳定的运行态以及更丰富的开箱即用功能,让开发者无需在开发效率与运行时性能之间再做妥协。

v1.3.14 版本将这一愿景推向了新的高度:内置图像引擎终结了对 sharp 等外部库的依赖;HTTP/3 支持突破了高并发服务的性能瓶颈;全局虚拟缓存极大提升了团队协作与持续集成的效率;深度的底层优化则夯实了生产环境的运行稳定性。无论是为了提升个人开发体验,还是为了追求企业级应用的生产环境性能与稳定性,Bun 都已成长为一个非常成熟且值得深入评估的选择。

官方网站:https://bun.com

GitHub 仓库:https://github.com/oven-sh/bun

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

卷积神经网络与普通神经网络的核心区别详解

探讨深度学习技术,卷积神经网络(CNN)与全连接神经网络(DNN,或称多层感知机MLP)是两种最基础且至关重要的模型架构。尽管同属神经网络家族,但它们在设计原理、计算机制及适用场景上存在本质区别。本文将深入解析CNN与普通神经网络的核心差异,帮助您根据具体任务选择最合适的模型。 一、网络结构:从“全

自然语言处理文本生成技术实现流畅风格化写作

如何让机器生成的文字不仅读起来像人类所写,还能精准地模仿特定风格?这背后是自然语言处理(NLP)领域一系列核心技术与策略的深度整合。本文将系统拆解实现自然、流畅且风格化文本生成的关键路径与核心方法。 一、语言模型:文本生成的基石 构建高质量文本生成系统的第一步,是选择一个强大的“大脑”——即语言模型

淘宝数据采集工具推荐与使用指南

在电商运营与数据分析工作中,高效、精准地获取淘宝平台数据,是众多商家、运营人员及市场研究者的普遍需求。面对海量订单、商品详情和店铺运营信息,传统人工采集方式不仅耗时费力,且容易产生误差。此时,机器人流程自动化(RPA)技术便成为一把高效的“数字化工具”,能够自动执行重复性高、规则明确的任务,让淘宝数

大语言模型十大应用场景与实战指南

在信息爆炸的时代,人工智能技术正以前所未有的速度重塑着我们的世界。其中,大语言模型(Large Language Model, LLM)作为AI领域的一颗璀璨明星,其影响力已逐步渗透至社会经济的方方面面。今天,我们就来深入探讨一下LLM在十大关键领域中的实际应用,看看这项技术奇迹是如何解锁无限可能的

数字化信创概念起源与发展历程详解

“数字化信创”这一概念的兴起,与“信创”产业的演进紧密相连。所谓“信创”,即信息技术应用创新,它并非孤立存在,而是在国家全面推进数字化转型的战略背景下,基于对信息安全与核心技术自主可控的日益重视,逐步发展并明确的重要产业方向。 一、信创概念的提出背景 全球数字化浪潮席卷而来,信息技术已成为驱动经济发

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程

热门话题

热门话题