LeCun JEPA世界模型代码精解:160行核心实现剖析

如果你一直关注AI架构的前沿发展,对Yann LeCun大力倡导的JEPA(联合嵌入预测架构)系列模型充满好奇,但又对动辄数百GB的预训练模型和复杂的工程代码感到无从下手,那么现在有一个绝佳的机会:有人将其核心思想,用最纯粹、最易懂的方式“翻译”成了代码。

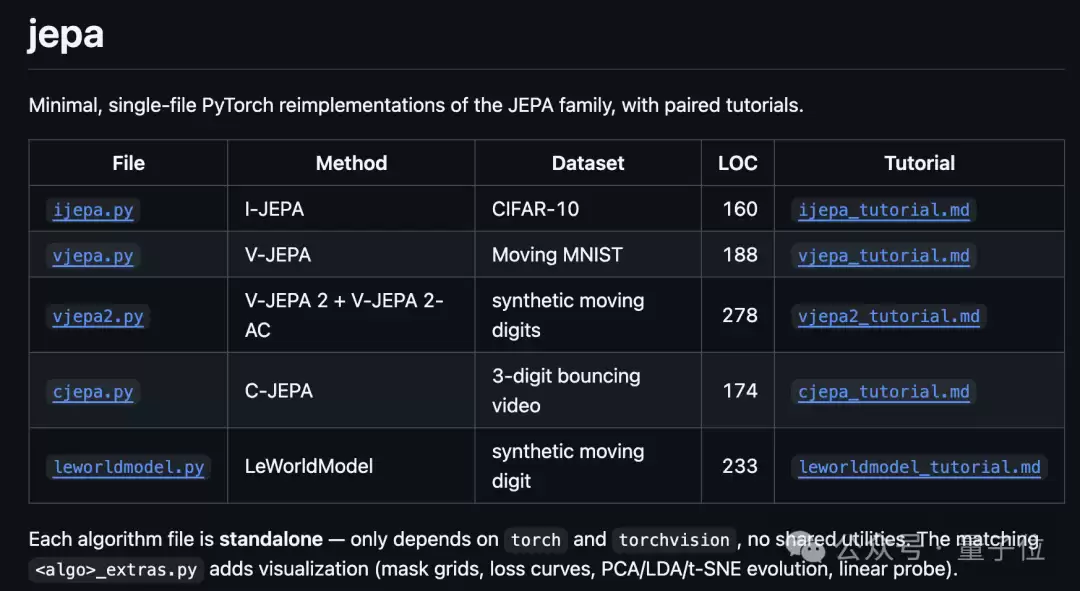

最近,GitHub上出现了一个极具教学价值的开源项目。开发者以极简的单个文件形式,基于PyTorch框架,将JEPA系列的核心变体完整实现了一遍。从I-JEPA到LeWorldModel,五个关键架构一个不落。最令人惊喜的是,每个实现的代码行数被精炼到了惊人的160行到278行之间,依赖项仅有PyTorch和torchvision。这意味着,你甚至可以用一台普通的笔记本电脑就能轻松运行实验,亲身体验JEPA的魅力。

该项目的目标非常明确:剥离所有复杂的工程外壳,直指算法原理的核心,让你能真正看懂并理解JEPA系列模型是如何工作的。下面,让我们快速浏览一下这五个模型的核心实现与特点:

- I-JEPA(图像JEPA):仅用160行代码在CIFAR-10数据集上运行。其核心是掩码块嵌入预测:随机遮盖图像的一部分图像块(patch),模型的任务是从可见区域的上下文信息中,预测被遮盖区域的语义嵌入(embedding)。EMA目标编码器、多块掩码策略、Smooth-L1损失——这些经典自监督JEPA的核心组件都被完整保留。

- V-JEPA(视频JEPA):188行代码适配于Moving MNIST动态数据集。它将二维图像块扩展为三维的“时空管块”(tubelet),并同时应用短程和长程两组管状掩码,让模型能够从部分视频帧序列中推测缺失帧的时空特征。其机制与I-JEPA同源,但增加了对时间维度的建模。

- V-JEPA 2-AC(带动作条件的视频JEPA):227行代码支持以动作为条件的预测。它采用两阶段训练策略:首先像标准V-JEPA一样进行预训练,然后在冻结的编码器潜在空间上,额外训练一个以动作为条件的预测器,实现更可控的生成。

- C-JEPA(物体轨迹JEPA):174行代码聚焦于3-digit弹跳视频的物体轨迹预测。它不再进行图像级的掩码,而是进行物体级的轨迹掩码:在初始时间点t=0保留物体身份作为锚点,后续时间点的轨迹信息全部被遮盖,模型使用双向Transformer在物体槽标记(slot token)上进行预测。

- LeWorldModel:233行代码实现了一个端到端训练的JEPA世界模型。这个版本更加简洁,没有使用EMA、没有梯度截断、也没有掩码操作,编码器和基于动作条件的自回归预测器被联合起来进行端到端训练。

如何实现极简教学:核心设计思路

那么,如何将一套前沿且复杂的AI架构压缩到如此轻量级?关键在于这个教学版项目所遵循的“三重精简”设计哲学。

要知道,原版JEPA论文通常使用ViT-Huge这类巨型模型和ImageNet或Kinetics等海量数据集,训练需要耗费数百张GPU,对普通学习者而言门槛极高。而这个教学版从三个层面进行了大幅简化:

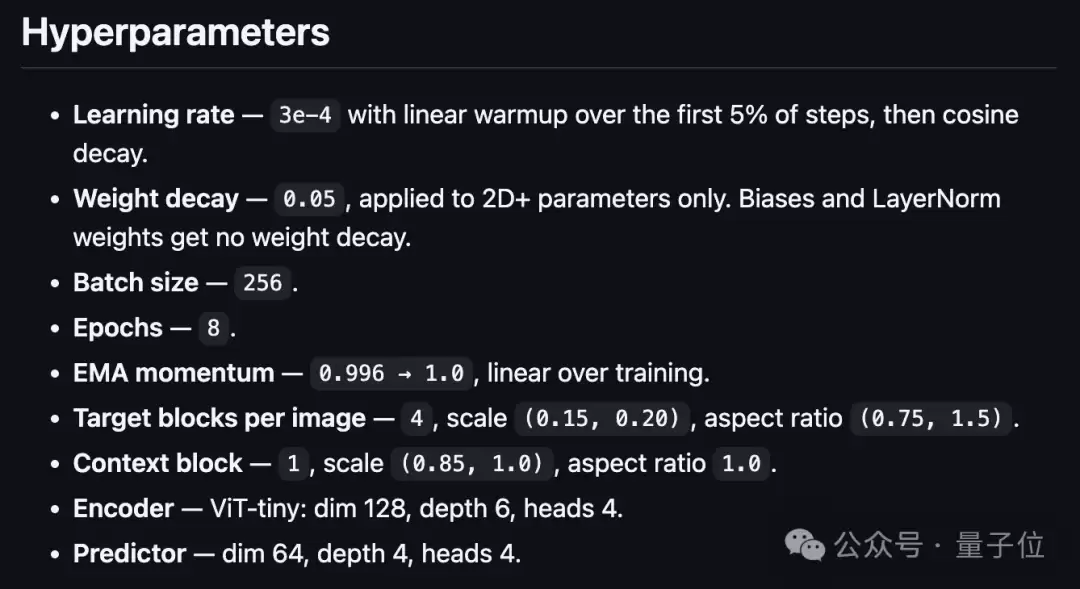

首先,模型规模从ViT-Huge大幅缩减为ViT-Tiny,参数量相差两个数量级,极大降低了计算需求。其次,数据集替换为CIFAR-10和合成视频(如Moving MNIST),数据量仅几十兆,验证效果足够且门槛极低。最后,也是最重要的一点,所有核心的算法机制一概保留。无论是掩码策略、损失函数(Smooth-L1、MSE)、预测逻辑,还是EMA更新、热身与余弦退火学习率调度等关键技术细节,都得到了精准的复现。

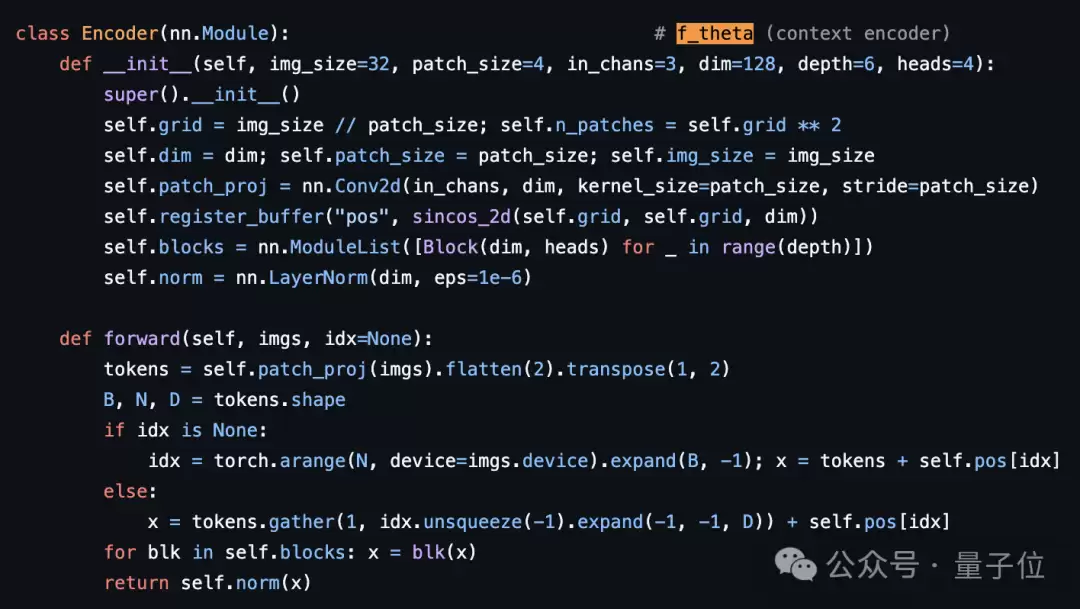

以最核心的ijepa.py文件为例,在短短160行代码里,包含了从图像块嵌入提取、ViT编码器、EMA目标编码器、多块掩码采样,到预测器构建、损失计算、学习率调度乃至权重衰减分离的完整训练流程。

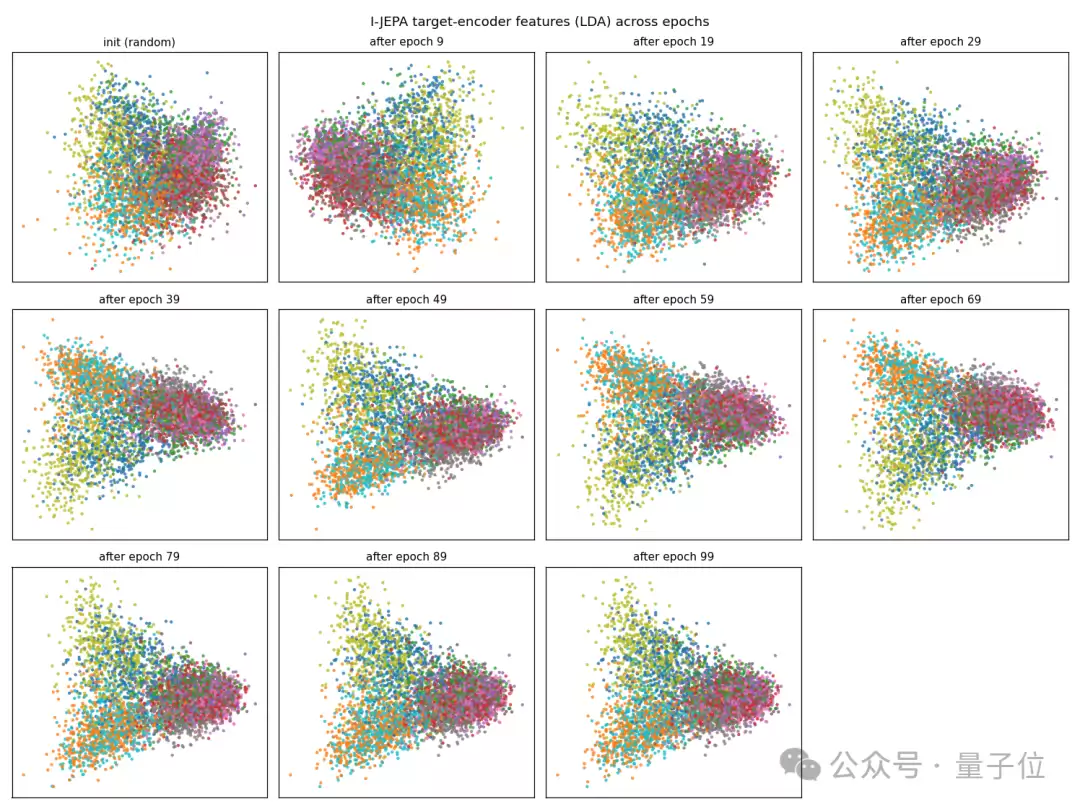

使用这套精简配置在CIFAR-10上训练100个周期(epoch),其线性探测(Linear Probing)准确率可以达到52.7%。为了直观展示模型特征的学习与演变过程,项目会在每训练10轮后,保存一次测试集特征的快照,并通过LDA(线性判别分析)降维投影到二维平面进行可视化,清晰呈现类别分离度的提升。

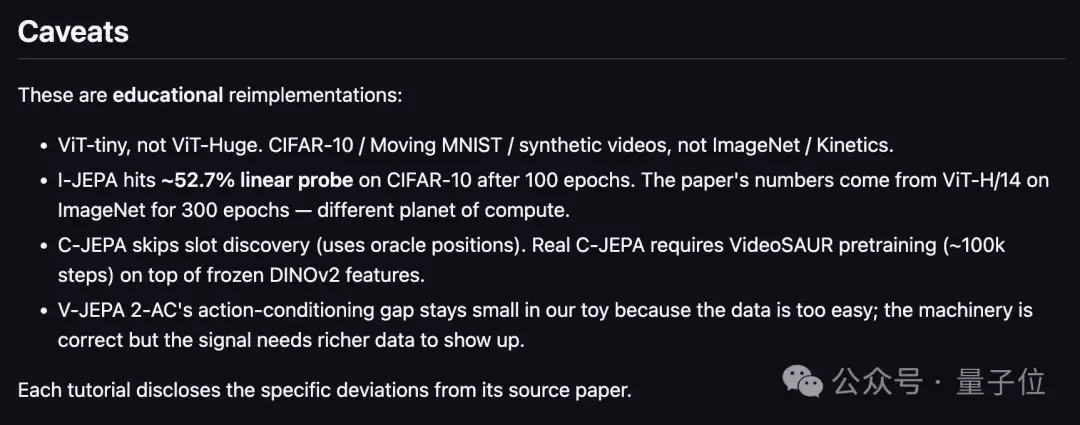

当然,必须明确指出,这个成绩与原版论文中ViT-Huge在ImageNet上训练300个周期的结果存在巨大差距。但两者的核心运行机制、损失目标和训练逻辑是完全一致的,教学版完美地复现了其“灵魂”。

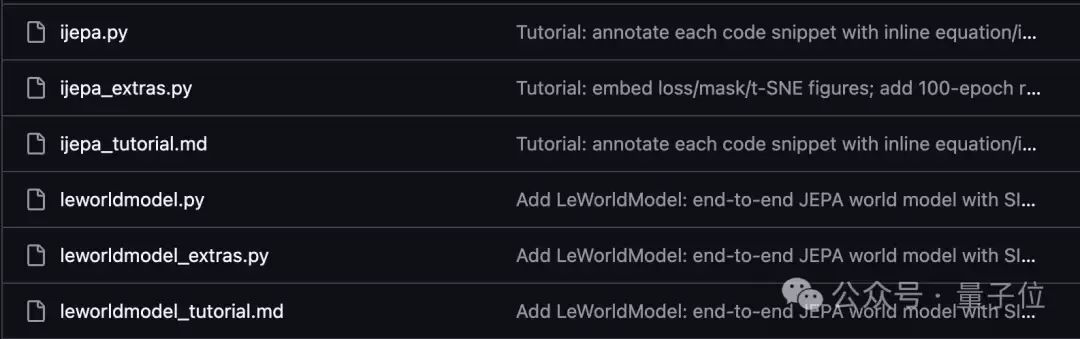

此外,项目的易用性和可观察性也设计得非常出色。每个主文件(如ijepa.py)旁边都有一个对应的xxx_extras.py扩展文件。运行后者,不仅能完成模型训练,还会自动生成全套可视化分析结果:掩码动画让你看清哪些图像区域被遮盖、哪些区域用于上下文预测;损失曲线图展示模型的收敛过程;t-SNE和PCA降维图则动态地呈现了在嵌入空间中,不同类别的样本如何从初始的混沌混合状态逐渐变得层次分明、边界清晰。

实际操作与上手体验也极其简单:

git clone git@github.com:keon/jepa.git && cd jepa

python -m venv .venv && source .venv/bin/activate

pip install -r requirements.txt

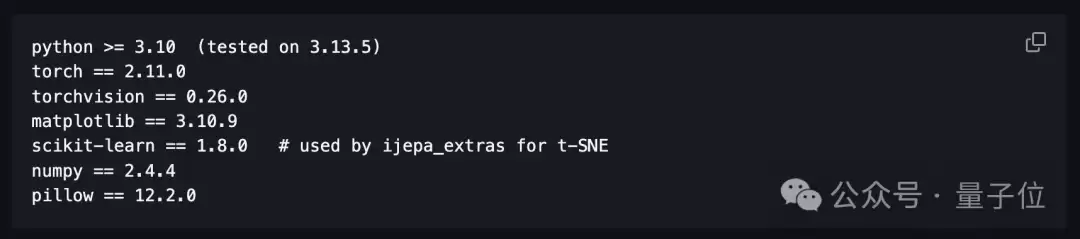

项目环境依赖非常干净,主要就是PyTorch及其相关工具库,确保了快速部署:

项目涵盖的5个JEPA变体均为完全独立的文件,没有共享的复杂工具代码,每个都可以直接运行,互不干扰:

python ijepa.py # 仅进行训练,不生成可视化

python ijepa_extras.py # 训练 + 全量可视化 + 线性探测评估

代码天然支持CUDA、MPS(Apple Silicon)和CPU运行,所需的小型数据集会自动下载。你想尝试学习哪个JEPA变体,直接运行对应的文件即可,彼此之间毫无依赖,学习路径清晰。

从论文概念到可读代码:降低理解门槛

JEPA这套由Yann LeCun提出的架构,在过去几年里虽然备受关注,但多少有些“曲高和寡”。LeCun在各种场合不遗余力地推广其作为世界模型基石的理念,相关论文也持续产出,业界公认这是一个重要的AI技术方向——其核心优势在于在抽象的、语义丰富的嵌入空间中进行预测,而非原始像素空间,从而能获得更高的计算效率、更好的泛化能力和对不确定性的鲁棒性。

然而,当学习者满怀热情地打开Meta AI官方发布的最新V-JEPA代码仓库时,往往会被其中庞大的工程体系所震慑:复杂的分布式训练框架、精心设计的数据流水线、EMA调度器、日志系统……对于只想透彻理解算法数学本质和核心思想的人来说,这无异于大海捞针,增加了学习与复现的难度。

而这个极简教学项目所做的,正是将JEPA重新“蒸馏”和“压缩”回其最纯粹的算法本体。每个实现文件打开就是清晰的算法逻辑,没有冗余的工程包装,没有分布式调度,没有多余的抽象层。编码器(f_θ)、预测器(g_φ)、掩码采样器(s_y)、损失计算、EMA更新,每个核心模块都只有寥寥数十行代码,并且在注释中清晰地标明了对应原论文中的数学符号,实现了论文公式与可执行代码的左右对照阅读,极大提升了学习效率。

当然,作为专注于教学和原理演示的版本,它必然在模型规模、数据集复杂度和最终任务精度上与原始论文的SOTA结果存在差距。开发者对此也非常坦诚,在项目文档中明确列出了每个实现的已知偏差与简化之处:例如,I-JEPA教学版52.7%的线性探测准确率,与原论文在ImageNet上达到的顶尖性能不可同日而语;C-JEPA的实现跳过了原流程中更复杂的VideoSAUR物体发现预训练阶段;V-JEPA 2-AC在玩具数据集上的条件预测信号可能不如真实场景中明显。

但这恰恰不是该项目的核心目标。它的最大价值,用开发者自己的话说,是“将前沿算法蒸馏到只剩其数学本质”,提供一个无干扰的、聚焦原理的学习环境。

对于AI初学者、机器学习爱好者,或是任何希望穿透重重工程迷雾,真正从第一性原理理解JEPA系列工作机制的研究者而言,这个GitHub仓库或许是目前最好的起点和学习工具。它成功地完成了一次重要的知识转换:让一个前沿且略显晦涩的学术概念,变成了一段段清晰、可运行、可修改、可调试的Python代码,从而显著降低了探索和理解下一代自监督学习与世界模型技术的门槛。

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

AI语言模型纽约街头实测:哥本哈根大学研究揭示人机交互安全挑战

这项由哥本哈根大学、IIIT兰契、ISI加尔各答、NIT安得拉邦、IGDTUW、IIT卡拉格普尔、谷歌DeepMind、谷歌以及南卡罗来纳大学AI研究所联合开展的研究,以预印本形式于2026年4月10日发布,论文编号为arXiv:2604 09746。 人工智能助手的能力日益强大,从撰写报告到规划行

字节跳动GRN模型革新AI绘画实现边生成边修改新方法

在探讨AI图像与视频生成技术时,我们通常会想到扩散模型——它如同修复一张被雨水浸湿的照片,通过反复“去噪”从混沌中逐步显现清晰画面。尽管这种方法效果显著,却存在一个根本的效率瓶颈:无论生成内容的复杂程度如何,模型都需要执行固定且繁重的计算步骤,无法智能地分配算力资源。 另一条主流技术路径是自回归模型

斯坦福AI诊断师可自我评估短板并针对性优化

这项由斯坦福大学主导的研究以预印本形式于2026年4月发表,论文编号为arXiv:2604 05336v1。研究提出了一个名为TRACE的系统,全称是“Turning Recurrent Agent failures into Capability-targeted training Environ

Meta AI新研究揭示旧数据复用如何提升40%训练效率

一项由Meta基础人工智能研究团队与纽约大学柯朗研究所联合开展的研究,于2026年4月9日以预印本形式发布,论文编号为arXiv:2604 08706v1。这项研究颠覆了AI训练领域一个长期被视为“金科玉律”的常识。 一、一个反直觉的发现:旧数据“回炉重造”,效果更佳? 在AI模型训练中,数据如同食

AI能否记住你?Kenotic Labs评估体系重新定义人工智能记忆边界

这项由Kenotic Labs开发的研究成果发表于2026年4月的第39届神经信息处理系统大会(NeurIPS 2025),论文编号为arXiv:2604 06710v1。 不知道你有没有过这样的体验:和一位朋友促膝长谈,分享了近期的压力、生活的变动,甚至一些私密的感受。可下次见面,对方却仿佛失忆了

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程

热门话题

热门话题