谷歌首席科学家Jeff Dean揭秘Gemini研发历程

“从一开始,谷歌就展现出巨大的潜力,发展到今天的规模,可以说是水到渠成。”这句话出自一位在谷歌度过了近半职业生涯的科学家之口。时至今日,他依然对这家公司充满热情,并坚守着其最初的使命:

整合全球信息,供大众使用,使人人受益。

Jeff Dean 至今还记得谷歌早期的日子,每到周二流量高峰,团队就提心吊胆,生怕系统崩溃。后来通过增加设备、优化代码和搜索功能,谷歌搜索才逐渐稳定下来。

再后来,当吴恩达在谷歌担任顾问时,Jeff Dean 与他共同设定了研究大型神经网络的目标,最终促成了 Google Brain 团队的诞生。

时间来到2011年,在质疑声中,Google Brain 成功训练出了比当时其他模型大50到100倍的神经网络。

而在地球的另一端,DeepMind 的故事才刚刚开始。

Jeff Dean 的愿景始终是构建高质量、大规模的多模态模型。当时的 DeepMind 与 Google Brain 目标相似,但分别选择了强化学习和模型扩展两条不同的技术路径。

收购 DeepMind 后,Jeff Dean 推动了两大团队的融合,Google DeepMind 由此诞生。

强强联合之下,交出的第一份重量级答卷便是 Gemini。

Gemini 的优势不仅在于多模态能力,更在于其“化繁为简”的设计理念。

得益于底层的 Transformer 架构,Gemini 能够并行处理海量数据,效率相比传统的递归模型提升了10到100倍。更重要的是,它能将不同类型的数据(如文本、图像、声音)抽象转化为相同的高维表示,从而整合表面信息及其背后的深层关联。

举个例子,Gemini 不仅能理解“牛”这个词,还能关联到与牛相关的声音、图像等多重信息。反之,输入这些相关信息,也能触发模型对“牛”的立体化理解。

对用户而言,一切交互都变得直观而简单。无需在不同工具或输入格式间切换,用户可以通过文字、语音、图片等多种方式与系统对话。系统则会自动整合所有输入,生成最直观、最易于理解的结果——文本可以生成图像,图像可以转化为语音,图文融合也能轻松实现。

对开发团队来说,实现这一技术的背后异常复杂,但 Gemini 成功跨越了这些挑战。

然而,Jeff Dean 的蓝图远不止于此。他目前正致力于开发更深层次融入人类生活的人工智能工具,覆盖从日常助手到医疗、AI教育等多个领域。

多模态模型的未来,如同谷歌的历程一样,充满了可能性。从过去到现在,这一领域持续展现着巨大的潜力与希望。

近日,Jeff Dean 做客 DeepMind 的播客节目,回顾了他与谷歌的过往、DeepMind 与 Gemini 背后的故事,并分享了对多模态模型的探索与见解。

90年代的谷歌

Hannah Fry:你在谷歌工作了25年,早期的谷歌是什么样子的?90年代刚加入时,是不是大家笔记本上都贴满了贴纸,穿着人字拖写代码?

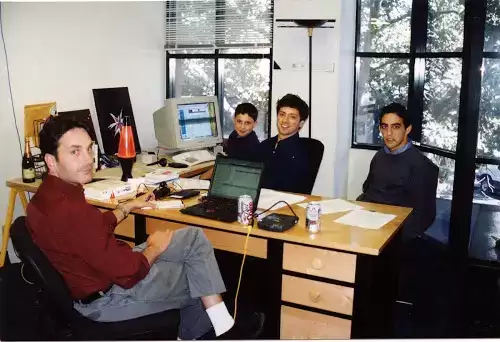

Jeff Dean:那时候还没有笔记本,我们用着巨大的CRT显示器,非常占地方。我的“桌子”其实是一扇门搭在两个锯木架上,你甚至能钻到桌子下面,用背把它顶高一点。

刚开始工作时,我们的办公室很小,大概只有这个房间的三倍大。

Hannah Fry:你是说……整个谷歌?

Jeff Dean:对,整个谷歌。当时我们在帕洛阿尔托大学大道的一个小办公室里,就在现在那家T-Mobile手机店的楼上。那时真的很让人兴奋,尽管公司很小,但看到越来越多人使用我们高质量的搜索服务,感觉太棒了。流量每天都在增长,每周都在攀升。

我们当时最紧要的任务,就是确保系统不会在每周二中午的流量高峰时崩溃。这迫使我们快速增加计算资源,优化代码提升速度,并开发新功能,让同样的硬件能为更多用户服务。

Hannah Fry:有没有那么一个时刻,让你们突然意识到——这家公司将来会变得非常庞大?

Jeff Dean:我想,从我刚加入的时候,那种流量的快速增长就已经很明显了。

我们觉得,只要专注于提供高质量的搜索结果,快速满足用户需求——事实上,我们巴不得用户尽快离开我们的网站,找到他们想要的信息——这个想法被证明非常成功。

用户显然喜欢我们的服务,所以从一开始,前景就相当明朗。

Hannah Fry:从“相当明朗”到如今的庞大规模,中间跨度可不小。你感到惊讶吗?

Jeff Dean:确实,业务范围的扩展有时难以预料,比如自动驾驶汽车。我们的产品线是逐步拓宽的,从最初的搜索引擎,到后来帮助用户管理邮件的Gmail等等。

这种扩展是自然而然的,因为它们都在解决实际的问题。这让我们不再只有一个产品,而是拥有了许多用户日常生活中都会用到的产品。

Hannah Fry:回顾这么多年的发展,你认为谷歌本质上始终是一家搜索公司,还是说它其实是一家AI公司,只是看起来像搜索公司?

Jeff Dean:我认为公司解决的许多核心问题,本质上都依赖于AI。在这25年里,我们逐步攻克了一系列复杂的AI难题,并持续取得进展。

虽然谷歌始于搜索,但我们不断将这些新的AI技术应用到搜索及其他产品中。所以,可以说我们一直在利用AI驱动公司前进。

Hannah Fry:你认为谷歌未来会一直是一家搜索公司吗?或者说,它现在还是吗?它正在改变吗?

Jeff Dean:谷歌让我非常欣赏的一点是,即便25年过去了,我们的使命依然充满力量——“整合全球信息,供大众使用,使人人受益”。

我认为,Gemini 让我们在理解各类信息方面迈进了一大步,这包括文本数据,也包括软件代码(它也是一种特殊形式的文本)。我们不仅能阅读文字,还能通过视觉和听觉接收信息。

我们的目标是让模型能够处理各种形式的输入,并生成相应的输出,无论是文本、音频、对话、图像还是图表。

我们真正想构建的,是一个能处理所有这些模态、并能按需生成输出的统一模型。

神经网络的早期探索

Hannah Fry:你还记得第一次接触神经网络是什么时候吗?

Jeff Dean:当然记得。神经网络的历史其实挺有趣的。

AI是一个非常古老的领域,早期阶段主要研究如何用规则来定义事物如何运作。那大概是20世纪50、60、70年代的事。

神经网络大约在70年代出现,在80年代末90年代初掀起过一阵热潮。

实际上,1990年我在明尼苏达大学读本科时,上了一门并行处理课程,探讨如何将一个任务分解,让多台计算机协同工作来解决问题。

Hannah Fry:我猜那时候的计算能力远不如现在,你们是怎么让计算机协作的?

Jeff Dean:神经网络是一种特殊的机器学习方法,它通过模拟人脑神经元的工作方式来学习。每个人工神经元都与下一层的其他神经元连接,分析接收到的信号,然后决定是否将信号向上传递。

神经网络由多层人工神经元组成,高层神经元通过分析下层传递的信号来学习。

例如,在图像识别任务中,最底层的神经元可能学会识别基础的色块或边缘;下一层可能识别出带有特定颜色边框的形状;更高层的神经元则可能识别出这些形状组成的物体,比如鼻子或耳朵。

通过这种层层抽象的学习,神经网络能发展出非常强大的模式识别能力。这也是1985到1990年间人们对神经网络感到兴奋的原因。

Hannah Fry:不过我们当时谈论的是非常非常小的网络,对吧?

Jeff Dean:是的,非常小。所以它们识别不了人脸或汽车这样的复杂物体,只能识别一些人工生成的简单模式。

Hannah Fry:就像一个网格,或许能识别出一个十字形之类的。

Jeff Dean:或者手写数字,比如这是7还是8。

这在当时已经很了不起了。但它们的能力仅限于此。而那些基于逻辑规则的系统,比如去定义什么是“7”,在处理各种潦草的手写体时,效果其实并不好。

所以,在听了两节关于神经网络的课后,我产生了浓厚兴趣,并决定将我的本科毕业论文主题定为神经网络的并行训练。

我当时认为,只要有更多的计算资源就能取得突破。于是我想,何不用系里那台32个处理器的机器来训练更大的网络呢?这就是我接下来几个月所做的事。

Hannah Fry:成功了吗?

Jeff Dean:算是成功了。当时我以为32个处理器足以让神经网络顺畅运行,但事实证明我错了。我们大概需要一百万倍的计算能力,才能真正让它们大放异彩。

幸运的是,摩尔定律的推进、处理器速度的提升,以及各种计算设备的发展,最终让我们拥有了强大一百万倍的计算系统。这让我重新燃起了对神经网络的兴趣。

当时,吴恩达每周有一天在谷歌做顾问。

有一次我在谷歌的厨房碰到他,问他最近在忙什么。他说:“还在摸索,不过我的学生在神经网络方面取得了一些不错的进展。”我于是提议:“为什么不试试训练一些超大的神经网络呢?”

这就是我们在谷歌开展神经网络研究的起点。后来我们成立了 Google Brain 团队,专门研究如何利用谷歌的计算资源来训练大型神经网络。

我们开发了软件,将神经网络分解成多个部分,由不同的计算机处理,并让它们相互通信,从而在2000台计算机上协同训练一个神经网络。这让我们训练出了比当时其他模型大50到100倍的网络。这是2012年初,在图像识别取得重大突破之前的事。

当时我们所做的,本质上和我本科论文一样,是把计算机连接起来。不同的是规模大了许多,而这次真的奏效了,因为计算机更快了,用的机器也更多了。

Hannah Fry但在2011年的时候,这感觉像是一场反赌吗?

Jeff Dean:当然像。我们当时为训练这些神经网络而搭建的系统,尝试了各种分解方法,我给它起名叫 DistBelief。

部分原因是很多人不相信这能成功,另一部分原因是它是一个分布式系统,用来构建这些网络——我们想训练的不仅仅是神经网络,还有深度信念网络。所以就叫 DistBelief 了。

DeepMind 和 Gemini 背后的故事

Hannah Fry:当你们在美国开发 DistBelief 时,大西洋彼岸的 DeepMind 才刚刚起步。我知道你是后来负责拜访 DeepMind 的人。能讲讲这个故事吗?

Jeff Dean:好的。Geoffrey Hinton,那位著名的机器学习研究员,2011年夏天曾在谷歌工作。当时我们甚至不知道该给他什么头衔,最后把他归为“实习生”,这挺有意思的。后来他和我一起工作,之后我们听说了 DeepMind 这家公司。

我想 Geoffrey 对这家公司的起源有所了解,也有其他人告诉我们,“英国有家公司在做一些有趣的事情。”当时他们大概只有四五十人。于是我们决定去看看,将其视为一个潜在的收购对象。

那时我在加州,Geoffrey 在多伦多当教授。他背部有问题,无法乘坐普通航班,因为他不能坐着,只能站着或躺着。而飞机起飞时又不能站着,所以我们安排了一架带有医疗床的私人飞机。

我们从加州飞到多伦多接上他,然后一起飞往英国,降落在某个偏远机场。接着我们坐上一辆大面包车,直奔 DeepMind 的办公室,地点应该在伦敦罗素广场附近。

前一晚的飞行让我们筋疲力尽,紧接着就是 DeepMind 团队连续13场、每场20分钟的演讲,介绍他们的各种项目。我们看了他们在雅达利2600游戏上的一些工作,比如《打砖块》和《乒乓球》,这些都非常有趣。

Hannah Fry:你们当时还没做强化学习的工作?

Jeff Dean:对,那时我们主要专注于大规模的监督学习和无监督学习。

Hannah Fry:强化学习更像是通过奖励来激励智能体,对吧?

Jeff Dean:是的。我认为这些技术都很有用,而且结合起来通常效果更好。

强化学习的核心在于,智能体在环境中行动,每一步都有多个选择。例如,在围棋中,你可以在多个位置落子;在雅达利游戏中,你可以移动摇杆或按下按钮。奖励往往是延迟的,在围棋中,你只有到棋局结束时才知道每一步的好坏。

强化学习的有趣之处在于,它能处理长时间的动作序列,并根据这些动作的最终结果给予奖励或惩罚。奖励或惩罚的程度与这些动作的预期结果相关。

如果你赢了,你会觉得这个决策是对的,从而增加对该策略的信心;如果输了,你可能会降低信心。强化学习特别适用于那些结果需要较长时间才能显现的场景。

监督学习则是指你有一组输入数据和对应的真实输出标签。一个经典的例子是图像分类,每张图片都有一个标签,比如“汽车”、“鸵鸟”或“石榴”。

Hannah Fry:当你们决定收购时,Demis(DeepMind 联合创始人)紧张吗?

Jeff Dean:我不确定他是否紧张。我当时主要关注的是代码质量。我要求看一些实际的代码,以了解他们的编码标准和注释情况。Demis 对此有些犹豫。

我说我只需要看一些小片段,就能了解代码的实际情况。于是,我进了一位工程师的办公室,我们坐下来聊了大约10分钟。

我问,这段代码是做什么的?那个东西呢?那有什么作用?能给我看看它的实现吗?出来之后,我对代码质量感到满意。

Hannah Fry:在这些演示中,你的总体印象如何?

Jeff Dean:我觉得他们的工作非常有趣,尤其是在强化学习方面。

我们当时专注于模型扩展,训练的模型比 DeepMind 处理的大得多。他们用强化学习解决游戏问题,这为强化学习提供了一个绝佳的应用场景。

将强化学习与我们的大规模扩展工作结合起来,看起来是一个非常有前途的方向。

Hannah Fry:这就像从两个方向解决问题——一个是小规模的、像玩具模型一样的强化学习;另一个是大规模的理解。把两者结合起来,威力巨大。

Jeff Dean:没错,确实如此。这也是我们去年决定合并 DeepMind、Google Brain 和其他谷歌研究部门的主要原因。我们决定将这些力量整合起来,组成 Google DeepMind。

Gemini 的概念其实在合并想法之前就有了,但真正的目的是让我们能集中力量攻克这些问题。

既然我们都致力于训练高质量、大规模、多模态的模型,那么把想法和计算资源分开就是不合理的。

因此,我们决定整合所有资源和人员,组建一个联合团队来解决这个问题。

Hannah Fry:为什么叫 Gemini?

Jeff Dean:名字其实是我起的。Gemini 意为“双子座”,象征着双胞胎。这个名字很好地体现了 DeepMind 和 Google Brain 的结合,象征着两个团队为了一个雄心勃勃的多模态项目而并肩奋斗。

此外,这个名字还有另一层含义,它有点像雄心勃勃的太空计划的前奏,这也是我选择它的原因之一。

Transformer与多模态处理

Hannah Fry:我想聊聊多模态。在这之前,能先谈谈 Transformer 的工作以及它的变革性影响吗?

Jeff Dean:当然。实际上,处理语言和许多其他领域的问题,往往都涉及序列。

例如,Gmail 的自动补全功能,根据你已输入的内容预测下一个可能的词,这类似于大型语言模型的训练方式。这类模型被训练来逐字逐词地预测文本的后续部分,就像一种高级的自动补全。

这种序列预测的方法在许多领域都有用。在机器翻译中,模型可以根据输入的英文句子预测对应的法文句子。在医疗领域,它可以处理病人的症状和检测结果,预测可能的诊断。

此外,这种方法也适用于其他类型的数据序列,比如DNA序列。通过隐藏序列中的部分信息,模型被迫去预测接下来会发生什么。这不仅适用于翻译和诊断,还可以扩展到更多领域。

在 Transformer 架构出现之前,成功的模型是递归模型,它们依赖内部状态来处理序列数据。处理每个词时,模型更新一次内部状态,然后再处理下一个词。这种方法需要逐步处理,导致速度较慢,因为每一步都依赖于前一步,存在序列依赖。

为了提高效率,谷歌的研究人员提出了 Transformer 架构。与其逐词更新状态,不如一次性处理所有词,并利用所有先前的状态进行预测。

Transformer 基于注意力机制,能够关注序列中的重要部分。这使得它可以并行处理大量词语,极大地提升了效率和性能,相比传统递归模型,提升了10到100倍。

这就是进步如此巨大的原因。

Hannah Fry:我们是否还能从语言和序列中获得一种概念性的理解或抽象?这让你感到惊讶吗?

Jeff Dean:是的。当我们听到一个词时,想到的不仅是它的表面形式,还有与之相关的许多事物。比如,“牛”这个词会让我们联想到牛奶、咖啡机、挤奶等。在词的向量表示中,方向性也很有意义。例如,“走”到“走了”的变化方向,与“跑”到“跑了”的变化方向是相似的。这种表示并非我们刻意设计,而是在训练过程中自然涌现的。

Hannah Fry:这很神奇。但这还只是语言层面。多模态处理会带来什么改变?有什么不同?

Jeff Dean:多模态处理的关键在于,如何将不同类型的输入数据(如图像和文字)转换为相同的高维表示。当我们看到一头牛时,无论我们是读到“牛”这个词,还是看到牛的图片或视频,我们大脑中被激活的区域是相似的。我们希望训练的模型,也能将这些不同输入背后的联合意义和表示整合起来。这样,看到一段牛在田野走的视频,模型内部触发的反应,应该与看到“牛”这个词时类似。

Hannah Fry:所以,多模态处理并不是把语言部分和图像部分分开处理再拼起来?

Jeff Dean:正是如此。在早期模型中,虽然存在这些表示,但处理起来确实更复杂。

Hannah Fry:这是否使得构建多模态模型的初始设置更加困难?

Jeff Dean:是的,多模态模型的整合和训练,比单一的语言模型或图像模型要复杂得多。然而,这样的模型能带来很多好处,比如跨模态的迁移学习。看到牛的视觉信息,可以帮助模型更好地理解语言。这样一来,无论是看到“牛”这个词还是牛的图像,模型内部都会有类似的反应被触发。

多模态模型的风险与潜力

Hannah Fry:你认为这些多模态模型会改变我们的教育方式吗?

Jeff Dean:我认为AI在教育领域的潜力是巨大的,不过我们还处于探索的早期阶段。

研究表明,一对一辅导的效果远好于传统课堂。那么,AI能否让每个人都享受到类似的一对一辅导呢?这个目标离我们并不遥远。

未来,像Gemini这样的模型可以帮助你理解课本内容,无论是文字、图片还是视频。如果有不理解的地方,你可以提问,模型会帮你解释,还能评估你的回答,引导你的学习进度。

这种个性化的学习体验可以惠及全球,不仅限于英语,还将支持世界上数百种语言。

Hannah Fry:你提到的多语言和普及工具的想法很好,但是否存在这样的风险:能使用这些工具的人获益更多,而无法使用的人会面临更大困难?这是你担心的问题吗?

Jeff Dean:是的,我担心可能会出现一个两极分化的系统。我们应该努力让这些技术普及化,最大化其社会效益,并确保教育资源变得负担得起甚至是免费的。

Hannah Fry:现在的计算方式似乎正从确定性转向概率性,公众是否需要接受模型可能会犯错的事实?这个问题能解决吗?

Jeff Dean:两方面都需要。一方面,我们可以通过技术进步来提升准确性,比如使用更长的上下文窗口。另一方面,公众需要明白模型是工具,不能盲目依赖它们的每一个输出。我们需要教育人们保持适度的怀疑,同时,技术的进步会减少这种怀疑的必要性,但适度的审视仍然重要。

Hannah Fry:除了加长上下文窗口,还有其他方法可以减少模型产生虚假结果的风险吗?

Jeff Dean:有的,另一个方法是“思维链提示”。例如,对于数学问题,让模型一步步展示解题过程,比直接问答案更有效。这不仅让输出更清晰,也提高了正确率。即使对于没有明确答案的问题,给出更具体的提示也能得到更好的结果。

Hannah Fry:这些多模态模型会理解我们的个人特点和偏好吗?

Jeff Dean:是的,我们希望模型能更加个性化。比如,如果你是素食主义者,它能推荐素食餐厅。虽然现在可能还做不到那么精细,但未来会有更多符合个人需求的功能,比如为你的孩子生成定制插图的睡前故事。

我们希望模型能处理复杂的任务。例如,你可以用简单的指令让机器人打扫房间。虽然现在的机器人还做不到这一点,但我们正接近这个目标。未来,它们将能在杂乱的环境中完成许多有用的任务。

Hannah Fry:目前这些助手主要用于增强人类能力,特别是在医疗和教育领域。多模态模型是否能帮助我们更好地理解世界?

Jeff Dean:是的。随着模型能力的提升,它们能处理更复杂的任务,比如策划一场会议或租赁一把椅子。模型可以像人一样通过提问来澄清需求,并进行高层次的任务规划。此外,它们能在模拟器中测试不同的设计方案,例如设计一架飞机。虽然我们无法准确预测这些能力何时实现,但模型在过去5到10年里取得了显著进展。未来,这些功能可能会更快到来,甚至能帮助设计特定用途的飞机。

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

可视化建站工具快站:零代码轻松创建专业网站

在众多可视化建站平台中,搜狐快站以其一站式的解决方案,成为企业搭建官网和移动端应用的优选工具。它提供直观的拖拽式页面编辑器、功能完善的内容管理后台、海量行业模板库,并确保所有页面完美适配手机、平板等不同屏幕。更值得一提的是,其额外集成了App快速生成、微信公众号管理以及微信小程序开发等核心能力,全面

智合同智慧应用平台助力企业高效签约

智合同是一款深度融合人工智能技术与法律服务的创新平台,由天津滨海高新技术产业开发区内一家具备独角兽潜力的科技企业自主研发。目前,品牌已在武汉、深圳、南京等核心城市设立分支机构,形成覆盖全国的服务网络,专注于提供基于人工智能、大数据与互联网的综合解决方案。 自2016年成立以来,智合同在知识产权与技术

iH5互动大师专业H5制作工具2000多家知名企业选择

在数字内容创作领域,一款高效且专业的工具往往是品牌与用户建立深度连接的关键。无论是国际巨头如Google、Uber,还是国内领先企业如京东、澎湃新闻,其背后频繁出现的动态、交互式内容,常离不开一类核心技术的支持——H5。目前,已有超过2000家知名品牌借助专业的H5工具进行创意表达,而一个汇聚了十万

高级面试辅导助你成功通过求职面试

面试教练(JobInterviewCoach)是一家致力于提供专业级面试辅导服务的在线平台,其核心使命在于系统化赋能求职者,全面提升面试准备效率与成功率。无论您是即将踏入社会的应届毕业生,还是寻求职业突破的资深职场人,该平台均能通过体系化的工具与个性化服务,助您从容应对求职过程中的关键挑战。 平台官

Huru人工智能视频面试平台助你高效准备求职

在当今竞争激烈的求职市场中,视频面试已成为企业招聘的常见环节。如何系统、高效地准备面试,成为众多求职者关注的焦点。Huru ai 作为一款人工智能驱动的面试准备平台,正通过智能模拟与实时反馈,为求职者提供专业、个性化的面试提升方案。 简而言之,Huru ai 是一个基于 AI 技术的视频面试模拟与辅

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程

热门话题

热门话题