DeepSeek与面壁智能大模型技术路径深度解析

大模型赛道经过两年高速发展,行业格局已呈现清晰分化。当前参与者主要沿着三条路径演进:一部分企业仍聚焦于大规模基座模型的参数竞赛;另一部分在算力约束下转向应用层,加速商业化进程;而第三类探索者,则致力于解决一个更核心的命题——如何在有限资源下,训练出性能更强、效率更高的模型。

如今,即便是追求参数规模的第一类厂商,也在积极寻求高效解决方案。OpenAI推出GPT-4o mini切入轻量级市场,Meta、微软、谷歌、阿里等巨头也纷纷布局Llama 3.1-8B、Phi系列、Gemma 2、Qwen 2.5等小型化模型,便是明证。行业共识在于,算力增长存在物理上限,且参数规模与模型性能并非线性正比关系。若参数倍增带来的能力提升有限,大模型整体发展速度将面临瓶颈。

OpenAI或许能以千亿级参数达到GPT-4的性能,但其他厂商可能需要投入更庞大资源才能勉强追赶。试图单纯依靠堆叠算力与参数来超越GPT-5,对绝大多数玩家而言既不经济,也不现实。因此,深耕应用场景成为许多公司的务实选择。而那些坚守基座模型研发的团队,则将研究重点转向“参数效率”——如何最大化每个参数的价值,这被视为模型训练的终极方向之一。目前,模型参数的潜力远未被充分挖掘。

在“高效训练”这条赛道上,国内创业公司面壁智能与深度求索(DeepSeek)凭借其高效且开源的技术路线迅速崛起,甚至在海外开发者社区也获得了广泛赞誉。《经济学人》杂志曾将二者并称为中国最具创新力的大模型公司。如今,在国内大模型创业生态中,除了备受关注的“六小龙”,面壁与DeepSeek这两支生力军也已强势加入竞争,形成了“6+2”的多元格局。

一个值得关注的现象是,国内的技术突破常先在海外引发热议。DeepSeek去年凭借极具成本优势的DeepSeek-V2一举成名,其最新发布的V3模型更令硅谷技术圈惊叹。面壁智能则曾因MiniCPM-Llama3-V 2.5模型被海外团队套壳抄袭事件引发关注,其后又因其专注端侧设备的独特战略而受到业界重视。两家公司技术实力获得海内外认可,其核心团队均拥有深厚学术背景:面壁核心成员多源自清华大学NLP实验室,DeepSeek也广泛吸纳清华、北大等顶尖高校的杰出人才。

然而,同属“高效”阵营,双方在技术路径与战略聚焦上存在显著差异。

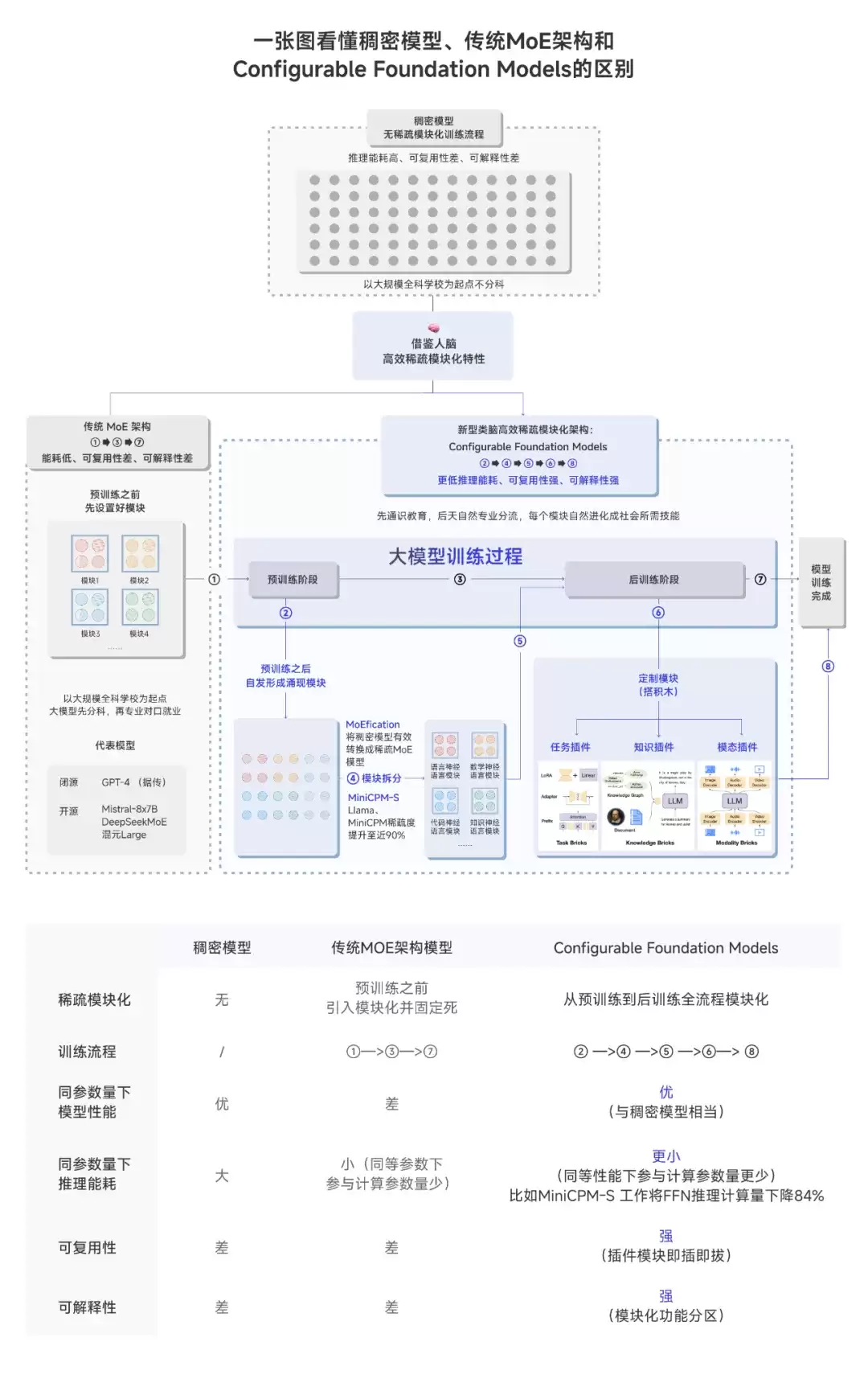

首先,在模型稀疏化方案上,DeepSeek选择了从头训练混合专家模型。对于云端超大规模模型服务,MoE架构确实是当前较优选择,能在扩展参数规模的同时控制计算成本。但MoE对资源受限的端侧设备并不友好。为此,面壁提出了更适配终端设备的稀疏化方案,不仅在MiniCPM-S系列中引入了自研稀疏训练方法,还创新性地提出了“可配置基础模型”这一新型类脑稀疏架构。

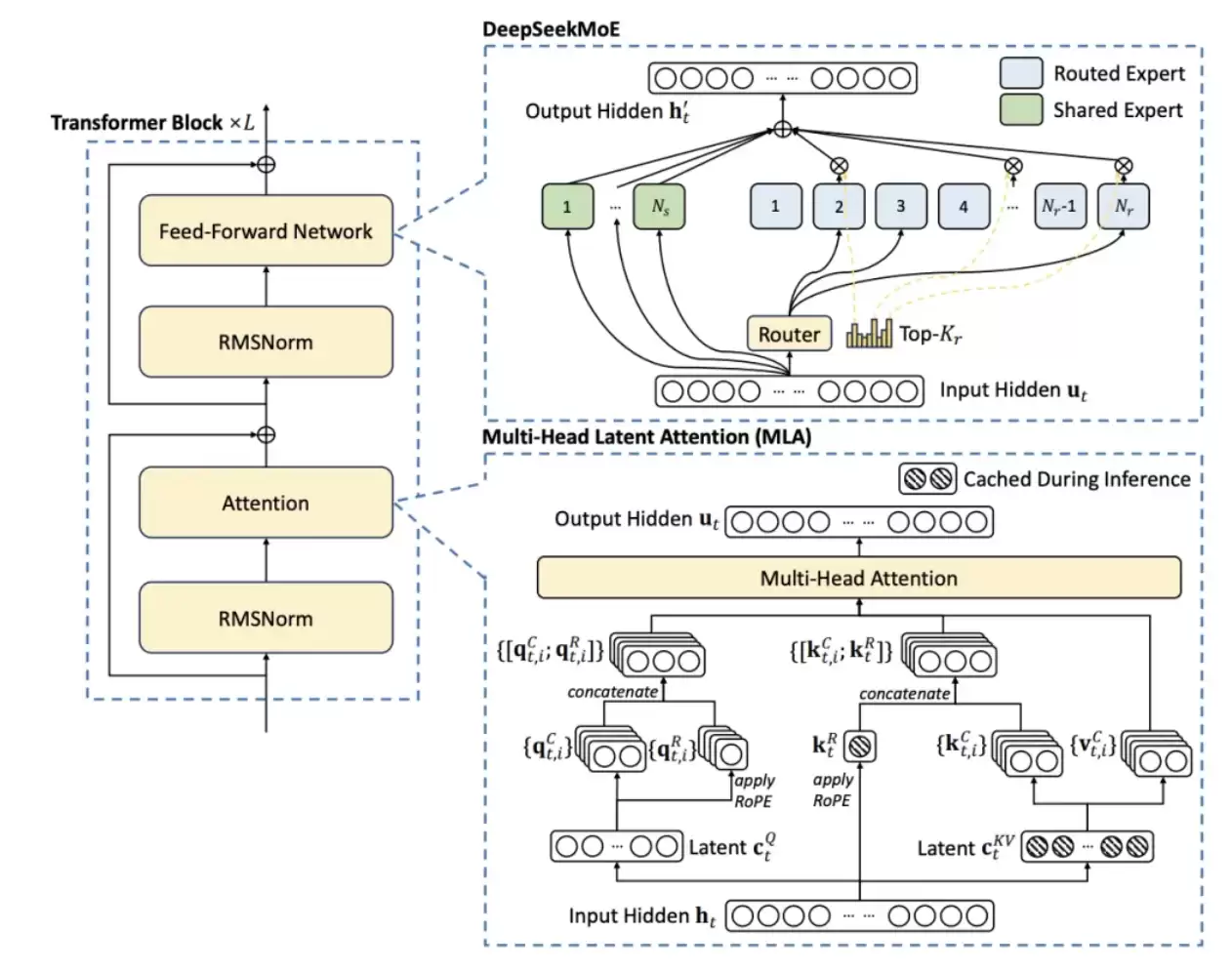

其次,两者的优化目标不同。DeepSeek的高效,是一套高度定制化、面向云端大集群训练与服务的极致技术体系,其MoE与多头潜在注意力技术深度耦合,核心目标是通过云服务最大化处理用户请求。而面壁的优化则聚焦于边缘计算与端侧算力场景,追求在单台设备上实现服务的高效性,推动模型本地化部署与运行。

再次,能力侧重点有所区别。DeepSeek在高效训练领域成就突出,而面壁则在高效推理,尤其是端侧推理方面积累了深厚经验。事实上,高效推理正是模型能否成功部署至手机等终端设备的关键挑战,而这恰恰是面壁早期切入并持续深耕的赛道。

「高效」问题何解?

近日,以“大模型界拼多多”著称的DeepSeek发布了DeepSeek-V3模型。其在多项基准测试中的表现,超越了Qwen2.5-72B和Llama 3.1 405B等开源模型。更引人注目的是其训练效率:仅用2048块H800 GPU就实现了这一性能。作为对比,训练Llama 3 405B消耗了16384块H100。

这再度激发了行业对高效训练的热情。无限制的“烧钱”竞赛并非可持续之道。数据显示,DeepSeek-V3的总训练成本约为557.6万美元,耗时280万GPU小时。而GPT-4o的训练成本据估算高达1亿美元,Llama 3 405B则耗费了3080万GPU小时。

提升基座模型的效率是行业核心命题,而稀疏化技术(如MoE)是主流方向之一。它能在扩大模型参数量的同时,让实际计算量远小于同规模的稠密模型,这在国内算力资源普遍受限的背景下,几乎是必然选择。

DeepSeek选择的路径是从零开始训练MoE模型。这种方式训练难度更大,但能避免一些潜在问题。例如,通过复制现有模型神经元来构建MoE的方法,可能导致专家之间知识重叠、权重冗余,无法充分发挥MoE的潜力。从头训练则自由度更高,有望逼近MoE架构的理论上限。当然,这套方案主要服务于云端。

对于端侧,MoE未必是最佳答案。面壁给出的解题思路是另一种稀疏化方案。去年,面壁在MiniCPM-S系列中引入了自研的稀疏化技术,通过激活函数替换和带约束的稀疏感知训练,能将Llama等模型的稀疏度提升至近90%,在基本保持模型性能的同时显著降低推理开销。相比之下,某些MoE方案可能会对模型效果产生明显影响。

去年底,面壁团队进一步提出了“可配置基础模型”架构。与MoE相比,CFM从更本质的层面覆盖了从预训练到后训练的全过程模块化。它基于一个发现:大模型在预训练中会像人脑一样,自发形成功能分化的神经元模块,分别擅长语言、数学、代码等不同任务,且每次计算只激活相关模块。CFM正是将大模型拆分为预训练产生的“涌现模块”和后训练产生的“定制模块”,使得模型构建可以像搭积木一样,通过模块的检索、组合与更新来实现复杂能力。

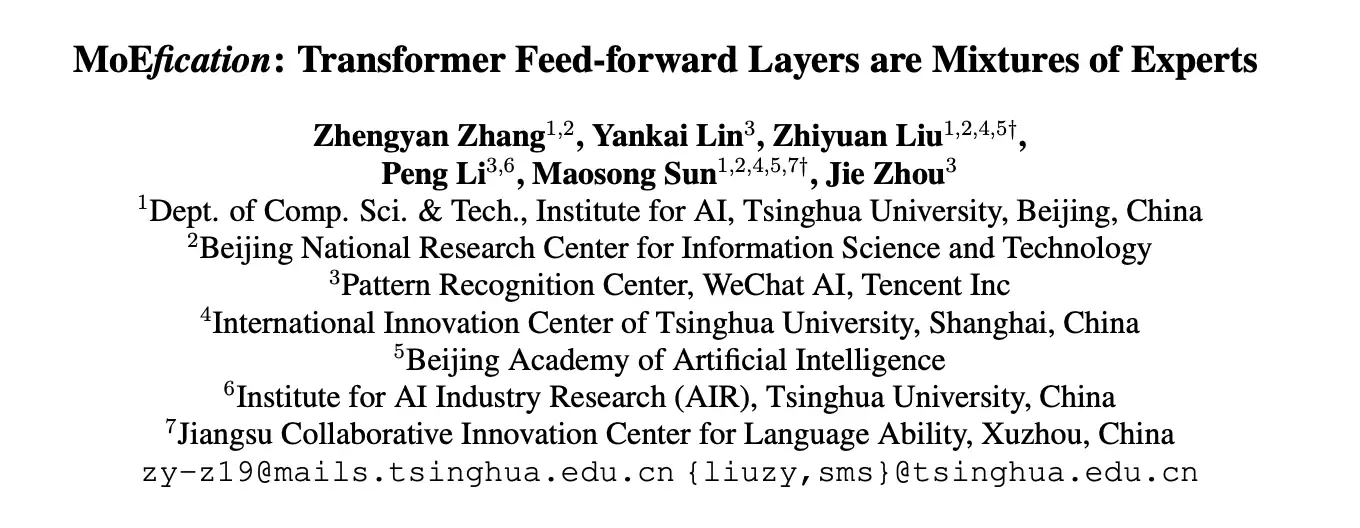

事实上,面壁是国内最早探索稀疏激活技术的团队之一。早在2021年6月,由面壁智能创始人刘知远牵头的“悟道·文源”项目就发布了千亿参数MoE模型CPM-2。同年,团队发表论文《MoEfication》,提出将稠密模型转化为等参数量的MoE模型,同样能实现大幅推理加速,证明了仅使用原模型10%-30%的参数即可保留95%的性能。

刘知远曾表示,创立面壁的初衷就是希望降低大模型的使用门槛。因此,团队早期就致力于降低模型压缩、微调等环节的成本,并始终沿着“降本增效”的路径探索。例如,面壁曾用仅2.4B参数的MiniCPM模型,实现了对标Llama 2 13B模型的性能。这种“以小搏大”的路径证明,当参数潜力被充分激发,小模型通过高效训练完全可能达到更优性能,这也为寻找更大规模模型的最优解提供了思路。

回到两家公司的路径差异。DeepSeek在云端超大规模模型中融合MoE与多头潜在注意力技术,使得模型能以更大的批次处理数据,减少单次请求的实际运算量,从而降低云端API的推理成本。有行业分析指出,其技术体系高度定制化,MoE与MLA及底层基础设施强绑定,整体是针对大集群训练与服务的云端极致优化。

而面壁的优化矛头则指向边端算力场景,追求单设备服务的高效性。其通过训练技术优化提升模型的“知识密度”,让更小的参数战胜更大的模型,并使MiniCPM系列能够直接在手机等终端设备上本地运行。在端侧场景的解决方案上,DeepSeek目前尚未涉足。

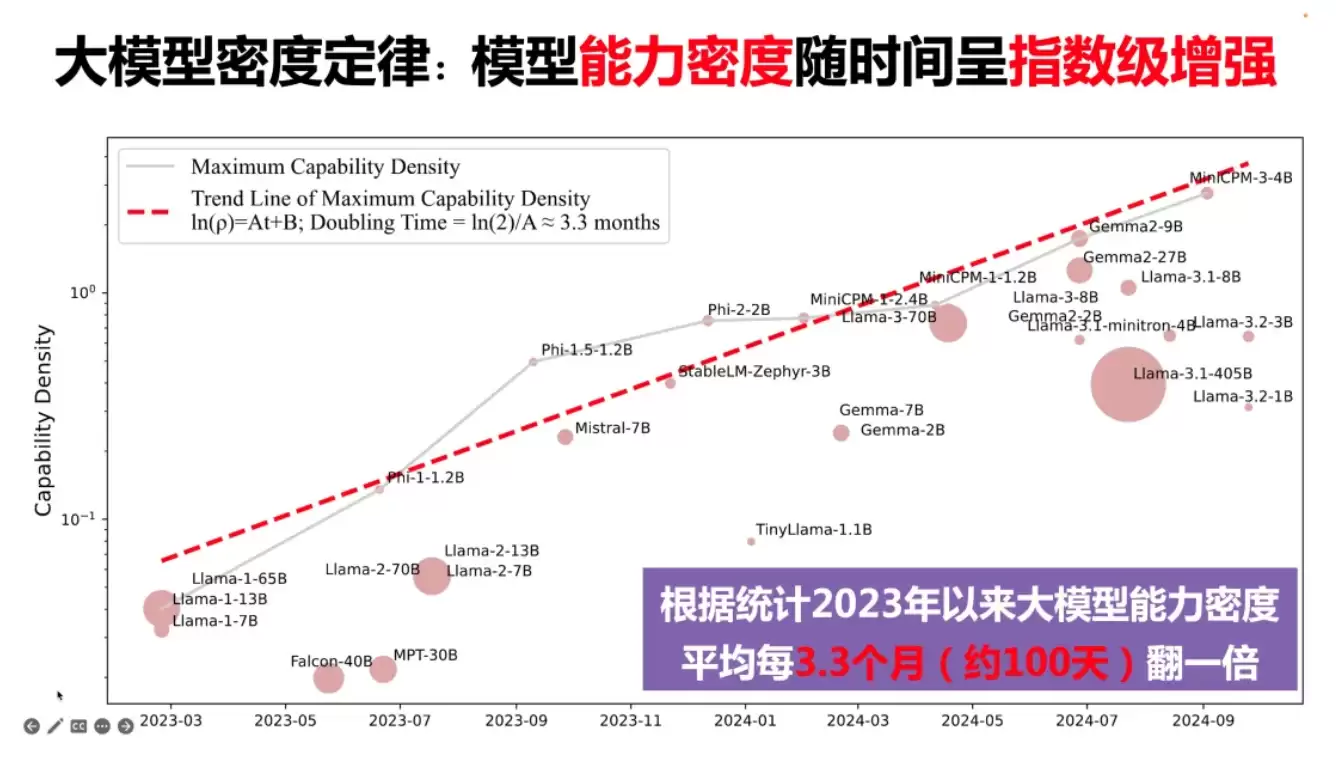

值得一提的是,关于模型性能随规模增长的“缩放定律”正面临数据和算力上限的挑战,甚至被质疑可能失效。面壁团队曾致力于在同等条件下实现更优的缩放曲线,如今则在探索其他规律。刘知远发现,大模型行业存在一种类似“摩尔定律”的现象:随着数据、算力、算法的协同演进,实现特定能力所需的参数规模在快速下降。例如,2020年GPT-3用1750亿参数达到的能力,到2024年初仅需24亿参数即可实现。这意味着模型的“能力密度”在不断提升。

基于此,面壁团队提出了“大模型密度定律”——模型的能力密度随时间呈指数级增长。这里的“能力密度”定义为,达到某个参考模型性能所需的有效参数大小与实际参数大小的比率。根据这一定律,可以推导出多个重要推论:实现相同能力所需的参数规模大约每3.3个月下降一半;模型推理和训练开销随时间迅速下降;模型小型化揭示了端侧智能的巨大潜力;模型存在由密度倍增周期决定的“有效期”等。

端侧如何胜云侧?

这套通过高效优化将模型做小的逻辑,自然而然地指向了端侧部署的广阔前景。从全球算力分布看,OpenAI、谷歌等巨头部署了庞大的云端算力集群,但全球超过80亿台手机中的芯片,构成了一个不可忽视的“长尾”算力池。事实上,手机中很多场景的计算并不都需要上云,本地处理往往是更高效、更可靠的选择。

刘知远对此有一个形象的比喻:明明一个13B模型的能力可以用一个2B的模型来实现,并且能在端侧跑得飞快,何必非要联网、发送请求到云端呢?大模型是计算密集型任务,从可持续发展和实际落地的角度看,端侧算力显然是一片尚未充分释放的蓝海。因此,MiniCPM所代表的端侧高效模型,很可能代表着未来的一个重要方向。毕竟,不是所有需求都需要动用GPT-4级别的能力,很多时候GPT-3级别的模型就已足够。

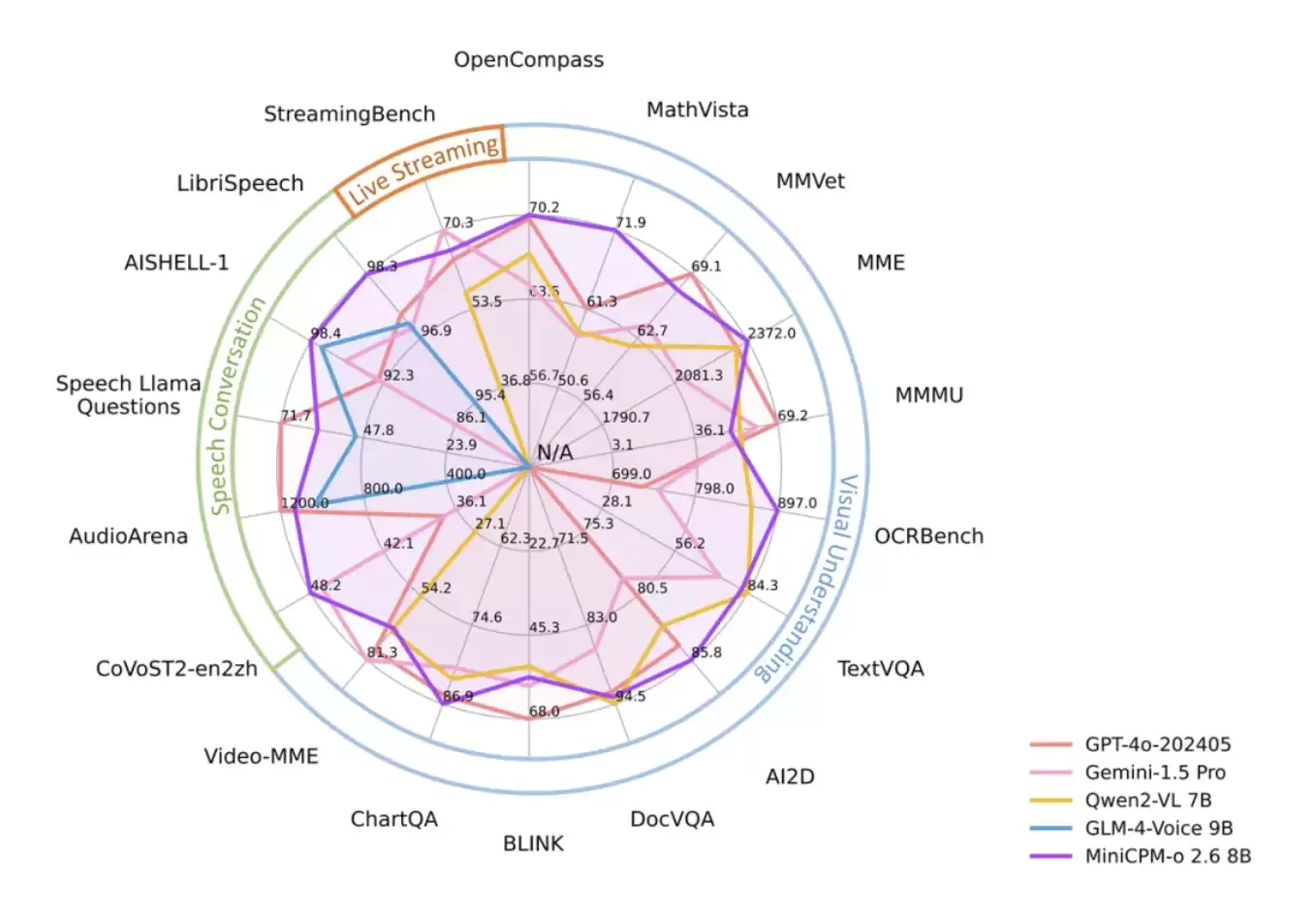

自MiniCPM-V系列开始,面壁便持续聚焦于解决端侧多模态模型的问题。近期,其又推出了全新的MiniCPM-o 2.6模型。据官方介绍,该模型仅80亿参数,不仅在视觉能力上进行了大幅提升,如强大的OCR、可信行为、多语言支持和视频理解,还引入了实时语音对话和多模态直播等新功能。它支持双语实时语音对话,声音可配置,并能实现情绪语速控制、端到端语音克隆、角色扮演等趣味交互,首次支持在iPad等端侧设备上进行多模态直播。

MiniCPM-o 2.6全面对标了GPT-4o的“全模态实时流式视频理解+高级语音对话”能力,支持视频、语音、文本输入及语音、文本输出,并具备了人类级别的低延迟实时交互体验。然而,GPT-4o并未部署在端侧,其网络延迟、服务器带宽及高并发下的可靠性仍是潜在隐忧。

与GPT-4o相比,MiniCPM-o 2.6的一个独特优势在于,它能感知并理解除人声之外的背景音,例如撕纸、倒水、金属碰撞等声音。这一点,目前大多数部署在云端的大模型还难以做到。

此外,面壁特别强调了其“真正”的视频大模型能力。通用人工智能不仅关乎大语言模型,其能力应涵盖推理、记忆、规划以及与外界环境的交互。而交互本质上是多模态的,需要深刻理解图像、视频和声音。

MiniCPM-o 2.6能够持续对实时视频和音频流进行建模,感知用户提问之前的画面和声音,这种方式更贴近人眼的自然视觉交互。相比之下,市场上一些宣称支持实时视频理解的模型或产品,实际上只是在用户提问后才对视频进行静态抽帧分析,无法捕捉提问前的上下文情境,更像是一个“照片大模型”。

实现这些技术突破,背后主要依靠三条路径:一是端到端全模态流式架构,通过模块化设计灵活构建多模态能力,并以端到端方式联合学习,支撑更高的能力上限;二是低延迟模态并发技术,通过时分复用等技术实现流式编码与低延迟响应;三是端到端全模态流式学习,让模型能在视频中观察环境,进行社会角色扮演,为未来驱动具身智能体参与社会活动打下基础。

面壁已将端侧模型的技术迭代推向了新高度。但需要明确的是,将模型做小解决高效性问题只是第一步,小模型并不完全等同于端侧模型。模型要成功部署在终端,硬件的发展同样至关重要。

目前,端侧模型面临内存、功耗、算力三大硬件瓶颈。例如,Apple曾指出,一个70亿参数的半精度模型完全加载到终端需要超过14GB的DRAM空间。Meta也测算过,一部满电约5000焦耳的iPhone,在每秒生成10个token的速度下,仅支持与一个7B模型对话不足2小时。

不过,行业的发展也带来了乐观信号。一方面,终端芯片性能在快速提升,最新芯片已能支持百亿参数模型运行;另一方面,模型训练技术也在进步,两三百亿参数的模型也能达到GPT-3.5的水平。关键问题在于如何将芯片能力与模型训练高效衔接,这需要深度的软硬件协同优化。面壁智能首席研究员韩旭表示,这方面的技术已不是根本障碍,更多是等待产业时机成熟。

务实的理想主义者

当前,不少团队将实现AGI作为终极目标或核心卖点。但就像计算机的发展史一样,造出更强大的计算机固然重要,而让计算机变得廉价、普及,从而让整个社会受益,则需要兼顾应用与普惠。面壁所做的,正是贡献这其中的一部分。

面壁对AGI的看法,更像是一群“务实的理想主义者”。他们认为,AI最终是服务于人的工具。从计算机科学的视角看,AI的目标是让计算机更智能、更具理解能力。思考如何让AI更高效,从而将人从重复性劳动中解放出来,才是更值得关注的问题。

在刘知远看来,如果按照OpenAI的规划,五年内实现超级智能,仍有太多关键问题亟待解决,“缩放预测”是其中之一,“超级对齐”更是核心挑战——即当模型在某个任务上超越人类后,如何确保其继续安全、可控地提升。而一味追赶GPT-4或许只是一个参考,跟随OpenAI不一定是最正确的选择。面壁在未来不会局限于单一的“缩放定律”,更不会把某个单一问题视为全部。换言之,实现AGI必须坚持自身独特的技术路线与价值思考。

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

网易CodeWave人工智能开发平台重塑企业智能研发流程

2025年10月14日,网易CodeWave在主题沟通会上重磅发布了“用AI重构研发方式”的战略愿景。会上,一系列全新的智能开发能力正式亮相,旨在实现从需求分析、产品设计到代码开发、部署运维及迭代优化的全流程智能化赋能。这不仅是开发工具的升级,更代表了企业级软件开发范式的深刻演进。作为专注于企业级市

汪军与Rich Sutton对话:大模型是否偏离了智能本质的探索

在刚刚落幕的RL China 2025开幕式上,一场跨越地域的思想对话备受瞩目。伦敦大学学院的汪军教授与图灵奖得主、被誉为“强化学习之父”的Richard Sutton,从学科根基出发,共同探讨了智能的本质与未来方向。这场对话,不仅关乎技术路径,更触及了人工智能研究的初心与使命。 作为强化学习领域的

高德地图AI应跳出传统竞争思维专注创新

高德进军到店业务的消息,近期在行业内引发了广泛关注。昨日,官方正式揭晓答案——并非重启口碑业务,而是推出了“高德扫街榜”。虽然方向已明,但随之而来的疑问却更多了。 过去数月,外卖市场的补贴竞争异常激烈。如今高德加码本地生活服务,是否意味着新一轮补贴大战即将开启?十年前,美团在团购领域脱颖而出,如今阿

Win11任务栏位置自定义设置与文件搜索效率优化指南

微软向Windows预览体验计划成员推送了Win11系统的新一轮更新,重点改进了任务栏的个性化设置与搜索功能。用户现在可以自由将任务栏放置在屏幕的上下左右任意一边,并可选更紧凑的“小任务栏”模式以节省屏幕空间。同时,系统搜索框的逻辑得到优化,在用户查找内容时,会优先显示高度匹配的本地文件和应用程序,

开发者如何抓住GDC千亿商机与财富机遇

人工智能创业者Steven回顾艰辛历程,从技术理想转向现实挑战,面临融资与团队生存压力。全球开发者先锋大会汇聚顶尖投资机构,提供项目路演与资本对接平台,成为其寻求突破的关键机遇。大会旨在探索大模型产业化落地,推动商业闭环,助力开发者实现价值。

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程

热门话题

热门话题