谷歌TPU 8i如何以差异化策略挑战英伟达市场地位

在拉斯维加斯举行的Google Cloud Next大会上,谷歌高级副总裁Amin Vahdat揭晓了其AI芯片战略的重大演进:首次明确区分了训练与推理两大核心任务,并同步推出了专为各自优化的TPU 8t与TPU 8i芯片。这标志着谷歌TPU产品线进入了精细化分工的新纪元。

“随着AI智能体(Agentic AI)的崛起,我们认为开发者社区将受益于针对训练和服务(推理)需求分别优化的专用芯片。”Amin Vahdat在官方博客中阐述道。这一决策清晰地传递出一个信号:AI算力市场正从通用化走向专业化,以满足下一代AI应用对效率与成本的极致要求。

此次“分家”策略中,专注于推理任务的TPU 8i成为了业界关注的焦点,它被视为谷歌抢占即将爆发的AI智能体时代商业机会的关键筹码。

TPU为什么要分家

谷歌为何要将芯片设计一分为二?核心驱动力在于提升整体效率与经济效益。

AI模型的训练与推理,虽同属计算范畴,但负载特性截然不同。训练过程如同让模型进行高强度、长周期的“深度学习”,追求极致的计算吞吐量与精度,以“大力出奇迹”的方式锻造模型能力。推理过程则如同模型“上岗工作”,需要以极低的延迟、高并发地处理海量实时请求,核心诉求是响应速度快、单次成本低、能效比高。

在AI发展早期,模型规模与应用场景相对有限,采用统一架构兼顾两者尚可平衡研发与使用成本。然而,随着AI智能体时代的到来,这种平衡被打破。智能体能够自主执行复杂任务链,其产生的推理请求量呈指数级增长,对芯片的实时处理能力与成本控制提出了前所未有的挑战。

企业的成本焦虑正从高昂的训练费用,快速转向更为持续的推理开销。从经济学角度看,专为训练设计的芯片通常搭载昂贵的高带宽内存(HBM),其成本占比极高。若用此类芯片处理智能体高频、海量的推理事务,无异于“杀鸡用牛刀”,将导致企业运营成本失控,阻碍AI应用的规模化落地。

“规模化商业化的关键在于,如何在实现最低响应延迟的同时,将每笔交易的成本降至最低。交易量正在激增,而单次成本必须大幅下降。”谷歌云人工智能与计算基础架构副总裁Mark Lohmeyer一语道破天机。

因此,谷歌选择了彻底的架构分离策略。

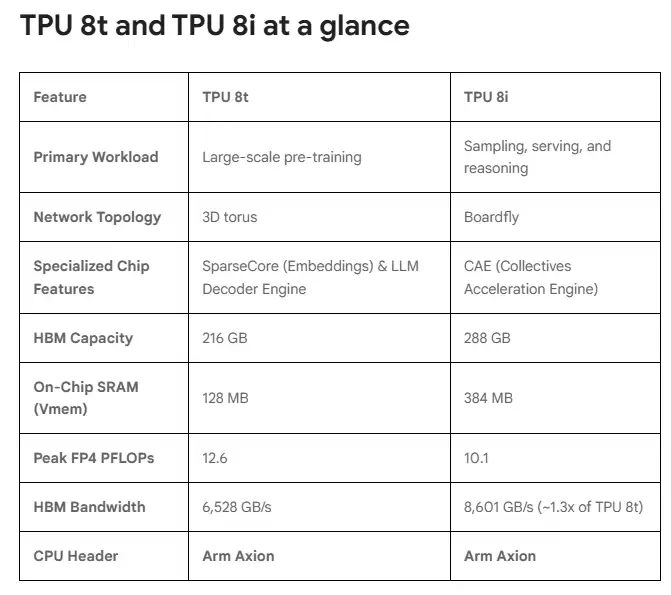

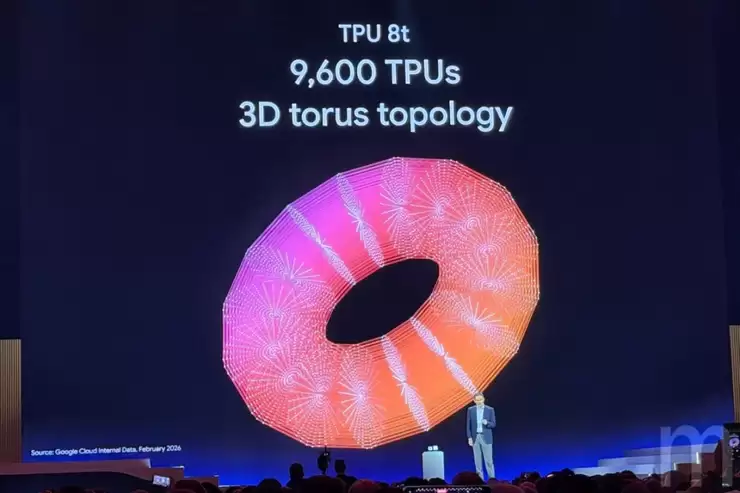

首先是面向训练的“算力巨兽”TPU 8t。其单个超级模块集成了9600颗芯片,提供高达121 exaflops的算力与2PB共享内存,计算性能较前代提升近3倍。全新的Virgo横向扩展架构支持超百万颗TPU芯片组成单一集群,有望将前沿大模型的训练周期从数月缩短至数周。在数据中心电力成为核心瓶颈的背景下,其能效表现尤为突出,实现了性能与每瓦性能的显著跃升。

其次是专攻推理的“成本杀手”TPU 8i。其设计直指推理瓶颈:首先,大幅强化了芯片的片上SRAM(静态随机存储器),容量提升至3倍。这使得芯片能够快速缓存关键数据,减少频繁访问外部HBM的延迟与功耗,有效缓解了AI推理中的“内存墙”问题。结合288GB的大容量HBM,TPU 8i能够流畅处理复杂的多步推理任务。

能效是TPU 8i的另一大杀手锏。其能效比较上一代提升117%,意味着在同等电力消耗下,可支持近乎翻倍的推理服务量。这为AI智能体的大规模、高频率部署提供了坚实的成本基础。行业分析预测,到2026年,近40%的企业应用将嵌入AI智能体,由此催生的市场规模巨大。谷歌的芯片分工战略,正是为了抢占这一未来市场的制高点。

Meta、Anthropic站台,新的算力联盟浮现?

谷歌对算力分工趋势的判断,迅速获得了市场重量级玩家的认可。Meta与Anthropic这两家AI巨头率先宣布成为TPU v8平台的首批重要客户。

AI明星公司Anthropic的联合创始人兼CEO Dario Amodei通过视频确认,其下一代核心模型的早期开发已在TPU 8t集群上运行数月。更为关键的是,Anthropic与谷歌达成了深度合作,计划在未来数年持续采购吉瓦级别的TPU算力,以保障其模型服务能力的弹性扩展。

这种合作超越了简单的硬件采购,形成了深度的“软硬协同”优化。谷歌TPU的光学互联技术与Anthropic模型采用的混合专家(MoE)架构进行了底层适配,从而显著降低了单次推理的Token成本。对Anthropic而言,这增强了其商业产品的成本竞争力;对谷歌而言,这获得了顶尖AI公司的实战验证与生态背书。

几乎同期,Meta被曝与谷歌签署了价值数十亿美元、为期多年的TPU使用协议,此消息一度引发英伟达股价波动。这并非意味着一个纯粹的“反英伟达联盟”成立,而更多是巨头们出于供应链安全与成本优化的“务实选择”。对于Meta和Anthropic而言,在依赖英伟达GPU的同时,引入谷歌TPU作为第二算力来源,能有效分散风险、增强议价能力。

谷歌的算力生意,本质是云生态的入口之争。TPU并不单独出售,而是作为Google Cloud的服务提供。客户使用TPU,往往会逐步融入谷歌的全栈AI云平台,从数据、训练、部署到应用集成。摩根士丹利分析指出,TPU产能的持续扩张将为谷歌带来可观的增量收入,并巩固其在AI云服务市场的地位。

老黄危机?英伟达“泥潭式”护城河

那么,谷歌的双芯片战略是否意味着英伟达的统治地位面临危机?目前来看,结论为时尚早。

谷歌与英伟达的关系呈现竞合交织的态势。在发布TPU 8i的同时,谷歌云明确表示其与英伟达的最新GPU平台是“互补”关系,并持续推进双方在软件与网络层面的合作。

英伟达构筑的护城河异常深厚。首先是以CUDA为核心的软件生态壁垒。全球数百万开发者基于CUDA构建应用,这种巨大的迁移成本构成了强大的用户锁定效应。其次是其惊人的迭代速度,通过垂直整合,其系统性能以远超行业平均水平的速度提升。此外,英伟达通过收购与自研,构建了从GPU、网络(InfiniBand)到软件(AI Enterprise)的完整基础设施栈,形成了封闭而高效的协同体系。

因此,谷歌TPU 8i采取的是一种“差异化切入”的战术。它并不寻求在训练市场全面替代英伟达GPU,而是瞄准了智能体时代爆发的推理市场,主打极致的成本与能效优势。对于那些对推理成本极度敏感、需要处理海量交互的企业客户而言,TPU 8i提供了一个极具吸引力的替代方案。简言之,在“炼模型”的主战场,英伟达地位稳固;但在“跑应用”的广阔腹地,谷歌正试图用TPU 8i切下最丰厚的一块蛋糕。

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

8G显存大模型硬件配置指南与可运行模型推荐

想在本地部署大语言模型,但只有一张8GB显存的显卡?这完全可行。关键在于精准选择模型与量化方案,在有限的硬件资源下实现最优性能。本文将为您详细解析适配8G显存的各类主流模型及其具体部署运行方案。 一、4-bit量化模型部署指南 对于RTX 3060、RTX 4060等主流消费级显卡,4-bit量化是

Canva证书制作教程:培训结业奖状DIY模板免费下载

制作一份兼具专业质感与视觉美感的证书,其实可以非常高效。借助Canva可画这类在线设计平台,即便是零基础的新手,也能轻松完成从模板挑选到成品导出的全流程。接下来,我们将详细解析使用Canva可画制作专业级证书的五个关键步骤。 一、选用专业证书模板 好的开始是成功的一半。在Canva可画,第一步变得异

Perplexity Pages页面不被收录如何检查Robots与SEO设置

许多用户在通过Perplexity Pages发布内容后,常常遇到一个关键问题:页面已经成功发布,但在Google、Bing等主流搜索引擎中却无法被搜索到。这通常并非搜索引擎的延迟,而是页面在技术配置或SEO设置上存在障碍,导致爬虫无法顺利抓取和索引。 简单来说,导致页面无法被收录的核心原因通常集中

Harness 是 AI Agent 的未来还是辅助工具

Harness,作为AI工程化进程中的关键组件,正成为提升大模型实际效能的核心手段。它要解决的核心痛点,是“模型具备潜力,但输出不稳定”。在当前阶段,Harness不可或缺,它能让能力尚不完善的模型可靠地投入生产环境。这好比一副可靠的支架——在腿部力量完全恢复之前,它是行走的必备支持。 近期GitH

千问AI数学解题能力实测 辅导作业实用指南

辅导孩子数学作业时遇到难题怎么办?别担心,现在有一位聪明的“AI家教”可以随时求助——千问AI。它不仅能提供详细的解题步骤,还能解析核心概念、梳理知识脉络,让数学学习过程更加清晰高效。关键在于,你需要掌握与它高效沟通的方法。 一、输入完整题目并明确需求 想要获得AI的精准解答,首先必须提供清晰的“问

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程

热门话题

热门话题