如何使用Hugging Face的Transformer库 Hugging Face模型加载与推理教程

使用hugging face的transformer库的关键步骤包括安装依赖、加载模型、处理输入和执行推理。1. 安装transformers和torch,建议用虚拟环境并优先学习pytorch;2. 用autotokenizer和automodelforxxx加载模型,注意任务类型匹配;3. 使用分词器编码文本并转为张量输入模型,通过softmax获取类别概率;4. 初学者可用pipeline简化操作,支持多种任务但灵活性较低。掌握这些步骤后即可在多数场景中应用。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

如果你刚接触Hugging Face的Transformer库,可能会觉得它功能强大但不知从何下手。其实,只要掌握几个核心步骤——加载模型、处理输入、执行推理——你就能快速上手使用各种预训练模型了。

1. 安装与环境准备

1. 安装与环境准备在开始之前,确保你的环境中已经安装了transformers和torch(或者tensorflow,根据你使用的框架)。

pip install transformers torch登录后复制

如果你打算用GPU加速推理,还需要安装对应的PyTorch版本或其他框架支持。这一步看似简单,但很多新手会忽略CUDA版本和依赖的匹配问题。

建议:

使用虚拟环境管理依赖,比如conda或venv如果不确定用哪个框架,推荐先学PyTorch,因为大多数教程和社区资源都基于它2. 加载预训练模型和分词器

使用虚拟环境管理依赖,比如conda或venv如果不确定用哪个框架,推荐先学PyTorch,因为大多数教程和社区资源都基于它2. 加载预训练模型和分词器Hugging Face提供了非常方便的接口来加载模型和对应的分词器。你只需要知道模型的名字,例如bert-base-uncased,就可以直接调用:

from transformers import AutoTokenizer, AutoModelForSequenceClassificationtokenizer = AutoTokenizer.from_pretrained("bert-base-uncased")model = AutoModelForSequenceClassification.from_pretrained("textattack/bert-base-uncased-imdb")登录后复制说明:

AutoTokenizer 和 AutoModelForXXX 是自动识别模型结构的通用类模型名称可以是最新支持的,也可以是你自己下载或上传到Hugging Face Hub的模型注意:有些模型需要指定任务类型,比如分类、生成、问答等,这时候不能直接使用AutoModel,而要选择具体类。

3. 处理输入并进行推理加载好模型后,下一步就是把原始文本转换成模型能理解的输入格式。通常流程如下:

使用分词器对文本进行编码将结果转为张量(tensor)输入模型获取输出示例代码如下:

inputs = tokenizer("I really enjoyed this movie!", return_tensors="pt")outputs = model(**inputs)logits = outputs.logits登录后复制关键点:

return_tensors="pt" 表示返回PyTorch张量输出的结果通常是logits,你需要通过argmax或softmax转换成实际类别如果你想获得更直观的结果,可以用下面的方法:

import torch.nn.functional as Fprobs = F.softmax(logits, dim=1)print(probs.detach().numpy())登录后复制

这样你可以看到每个类别的预测概率。

4. 使用Pipeline简化操作(适合初学者)如果你不想手动处理那么多细节,Hugging Face还提供了一个高级API——pipeline,它封装了模型加载、数据处理和推理过程。

例如,做一个情感分析:

from transformers import pipelineclassifier = pipeline("sentiment-analysis", model="textattack/bert-base-uncased-imdb")result = classifier("This film was amazing and I loved it!")print(result)# 输出:[{'label': 'POSITIVE', 'score': 0.9998}]登录后复制优势:

快速实现常见任务代码简洁易懂内置支持多种任务,如翻译、摘要、NER等缺点:

灵活性不如手动控制不太适合做定制化开发基本上就这些内容了。掌握了模型加载、输入处理、推理流程以及Pipeline的使用,你已经可以在大多数场景下使用Hugging Face的Transformer库完成任务了。虽然看起来步骤不多,但每一步都有容易出错的地方,比如模型版本不一致、输入格式错误等,多练习几次就能熟练应对。

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

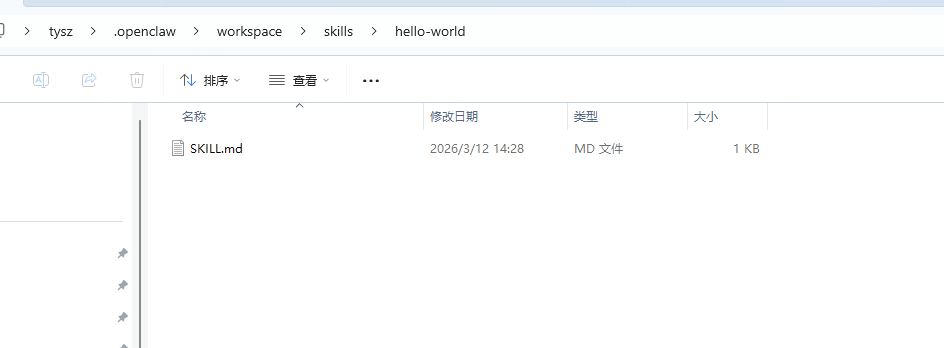

OpenClaw如何自定义SKILL

1 Skills机制概述 提起OpenClaw的Skills机制,不少人可能会把它想象成传统意义上的可执行插件。其实,它的内涵要更精妙一些。 简单说,Skills本质上是一套基于提示驱动的能力扩展机制。它并不是一个可以独立“跑”起来的程序模块,而是通过一份结构化描述文件(核心就是那个SKILL m

OpenClaw 是什么?OpenClaw 详细使用教程及中转 API 优缺点

OpenClaw 是什么?OpenClaw 详细使用教程及中转 API 优缺点分析 最近,圈子里的讨论热度明显聚焦在一个词上:OpenClaw。无论是开发者,还是正在推进AI项目的团队,都在打听它。这工具到底是什么?能解决什么问题?配上那些中转Token,真的就高枕无忧了吗?今天,我们就来把这事儿掰

OpenClaw教程(八)—— 为OpenClaw打造记忆系统

上一篇我们探讨了OpenClaw的自动化能力,今天的话题,可以说是一个AI助手能否真正“进化”的关键——如何为它构建一套有效的记忆系统。 随着助手能力的不断扩展,它每天处理的事务会越来越多,产生的信息量也会急剧增长:例行检查、异常发现、你下达的各种指令……如果没有记忆,每次唤醒它都如同面对一张白纸,

OpenClaw创建 Skills

SKLL md 在构建AI助手自定义技能的过程中,一个基础的“打招呼”功能看似简单,却是理解整套开发流程的绝佳入口。这个名为 hello_world 的技能模板,完整展示了一个规范的技能描述文件应如何构成,是所有复杂功能开发的基石。 ---name: hello_worlddescription:

让 AI 替你叫车,哈啰顺风车上线出行行业首个 MCP 服务

让 AI 替你叫车:哈啰顺风车上线出行行业首个 MCP 服务 4月3日,哈啰顺风车推出一项业内瞩目的创新举措:正式上线名为MCP的新型服务。通俗来讲,这项服务将顺风车从寻找车主、智能匹配到最终下单支付的完整流程能力,封装成了一套标准化的技术接口,直接向各类大语言模型和AI智能体开放调用权限。 这一变

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程