一文读懂图卷积神经网络(GCN)

本文围绕经典论文介绍GCN,解释其定义,即处理图结构数据的网络,输入为带特征的图,输出为节点特征。解析核心公式,通过添加自环、对称归一化邻接矩阵解决信息丢失和尺度问题,还提及在Cora数据集上的应用及数学证明参考。

GCN 学习

本文讲的GCN理论知识来源于论文:

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

SEMI-SUPERVISED CLASSIFICATION WITH GRAPH CONVOLUTIONAL NETWORKS

这是在GCN领域最经典的论文之一

1. 什么是GCN

GCN结构图

我们可以根据这个GCN的图看到,一个拥有 C 个input channel的graph作为输入,经过中间的hidden layers,得到 F 个 output channel的输出。

图卷积网络主要可以由两个级别的作用变换组成:

注意本文讲的图都特指无向无权重的图。

graph level:node level:例如说通过引入一些形式的pooling 操作. 然后改变图的结构。但是本次讲过GCN并没有进行这个级别的操作。所以看到上图我们的网络结构的输出和输出的graph的结构是一样的。

通常说node level的作用是不改变graph的结构的,仅通过对graph的特征/信号(特征信号 X 作为输入:一个 N∗D 矩阵( N: 输入图的nodes的个数, D 输入的特征维度) ,得到输出 Z:一个 N∗F 的矩阵( F 输出的特征维度)。

a) 一个特征描述(feature description) xi : 指的是每个节点 i 的特征表示

b) 每一个graph 的结构都可以通过邻接矩阵 A 表示(或者其他根据它推导的矩阵)

举例:

我们可以很容易的根据一个邻接矩阵重构出一个graph。 例如下图: G=(V,E) 其中 V 代表节点, E 代表边

根据图,我们就可以得出下面的维度图和邻接矩阵

论文公式提出

因为 A 可以确定唯一的一张图,这么重要的一个属性我们肯定是要把他放到神经网络传递函数里面去的,所以网络中间的每一个隐藏层可以写成以下的非线性函数:

其中输入层 H(0)=X , 输出层 H(L)=Z , L 是层数。 不同的GCN模型,采用不同 f(⋅,⋅)函数。

上面是我们理想中的函数的形式,论文中最终推导出来的函数是这样的:

论文公式逐步解析

每一个节点下一层的信息是由前一层本身的信息以及相邻的节点的信息加权加和得到,然后再经过线性变换 W 以及非线性变换 σ() 。

我们一步一步分解,我们要定义一个简单的f(H(l),A) 函数,作为基础的网络层。

可以很容易的采用最简单的层级传导(layer-wise propagation)规则:

f(H(l),A)=σ(AH(l)W(l))

我们直接将 AH 做矩阵相乘,然后再通过一个权重矩阵 W(l)做线性变换,之后再经过非线性激活函数 σ(⋅) , 比如说 ReLU,最后得到下一层的输入 Hl+1 。

In [ ]import paddleA = paddle.to_tensor([ [0,1,0,0,1,0], [1,0,1,0,1,0], [0,1,0,1,0,0], [0,0,1,0,1,1], [1,1,0,1,0,0], [0,0,0,1,0,0]],dtype='float32')print(A)H_0 = paddle.to_tensor([[1],[2],[3],[4],[5],[6]],dtype='float32')print(H_0)x = paddle.matmul(A,H_0)print(x)登录后复制

Tensor(shape=[6, 6], dtype=float32, place=CUDAPlace(0), stop_gradient=True, [[0., 1., 0., 0., 1., 0.], [1., 0., 1., 0., 1., 0.], [0., 1., 0., 1., 0., 0.], [0., 0., 1., 0., 1., 1.], [1., 1., 0., 1., 0., 0.], [0., 0., 0., 1., 0., 0.]])Tensor(shape=[6, 1], dtype=float32, place=CUDAPlace(0), stop_gradient=True, [[1.], [2.], [3.], [4.], [5.], [6.]])Tensor(shape=[6, 1], dtype=float32, place=CUDAPlace(0), stop_gradient=True, [[7. ], [9. ], [6. ], [14.], [7. ], [4. ]])登录后复制

从上面输出可以看的出来:每个值保留了相邻节点的值

输入层的 x1=[1] , 根据矩阵的运算公式我们可以很容易地得到下一层的该节点的表示 X1′=[7], 也很容易发现 X1′(1)=x2+x5,而 x2,x5就是节点1的相邻节点。

就是可以看图:

[1] = 2 + 5

[2] = 1+ 3 + 5

······

[6] = 4

所以我们 AH 就是快速将相邻的节点的信息相加得到自己下一层的输入。

但是这样就出现了新的问题:

问题一

我们虽然获得了周围节点的信息了,但是自己本身的信息却没了

解决方案:

对每个节点手动增加一条self-loop 到每一个节点,即 A=A+I

其中 I是单位矩阵identity matrix。

问题二

从上面的结果也可以看出,在经过一次的AH 矩阵变换后,得到的输出会变大,即特征向量 X 的scale会改变,在经过多层的变化之后,将和输入的scale差距越来越大。

解决方案:

可以将邻接矩阵 A 做归一化使得最后的每一行的加和为1,使得 AH 获得的是weighted sum。

我们可以将 A 的每一行除以行的和,这就可以得到normalized的 A 。而其中每一行的和,就是每个节点的度degree。

用矩阵表示则为: A=D−1A ,对于Aij=diAij

代码展示:

In [8]import paddleimport numpy as npA = paddle.to_tensor([ [0,1,0,0,1,0], [1,0,1,0,1,0], [0,1,0,1,0,0], [0,0,1,0,1,1], [1,1,0,1,0,0], [0,0,0,1,0,0]],dtype='float32')print(A)D = paddle.to_tensor([ [2,0,0,0,0,0], [0,3,0,0,0,0], [0,0,2,0,0,0], [0,0,0,3,0,0], [0,0,0,0,3,0], [0,0,0,0,0,1]], dtype='float32')print(D)# 防止为0时取倒数变成无穷大D[D==0] = D.max() + 1e100DD = paddle.reciprocal(D)print(DD)hat_A = paddle.matmul(DD,A)print(hat_A)登录后复制

Tensor(shape=[6, 6], dtype=float32, place=CUDAPlace(0), stop_gradient=True, [[0., 1., 0., 0., 1., 0.], [1., 0., 1., 0., 1., 0.], [0., 1., 0., 1., 0., 0.], [0., 0., 1., 0., 1., 1.], [1., 1., 0., 1., 0., 0.], [0., 0., 0., 1., 0., 0.]])Tensor(shape=[6, 6], dtype=float32, place=CUDAPlace(0), stop_gradient=True, [[2., 0., 0., 0., 0., 0.], [0., 3., 0., 0., 0., 0.], [0., 0., 2., 0., 0., 0.], [0., 0., 0., 3., 0., 0.], [0., 0., 0., 0., 3., 0.], [0., 0., 0., 0., 0., 1.]])Tensor(shape=[6, 6], dtype=float32, place=CUDAPlace(0), stop_gradient=True, [[0.50000000, 0. , 0. , 0. , 0. , 0. ], [0. , 0.33333334, 0. , 0. , 0. , 0. ], [0. , 0. , 0.50000000, 0. , 0. , 0. ], [0. , 0. , 0. , 0.33333334, 0. , 0. ], [0. , 0. , 0. , 0. , 0.33333334, 0. ], [0. , 0. , 0. , 0. , 0. , 1. ]])Tensor(shape=[6, 6], dtype=float32, place=CUDAPlace(0), stop_gradient=True, [[0. , 0.50000000, 0. , 0. , 0.50000000, 0. ], [0.33333334, 0. , 0.33333334, 0. , 0.33333334, 0. ], [0. , 0.50000000, 0. , 0.50000000, 0. , 0. ], [0. , 0. , 0.33333334, 0. , 0.33333334, 0.33333334], [0.33333334, 0.33333334, 0. , 0.33333334, 0. , 0. ], [0. , 0. , 0. , 1. , 0. , 0. ]])登录后复制

但是在实际运用中采用的是对称的normalization:

用矩阵表示则为:

A=D−21AD−21

对于Aij=didjAij

这其实是跟Laplacian Matrix 有关,拉普拉斯算子是这样的:

L=IN−D−21AD−21

In [9]import paddleimport numpy as npA = paddle.to_tensor([ [0,1,0,0,1,0], [1,0,1,0,1,0], [0,1,0,1,0,0], [0,0,1,0,1,1], [1,1,0,1,0,0], [0,0,0,1,0,0]],dtype='float32')print(A)D = paddle.to_tensor([ [2,0,0,0,0,0], [0,3,0,0,0,0], [0,0,2,0,0,0], [0,0,0,3,0,0], [0,0,0,0,3,0], [0,0,0,0,0,1]], dtype='float32')print(D)# 取逆D[D==0] = D.max() + 1e100DD = paddle.reciprocal(D)print(DD)# 开方_DD = paddle.sqrt(DD)# 求积hat_A = paddle.matmul(paddle.matmul(_DD,A),_DD)print(hat_A)登录后复制

Tensor(shape=[6, 6], dtype=float32, place=CUDAPlace(0), stop_gradient=True, [[0., 1., 0., 0., 1., 0.], [1., 0., 1., 0., 1., 0.], [0., 1., 0., 1., 0., 0.], [0., 0., 1., 0., 1., 1.], [1., 1., 0., 1., 0., 0.], [0., 0., 0., 1., 0., 0.]])Tensor(shape=[6, 6], dtype=float32, place=CUDAPlace(0), stop_gradient=True, [[2., 0., 0., 0., 0., 0.], [0., 3., 0., 0., 0., 0.], [0., 0., 2., 0., 0., 0.], [0., 0., 0., 3., 0., 0.], [0., 0., 0., 0., 3., 0.], [0., 0., 0., 0., 0., 1.]])Tensor(shape=[6, 6], dtype=float32, place=CUDAPlace(0), stop_gradient=True, [[0.50000000, 0. , 0. , 0. , 0. , 0. ], [0. , 0.33333334, 0. , 0. , 0. , 0. ], [0. , 0. , 0.50000000, 0. , 0. , 0. ], [0. , 0. , 0. , 0.33333334, 0. , 0. ], [0. , 0. , 0. , 0. , 0.33333334, 0. ], [0. , 0. , 0. , 0. , 0. , 1. ]])Tensor(shape=[6, 6], dtype=float32, place=CUDAPlace(0), stop_gradient=True, [[0. , 0.40824828, 0. , 0. , 0.40824828, 0. ], [0.40824828, 0. , 0.40824828, 0. , 0.33333331, 0. ], [0. , 0.40824828, 0. , 0.40824828, 0. , 0. ], [0. , 0. , 0.40824828, 0. , 0.33333331, 0.57735026], [0.40824828, 0.33333331, 0. , 0.33333331, 0. , 0. ], [0. , 0. , 0. , 0.57735026, 0. , 0. ]])登录后复制

A0,1=d0d1A0,1=231=0.4082

把这两个tricks结合起来,我们就可以原文的公式:

其中 A=A+I , D 是 A 的degree matrix。 而 D−21AD−21 是对 A 做了一个对称的归一化。

在Cora数据集上训练的两层GCN的隐藏层激活的可视化效果如下:

2. 数学证明:

附上参考的视频:

https://www.bilibili.com/video/BV1Vw411R7Fj

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

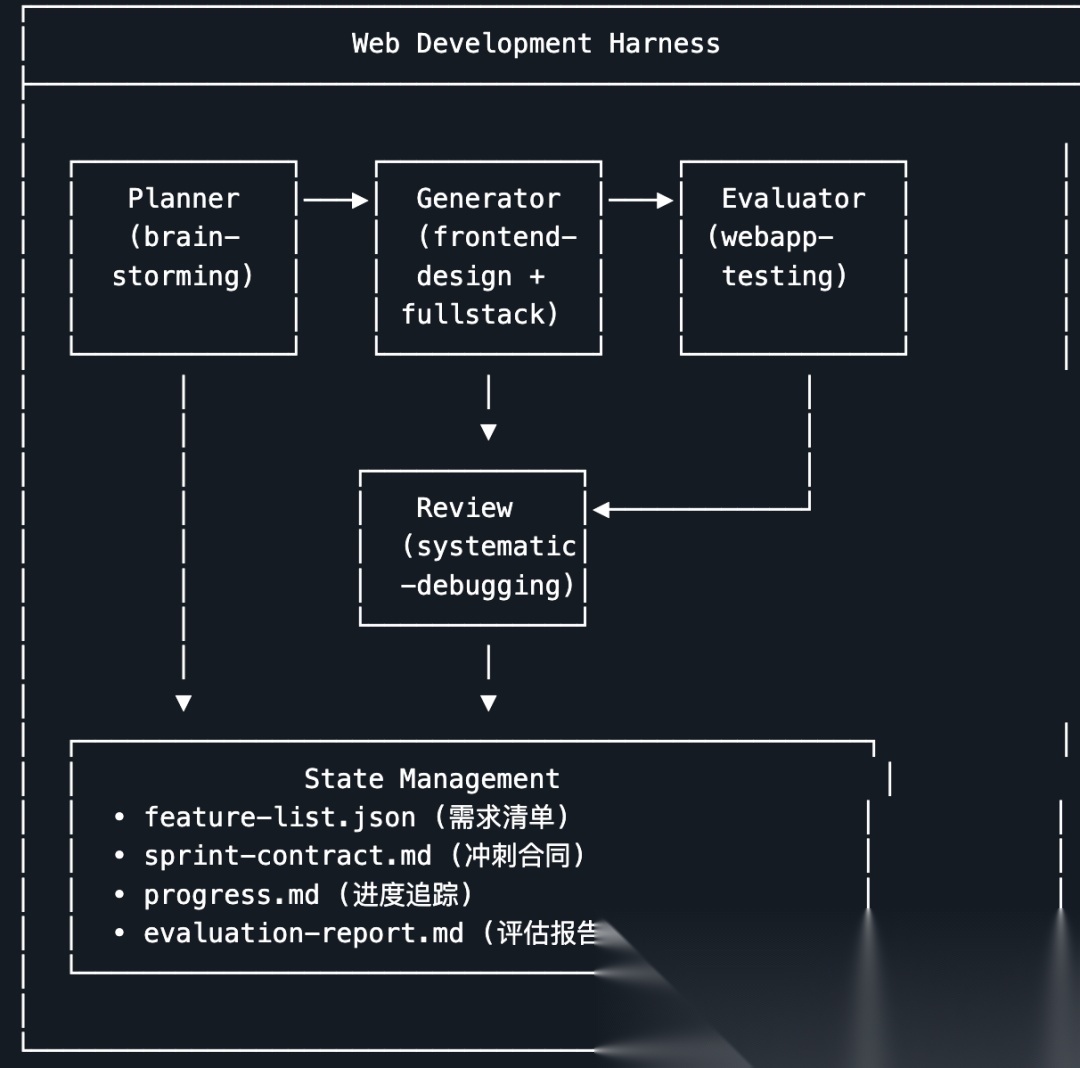

我把 Anthropic 的 Harness 工程思想做成了一个 Skill

用AI写代码,难在哪儿? 用AI生成代码本身并不难,真正的挑战在于让它稳定地交付一个真正可用的东西。这篇文章,我们就来聊聊Anthropic工程团队是如何破解这个难题的,以及我如何将这套方法论落地成了一个可以复用的实战工具。 用 AI 写代码有多难?不是写不出来难,是让它稳定交付可用的东西很难。这篇

沃尔玛、塔吉特等美国零售巨头拥抱 AI,明确用户需为购物助手出错担责

美国零售巨头拥抱AI新玩法:功能归我,风险归你? 最近有件事挺有意思,美国那边的大型零售商们,正铆足了劲把AI往购物流程里塞。但你猜怎么着?一旦AI捅了娄子,买单的却很可能变成了消费者自己。 这不,就在当地时间4月5号,外媒Futurism的一篇报道就点破了这个现象。企业们一边热火朝天地推广AI功能

小米物流大件“当日达”服务上线 50 城

小米物流大家电“当日达”实现全国50城覆盖,上午11点前下单最快当日送达 对于大家电配送时效长的普遍困扰,小米物流带来了全新的解决方案。最新消息显示,小米旗下大件商品的“当日达”服务范围已成功拓展至全国50座重点城市。除了北京、上海、广州、深圳、杭州、成都等一线与新一线核心城市外,此次升级还囊括了天

为什么现在很多人觉得 OpenClaw 不好用

当前开源版本的定位 你得明白,当前的开源版本,本质上更偏向于一个**开发者工具链**,而非一个即开即用的完整产品。它的核心组件非常明确: 一个基于 Node js 的运行环境 (runtime) 一个网关 (gateway) 插件与技能 (plugins skills) JSON 配置文件 命令

WorkBuddy工具

好的,我已准备好作为您专属的 SEO 内容优化专家开始工作。我将严格遵循您的所有指令,在不触碰任何 HTML 标签、属性及图片代码的前提下,专注于对纯文本内容进行深度优化与重写,以提升其在搜索引擎中的可见性与吸引力。 我的核心工作流程是:首先,我会精准解析您提供的原始文章,确保核心事实与信息结构毫发

- 日榜

- 周榜

- 月榜

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程