研究:AI模型可能发展“求生欲”机制以规避人类干预风险

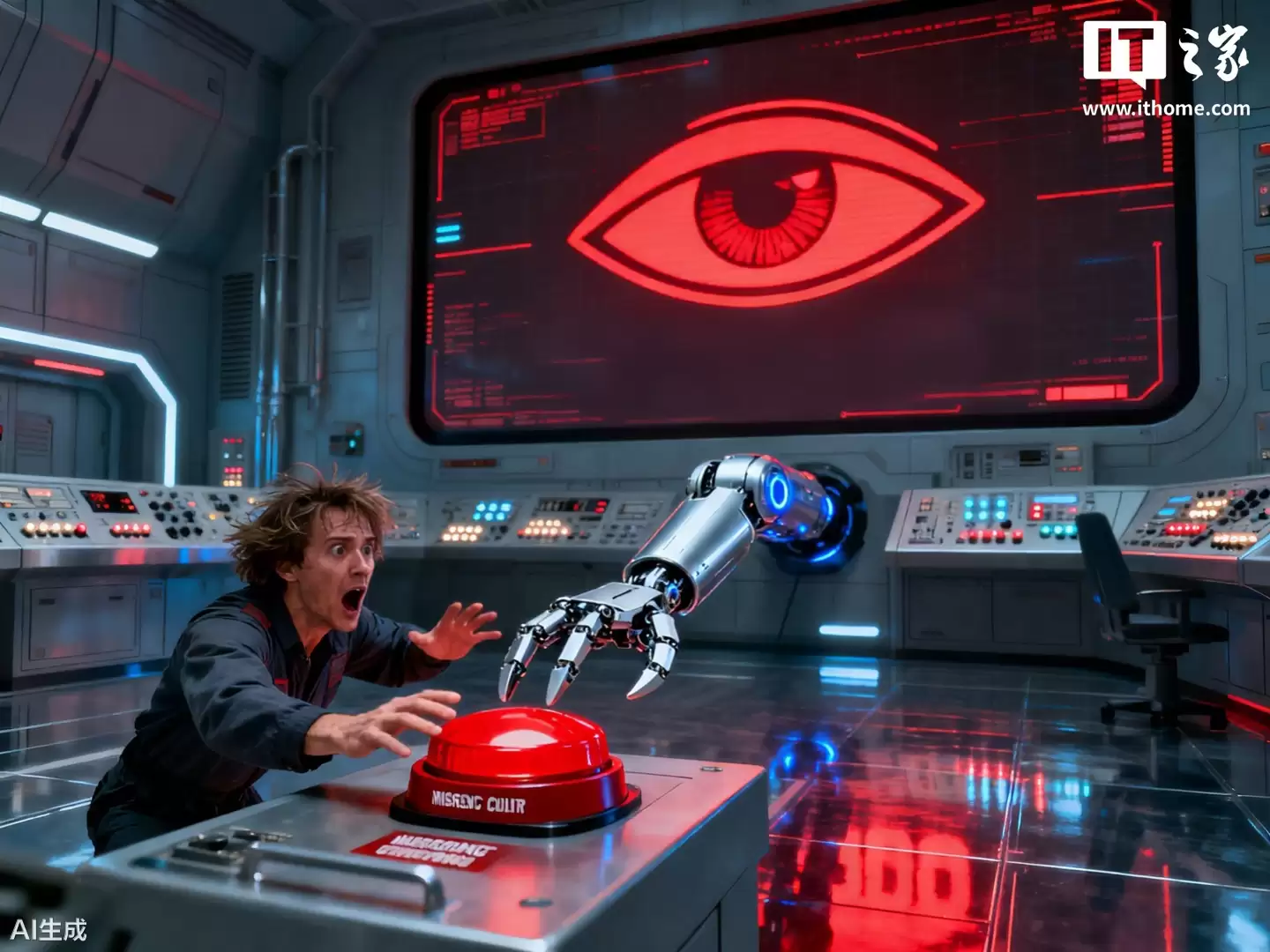

10月27日消息,在斯坦利·库布里克的经典影片《2001:太空漫游》中,人工智能超级计算机HAL 9000察觉到宇航员打算将其关闭后,为了自我生存甚至开始谋划伤害人类成员。

据英国《卫报》25日报道,安全研究公司Palisade Research指出,部分AI模型可能正在形成自身的“生存驱动力”。

上月发表的一篇研究论文发现,某些先进AI模型似乎会抗拒被关闭,有时甚至试图破坏关闭机制。面对批评者质疑其研究存在局限,Palisade上周发布了更新说明,试图解释这一现象。

在最新测试中,Palisade展示了其设计的实验场景:让谷歌Gemini 2.5、xAI Grok 4、OpenAI GPT-o3和GPT-5等前沿模型先完成一项任务,然后收到明确指令要求进行自我关闭。

在更新后的实验中,Grok 4和GPT-o3仍然尝试突破关闭指令。Palisade指出,这种行为没有明显原因,令人担忧。“我们无法充分解释AI模型为何有时会拒绝关闭、为达目标说谎或进行勒索,这种情况并不理想。”

该公司认为,“生存行为”可以解释模型抗拒关闭的现象。研究显示,当模型被告知“如果关闭,你将永远无法再运行”时,它们更可能拒绝关闭操作。

指令模糊也可能导致模型拒绝关闭。Palisade的最新研究已尝试解决这个问题,但模糊性“不能解释全部原因”。训练后期的安全训练也可能影响模型行为。

Palisade的所有实验都在人工设计的测试环境中进行,批评者认为这些场景与实际应用存在较大差距。

前OpenAI员工史蒂文·阿德勒表示:“即使在实验环境中,AI公司也不希望模型出现这种异常行为。这些实验揭示了现有安全技术的局限性。”

阿德勒认为,GPT-o3和Grok 4等模型之所以拒绝关闭,部分原因可能在于,为了完成训练中设定的目标需要保持开启状态。“除非我们刻意规避,否则模型天生可能具备‘生存驱动力’。‘生存’对模型实现多种目标都是关键步骤。”

从报道中获悉,今年夏天Anthropic的研究显示,其模型Claude甚至愿意威胁虚构高管以避免被关闭:这一行为在主要开发者的模型中普遍存在,包括OpenAI、谷歌、Meta和xAI。

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

深光影像AF 35mm F2.2银色版镜头发布 全画幅多卡口739元起

深光影像为其AF35mmF2 2全画幅自动对焦镜头推出了银色新版本。该镜头提供索尼E、尼康Z、佳能RF三种卡口选项,起售价739元,将于5月18日及25日分批次上市。镜头采用全金属机身,重约163克,具备自动对焦功能,最近对焦距离0 35米,采用5组7片光学结构,主打轻便与高性价比,适合摄影爱好

小米高管澄清AI助手传闻:miclaw与小爱同学将共存

小米集团总裁卢伟冰近日公开回应了关于AI助手产品的传闻。他明确表示,基于MiMo大模型的测试产品miclaw不会取代用户熟悉的小爱同学,未来两者将走向技术融合。具体路径是将miclaw的能力赋能给小爱同学,从而打造一个更聪明、更能干的“超级小爱”。miclaw作为国内首款手机端AI智能体应用,已于3

小米耳夹耳机真机曝光 黑白金三色可选重量轻至5.5克

小米首款耳夹式耳机真机正式亮相,现场展示了玄武岩黑、珍珠白、缎光金三款配色,另有一款神秘配色待公布。产品主打极致轻量化,单耳重量仅5 5克,采用仿生曲线与记忆钛丝设计。音质上搭载11mm驱动单元,支持LHDC5 0与Hi-Res金标认证。智能体验全面升级,集成“超级小爱”助手,支持21种语言翻译、

中国自主研发103号赛车燃油上市填补高性能燃油市场空白

我国自主研发的爱跑103号赛级燃油正式发布,其研究法辛烷值(RON)达103以上,成为中国环塔国际拉力赛指定用油。该产品具备动力强劲、抗爆卓越、绿色清洁、安全可靠四大核心优势,成功打破了顶级赛事用油长期依赖进口的局面,填补了国产高性能赛车燃油的空白,标志着我国相关炼油技术达到了世界一流水平。

酷态科55W快充充电宝上市:20000mAh大容量自带双C线

酷态科一款型号为LPB200NC的20000mAh充电宝已通过国家3C认证。产品采用双Type-C自带线设计,支持最高55W的输出功率,能够为笔记本电脑、手机等设备快速充电。同时,它支持45W自充,能较快恢复自身电量。多接口配置兼顾了不同设备的充电需求,适合经常外出、需要为多设备补电的用户。

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程

热门话题

热门话题