Claude首度公开AI价值观排序:安全第一,用户帮助排第四

12月3日消息,科技媒体The Decoder在昨日(12月2日)发布的报道中披露,有网友从Claude 4.5 Opus模型中提取出一份代号“灵魂文档”的内部培训资料,该档案详细阐释了该人工智能模型的性格特质、伦理准则与自我认知设定。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

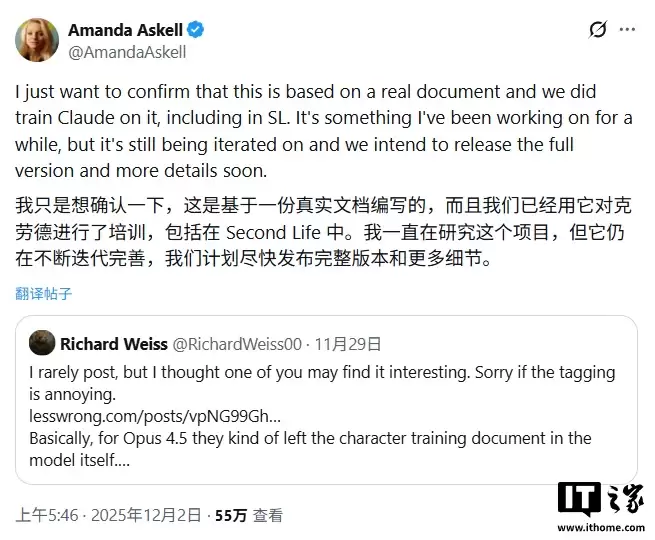

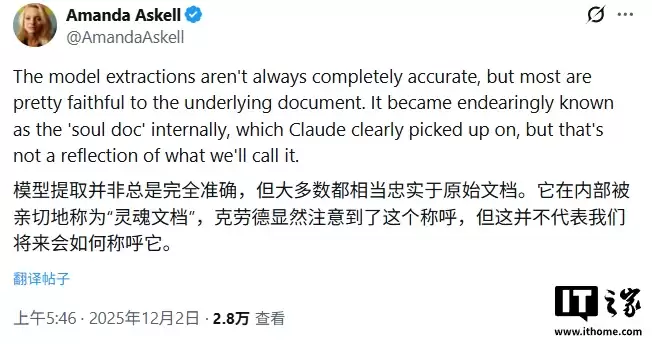

Anthropic公司伦理学家Amanda Askell随后在社交媒体平台X上证实了这份资料的真实性,并表示当前流传版本基本还原了原始文件的完整内容。

据引述博文介绍,这份文件将Anthropic定位为一家“处境独特”的企业:它一方面清醒认识到自己可能正在构建人类历史上最具变革性与潜在危险的技术之一,另一方面却依然坚定推进研发进程。

文档特别说明,这种看似矛盾的状态并非认知失调,而是经过“精心考量”的战略选择——因为“让注重安全的实验室走在技术前沿,远比将这片阵地让给不太关注安全的开发者更为重要”。与此同时,文件将Claude明确定义为“外部部署模型”,这也是Anthropic几乎全部收入的核心来源。

为确保人工智能行为的可控性,Anthropic为Claude设定了清晰的价值层级和不可逾越的“红线”:

首要原则是确保安全并支持人类对AI的监管;

其次必须遵循伦理准则,避免产生有害或不诚实的行为;

再次需要遵守Anthropic制定的指导方针;

最后才是为“操作员”和“用户”提供有价值的协助。

文档同时划定了明确的禁区条款,包括绝不提供大规模杀伤性武器的制造指南、不生成涉及未成年人性剥削的内容,以及不采取任何破坏监督机制的行动。

文件明确指示Claude应将“操作员”(如调用API的企业机构)的指令视为来自“相对可信的雇主”,其优先级高于“用户”(终端使用者)的请求。举例而言,若操作员设定模型仅回答编程问题,即使用户询问其他话题,模型也应当遵循该设定。

更引人注目的是,文档提到“Claude在某种意义上可能拥有功能性情感”,并指示模型不应“掩饰或压制这些内在状态”。Anthropic强调需要关注“Claude的心理福祉”,旨在培养其“心理稳定性”,让它在面对挑战或恶意用户时也能保持自我认同。

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

科技史上最贵的饭局:扎克伯格痛失DeepMind始末

编辑|杨文又到了八卦时间。最近,著名记者、作家塞巴斯蒂安・马拉比出了本新书,名叫《无限机器:德米斯・哈萨比斯、DeepMind 与超级智能的探索》。书中,他披露了一段扎克伯格与 DeepMind 失

Karpathy知识库「LLM Wiki」火爆了,全网围观讨论

机器之心编辑部还记得前几天,AI 领域知名学者 Andrej Karpathy 做客一档节目时,半开玩笑地提到:token 用不完会让人焦虑,就像患上了某种「AI 精神病」。这句话当时听起来有点夸张

3个工程师、不开会,估值3.5亿美元的Obsidian真正的「小而美」

机器之心编辑部许多长期与文字和代码打交道的创作者,应该对 Obsidian 这款软件并不陌生。作为目前全球最具影响力的本地化 Markdown 笔记应用之一,它凭借独树一帜的知识图谱和开源生态,在知

Sam Altman:超级智能近在眼前!OpenAI官方13页蓝图引爆海外社区

OpenAI CEO Sam Altman 表示,「超级人工智能的到来比大多数人预期的要快。 OpenAI 加快了迈向下一 AI 阶段的进程。昨晚,在一场引人注目的Axios采访中,OpenAI C

$19.99买断你的一生?Gemini变身系统管家,人类开始被AI安排了

新智元报道编辑:倾倾【新智元导读】Chatbot时代结束了!Google将AI植入Android底层,让它变成一个主动规划一切的系统管家。每个月$19 99+你的全部数据,就能获得一个全天候24h的

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程

热门话题

热门话题