通义千问Qwen3-TTS两款AI语音模型发布:支持定制与声音复刻

12月24日消息,阿里通义今日正式发布Qwen3-TTS家族的两款全新模型:音色创造模型Qwen3-TTS-VD-Flash与音色克隆模型Qwen3-TTS-VC-Flash。两款模型的主要特性如下:

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

音色创造:Qwen3-TTS-VD-Flash支持用户通过复杂、自然的语言指令输入,实现对音色、韵律、情感乃至人设的精细化调控。它让用户能够全面掌控从“说什么”到“如何说”的整个过程,自由定义心中想要的语音特质。这彻底改变了以往只能克隆现有音色,或是在有限预设音色库中进行选择的局面。

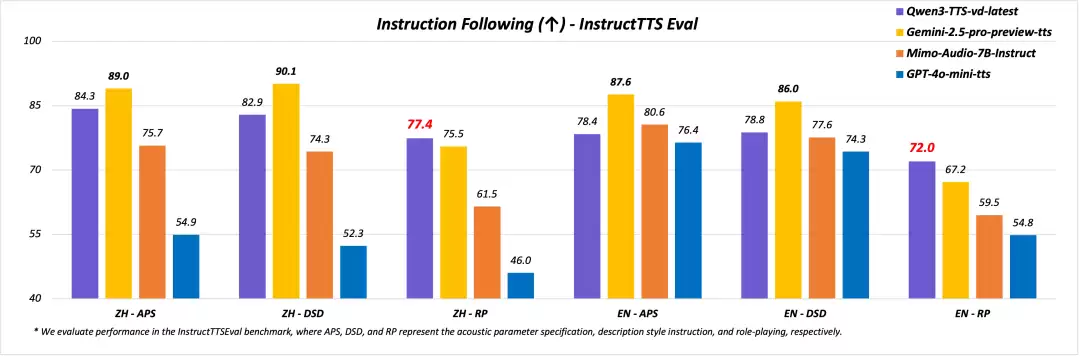

在InstructTTS-Eval评测中,其综合表现显著优于GPT-4o-mini-tts和Mimo-audio-7b-instruct;在角色扮演测试中也超越了Gemini-2.5-pro-preview-tts。

音色克隆:Qwen3-TTS-VC-Flash支持仅需3秒音频即可完成音色克隆,并能基于克隆出的音色,生成涵盖中文、英文、德语、意大利语、葡萄牙语、西班牙语、日语、韩语、法语、俄语等10大主流语言的语音。

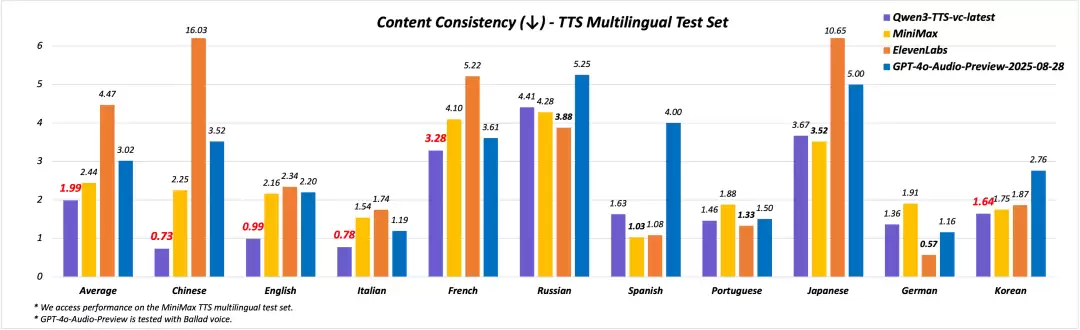

在MiniMax TTS Multilingual Test Set上,其平均词错误率(WER)全面低于MiniMax、ElevenLabs及GPT-4o-Audio-Preview。

高表现力:无论是Qwen3-TTS-VD-Flash还是Qwen3-TTS-VC-Flash,都具备高度拟人化的自然音色。它们能够稳定、可靠地输出与文本内容高度契合的语音,并依据文本语义自动调节语气节奏,呈现出自然生动的表达效果。

鲁棒的文本能力:两款模型均拥有强大的文本解析能力,可自动处理复杂文本结构,精准提取关键信息。对于多样化、非规范化的文本格式,都展现出较强的鲁棒性(注:鲁棒性指系统在面临内部结构或外部环境的变化时,维持功能稳定运行的能力)。

Qwen3-TTS-VD-Flash

该模型支持用户通过自然语言描述来生成定制化的音色形象。您只需随意输入有关声学属性、人设描述、背景信息等自由描述,即可轻松创造出自己期望的语音形象。

可控的生成质量:在InstructTTS-Eval评测中,Qwen3-TTS的综合表现显著优于GPT-4o-mini-tts和Mimo-audio-7b-instruct;在角色扮演测试中也超越了Gemini-2.5-pro-preview-tts。

Qwen3-TTS-VC-Flash

该模型支持通过自然语音进行3秒级别的音色克隆。基于克隆出的音色,可生成多语种音频,同时对复杂文本和带有环境背景音的“野生”音频都具有较高的处理鲁棒性。

多语种音色克隆:在MiniMax TTS Multilingual Test Set上,Qwen3-TTS在中、英、法、意等语种的内容稳定性方面优于MiniMax、ElevenLabs及GPT-4o-Audio-Preview;其平均词错误率(WER)也位居第一。

Qwen3-TTS-Voice-Design API 文档:

https://www.alibabacloud.com/help/zh/model-studio/qwen-tts-voice-design?spm=a2ty_o06.30285417.0.0.56a0c9216Ey6VM

Qwen3-TTS-Voice-Clone API 文档:

https://www.alibabacloud.com/help/zh/model-studio/qwen-tts-voice-cloning?spm=a2ty_o06.30285417.0.0.56a0c921WnHNlN

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

新加坡国立大学破解AI看图说话难题让机器描述更准确

人工智能的“幻觉”问题,特别是大模型在图像描述任务中凭空捏造内容的现象,一直是制约其可靠应用的关键挑战。2026年2月,一项由新加坡国立大学与北京大学深圳研究生院联合发布的突破性研究,为这一难题提供了全新的理解与一套高效、简洁的解决方案。这项研究(论文预印本编号:arXiv:2602 22144v1

斯坦福大学JavisDiT++实现AI有声有色视频生成

这项由浙江大学、新加坡国立大学、多伦多大学等全球顶尖科研机构联合完成的研究成果,已正式发表于2026年国际学习表征会议(ICLR 2026),论文预印本编号为arXiv:2602 19163v1。对于希望深入探究技术细节的读者,可通过此编号查阅完整的学术论文。 在浏览短视频时,你可能已经察觉到一种普

北大提出AI推理双车道方案解决大模型对话卡顿难题

这项由北京大学计算机学院主导,联合清华大学及DeepSeek-AI共同完成的前沿研究,其成果已正式发布于2026年2月的arXiv预印本平台,论文编号为arXiv:2602 21548v1。关注大语言模型推理优化的研究者与开发者,可通过此编号查阅论文全文与技术细节。 在与大语言模型进行深度、多轮对话

清华大学AI突破:赋予虚拟世界持久记忆,解决视频生成失忆难题

想象一下,你正在体验一款开放世界游戏。当你站在高塔之巅,远方的山脉清晰可见。随后你转身离开,去探索地图的其他角落。许久之后,当你再次回到这座塔顶,那座山依然以完全相同的姿态矗立在原地。这种空间持久且一致的认知,是人类理解世界的基础。 然而,若让当前的主流AI来动态生成这样的游戏场景,结果会大相径庭。

大模型压缩技术COMPOT让AI运行更高效

随着人工智能模型参数规模不断突破千亿级别,其庞大的存储需求和计算开销已成为实际部署的主要瓶颈。针对这一挑战,MWS AI基础研究中心与ITMO大学联合提出了一种名为COMPOT的创新模型压缩技术。这项发表于2026年2月预印本平台(arXiv:2602 15200v1)的研究,为大语言模型高效“瘦身

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程

热门话题

热门话题