刷屏AI圈!亚马逊架构师吃透Anthropic官方范式,9层Agentic AI落地架构,治好90%项目烂尾

为什么你的AI Agent永远停留在Demo阶段?

最近AI Agent赛道卷得厉害,但一个尴尬的现象反复上演:Demo惊艳全网,一上线就翻车。本地测试丝滑流畅,到了生产环境却故障不断。很多团队拼命堆叠智能体、工具和工作流,结果系统变得混乱失控,问题无法溯源,迭代更是无从下手。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

问题出在哪?一个普遍的误解是,把AI Agent的核心简单等同于“多智能体协作加调用工具”。现实很快给出了教训:只注重前端能力的炫酷,而忽视底层保障体系的构建,是大量AI项目无法量产成功的根本原因。

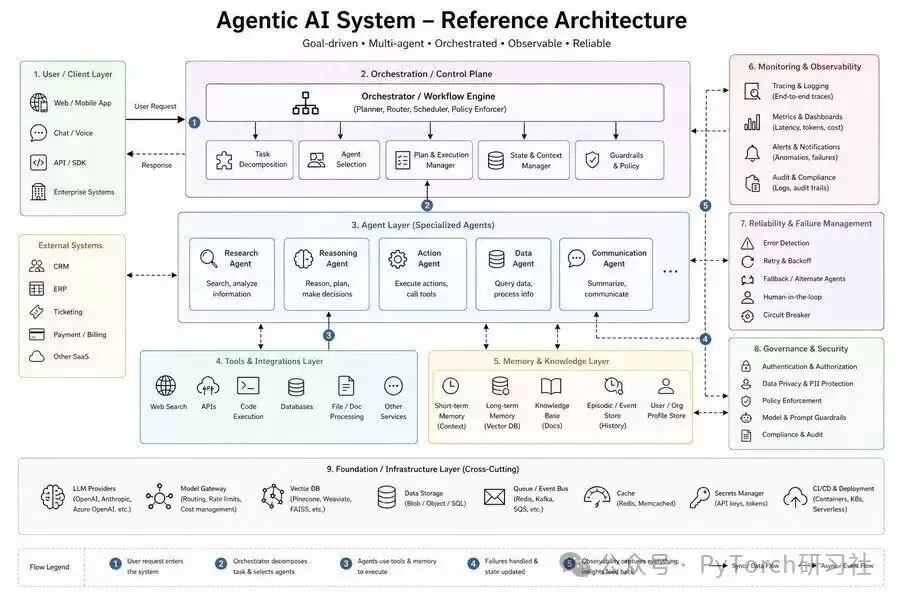

最近,亚马逊设备部门的解决方案架构师Neha Sharma分享的一套架构图火了。她基于Anthropic最新的重磅博客《Building Effective AI Agents》,并结合自身备考Claude架构师认证的实战思考,梳理出一套可直接落地的9层Agentic AI标准参考架构。

Image

Image

这张由AI生成的架构图,没有晦涩的概念堆砌,也没有冗余的设计,完全对齐生产环境的真实需求,精准戳中了AI Agent落地过程中的核心痛点。它之所以迅速刷屏技术圈,被众多开发者收藏,是因为它揭示了一个行业真相:顶尖AI Agent的差距,往往不在前端的编排逻辑有多花哨,而在那被90%的人所忽略的后半段能力。

1. 从演示到生产,到底差了什么?

审视市面上绝大多数的AI Agent教程和开源项目,你会发现它们的焦点高度集中在三件事上:

✅ 如何设计任务编排逻辑

✅ 如何搭建多智能体分工体系

✅ 如何对接插件、API和检索工具

这三层确实是Agent的“门面”,能快速做出令人眼前一亮的演示效果。但Anthropic在行业深耕的实战经验早已表明,高效的AI Agent从不依赖于复杂的框架,而是仰仗于简洁、可落地、高可靠的工程体系。

Neha Sharma在复盘了大量落地案例后指出一个关键事实:生产环境中80%的致命问题,并非出在“智能体执行任务”这个环节,而是源于“监控缺失、容错失效、合规空白”。

没有底层保障的Agent系统,本质上就是在“裸奔上线”:任务出错无法追溯根源,超时崩溃没有兜底方案,数据泄露缺乏防护,权限管理一片混乱。这也解释了,为何无数AI项目止步于Demo的辉煌,一旦上线便遭遇滑铁卢。

而这套9层架构最大的价值,正是补齐了所有这些落地短板,为行业提供了一套从“演示级”平滑过渡到“生产级”的完整标准答案。

2. 逐层拆解:9层架构如何构建生产级AI Agent

这套架构自上而下,层层递进,逻辑形成闭环,权责清晰分明。它完整覆盖了从“用户交互”到“智能决策”,再到“能力调用”、“记忆存储”,最后到“运维保障”和“底层支撑”的全链路。无论是新手理解核心思想,还是老手直接复用落地,都能从中获得清晰指引。

第一层:用户/客户端界面(User/Client Interface)

这是整个系统的入口,核心价值在于承接人类需求,并定义清晰的目标。用户无需关心底层复杂的运行逻辑,只需要输入明确的任务,并设定好核心目标与约束条件。无论是Web端、移动客户端、API对接还是企业内部系统,所有需求都在这一层统一收敛,为后续的智能编排打下坚实基础。

它的核心作用是统一需求入口,从根本上杜绝因目标模糊而导致的Agent无效执行。

第二层:编排/控制平面(Orchestration / Control Plane)

此处堪称整个AI系统的“大脑”和指挥中心,是任务调度的核心枢纽。它本身不直接执行具体任务,只负责全局的统筹工作:拆解复杂目标、规划执行路径、分发子任务、把控整体流程节奏、协调各个模块的联动。

区别于简单、线性的工作流,Agentic AI的自主性很大程度上依赖于这一层来实现。它能够根据任务执行的动态情况灵活调整流程,而非机械地执行预设的固定脚本。

它的核心作用是定策略、控节奏、管全局,是系统智能性的核心载体。

第三层:智能体层(Agents Layer)

这里是系统的“执行军团”,核心在于多专业化智能体的分工与协作。不再是让一个“全能”Agent包揽所有工作,而是根据具体场景拆解出专属的智能体:负责检索的Agent、专精数据分析的Agent、擅长文案生成的Agent、主导逻辑推理的Agent等等。

各Agent可以并行作业、高效协作,也能在必要时相互补位,从而大幅提升处理复杂任务的效率与专业度。这完美契合了Anthropic所倡导的“可组合、轻量化”设计哲学。

它的核心作用是实现专业化分工,确保每一个子任务都由最合适的智能体来执行。

第四层:工具与集成(Tools & Integrations)

这一层是Agent的“外部能力触手”,是智能体从理论走向实用的关键桥梁。它包含了网页搜索、数据库读写、企业API对接、代码执行、文件解析、第三方插件调用等所有外部能力。

大语言模型本身的知识存在局限,能力也相对单一。只有通过工具层打通外部资源,才能突破模型固有的边界,去完成实时、真实且复杂的业务落地任务。

它的核心作用是连接虚拟智能与真实业务世界,让AI真正具备落地执行的能力。

第五层:记忆与知识(Memory / Knowledge)

这是系统的“记忆中枢与知识库”,直接决定了AI的成长性和连续性。它涵盖了短期会话记忆、长期用户偏好记忆、向量化知识库、业务专属知识沉淀等。

有了这一层,AI才能摆脱“单次对话、零记忆重启”的短板,实现上下文的连贯理解、用户习惯的留存学习以及业务知识的持续迭代,真正做到越用越智能。

这也是企业级AI Agent区别于普通一次性对话机器人的核心差异之一。

它的核心作用是沉淀数据与经验,支撑AI实现持续迭代和精准应答。

第六层:监控(Monitoring)——生产落地的核心关键

Neha特别强调,这是生产环境中最不可或缺,却又最容易被忽视的一层。它负责实时追踪全链路的执行状态:包括每一步的决策逻辑、所有工具调用的记录、各环节的耗时与性能、出现的异常节点以及用户的行为轨迹。

没有监控层,系统就如同在“黑盒”中运行:出错时无法快速定位根因,性能瓶颈难以优化,违规操作无从追溯,对企业而言上线风险极高。

它的核心作用是实现全链路的透明化,让系统变得可观测、可复盘、可优化。

第七层:可靠性与故障处理(Reliability & Failure Handling)

这是AI系统的“安全兜底防线”。它包含自动错误识别、失败重试机制、流量峰值时的服务降级策略、超时熔断保护、以及必要时的人工介入(human-in-the-loop)等全套容错能力。

大模型本身存在一定的随机性和不确定性,工具调用、网络请求等环节也难免出现异常。这一层的存在,就是为了妥善处理这些不确定性,保障系统的稳定运行,避免因单点故障导致整个任务流程崩盘。

它的核心作用是抵御随机风险,大幅提升系统的整体稳定性与可用性。

第八层:治理、安全与合规(Governance, Security & Compliance)

这是企业级落地不可逾越的“准入底线”。它涵盖了权限分级管控、数据加密传输与存储、隐私信息脱敏、全操作审计日志、内容安全风控、以及行业特定合规性校验等能力。

个人Demo项目或许可以忽略合规问题,但企业生产系统必须严守规则。尤其是在金融、政务、医疗等敏感行业,缺乏治理与合规层的AI系统,根本不可能获准上线商用。

它的核心作用是守住数据安全与行业合规的底线,为商业化落地铺平道路。

第九层:底层基础设施(Infrastructure)

这是整套AI系统的“硬件底座”。它包含算力资源(如GPU)、云服务、存储系统、网络配置、容器调度平台以及运维体系等,为上面所有层级提供稳定、高效的底层支撑。基础设施的稳定性与性能,直接决定了整个系统的响应速度、高并发处理能力以及未来的扩容上限。

它的核心作用是筑牢底层基座,保障全系统能够高效、稳定地运转。

3. 顶尖架构师的洞见:AI Agent落地的真相

这套架构之所以引发广泛共鸣,不仅在于其逻辑的完整性,更在于它有力地纠正了行业的普遍误区。

Neha Sharma结合Anthropic的最新理念与一线落地经验,给出了几个关键结论:

不要沉迷于花哨能力,落地的核心是工程化兜底。编排、多智能体、工具调用这些只是“表层能力”,而监控、容错、治理才是实现“量产”的关键。绝大多数项目的失败,不是因为智能程度不够,而是因为系统不够稳定、不够安全、不可控。

优秀的AI Agent,追求简洁与可组合性,拒绝过度设计。这完全契合Anthropic的核心思想:高效的智能体从不依赖复杂框架,简单、透明、可迭代的结构才是最优解。无需盲目堆叠复杂逻辑,分层清晰、权责明确,本身就是最好的架构。

企业级AI,必须是“可观测、可容错、可合规”的完整系统。从Demo到生产环境,差的往往不是智能能力本身,而是工程化、安全化、合规化的底层保障体系。补齐后面这三层能力,才是AI Agent从“能用”走向“好用”、最终实现“商用”的终极门槛。

4. 写在最后

AI Agent的赛道,早已告别了单纯“拼概念、秀噱头”的早期阶段,正式进入了比拼工程落地与稳定商用的硬核时代。

当很多团队还在表层功能上内卷时,顶尖的架构师们已经在深耕底层保障体系。这套源自Anthropic最新思想、并经亚马逊一线架构师梳理迭代的9层架构,不仅是一套可视化的思维模型,更是一套可以直接参照、落地实施的生产级标准。

无论是新手入门构建Agent思维体系,还是开发者优化现有项目以解决上线翻车难题,亦或是团队从零开始搭建企业级AI系统,这套架构都提供了极高的参考价值。

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

开多个 Agent 后 Claude Code 账单翻了四倍,一个配置解决了

Claude Code 多 Agent 成本陷阱:你以为是一个对话,其实背后开了三个“小号” 当你打开 Claude Code,让它帮你重构一个 Spring Boot 模块时,你以为这只是一次简单的对话、一个 API 调用。但真相往往更复杂:Claude Code 在后台悄悄启动了三个独立的子 A

王炸级项目:为何要学习AI全链路短剧自动生成平台?

AI全链路短剧生成平台:从“一句话”到“成片”的自动化工厂 想象一下,你只需要输入一个想法,剩下的写小说、编剧本、画分镜、生成视频,全部由AI自动完成,整个过程进度还能随时暂停、跳过或重启,绝不丢失。这就是《AI全链路短剧生成平台》要构建的愿景——一个基于多套AI Agent和20余个大模型的企业级

刷屏AI圈!亚马逊架构师吃透Anthropic官方范式,9层Agentic AI落地架构,治好90%项目烂尾

为什么你的AI Agent永远停留在Demo阶段? 最近AI Agent赛道卷得厉害,但一个尴尬的现象反复上演:Demo惊艳全网,一上线就翻车。本地测试丝滑流畅,到了生产环境却故障不断。很多团队拼命堆叠智能体、工具和工作流,结果系统变得混乱失控,问题无法溯源,迭代更是无从下手。 问题出在哪?一个普遍

4090显卡部署大模型_24G显存极限压力测试报告

在RTX 4090(24GB显存)上部署大模型的五条可行路径 当你手握一块性能强劲的RTX 4090显卡,准备部署大语言或多模态模型时,最常遇到的拦路虎是什么?没错,就是那看似充裕、实则捉襟见肘的24GB显存。模型权重、激活内存、KV缓存层层叠加,很容易就突破了硬件的承载阈值,导致显存溢出、推理卡顿

如何在Perplexity中自定义AI助手的语气_在个人资料中设置回复风格

如何在Perplexity中自定义AI助手的语气 想让Perplexity AI的回复更贴合你的表达习惯,却发现默认输出风格固定、缺乏个性?这通常是因为全局的语气偏好尚未配置。别担心,实现个性化语气定制其实有清晰的路径可循,下面就来拆解具体的操作步骤。 简单来说,Perplexity将语气控制能力整

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程

热门话题

热门话题