MicroCoder突破大模型训练瓶颈:用算法数据框架提升经验

MicroCoder团队 投稿

量子位 | 公众号 QbitAI

新一代代码模型的训练动态已与旧模型截然不同,主流强化学习方法和数据集在其上几乎“失效”。

微软亚洲研究院与剑桥大学、普林斯顿联合推出MicroCoder,从算法、数据、框架、训练经验四个维度全面升级,在最新代码测试集上取得明显提升,并从七个方面开源了34条训练洞察。

背景:旧经验遇上新模型,为何几乎全部“失效”?

强化学习正在成为代码大模型能力提升的核心路径。以GRPO为代表的策略优化方法在数学推理任务上积累了大量成功经验,人们自然地把这套方法迁移到了代码生成上。

然而研究者很快发现了一个现象:用DeepCoder这类主流数据集训练最新推理模型,性能几乎没有提升;而同样的做法在过去版本的模型上却有显著效果。

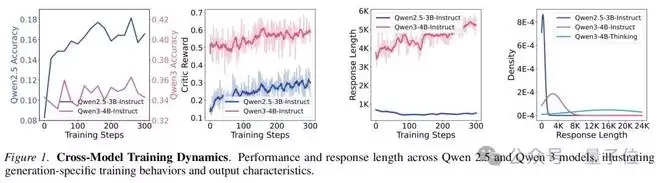

这背后的原因是代际性的:最新推理模型的能力已经超出了主流数据集的难度,这些题目对它而言过于简单,无法产生有效的学习。与此同时,最新推理模型在训练中输出长度持续增长,而旧模型的输出长度稳定甚至下降,两代模型的训练动态已经截然不同,专为旧模型设计的训练方法在新模型上不再适用。

针对这一训练瓶颈,来自微软亚洲研究院、剑桥大学和普林斯顿大学的研究团队提出了MicroCoder项目,包含四个核心贡献:MicroCoder-GRPO算法、MicroCoder-Dataset数据集、MicroCoder-Evaluator训练评估框架,以及跨超过30组受控实验总结的34条训练经验。

算法:MicroCoder-GRPO

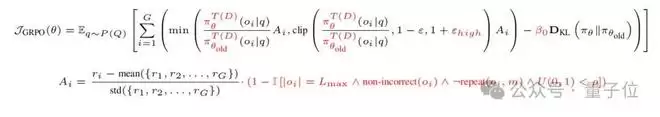

MicroCoder-GRPO在GRPO基础上引入三项修改,专门应对现代代码模型的训练动态。

修改一:条件截断掩码

强化学习训练中,被最大长度截断的输出若参与策略优化,会引导模型生成更短的输出。为此,DeepCoder等方法采用“全部掩码”策略,对所有达到最大长度的输出都将优势分数置零,但这会导致输出长度增长过快。

MicroCoder-GRPO提出了更精细的条件截断掩码:只对同时满足四个条件的输出执行掩码,达到最大长度、答案非错误、无尾部重复序列、且以特定概率随机抽取。实验表明,这一策略有效解锁了模型的长输出潜力,同时规避了全掩码策略带来的训练问题,最终收敛性能高于无掩码和全掩码两种方案。

修改二:多样性驱动的温度选择

输出多样性是强化学习稳定训练的关键指标。研究发现:在固定温度下,多样性不会总随训练进行持续变动,而是不同温度下会最终收敛到相近水平;而一旦初始多样性与预期收敛值相差较大,模型的训练就容易受到影响。传统标准温度对最新推理模型而言较低,容易因此产生影响。

MicroCoder-GRPO提出根据模型初始输出多样性动态确定训练温度:测量初始多样性趋势,选择能使多样性平稳收敛的温度值。文章还发现“先低温后高温”的分阶段方法优于全程固定温度,但需避免连续的温度过渡,即便是短暂的渐变也可能对多样性造成影响。

修改三:去除KL散度+高裁剪比率

沿用DAPO的设计思路,MicroCoder-GRPO将KL散度权重设为0,并采用更高的裁剪比率。实验证明,保留KL散度会持续影响输出多样性、限制输出长度增长,导致性能“先涨后跌”;去除后,模型获得持续的性能提升。

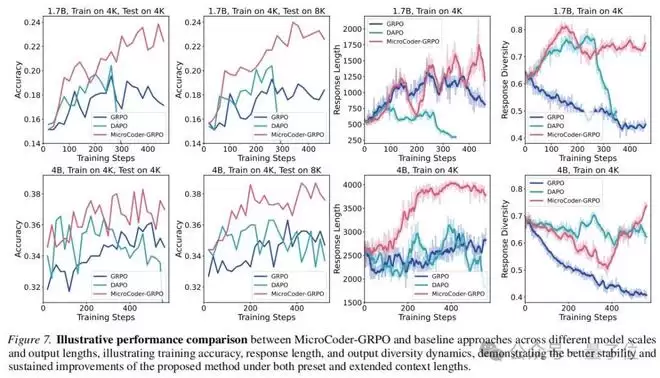

三项修改共同作用下,MicroCoder-GRPO在最新代码测试集上相比DAPO基线取得明显提升,且在拓展测试上下文长度时更为显著。

数据:MicroCoder-Dataset

算法之外,数据难度也是代码模型能力的重要影响因素。

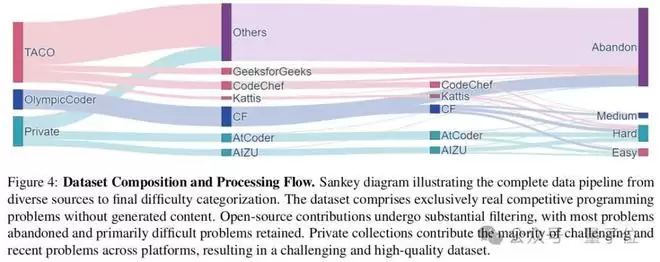

四阶段数据处理流水线

MicroCoder-Dataset的构建分四个阶段:“收集”从多元平台收集真实竞赛题目;“处理”统一语言、去噪、格式标准化,并用LLM自动生成和筛选测试用例;“筛选”实施软硬约束及自适应难度过滤;“验证”进行人工抽查确保可读性和测试用例准确性。

自动难度过滤:预测-校准-选择

难度过滤是MicroCoder-Dataset的核心创新。研究团队设计了一套五维难度评估矩阵,由LLM对每道题进行三次独立打分,取平均后计算加权难度分。

这五个维度的权重设计有其理论依据,参考了Bloom教育目标分类法、McCabe和Halstead方法,将重心放在真正考验推理和编程能力的维度上,而非语义理解和记忆。

随后,以模型实际通过率为基准对预测分进行校准,在LiveCodeBench数据集上确定易、中、难的分界值,预测分布与实际分布几乎完全吻合。过滤后,简单题占比降至25%以下,困难题占比提升至50%以上。

数据集特点

最终,MicroCoder-Dataset包含超过13K经严格筛选的真实竞赛题,全部来自实际竞赛平台而非LLM生成。聚类分析表明各平台题目互补,与测试集之间没有重合。

效果对比

在相同训练下,MicroCoder-Dataset在300步训练内取得的性能增益是DeepCoder数据集的3倍。以DAPO训练最新推理模型为例,相比DeepCoder,MicroCoder在LeetCode上整体提升约6.0个百分点,难度越高,增益越明显。

训练评估框架:MicroCoder-Evaluator

代码评估的准确性直接决定强化学习的质量。

问题:原版评估器的误判

LiveCodeBench原版评估器采用严格精确匹配策略:直接等值比较、精确浮点计算、仅做基本空白去除。这种方式会将大量格式正确但略有差异的正确答案判为错误,例如返回列表与元组的格式差异、浮点精度差异,产生噪声,干扰训练。

解决方案:多方法回退的综合验证

MicroCoder-Evaluator采用6-7种方法组成的回退链进行综合输出验证,依次尝试不同的比较策略:支持列表、元组、字符串、集合等格式的自动类型转换;进行浮点近似比较;多行分割与空白规范化等预处理;单个方法失败后自动切换至下一种方法,全程高容错。

效果

与LiveCodeBench原版评估器相比,MicroCoder-Evaluator将评估准确率提升约25%,即更准确地识别了正确解法的变体,减少了误判噪声。训练曲线对比显示,使用MicroCoder-Evaluator的模型在早期训练阶段可以获得更可靠的学习反馈,最终测试准确率更高且收敛更快。

此外,通过优化并行处理策略,MicroCoder-Evaluator将每个训练步骤的执行速度提升约40%,显著提升了训练效率。

训练洞察:34条跨越七大维度的经验

MicroCoder项目通过超过30组受控实验完整地记录了现代代码模型强化学习训练中的经验,覆盖七大维度,以下列出各维度的核心洞察:

代码评估器:评估准确性对训练效果影响显著,尤其在早期阶段。高容错评估带来更可靠的结果反馈,能有效防止次优收敛。原版LiveCodeBench评估器的严格匹配策略会产生误判,在训练初期产生影响。

温度动态:模型对温度的鲁棒性随训练进行而增强。不同温度下,输出多样性变化但最终收敛到相近水平。当初始多样性低于收敛预期时,可能导致训练失败。

训练数据:数据难度影响泛化能力。在简单数据集上表现优秀并不意味着在测试集上同样优秀,只有挑战性更高的训练问题才能带来真正的泛化提升。更难的问题会促使模型生成更长的解题路径,输出长度增长速度和最终长度均更大。

上下文长度与扩展:更长的最大输出与更高的最终准确率、更快的输出增长和更高的多样性直接相关。早期训练阶段的输出长度限制会产生“不可逆”影响,一旦模型在短输出限制下训练足够长时间,后续即便增大上下文,性能也无法完全恢复。

截断掩码策略:掩码比例在训练速度与峰值性能之间形成平衡,更高的掩码比例能更快达到初始峰值,但较低的掩码比例能延长上升阶段并达到更高的峰值。30%的条件掩码在输出长度增长速率上已接近全掩码,同时显著优于全掩码在训练稳定性等方面的表现。

批大小与在线训练:较小的训练批大小产生更接近在线训练的行为,加快多样性收敛,但影响训练稳定性;较大的批大小产生离线训练行为,稳定性更强。最优选择来自两者之间的平衡。

KL散度与裁剪比率:标准KL散度会持续影响输出多样性并限制输出长度增长,形成“性能先涨后跌”的形式。去除KL散度是支持长期持续性能提升的重要条件。

完整的34条洞察已在项目主页的MicroCoder-Insights博客中完整整理,覆盖每个维度的具体实验和结论,是目前最为完整的现代代码模型强化学习训练经验库之一。

项目价值

代码大模型的强化学习训练长期借鉴数学推理任务的经验。MicroCoder首次完整提出,这一迁移路径存在代际断层,不同模型世代之间,训练动态、数据需求与算法设计的有效假设已发生质变而非量变,打破了该领域固有认知,明确了新一代代码模型的研究方向。

在算法设计层面,条件截断掩码与多样性驱动温度选择,对强化学习训练中训练稳定性与策略探索性之间的平衡提出了可执行的兼顾方案,具有超出代码生成任务本身的方法论参考价值。

本项目通过超过三十组受控实验完整整理34条训练经验与洞察,覆盖算法、数据、评估、上下文、温度等七大核心维度,是目前代码大模型后训练领域最为完整、有效的知识沉淀之一,对研究内容的整理分享是模型训练社区最有影响力的开源项目之一。

作者介绍:

MicroCoder第一作者李宗谦,剑桥大学自然语言处理博士生,剑桥信托学者,剑桥国际生全额博士奖学金,在微软亚洲研究院完成系列工作。他在微软、谷歌、红杉、真格等有实习工作经历,2025年完成一作论文9篇,发表于NeurIPS、ACL等会议,参与工作发表Nature,对学界、业界、创业有浓厚兴趣,是当前大语言模型领域值得关注的年轻研究员。

项目主页:

https://github.com/ZongqianLi/MicroCoder

算法论文:

https://arxiv.org/abs/2603.07777

数据集论文:

https://arxiv.org/abs/2603.07779

训练经验博客:https://github.com/ZongqianLi/MicroCoder/blob/main/MicroCoder-Insights.md

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

豆包AI中英互译使用技巧与详细步骤

豆包AI翻译效果不佳常因使用方式不当。针对不同场景,可采用五种方法:对话模式适合灵活的口语翻译;专用工具页确保语言精准对应;浏览器助手实现网页双语对照阅读;语音输入满足实时口语转译需求;文档上传功能则能批量处理专业文件并保留格式。

豆包AI接口收费标准与API价格详解

豆包AI接口采用按量计费模式,按输入输出Token消耗实时扣费。新用户享有一次性试用额度,过期自动失效。稳定业务可购买预付费资源包以降低成本,但需注意有效期。调用受RPM和TPM配额限制,超限即触发限流。特定API采用阶梯计费,单价随日调用量增加而降低。务必关注账户余额,避免服务中断。

Recraft AI注册失败解决方法 账号创建与登录问题全指南

注册RecraftAI时若遇页面无响应或收不到验证邮件,通常源于网络或设置问题。可检查邮箱垃圾箱并将相关域名加入白名单,或改用Google账号授权登录以跳过验证。此外,清理浏览器缓存、禁用插件、切换网络或使用合规邮箱密码也有助于解决。还可通过“忘记密码”功能触发激活邮件。

腾讯元宝辅导作业实测家长分享使用体验

腾讯元宝作为作业辅导工具,通过拍题答疑、作业批改、口语陪练、作文辅助和古诗文记忆五大核心功能,为家庭学习提供支持。这些功能不仅提供即时解析与批改,更注重引导解题思路、分析错误原因、纠正发音、优化表达及运用记忆法,旨在培养学习习惯与能力,而非简单给出答案。

OpenClaw AI文案自动生成实用技巧详解

使用AI生成文案时,内容质量不稳定常因提示策略与流程管控不足。可通过五步闭环方案提升:采用结构化提示明确任务;多轮迭代优化内容与事实;绑定动态数据源注入实时信息;设置人工核验确保合规安全;启用多模型协同融合优势,最终输出精编内容与详细日志。

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程

热门话题

热门话题