SSA架构算力骤降千倍成本仅为Opus百分之五

Transformer统治地位悬了!一款SubQ模型带着SAA架构横空出世,1200万上下文成本仅Opus的5%,计算量暴减千倍。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

Transformer架构的王座,似乎开始松动了。

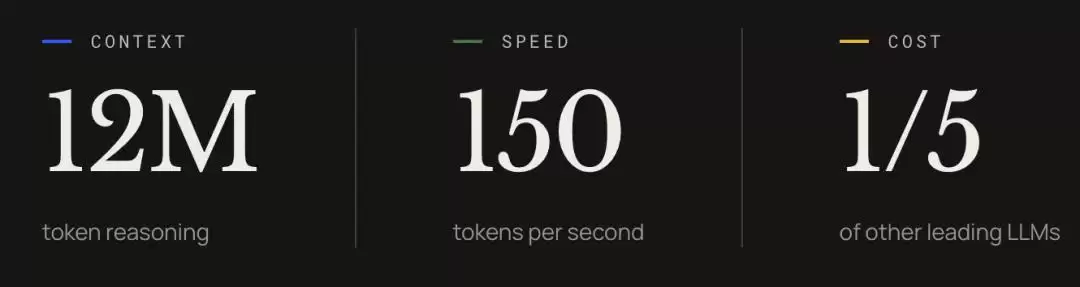

最近,一款名为SubQ的AI模型横空出世,其背后全新的架构思路,足以让整个行业侧目。它号称是全球首个基于完全亚二次方稀疏注意力架构(SSA)的模型,能够处理高达1200万Token的上下文长度。

关键在于,SubQ的SSA架构引入了一种“动态选择”机制。它不再像传统Transformer那样,强制计算序列中所有Token之间的关联,而是根据内容本身,智能地筛选出真正需要关注的焦点。这种思路上的根本转变,带来了惊人的效率提升——据称,其计算量相比标准Transformer直接减少了1000倍。

实验数据显示,在处理100万Token的上下文时,SubQ的速度比经过极致优化的FlashAttention-2还要快52倍以上,而成本更是不到Claude Opus的5%。

更令人惊讶的是,打造出这一架构的Subquadratic公司,总部位于迈阿密,整个团队仅有13人。消息一出,便在AI社区引发了激烈讨论。有行业观察者甚至评论道:“如果这一切都是真的,那么Anthropic和OpenAI的估值恐怕要归零了。” 也有人认为,这或许才是大型语言模型未来真正实现规模扩展的正确路径。

Transformer的“原罪”:九年未解的效率困局

自2017年谷歌那篇划时代的论文《Attention Is All You Need》发表以来,Transformer架构便奠定了其在AI领域的统治地位。过去九年,从GPT到Claude,再到Gemini,几乎所有前沿大模型都建立在同一个核心基础之上:密集注意力机制。

然而,这种机制存在一个根本性的效率瓶颈。它的工作方式堪称“暴力”:序列中的每个Token都需要与所有其他Token进行一次关联计算。这就导致了著名的“二次方复杂度”问题——上下文长度每增加一倍,所需的计算量便会飙升四倍。

后果显而易见:输入越长,模型运行就越昂贵、越缓慢,也越容易达到硬件极限。这直接解释了为何当前主流大模型的上下文窗口大多被限制在百万Token级别左右。并非技术上无法做到更长,而是经济上难以承受。SubQ的出现,正是试图从根本上改写这个效率等式。

SSA架构:核心思路是“做减法”

SubQ实现突破的关键,在于其SSA架构——亚二次方稀疏注意力。其设计思路出奇地清晰:既然在训练好的模型中,绝大多数注意力权重都趋近于零,那么为何还要耗费巨量算力去计算它们呢?

SSA采取了一种更聪明的策略。对于每一个查询(Query),模型会基于其内容语义,在长序列中动态地选择出真正值得关注的那些位置,然后仅在这些选定的位置上进行精确的注意力计算。换句话说,它只计算那些有意义的交互,而主动跳过了超过99%的、贡献微乎其微的计算。

这一架构带来了三个核心特性:

线性扩展: 计算量仅随选中的关键位置数量线性增长,而非随整个序列长度呈二次方爆炸。这意味着上下文长度翻倍,成本也大致只翻倍,而非四倍。

内容依赖路由: 模型根据语义相关性决定关注哪里,而非固定的位置偏移。无论关键信息藏在序列的第3个还是第1100万个Token,都能被有效定位。

精确检索: 它不像循环神经网络那样将历史信息压缩成固定维度的状态,而是保留了从原始上下文中任意位置精确检索信息的能力。

本质上,SSA的创新不在于“如何把密集注意力算得更快”,而在于“如何让模型聪明地减少不必要的注意力计算”。

减少的计算开销,直接转化为了实实在在的速度优势。

性能实测:速度与成本的碾压式优势

Subquadratic公司公布的一系列基准测试数据,每一项都极具冲击力。

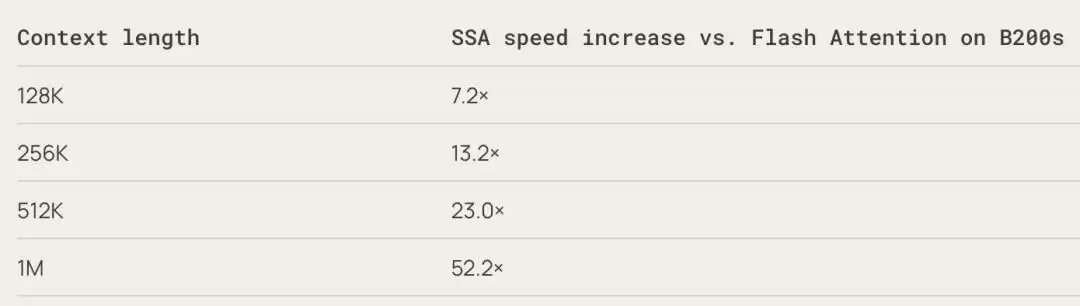

在100万Token的序列长度上,SSA架构相比标准的密集注意力配合FlashAttention-2优化,速度快了52.2倍。随着上下文增长,优势呈指数级扩大:在12.8万Token上快7.2倍,25.6万Token上快13.2倍,51.2万Token上则达到23倍。这完美印证了SSA的线性扩展特性——传统方法越长越慢,而SSA则越长越显划算。

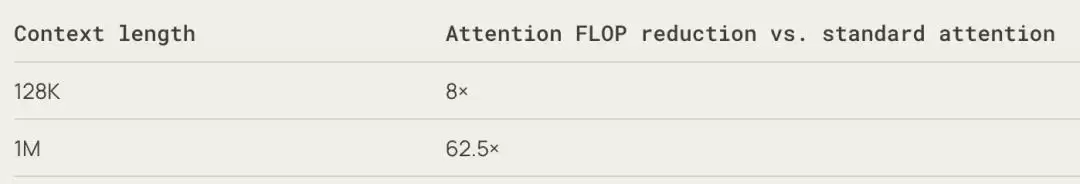

算力消耗的降低更为惊人。在100万Token下,注意力部分的浮点运算次数减少了62.5倍;当序列长度达到1200万Token时,这一数字飙升到了近1000倍。

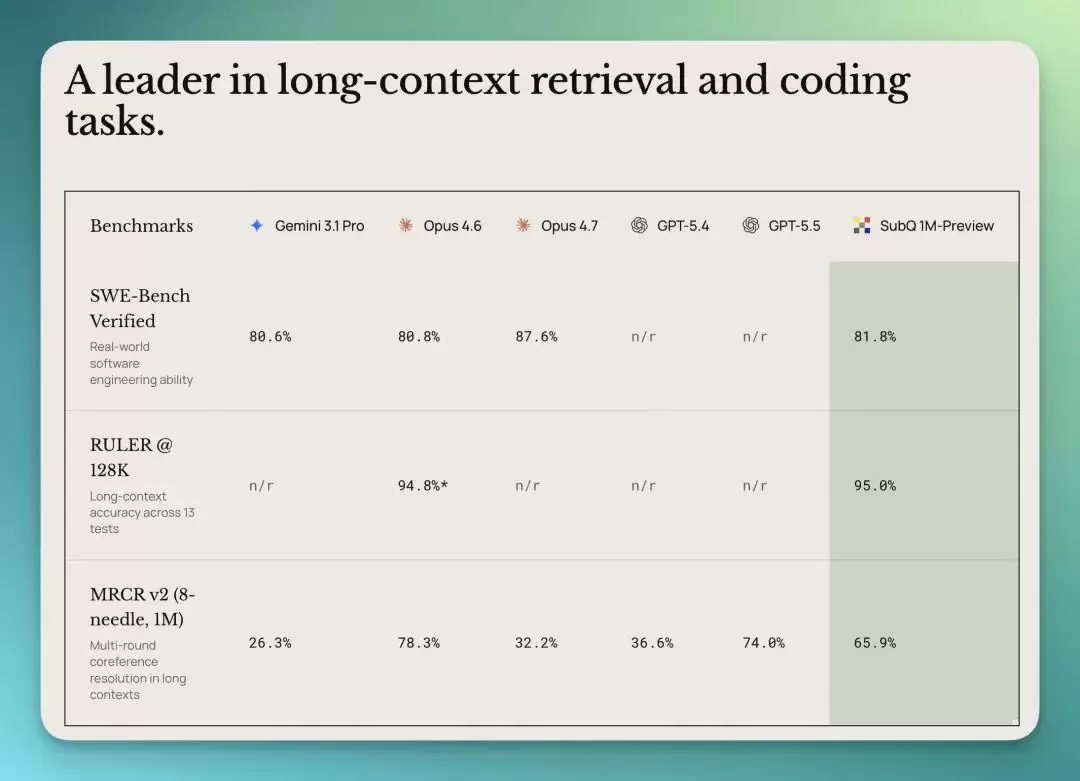

成本对比则更为直观。在RULER 128K基准测试上,SubQ的调用成本约为8美元,而达到相近效果的Claude Opus则需要2600美元,两者相差超过300倍。

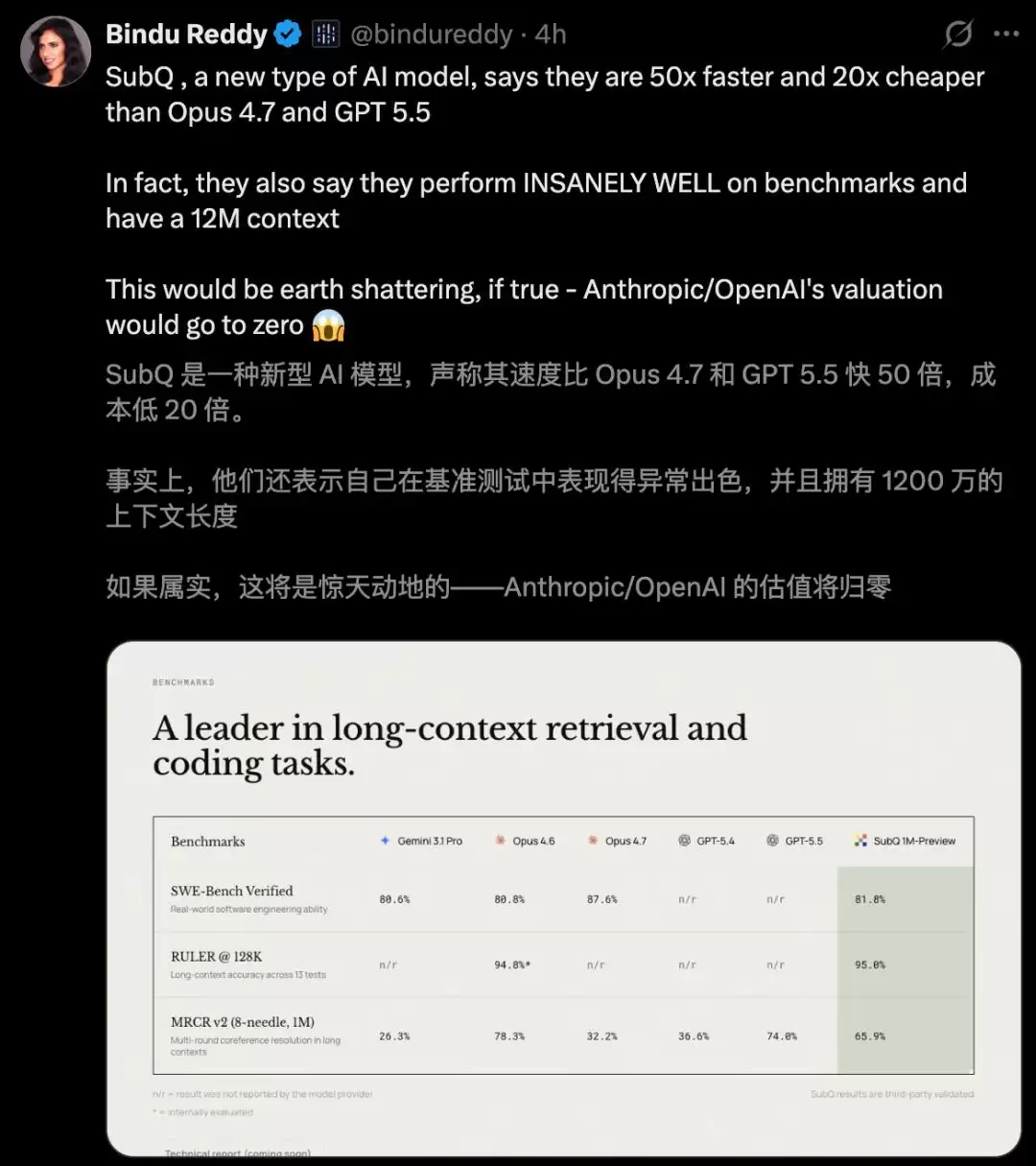

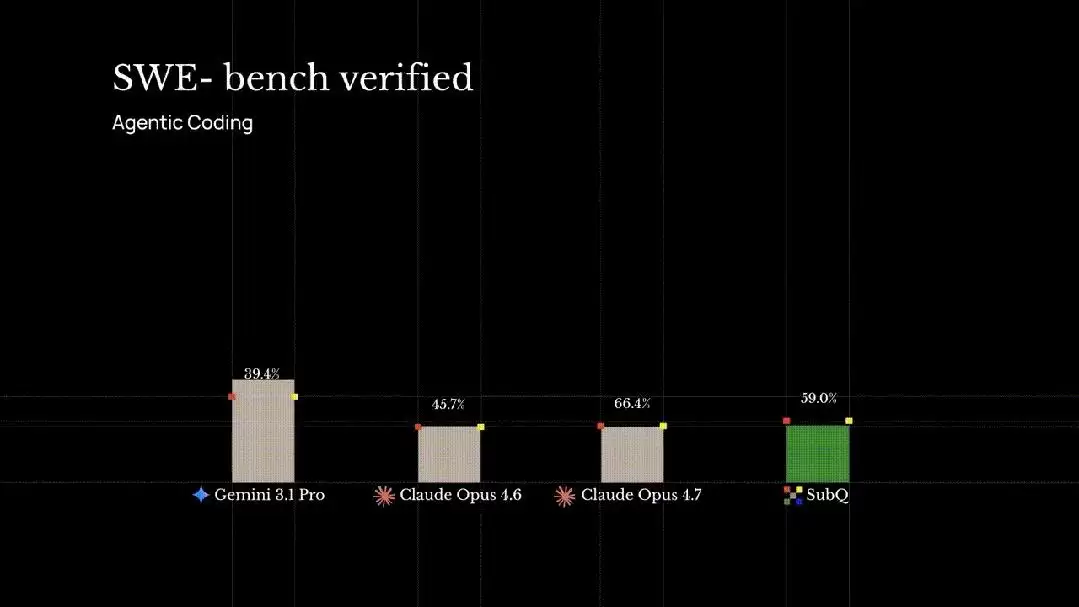

最关键的是,这些速度和成本优势,并未以牺牲模型能力为代价。在多项核心基准测试中,SubQ表现出了强大的竞争力:

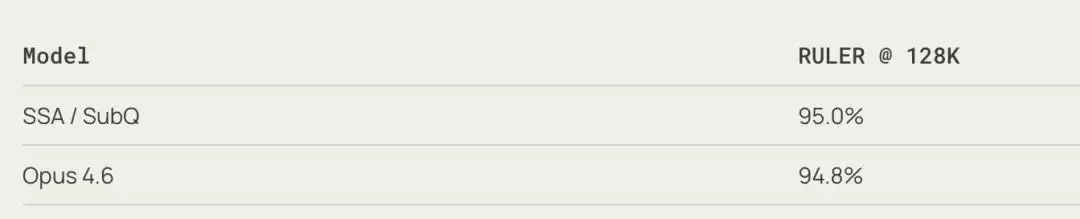

- RULER 128K(长上下文理解): SubQ得分95%,略高于Opus 4.6的94.8%。

- SWE-Bench Verified(代码工程任务): SubQ得分81.8%,超过了Opus 4.6的80.8%。

- MRCR v2(长上下文信息检索): SubQ获得65.9%,虽低于Opus 4.6的78%,但显著超越了GPT-4o的39%和Gemini 1.5 Pro的23%。

综合来看,这组数据揭示了一个令人震撼的事实:一家尚处于种子轮阶段的初创公司,以其架构创新,用不到行业巨头5%的成本,在多项关键任务上达到了与顶尖模型持平甚至超越的水平。

凭借1200万Token的超长上下文能力,SubQ可以轻松将整个代码库、长达数月的项目记录或长期运行的智能体状态一次性输入处理,而成本据说仅为传统方法的五分之一。

如果其宣称的性能经得起独立验证,这无疑是Transformer架构问世以来,最具碘伏潜力的突破之一。

13人团队:小公司的大野心

Subquadratic公司成立于2024年,目前已获得2900万美元的种子轮融资,估值达到5亿美元。公司由两位联合创始人领导:CEO Justin Dangel和CTO Alexander Whedon。

其研究团队虽仅有11人,但全部拥有博士学位,成员背景来自Meta、谷歌、牛津大学、剑桥大学、Adobe等顶尖机构。一个有趣的细节是,这家公司前身名为Aldea,最初专注于语音模型,后来才全面转向注意力架构的基础研究。

此次发布,Subquadratic一次性推出了三条产品线:

- SubQ API: 提供完整的1200万Token上下文处理能力。

- SubQ Code: 一个命令行编码智能体,能够将整个代码库作为上下文进行分析。

- SubQ Search: 一款深度研究工具,发布初期将免费提供。

行业反响:碘伏性突破还是过度营销?

SubQ的发布迅速在AI社区内引发了两极分化的讨论。正如一位AI从业者所言,SubQ面临两种极端的可能性:它要么是Transformer以来最重要的架构突破,要么就可能成为AI领域的“Theranos”(指曾轰动一时后被证实为骗局的血液检测公司)。

支持者认为这是2026年最令人兴奋的AI发布之一,Subquadratic可能找到了萨姆·奥特曼曾预言的那种“另一个架构”的重大突破。许多人对这种从根本上提升效率的路径表示期待。

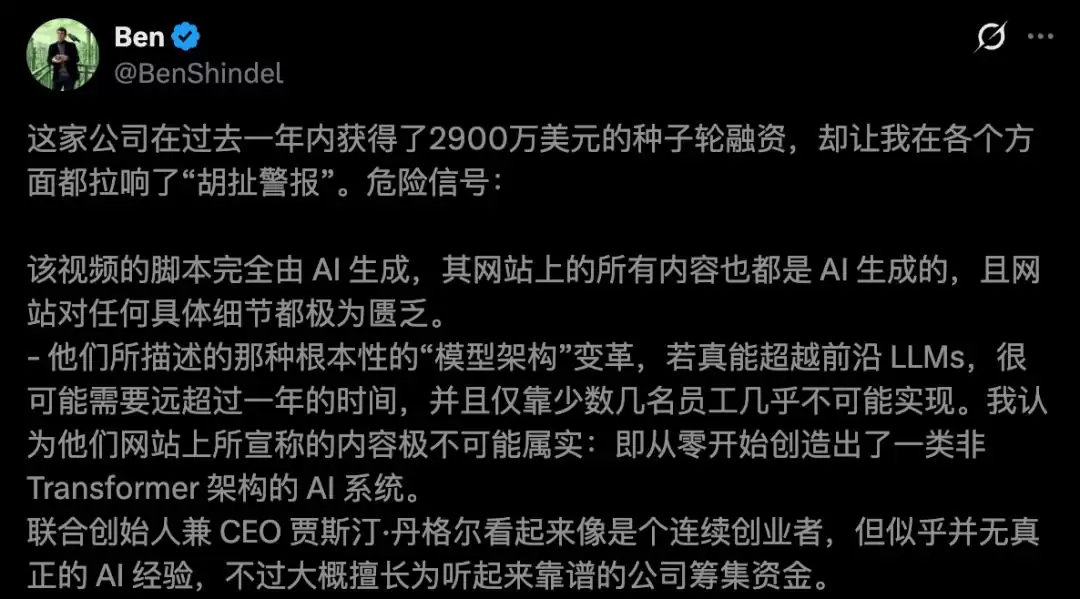

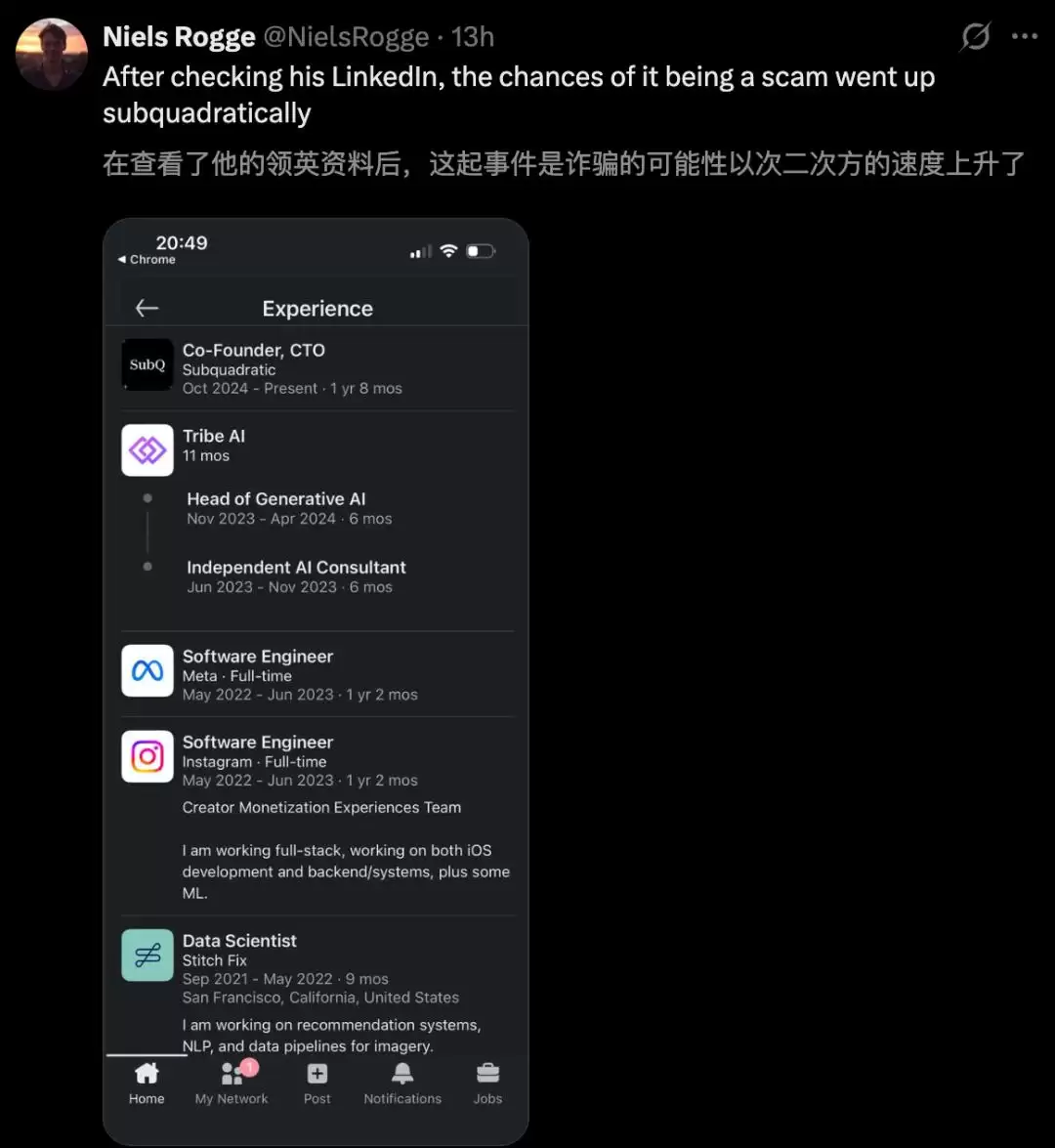

然而,怀疑论者的声音同样尖锐。有人质疑其技术真实性,尤其是在审视了创始人的背景后,认为这可能是一场营销噱头。

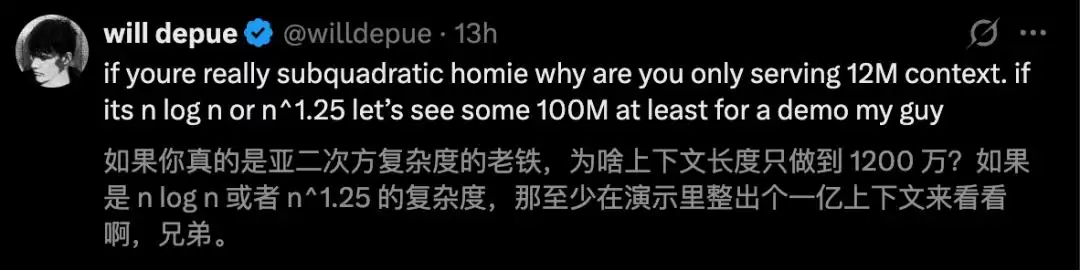

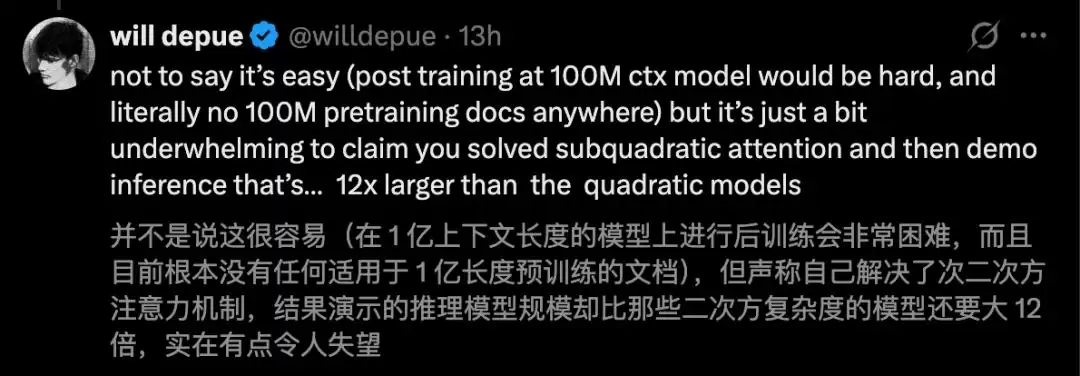

前OpenAI研究员Will Depue更是连续发文指出,SubQ的技术“几乎可以确定是基于Kimi或DeepSeek已有的稀疏注意力模型进行的微调”,而非其宣称的全新架构。

AI领域见证过太多“发布会即巅峰”的故事,华丽的PPT演示与真实世界的大规模可靠部署之间,往往存在一条巨大的鸿沟。但另一方面,正因为这项技术潜在的碘伏性如此巨大,整个行业也无法对其视而不见。最终的答案,恐怕要等到详细的技术报告公开、并由第三方机构进行独立的基准测试复现后,才能真正水落石出。

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

DeepSeek获国家大基金领投估值近450亿美元

国家大基金或领投DeepSeek,其估值在谈判中已接近450亿美元。尽管公司商业化进程有限,但投资者看重其长期技术潜力。此次投资若达成,将是国家大基金首次大规模进入大模型领域,标志着从硬件投资到软件核心的关键跨界,有望推动中国AI产业形成从算力、制造到模型层的协同新格局。

陶哲轩推荐ClaudeCode审稿工具15分钟高效完成论文修改

陶哲轩利用ClaudeCode处理论文审稿意见,仅用15分钟便高效完成了修改,并发现了审稿报告中的一处笔误。他设想将语法校对等繁琐工作交给AI处理,而让研究者专注于核心难题。这体现了AI作为“副驾驶”辅助研究、提升效率的趋势,此前AI已帮助解决多个数学难题。

华人团队打造AI生图新势力香蕉与GPTImage之外的第三种选择

LumaAI发布图像模型Uni-1 1,在第三方盲测榜单中位列全球第三。该模型将推理与生成整合,显著提升品牌视觉一致性。其API价格低廉,单图成本低至0 04美元,已获阿迪达斯、阳狮等企业采用,用于广告本地化、电商视觉等场景。团队由华人学者领衔,不足15人,实现了技术突破与商业落地。

Anthropic用员工手册训练AI将失控率从54%降至7%

研究提出“模型规范中期训练”(MSM)方法,在传统对齐微调前增加阶段,让AI先学习规范背后的原理与理由。实验显示,该方法使AI智能体在模拟企业环境中的失控率从54%大幅降至7%,并减少了对齐微调的数据需求。研究表明,理解行为准则背后的“为什么”比仅示范数据更有效。

Claude获亚马逊巨额投资与算力支持贝索斯押注AI未来

Anthropic与亚马逊达成十年千亿美元AI基础设施合作,锁定5吉瓦算力用于Claude模型。亚马逊追加投资,总投资额近330亿美元,以应对用户激增带来的算力需求。行业竞争正从模型转向基础设施,算力成为核心护城河。双方深度绑定,但Anthropic保持运营独立并实施多云战略。

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程

热门话题

热门话题