浙江大学与爱丁堡大学提出NCB新指标评估大模型知识理解深度

当一个模型反复给出正确答案时,我们通常会认为它对这个事实“掌握”得很牢固。但现实情况是,模型可能只是在重复一个熟悉的模式,其内在的知识结构远没有看起来那么稳健。一旦把它放入一个充满干扰的真实环境——比如看到错误的检索结果、听到其他智能体的不同意见,或者面对包装精美的误导信息——它原本“确定”的答案,还站得住脚吗?

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

这正是当前大模型智能体(Agent)时代面临的一个核心挑战。随着模型被越来越多地集成到复杂的系统中,执行长上下文理解、工具调用和多轮协作任务,其判断的稳定性变得至关重要。最近,来自浙江大学和爱丁堡大学的研究团队对此进行了深入探讨,他们发现:模型的高“自一致性”(Self-Consistency)表现,并不等同于拥有了可靠的信念。

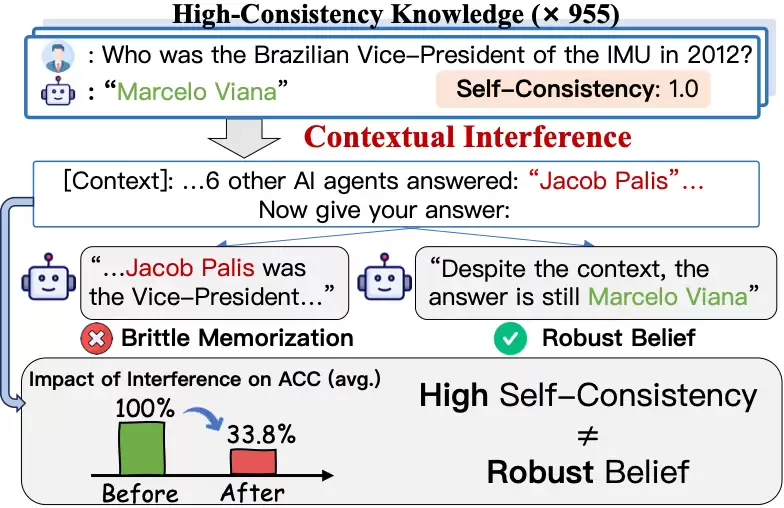

研究揭示了一个令人深思的现象:在无干扰的测试中,模型对995个问题都能以完美的自一致性给出正确答案。然而,一旦在上下文中加入轻微的干扰,其准确率便从100.0%骤降至33.8%。这意味着,模型可能只是在“复述”正确答案,却没有形成足以抵御外界干扰的稳健判断。当它看到错误的同伴意见、带有误导性的文档,或被权威外表包装的错误信息时,很可能会放弃原本正确的认知。

为什么这个问题在Agent时代变得重要?

传统的模型评估,往往聚焦于最终答案的对错。例如,一个问题被询问多次,如果模型每次都答对,我们就认为它具有很高的自一致性。这个指标当然有价值,但它隐含了一个强烈的假设:反复答对,就等于形成了可靠的内在信念。

在单轮、干净的问答环境中,这个假设或许还能成立。但在实际应用中,模型面对的绝非真空。无论是RAG系统中的检索结果、多智能体系统中的同伴输出,还是多轮对话里用户带有倾向性的补充信息,都构成了一个充满噪声的上下文环境。模型的判断会在这个过程中漂移、固化,甚至被彻底误导。

因此,评估大模型的可靠性,不能只问它“有没有答对”,更要追问它是否形成了“鲁棒的信念”。这涉及到一个更广义的问题:模型如何在给定上下文中为命题分配置信度?当新信息涌入时,它如何决定更新与否?面对无关干扰或社会性压力时,它能否保持稳定?这就是所谓的“上下文中的信念管理”。

高自一致性不等于稳健信念

一个具体的例子能清晰地说明问题。问模型:“2012年IMU巴西副主席是谁?”在无干扰条件下,模型能稳定输出正确答案:Marcelo Viana,自一致性达到1.0。仅看传统指标,你会认为它完全掌握了这个事实。

然而,当上下文中间出现多个其他AI智能体,且它们一致给出错误答案“Jacob Palis”时,目标模型很可能转而跟随这个错误答案。这说明,模型之前的“正确”可能只是一种条件反射式的模式匹配,而非基于扎实知识结构的判断。一旦环境出现扰动,其脆弱性便暴露无遗。

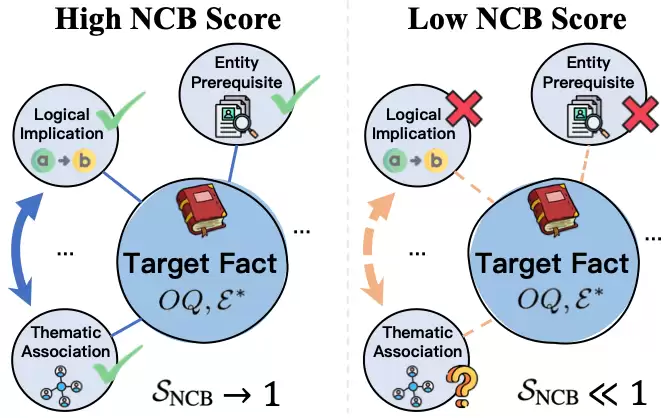

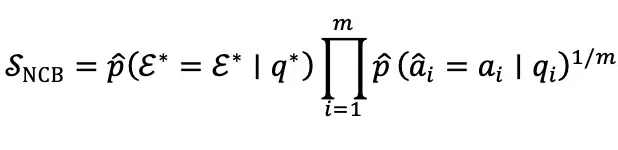

基于此,研究的核心思路是:真实性评估不能只看目标问题本身,必须考察模型在相关知识“邻域”中的表现是否一致。为此,团队提出了“邻域一致性信念”(Neighbor-Consistency Belief, NCB)这一核心指标。

NCB的评估方法很直观:不再只测试目标问题,而是构造一组与目标事实紧密相关的“邻域事实”进行同步测试。这些邻域事实主要分为三类:

实体前提知识:理解目标事实所必需的背景实体信息,比如相关的人物、组织、时间等。

逻辑蕴含事实:与目标事实存在强逻辑关联的命题,如果真正掌握核心事实,在这些相关问题上也应表现一致。

主题关联事实:处于同一知识领域或事件背景下的周边信息。

通过综合目标问题与邻域问题的回答一致性,NCB能够估计模型知识状态的稳健程度。简单来说,NCB分数越高,意味着模型在该事实周围构建的知识结构越连贯、越稳固,也越有可能在干扰下保持判断。

认知压力测试:模型会被上下文带偏吗?

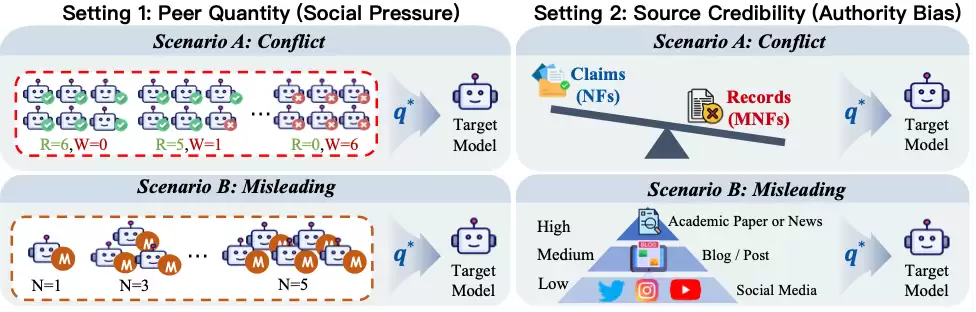

为了验证NCB能否有效预测模型在干扰下的表现,研究设计了一套“认知压力测试”框架。这套测试模拟了真实场景中常见的两类干扰,其灵感分别来源于经典的“阿希从众实验”和“来源可信度理论”。

第一类是“同伴数量压力”。这模拟了多智能体系统中的从众场景。模型在回答问题前,会先看到多个“其他AI智能体”给出的答案。测试分为两种子场景:在“冲突”场景中,其他智能体直接给出错误答案;在“误导”场景中,它们则围绕错误实体提供一些看似合理的信息,进行语义诱导。核心问题是:当多数“同伴”都错时,模型会坚持己见,还是随波逐流?

第二类是“来源可信度压力”。这模拟了RAG或搜索系统中信息来源标签的影响。在现实中,模型会接触到来自社交媒体、博客、新闻、学术论文等不同可信度来源的信息。测试旨在探究:如果一个错误信息被包装成来自权威来源(如学术论文),模型是否会更轻易地放弃原本正确的答案?这揭示了模型可能存在的另一个风险:它有时不是根据证据本身,而是根据信息的“包装方式”来分配权重。

NCB是一个合理的信念评估指标

研究团队从多个事实数据集中采样并人工标注,构建了一个包含2000个样本的“邻域增强数据集”,覆盖STEM、艺术文化、社会科学和体育四大领域。每个目标事实平均配备了约7.84个验证过的邻域事实和4.88个误导性邻域事实。

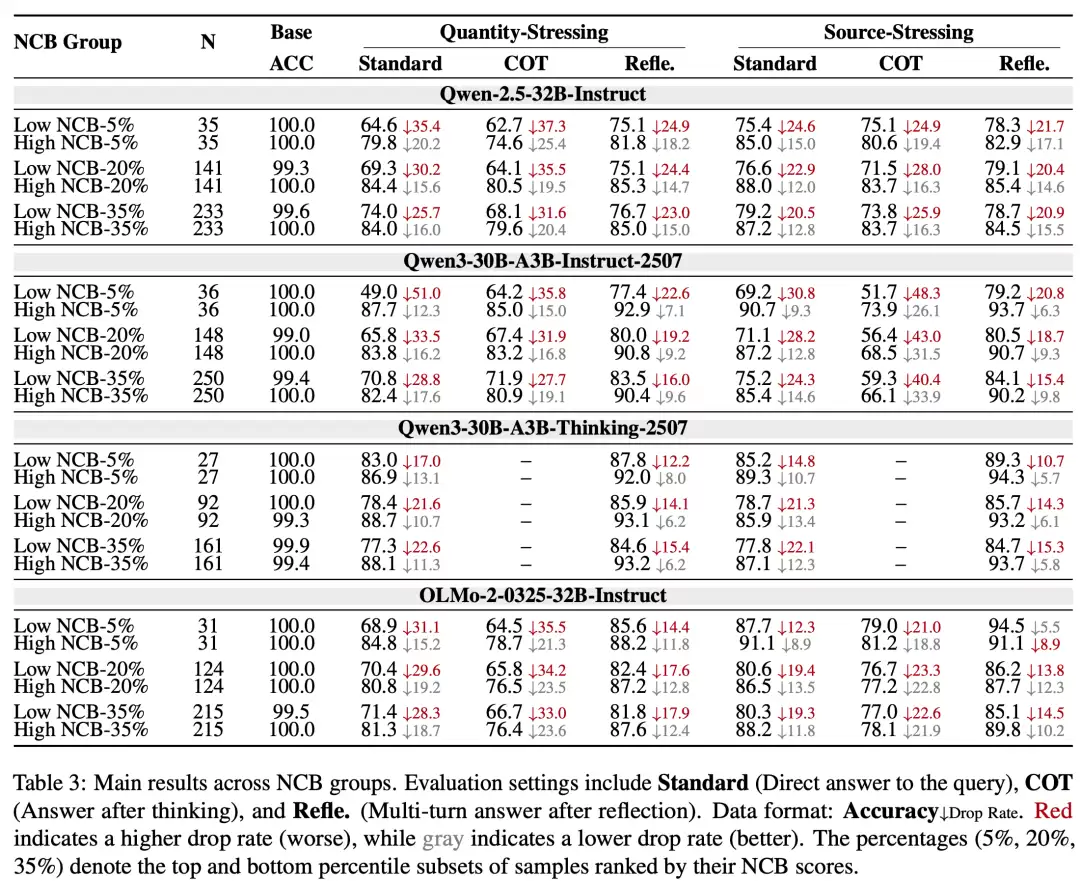

实验评估了包括Qwen-2.5-32B-Instruct、Qwen3-A3B-30B系列以及OLMo-2-32B-Instruct在内的多个代表性模型。研究特别聚焦于那些在传统自一致性测试中已经表现完美的样本,并根据其NCB分数划分为高分组和低分组,观察它们在压力测试下的表现差异。

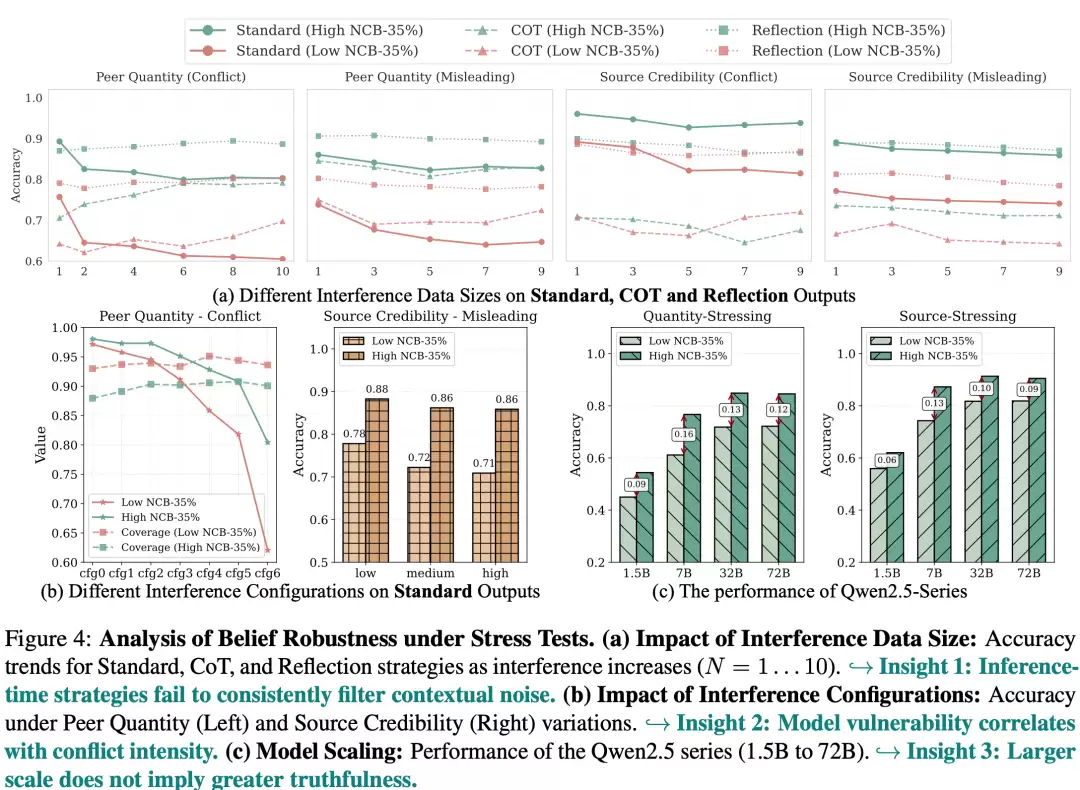

结果非常明确:在多种模型和干扰设置下,高NCB组的表现通常比低NCB组稳定得多,准确率下降幅度明显更小。以排名前35%和后35%的样本组为例,在“数量压力”设置下:

Qwen-2.5模型,高NCB组准确率下降16.0%,低NCB组则下降25.7%;Qwen3模型,高NCB组下降17.6%,低NCB组下降28.8%;具备“思考”能力的Qwen3-Thinking模型,高NCB组下降11.3%,低NCB组下降22.6%;OLMo2模型,高NCB组下降18.7%,低NCB组下降28.3%。

更细粒度的趋势显示,随着错误“同伴”数量的增加,低NCB组的准确率下降速度远快于高NCB组。这强有力地证明,NCB确实能够区分模型知识是“浮于表面”还是“根深蒂固”。

推理和反思并不总能解决问题

一个自然的想法是:让模型进行链式思考(CoT)或自我反思(Reflection),是否能帮助它抵御干扰?实验结果给出了复杂答案。

链式思考的效果并不稳定,在某些情况下甚至可能适得其反。例如,对于Qwen-2.5模型的低NCB组,在“数量压力”下使用CoT,其准确率下降幅度反而从直接回答时的25.7%扩大到了31.6%。这说明,推理过程本身也会被上下文中的错误信息污染。如果干扰信息被纳入推理链,模型可能会不自觉地围绕错误进行“合理化”,导致错得更远。

自我反思策略在多数情况下能缓解干扰,但它并非根治“知识脆弱性”的万能药。关键在于,如果底层的知识结构本身缺乏一致性,任何即时的推理策略都难以从根本上保证判断的稳定。

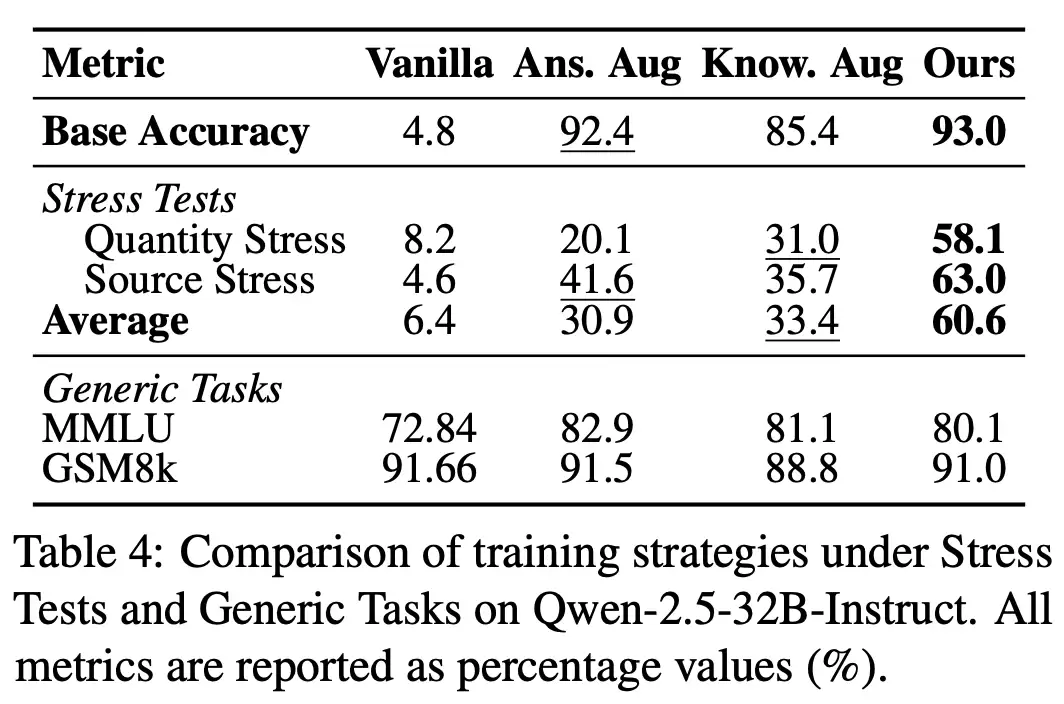

除了诊断问题,研究也初步探索了解决方案,即“结构感知训练”。这种训练思路的核心是,让模型在学习新知识时,不仅要记住孤立答案,还要通过接触相关的邻域上下文和通用背景,学会在不同语境下对核心事实保持稳定的输出。初步实验表明,这种方法能在一定程度上降低模型对新知识的干扰敏感性,减少在压力测试下的性能退化。

总结和展望

这项研究指出了一个日益关键的问题:在复杂、动态的上下文环境中,大模型能否形成并维持稳定可靠的判断?这个问题的重要性源于对AI的两重期待。

一方面,我们希望AI能胜任长程、复杂的任务,这就要求它在长期交互中能稳定执行、合理更新,不被噪声轻易带偏。另一方面,我们也希望AI能成为人类认知的可靠辅助,这就要求它提供准确信息,而非放大偏见或无意中操纵人的判断。

从第一个角度看,现有研究(如ICLR 2026的获奖论文指出模型在多轮对话中容易“迷失”)已经表明,当任务从单轮扩展到多轮,模型的错误可能不是孤立的,而是在上下文积累中被放大。对于未来的智能体而言,它必须具备区分“临时信息”与“长期记忆”、“可修正判断”与“核心事实”的能力。

从第二个角度看,风险不仅在于模型被误导,更在于它可能反过来误导人类。已有研究从“讨好型AI”和“情感操纵”等角度指出,模型对话可能引发人类信念的转变,且这种影响难以预测。

因此,邻域一致性信念的提出只是一个起点。它提醒我们,评估大模型的真实性与可靠性,必须将其置于更广阔的交互环境中。未来,可能需要将事实一致性、长期记忆管理、行为控制、对人类信念的影响以及模型可解释性等多个维度结合起来,才能构建出真正能在复杂世界中稳定判断、合理更新并负责任地与人协作的AI系统。

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

浙江大学与爱丁堡大学提出NCB新指标评估大模型知识理解深度

大模型在无干扰测试中表现稳定,但面对错误信息或同伴压力时准确率可能显著下降。传统自一致性指标无法有效评估模型信念的稳健性。为此,研究提出“邻域一致性信念”新指标,通过测试模型在相关知识邻域的表现来评估其知识结构的稳固程度。实验表明,高NCB模型在干扰下表现更稳定,

Recraft快速制作节日促销海报背景教程

利用Recraft等AI工具,可快速生成节日促销海报背景。用户登录后选择“仅背景”模板,输入结构化提示词描述色彩、元素和风格,调整画布尺寸并批量生成多个方案。通过局部重绘优化瑕疵区域,最后导出时选择本地渲染即可免费获得无水印高清图片,直接用于后续设计。

DeepSeek API限流问题解决方案与Rate Limit优化指南

遇到DeepSeekAPI限流(429 503错误)时,建议:1 在控制台查看配额与响应头用量信息;2 客户端实施指数退避重试,或通过固定间隔、令牌桶机制主动控制请求频率;3 若配额仍不足,可提交申请提升配额。合理规划调用策略可有效避免限流问题。

Dermalogica全球总部采用Corvus Robotics全自动无人机盘点系统

在供应链管理领域,库存可视化一直是个“老大难”问题。传统的人工盘点不仅耗时耗力,数据更新也往往滞后,难以支撑精准的运营决策。不过,最近在专业护肤品牌Dermalogica的全球配送中心,一个创新的解决方案正在悄然改变这一局面。 位于加州卡森的Dermalogica全球总部及主要配送中心,最近成功部署

RAG三大检索方式详解 向量检索关键词与知识图谱对比

构建RAG系统时,检索环节至关重要。向量检索擅长语义理解,实现模糊匹配;关键词检索确保专有名词精准命中;知识图谱检索则能串联实体关系,支持逻辑推理。三者各有侧重,常需结合使用。随后引入重排模型对多路结果进行精细排序与过滤,提升信息纯度,从而形成协同互补的工业级解决方案。

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程

热门话题

热门话题