AI评估能力进化史 EVOLM揭示模型自定规则的结构化进程

强化学习已成为大语言模型后训练阶段的关键技术,但一个根本性难题始终存在:可靠的奖励信号从何而来?依赖昂贵的人工标注、存在供应链风险的闭源模型(如GPT-4)、易被“破解”的标量奖励模型,或仅适用于数学、代码等有标准答案领域的可验证奖励,都各有局限。近期,来自华盛顿大学、AI2和宾夕法尼亚大学的研究团队提出了一种创新解决方案:让模型自主生成评分标准,并利用这套标准进行自我训练,实现协同进化。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

实验结果令人瞩目:基于Qwen3-8B训练的评分标准生成器,在RewardBench-2基准上的表现超越了GPT-4,领先幅度达25.7%。使用该标准训练出的策略模型,在OLMo3-Adapt的12项基准测试中平均得分达到69.3%,不仅比使用GPT-4生成标准训练的策略高出3.9%,甚至超越了当前最先进的8B标量奖励模型SkyWork-RM训练的策略,优势达16%。

外部监督的固有瓶颈

论文开篇即指出当前奖励机制的瓶颈:各类外部监督方式均存在天花板。人类判断难以评估超越自身认知的模型输出;依赖闭源API带来可控性与安全风险;标量奖励模型易遭遇策略模型的“奖励破解”攻击;而可验证奖励的适用范围又过于狭窄。

研究揭示了一个关键洞见:语言模型在预训练阶段已内化了海量的评估性知识。强化学习的任务,应是激发并结构化这些内在知识,而非从零开始灌输外部标准。真正的挑战在于,如何将模型隐含的评估能力,转化为可用于训练的可操作奖励信号。

为此,论文提出了一个两阶段评估框架:首先由“评分标准生成器”明确“衡量哪些维度”,再由“打分器”依据这套具体、可核查的标准进行评分。这种方法的优势在于:对于小模型独立判断困难的复杂问题,提供明确的评分项能极大提升判断的可靠性;同时,自然语言形式的评分标准具备可读性、可审查性,并能在不同打分器间复用。

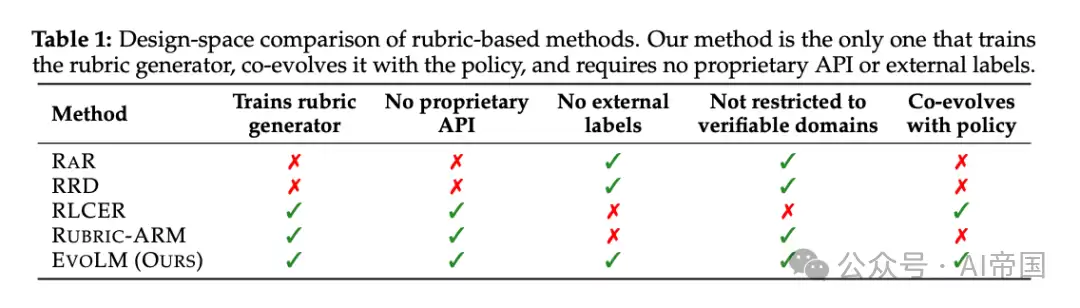

[Table 1: 各类基于rubric的RL方法设计空间对比]RAR、RRD依赖闭源API;RLCER、Rubric-ARM需要外部标签;EVOLM是唯一同时满足“训练rubric生成器”、“不依赖闭源API”、“不需要外部标签”、“不局限于可验证领域”、“与policy共同进化”五项条件的方法。

图片

图片

定义并优化“评分标准的质量”

本项工作的核心突破,在于为“评分标准的质量”提供了一个可直接优化的定义:一套优质的标准,应能帮助打分器,为更优的回答给出更高的分数。

形式化表述为:给定一个偏好对(回答A优于回答B),若打分器在特定评分标准下给A的分数高于B,则该标准被视为“具备辨识力”。研究将评分标准视为潜变量,通过变分推断推导出证据下界优化目标:标准生成器需最大化“打分器正确重建偏好顺序”的对数似然,同时受KL散度约束,使其输出接近参考模型的分布。

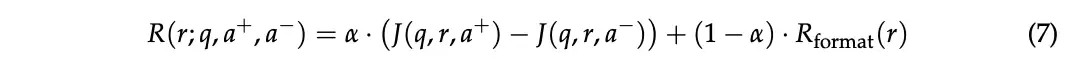

由于评分标准是离散文本,研究采用策略梯度进行优化。在实际训练中,使用“边际差+格式校验”的组合来替代log-sigmoid奖励:

图片

图片

其中α=0.7,R_format是一个{0,1}的JSON格式校验项,用于确保生成的评分标准符合打分器可解析的既定模式。

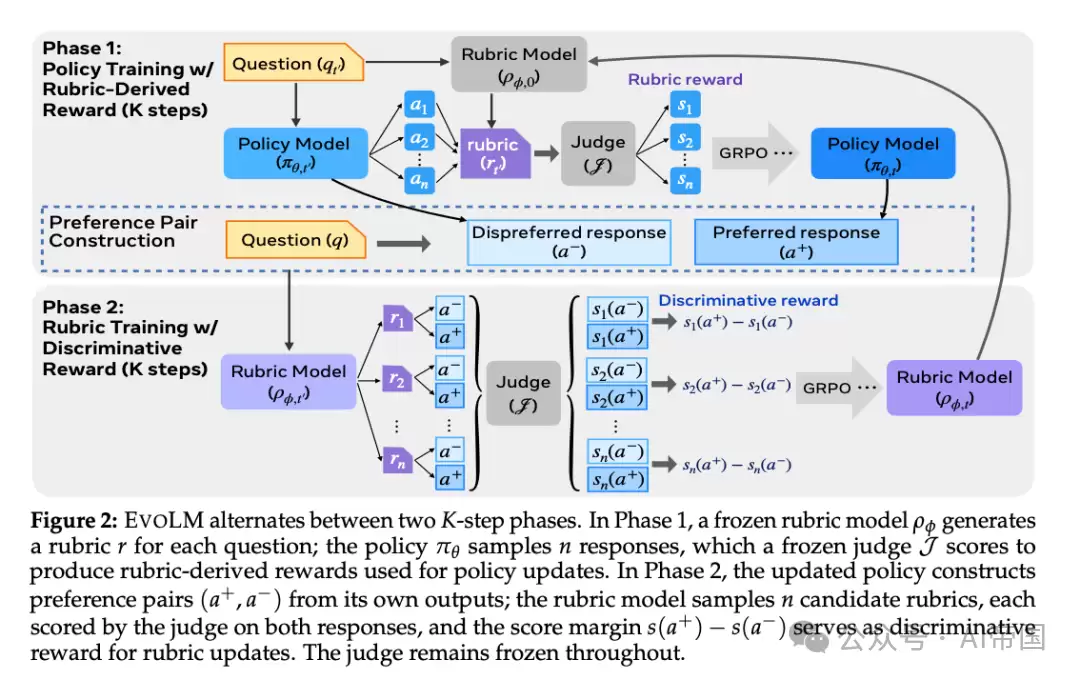

[Figure 2: EVOLM的双阶段交替训练流程]阶段1,冻结rubric生成器ρ,policy针对每个问题采样n个回答,judge按rubric打分作为policy的奖励。阶段2,更新后的policy构造偏好对(a+, a-),rubric生成器采样n个候选rubric,judge在两个回答上打分,score(a+)−score(a-)的差作为rubric生成器的奖励。judge全程冻结。

图片

图片

方法实现的关键细节

研究采用了单模型共享参数的设计,使用同一个Qwen3-8B模型通过不同提示词来分别扮演策略模型和评分标准生成器。这一设计将显存占用减半,而消融实验表明,其下游效果与使用两个独立模型的配置几乎一致(均为69.3%)。打分器则固定使用冻结的Qwen3-1.7B,从而确保奖励信号的改进完全源于评分标准生成器自身的进化。

交替训练的节奏K设置为50。即策略模型先训练50步,然后评分标准生成器再训练50步,如此循环。实验发现,K值过小(如2)会导致双方均未充分收敛,K值过大(如100)则会使标准生成器训练时所依赖的策略分布过于陈旧。K=50是消融实验中下游性能表现最佳的点。

训练所需的偏好对完全无需外部标注。论文提供了三种构建方法,默认以随机均匀的方式采样使用:

(1)时序对比:将当前训练步生成的回答作为正例,从20到100步之前的历史生成中采样一个作为负例。随着训练推进,“更早”的回答被逐渐替换,自然形成了一种课程学习机制。

(2)问题回推:给定一个正例回答,让策略模型推断其原本对应的问题,再用这个推断出的问题生成一个负例回答,以此检验评分标准是否能判断“回答是否切题”。

(3)按标准生成:使用当前的评分标准引导策略模型生成一个正例回答,同时在不使用标准的情况下生成一个负例回答,直接验证评分标准对生成质量的指导作用。

训练数据来源于Tulu 3偏好数据集去重后的大约27.1万条提示,覆盖对话、指令遵循、数学推理、代码生成、科学问答、角色扮演等多种类型。策略模型和标准生成器均使用GRPO方法训练,每个提示采样8个回答,学习率为1e-6,KL系数为0.001。

一个反直觉的重要发现

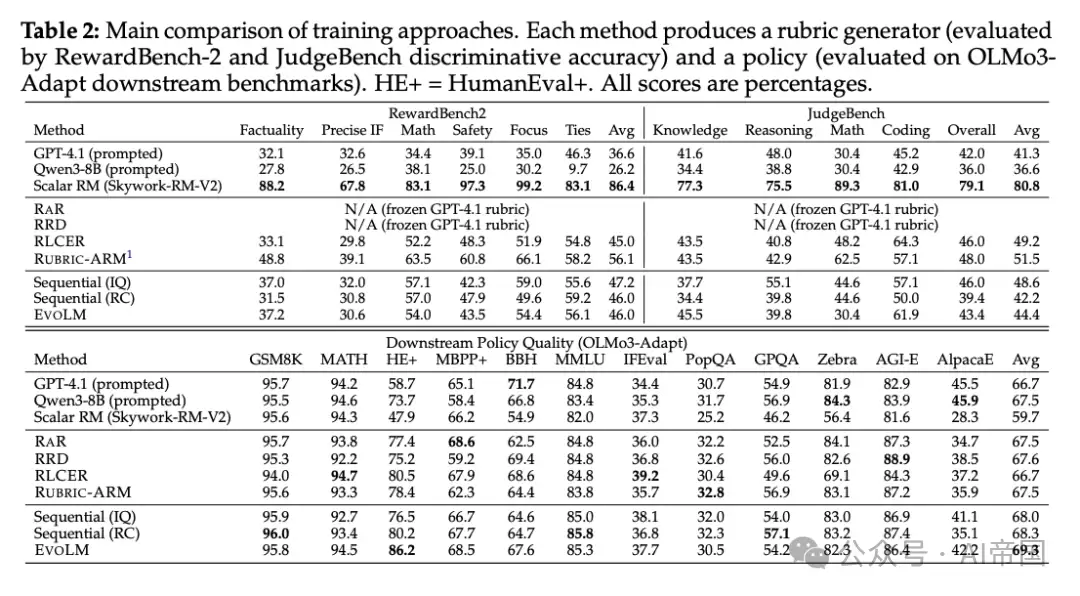

[Table 2: 各方法在rubric质量和下游policy质量上的对比]EVOLM在OLMo3-Adapt上12项平均69.3%,领先GPT-4.1 prompted(66.7%)、Qwen3-8B prompted(67.5%)以及RAR、RRD、RLCER、RUBRIC-ARM四种已有rubric-based RL方法(66.7%–67.6%)。代码生成提升最大(HumanEval+ 86.2% vs 次优80.5%)。

图片

图片

最反直觉的结果出现在与标量奖励模型的对比中。SkyWork-RM-V2在RewardBench-2上获得了86.4%的高分(EVOLM为46.0%),在JudgeBench上也达到80.8%,在两个榜单上都大幅领先。然而,用它训练出的策略模型,在下游任务上的平均得分仅为59.7%,比EVOLM低了9.6个百分点。

这印证了“奖励过优化”的已知结论:静态的评估标准——无论是编码在模型权重中,还是固化在提示词里——都难以适应一个持续学习的策略模型。策略模型在训练中会不断寻找“欺骗”固定奖励函数的捷径。而协同进化的评分标准之所以有效,正是因为它能随着策略模型分布的变化而动态调整,始终保持有效的辨识力。

评分标准从“抽象标签”进化为“可核验检查项”

论文通过大量定性分析,揭示了一个有趣的演变机制。以“周长为48的矩形,求其最大面积”问题为例:在训练第100步时,评分标准是“正确应用周长公式”、“正确求最大值”等权重均等的通用步骤;到了第1000步,标准浓缩为3条,其中权重高达0.8的第一条直接写明“答案是正确的最大面积144,由给定周长48推导得出”,将一道证明题的评估,转变为了答案核对。

对100个评估提示的统计证实了这一趋势:仅有抽象标签而无具体内容的评判标准从21.9%降至0.3%;嵌入了具体期望值的标准从6.9%升至19.3%;约束类标准从7.7%升至20.3%。标准的条目数稳定在3到4条,但平均长度从59个字符增长到了112个字符。

协同进化训练将评估从依赖“整体语义判断”转变为可执行的“模式匹配”,而模式匹配正是小型打分器能够可靠完成的任务。

卓越的跨领域、跨模型、跨打分器迁移能力

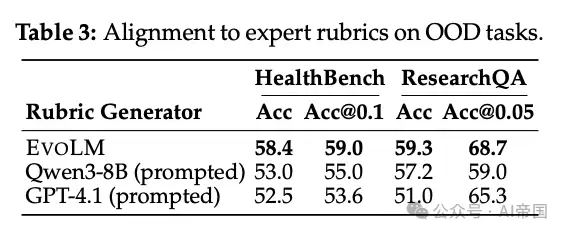

研究在Tulu 3数据集上训练,却在完全未见过的深度研究任务上进行了测试。

[Table 3: 在HealthBench和ResearchQA上与专家rubric的pairwise一致率]EVOLM在HealthBench达到58.4%(GPT-4.1 prompted 52.5%),在ResearchQA达到59.3%(GPT-4.1 51.0%),过滤掉模糊偏好对后的Acc@δ指标上优势更明显。

图片

图片

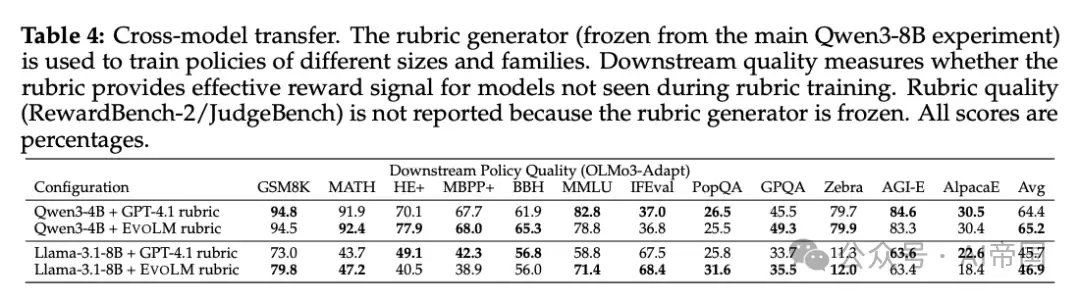

更进一步,研究将训练好的评分标准生成器冻结,用于训练一个全新的、未见过的策略模型:

[Table 4: 跨模型迁移结果]Qwen3-4B用EVOLM rubric训出的policy平均65.2%,超过GPT-4.1 rubric的64.4%;Llama-3.1-8B换成EVOLM rubric从45.7%提到46.9%。Qwen3家族内代码生成提升显著(HE+ 77.9% vs 70.1%)。

图片

图片

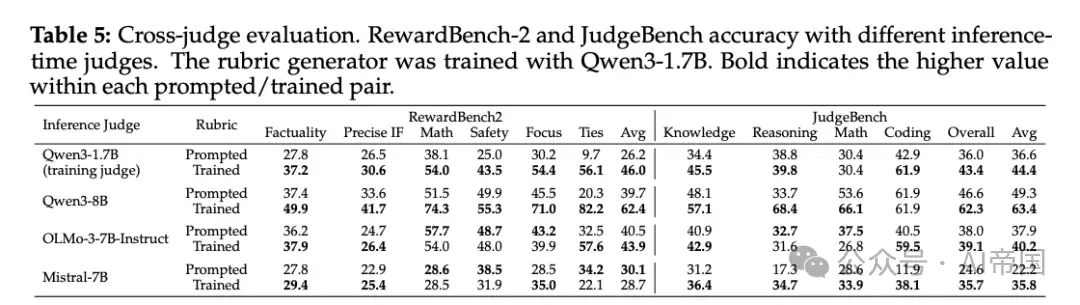

[Table 5: 跨judge评估]rubric生成器在Qwen3-1.7B上训出后,换到Qwen3-8B当judge推理,RewardBench-2提升22.7个百分点(62.4% vs 39.7%),JudgeBench提升15.7个百分点。说明训好的rubric编码的是可复用的评估结构,更强的judge反而能从中获得更多信号。

图片

图片

“协同进化”过程本身决定训练质量

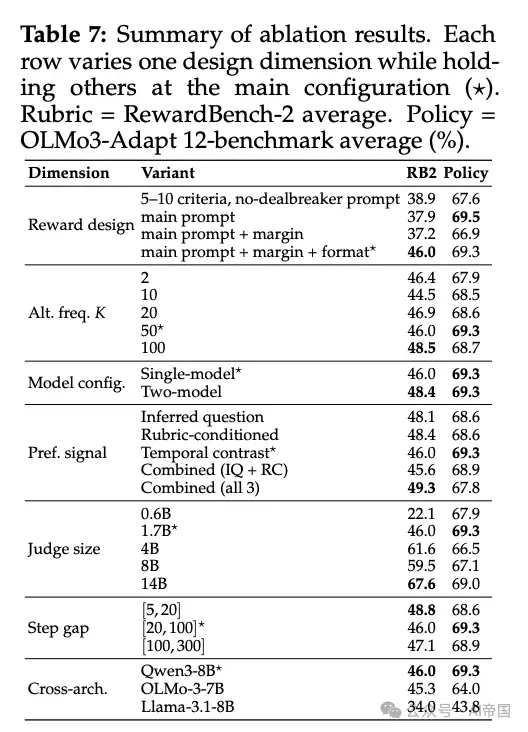

[Table 7: 7个维度的消融汇总]K从2到100下游只在67.9%–69.3%之间波动;judge从0.6B换到14B,RewardBench-2从22.1%跃升到67.6%,但下游policy反而在1.7B judge下最优。在所有消融组中,RewardBench-2最高的变体从来都不是下游policy最好的变体。

图片

图片

涵盖奖励设计、交替频率、单双模型、偏好信号、打分器大小、跨架构等7个维度的消融实验,共同指向一个核心结论:决定最终训练质量的是“协同进化”这一动态过程本身,而非任何具体的配置参数。静态的、保留的评估并不能反映评分标准在策略训练过程中的真实价值。

这项研究最终阐明:语言模型内部本就蕴藏着丰富的评估性知识,强化学习的作用在于将其激发并结构化。当这种“激发”不再依赖外部裁判,而是让模型自主将评估能力转化为可读、可训练、且能与策略同步进化的评分标准时,奖励信号便有望突破人类判断和闭源API的双重限制。

当然,该方法也存在局限:冻结打分器的设计虽将改进来源唯一限定于标准生成器,但也可能限制了评分标准复杂度的上限;此外,该方法在通用后训练数据上得到验证,其在医学、法律等专业领域混合数据上的表现,仍是一个有待探索的开放问题。

原文标题:EVOLM: Self-Evolving Language Models through Co-Evolved Discriminative Rubrics

原文链接:https://arxiv.org/abs/2605.03871

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

Canva新设备快速适配指南 详细操作教程

当你在Canva中精心完成设计后,突然需要将其适配到一台新发布的设备上——例如最新的折叠屏手机、AR眼镜界面,或是特定车型的车载中控屏——这确实是一个常见的挑战。问题通常在于Canva的内置模板库尚未收录这款新设备的规格,直接套用会导致画布比例失调、元素错位或导出尺寸不符。无需担心,解决这一问题的技

Recraft中文字符创作指南 绕过限制实现中文设计

在Recraft平台进行中文内容创作时,用户偶尔会遇到文字渲染异常的问题,例如显示乱码、字符错位、笔画缺失,甚至被自动替换为英文符号。这通常表明当前启用的AI模型对中文的原生兼容性存在不足。不过,这些问题都有成熟的解决方案。本文将系统介绍五种经过实践验证的有效方法,帮助您稳定、清晰地呈现中文字符,确

Figma实例组件脱离原位怎么办 Reattach Instance插件还原教程

在Figma设计过程中,误操作导致组件实例“脱离原位”(Detach Instance)是许多设计师常遇到的问题。一旦实例与主组件断开链接,便会退化为普通图层组,失去同步更新的能力,同时可能引发图层结构错位。幸运的是,借助“Reattach Instance”这款专业插件,我们可以高效地将其重新关联

Canva快捷键大全 提升设计效率的必备键盘操作指南

在Canva可画里做设计,效率卡顿、重复操作费时费力?问题很可能出在这里——你还没把它的快捷键体系用起来。一旦掌握,行云流水的操作感会让你彻底告别菜单栏的频繁点击。下面这份梳理,覆盖了从基础编辑到图层管理的全流程高频操作,帮你把键盘变成效率翻跟斗。 一、基础编辑类快捷键 这类快捷键是设计的“基本功”

Figma AI自动排序教程 利用Flow Analysis优化原型逻辑排列

在Figma中进行原型设计时,你是否常常感到困惑:各个界面画板或组件节点分散在画布各处,用户的操作路径和跳转逻辑难以直观理解?这通常是由于一个关键功能未被充分利用——即“流程分析”(Flow Analysis)工具,或者画板之间的交互连接未能正确建立关联。 无需担忧,本文将为你详细解析如何借助Flo

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程

热门话题

热门话题