谷歌DeepMind开源多模态模型TIPSv2技术解析与应用

多模态人工智能领域迎来重大突破,Google DeepMind 正式开源其新一代视觉-语言模型 TIPSv2。该模型通过一系列创新架构设计,在零样本语义分割、图像-文本检索等核心任务上刷新了多项性能记录,为密集视觉-语言对齐设立了新的技术标杆。本文将深入解析其技术原理、核心优势与应用前景。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

TIPSv2 的核心突破在于实现了图像局部区域(Patch)与文本描述之间的高精度“密集对齐”。这一能力是达成高质量零样本视觉理解任务的关键基础。为实现这一目标,研究团队融合了三大关键技术模块,显著提升了模型对复杂视觉场景的语义解析能力。

TIPSv2的主要功能

该模型具备全面的多模态理解与生成能力,覆盖了当前视觉-语言交互的主流应用场景:

- 零样本语义分割:无需针对特定类别进行训练,仅凭自然语言指令(例如“找出图像中所有行人”)即可精确分割出对应物体轮廓。

- 图像-文本检索:支持双向跨模态检索,既能通过文本查询匹配图像,也能依据图像内容搜索相关文字描述。

- 零样本图像分类:在 ImageNet 等标准分类数据集上,直接通过文本嵌入匹配完成分类,无需进行任务特定的微调。

- 深度与法向量预测:利用其强大的 Patch 级特征表示,可同时估计场景的深度信息与物体表面法线方向。

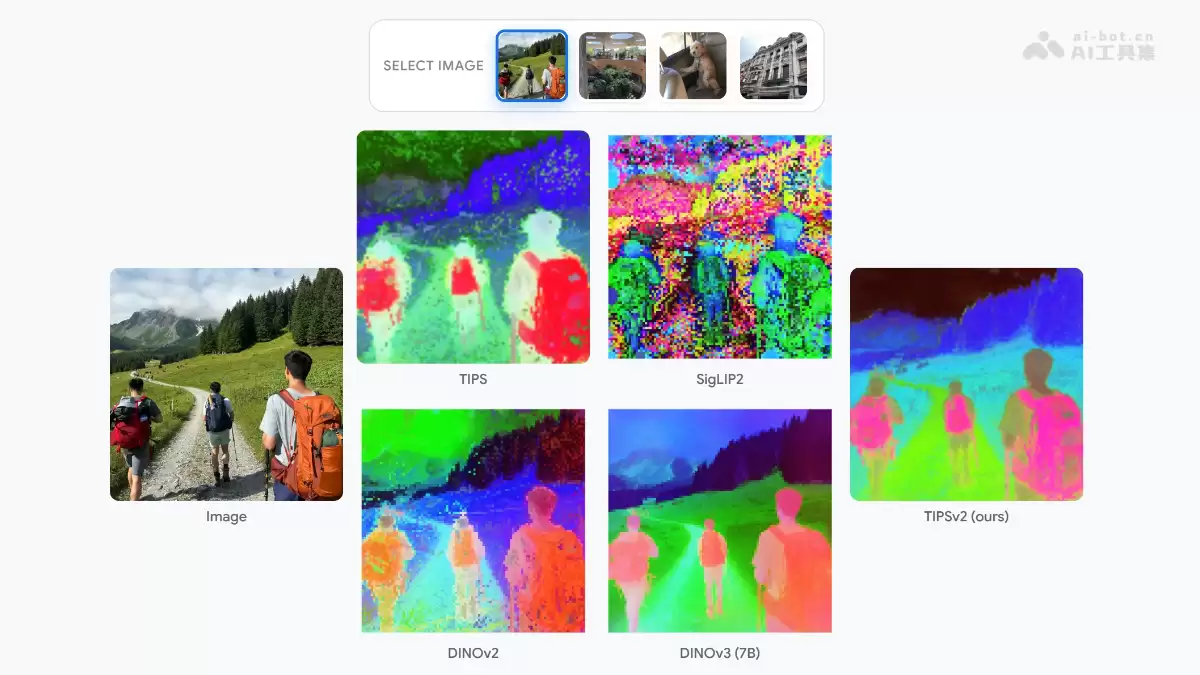

- 特征可视化:支持生成图像 Patch 嵌入的 PCA 降维可视化图谱,直观展示模型对不同图像区域的语义理解分布。

TIPSv2的技术原理

模型卓越性能的背后,是四项关键的技术创新:

- iBOT++ 自蒸馏框架:作为原有 iBOT 方法的升级版,它将 Patch 级别的自蒸馏损失扩展至所有视觉 Token,强制学生模型对齐教师模型的全套 Patch 表示。该策略在 ADE150 数据集上将零样本分割性能提升了 14.1 个 mIoU。

- Head-only EMA 高效训练:为提升训练效率,团队创新性地仅对模型末端的投影头(Projection Head)应用指数移动平均更新,主干网络则保持常规训练。此策略减少了 42% 的 EMA 参数更新量,大幅降低了训练内存开销。

- 多粒度文本增强策略:采用双模型文本生成方案,结合 PaliGemma 生成的密集区域描述与 Gemini Flash 生成的全局深度描述。训练时随机交替使用不同粒度的文本,极大增强了模型对多样化语言描述的鲁棒性。

- 对比学习与自监督联合优化:模型采用多任务联合训练范式,同步接收文本监督信号与自监督信号,成功解锁了骨干网络进行密集图文对齐的内在能力。

TIPSv2的关键信息和使用要求

对于希望快速部署与实验的研究者与开发者,以下是关键信息:

- 研发团队:由 Google DeepMind 团队主导,论文主要作者包括 Bingyi Cao、Koert Chen 和 André Araujo。

- 开源范围:本次开源极为全面,发布了从 8600 万到 110 亿参数的四种规格预训练模型,并提供 PyTorch 与 JAX/Scenic 双框架代码。同时,Hugging Face 平台提供了在线演示与 Colab 笔记本。

- 运行环境:需要 Python 3.11 及以上版本,并可根据需求选择 PyTorch 或 JAX/Scenic 作为计算后端。

- 依赖安装:核心依赖库包括 torch、torchvision、tensorflow_text 及 scikit-learn 等。

TIPSv2的核心优势

与现有主流视觉-语言模型相比,TIPSv2 在多个维度展现出显著优势:

- Patch-文本对齐能力领先:在 ADE150、PASCAL VOC 等四个主流分割基准测试中均取得领先。其零样本分割流程简洁,仅需最大化余弦相似度即可获得更高 mIoU,无需复杂后处理。

- 卓越的参数效率:得益于 Head-only EMA 策略,训练内存占用大幅降低。通过知识蒸馏,较小规模的 TIPSv2 模型甚至在密集对齐任务上能超越更大的教师模型。

- 突出的训练性价比:数据对比显示,参数量更少、训练数据量也更低的 TIPSv2-g 模型,在 5 项评测中的 3 项上超越了参数量多 56%、数据量多 47 倍的 PE-core 模型。而 TIPSv2-L 则在 6 项评测中的 4 项上,胜过了参数多 6 倍、数据多 15 倍的 DINOv3-L。

- 全面的任务通用性:模型能力均衡,在密集对齐(分割)、全局对齐(检索/分类)及纯视觉任务(深度/法向量估计)三大维度上均表现优异,在 9 项任务、20 个数据集中具备强大竞争力。

- 清晰可解释的特征表示:通过 PCA 可视化对比可见,其 Patch 嵌入比 SigLIP2、DINOv3 等模型的结果更平滑,能更好地保留物体边界与语义细节。

TIPSv2的项目地址

所有相关资源均已在以下平台开放:

- 项目官网:https://gdm-tipsv2.github.io/

- GitHub仓库:https://github.com/google-deepmind/tips

- HuggingFace模型库:https://huggingface.co/collections/google/tipsv2

- arXiv技术论文:https://arxiv.org/pdf/2604.12012

TIPSv2的同类竞品对比

| 维度 | TIPSv2 | DINOv3 | SILC |

|---|---|---|---|

| 机构 | Google DeepMind | Meta | 多机构 |

| 核心机制 | iBOT++ + 对比学习 + 多粒度 Caption | 纯自监督(DINO + iBOT) | 对比学习 + 掩码语言 |

| 文本监督 | 多粒度合成 Caption | 无 | 单粒度 |

| 零样本分割 | 直接余弦相似度,无需后处理 | 需滑动窗口协议辅助 | 依赖 TCL 滑动窗口协议 |

| 参数效率 | 高(Head-only EMA 省 42% 内存) | 低(全模型 EMA,大数据量) | 中等 |

| Patch-文本对齐 | SOTA | 弱(无文本对齐) | 较强但需复杂协议 |

TIPSv2的应用场景

凭借其强大的零样本理解与密集视觉对齐能力,TIPSv2 在多个行业具有广阔的应用潜力:

- 自动驾驶与机器人:实时解析复杂动态环境,通过自然语言指令零样本分割出行人、车辆、可行驶区域等,降低对海量标注数据的依赖。

- 电商搜索与内容风控:利用其高精度图像-文本双向检索能力,实现更精准的商品以图搜图、以文搜图,并辅助识别违规图像内容。

- 智能医疗影像分析:辅助医生通过自然语言描述(如“定位右下肺叶的磨玻璃结节”)快速定位病灶区域,有望大幅降低医学影像标注成本。

- 具身智能与交互机器人:使机器人能够理解“请把桌子上的蓝色马克杯拿过来”等复杂指令,并在真实环境中完成视觉定位与抓取。

- 人工智能可解释性研究:其提供的特征可视化工具,为研究人员探索多模态模型的内部工作机制与决策逻辑提供了重要窗口。

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

谷歌拟投资Anthropic 400亿美元加码人工智能竞赛

科技巨头在人工智能领域的战略布局再次迎来关键性升级。据多家权威财经媒体披露,谷歌正计划向知名AI研究公司Anthropic追加高达100亿美元的战略投资,而这笔交易可能仅是长期合作计划的第一步——未来总投资额或将达到300亿美元。此次投资将以Anthropic高达3500亿美元的估值进行,与该公司今

OpenAI CEO奥尔特曼发布AGI五大原则 致力于普惠全人类

近日,OpenAI首席执行官萨姆・奥尔特曼(Sam Altman)发布了一份关于人工智能未来发展的纲领性声明,系统性地阐述了确保AI技术红利惠及全人类的五项核心原则。这份声明旨在明确AI发展的伦理方向,防止技术权力与成果被少数力量所垄断。 奥尔特曼强调,人工智能的变革潜力是划时代的,其影响力或将超越

滴滴公开安全AI模型顺风车风险防控实现人机协同新阶段

在最近的一场顺风车安全治理开放日活动上,滴滴首次对外公开了其在安全技术层面的最新探索。面对行业中长期存在的反作弊难题和“未乘车却被收费”等用户痛点,平台借助前沿的人工智能技术,交出了一份阶段性的治理成绩单。 智能化判责让违规行为无所遁形 顺风车场景下的司乘纠纷往往高频且复杂。为此,滴滴全面部署了AI

鬼藏PPT开源技能网页HTML生成教程

在AI工具层出不穷的当下,制作PPT似乎变得轻而易举。然而,你是否也常常面临这样的挑战:AI生成的演示文稿要么风格雷同、缺乏个性,要么过于浮夸、破坏了内容的专业感?今天介绍的这个开源项目,或许提供了一种全新的解决方案——它不追求“完全自动化”,而是专注于打造一种优雅、可控且极具设计感的人机协作体验。

谷歌计划向Anthropic追加投资总额或至400亿美元

人工智能领域的竞争正迈向一个前所未有的激烈阶段,科技巨头的战略布局一次比一次更具震撼力。最新消息透露,谷歌正计划向AI明星企业Anthropic投入高达100亿美元的资金,而这可能仅仅是双方长期合作的开端。根据更广泛的战略规划,未来总投资额甚至有望达到400亿美元的惊人规模。 一旦这笔交易正式落地,

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程

热门话题

热门话题