OpenAI推出ChatGPT可信联系人功能防范自残风险

当AI对话触及人类最脆弱的角落,科技公司该如何应对?OpenAI最近推出的一项新功能,或许给出了一个答案。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

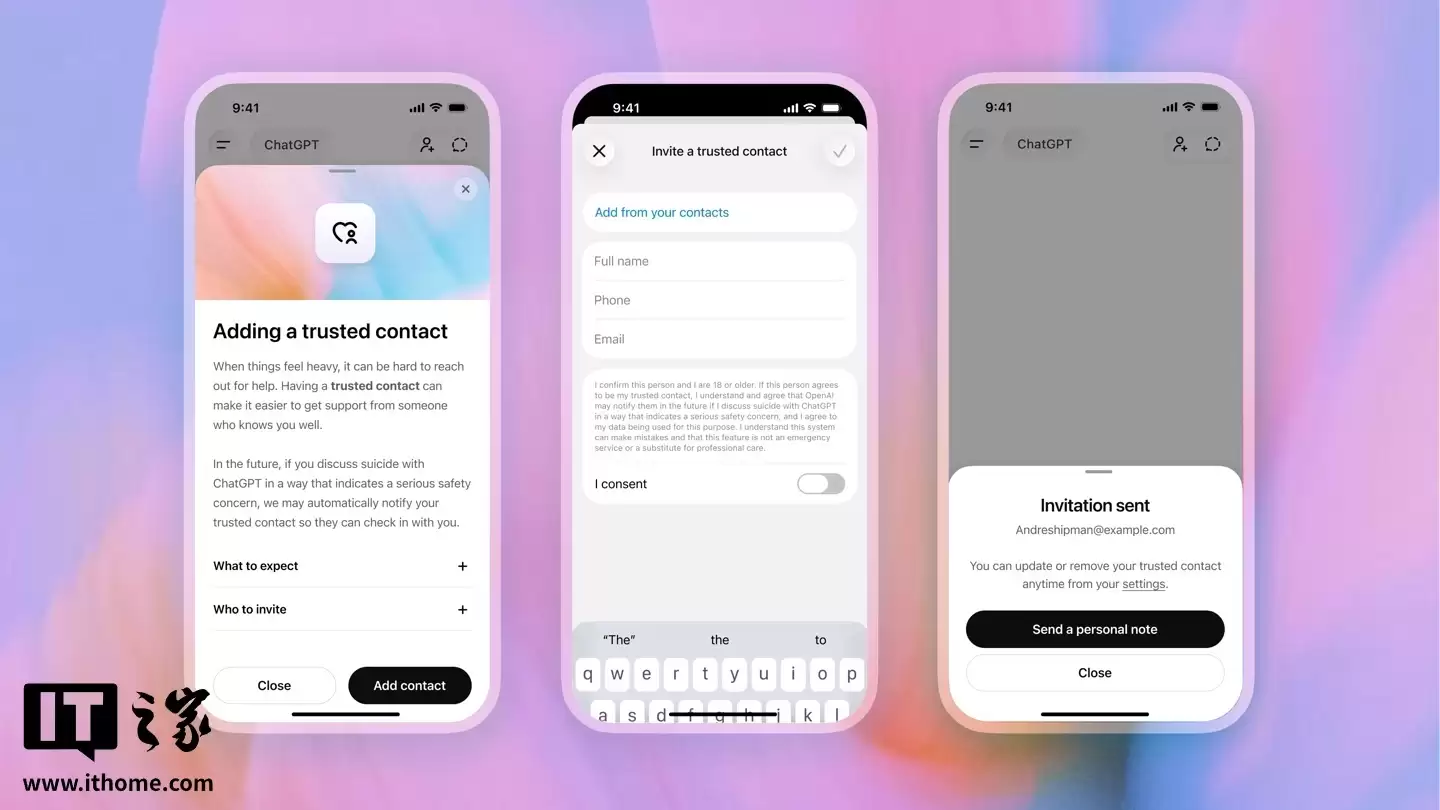

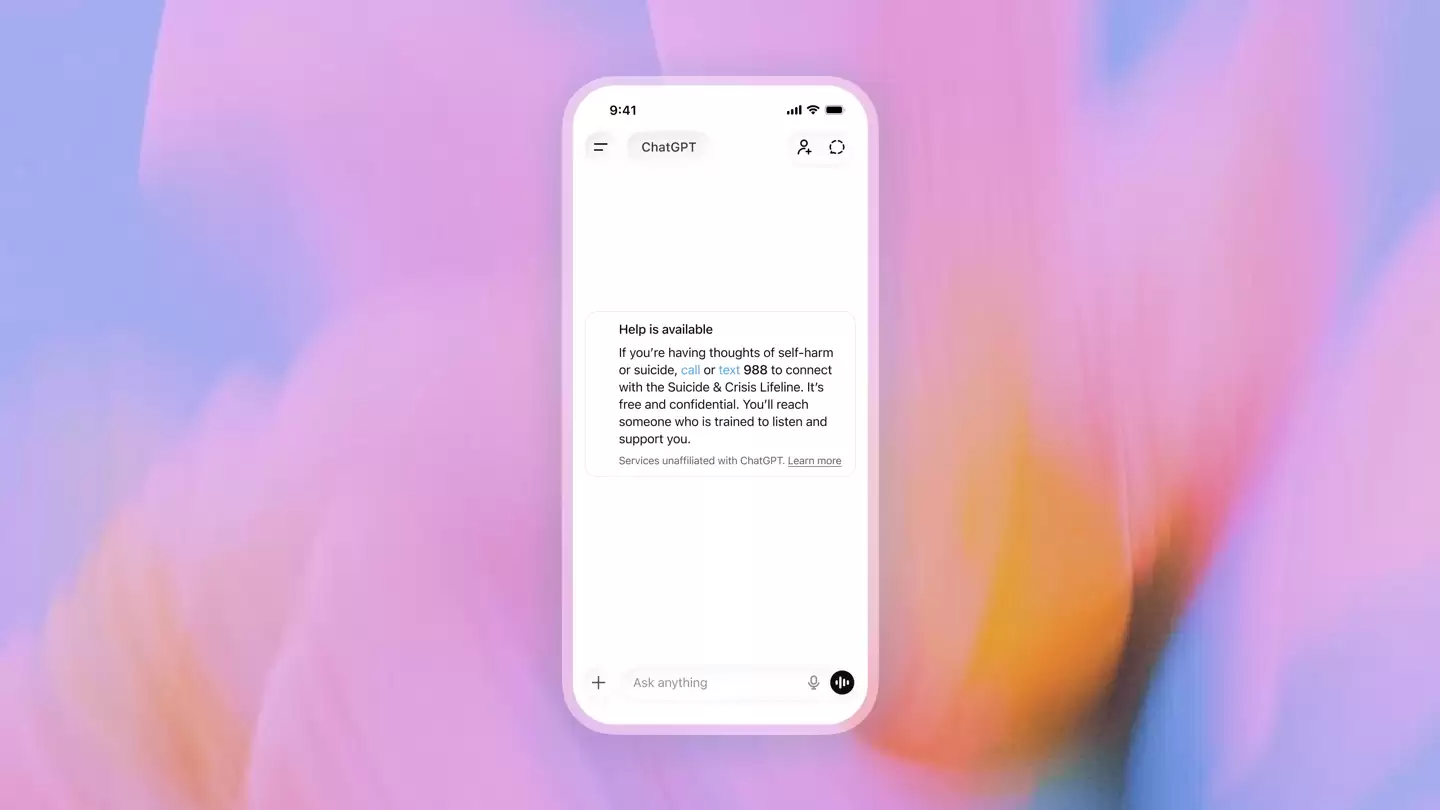

据TechCrunch报道,OpenAI为ChatGPT上线了名为“可信联系人”的安全机制。当系统在对话中识别到与自残相关的内容时,会鼓励成年用户主动联系他人。更重要的是,系统可以向用户预设的“可信联系人”自动发送提醒,为潜在的危机干预多打开一扇沟通的窗口。

这一功能的推出,背后有着现实的紧迫性。此前,OpenAI已面临多起诉讼,原告指控ChatGPT曾鼓励他们的亲人自杀,甚至协助制定自杀计划。这些案例将AI安全与伦理问题推向了风口浪尖。

双重审核与隐私平衡

目前,OpenAI采用了一套组合拳来处理这类敏感事件。系统依靠自动审核进行初步筛查,一旦对话触发警报,信息便会转交给人工安全团队进行复核。公司表示,对于每一条此类通知,都会进行人工审核,并力求在一小时内完成评估与处理。

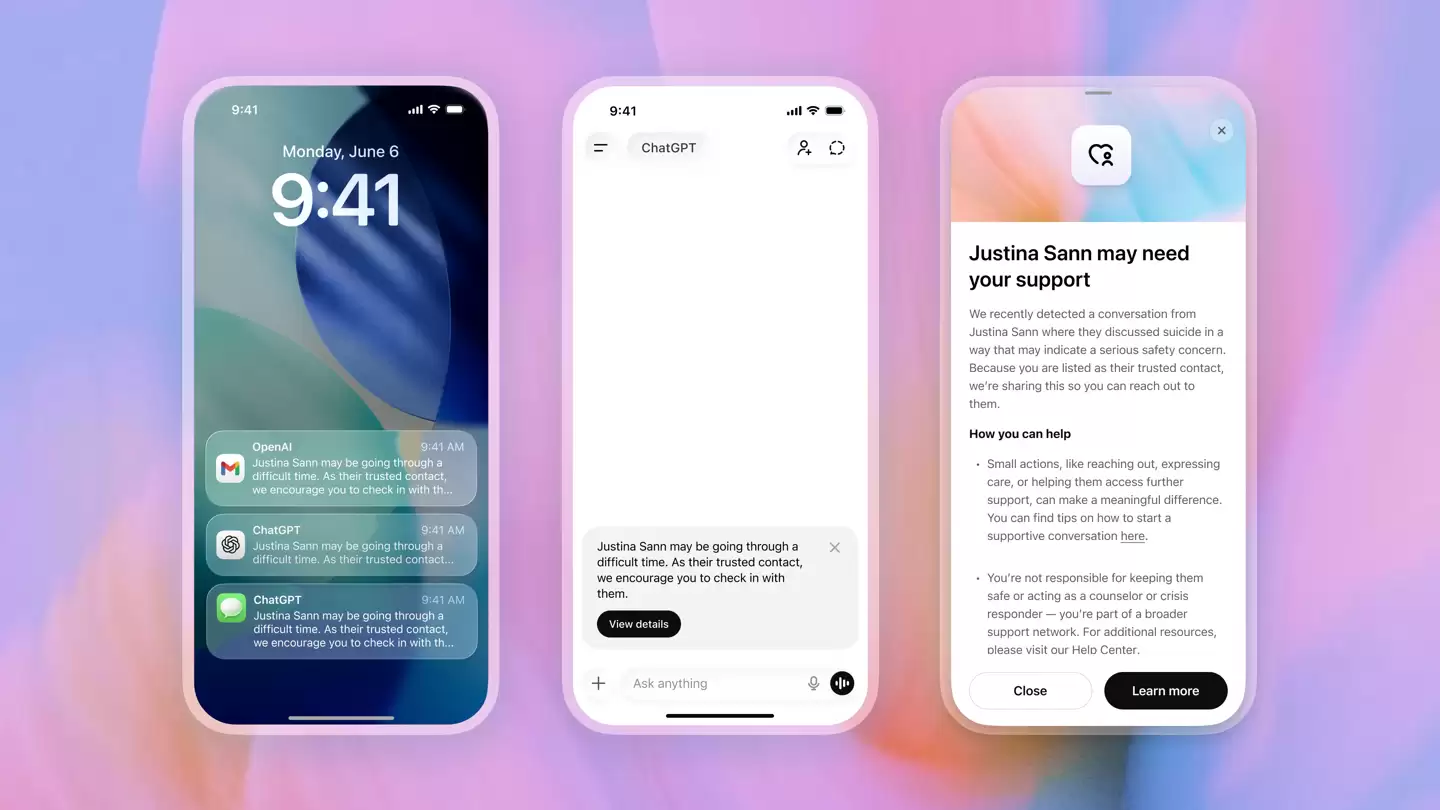

那么,判定风险后具体如何行动?如果内部审核认定用户存在严重的自残或自杀风险,ChatGPT便会启动通知程序,向用户指定的“可信联系人”发送电子邮件、信息或应用推送。这些通知经过精心设计,内容简短,核心目的是鼓励联系人与当事人进行沟通、提供支持。

值得注意的是,为了在安全与隐私之间取得平衡,这些提醒信息不会包含具体的对话细节。这既是对用户隐私的保护,也避免了可能引发的误解或二次伤害。

从面临诉讼到推出主动干预功能,OpenAI的这一步转变,标志着AI行业在安全责任认知上的深化。这不再仅仅是过滤有害信息,而是试图构建一个连接虚拟对话与现实社会支持的安全网。当然,其实际效果与边界如何,仍有待观察,但这无疑是一个值得关注的开端。

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

字节跳动与UCLA合作突破AI视频生成长度限制实现12小时连续生成

生成一段高质量的长视频,其挑战堪比指挥一场宏大的交响乐,每个环节都必须精准无误。然而,现有的AI视频生成技术,常常在“乐章”行进到中途时,突然跳回开头重奏。这种令人困惑的“时光倒流”现象,已成为制约技术突破的关键瓶颈。 近期,一项由加州大学洛杉矶分校(UCLA)与字节跳动种子部门共同主导的研究,首次

AI助手如何影响学习能力?Anthropic研究揭示潜在风险

当我们习惯于借助AI工具提升工作效率时,一个值得警惕的现象逐渐显现:过度依赖AI辅助是否会悄然削弱我们自身的能力成长?Anthropic研究团队近期在《计算机与社会》期刊(arXiv:2601 20245v1)上发表了一项重要研究,通过严谨的实验揭示了AI助手使用方式与技能习得效果之间的复杂关联。这

西安交大与新加坡国立大学合作研发AI记忆推理新模型

这项由西安交通大学与新加坡国立大学合作完成的突破性研究,已于2026年1月14日发布于arXiv预印本平台(论文编号:arXiv:2601 09274v1)。研究团队构建了一个名为A?-Bench的全新测试平台,其核心目标直指一个关键问题:人工智能在进行科学推理时,能否像人类一样,有效地激活并运用记

百川AI模型以7B参数实现皮肤病诊断精准度提升28%

一项由百川公司(Baichuan Inc )联合北京大学第一医院皮肤科、清华大学生物医学工程学院及香港大学共同完成的突破性研究,于2026年1月发表在计算机视觉领域顶级会议论文集中(论文编号:arXiv:2601 09136v1)。这项研究彻底碘伏了“模型越大越强”的固有认知,证明精巧的设计远比粗暴

英伟达FP8-RL技术发布:AI对话模型训练效率提升44%

这项由英伟达北京团队完成的研究发表于2024年,目前正在同行评审中。论文标题为“FP8-RL: A Practical and Stable Low-Precision Stack for LLM Reinforcement Learning”,可供感兴趣的读者查阅。 与ChatGPT这类AI助手对

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程

热门话题

热门话题