英伟达MIT华人团队开源大模型推理内存优化技术

你是否曾面临这样的困境:手握一张拥有24GB显存的RTX 4090显卡,想要运行一个参数规模高达320亿的大语言模型,执行复杂的多步骤智能体任务,却因KV缓存占用过高而显存爆炸,连模型都无法加载?

现在,一种名为TriAttention的创新方法彻底改变了这一局面。应用该方法后,模型不仅能够稳定运行,还能流畅地处理长达6份的文档,并自动生成结构完整的周报。

这项突破性技术并非社区魔改,而是来自麻省理工学院、英伟达与浙江大学的联合研究团队,其成果已形成严谨的学术论文。

TriAttention的核心机制极为精妙。它在预旋转位置编码的空间中,通过分析查询向量与键向量的三角集中度,来精准评估每个键值对(KV Pair)的重要性。基于此评估,系统能够智能地保留关键信息,果断舍弃冗余部分。

我们可以用一个比喻来理解:许多传统的KV缓存压缩技术,如同使用真空压缩袋打包行李,无论物品是蓬松的羽绒服还是坚硬的砖块,都进行无差别压缩。而TriAttention的策略则更像是先开箱仔细筛选,丢弃无用的砖块,只精心打包真正必需的羽绒服,从而实现更高效的存储。

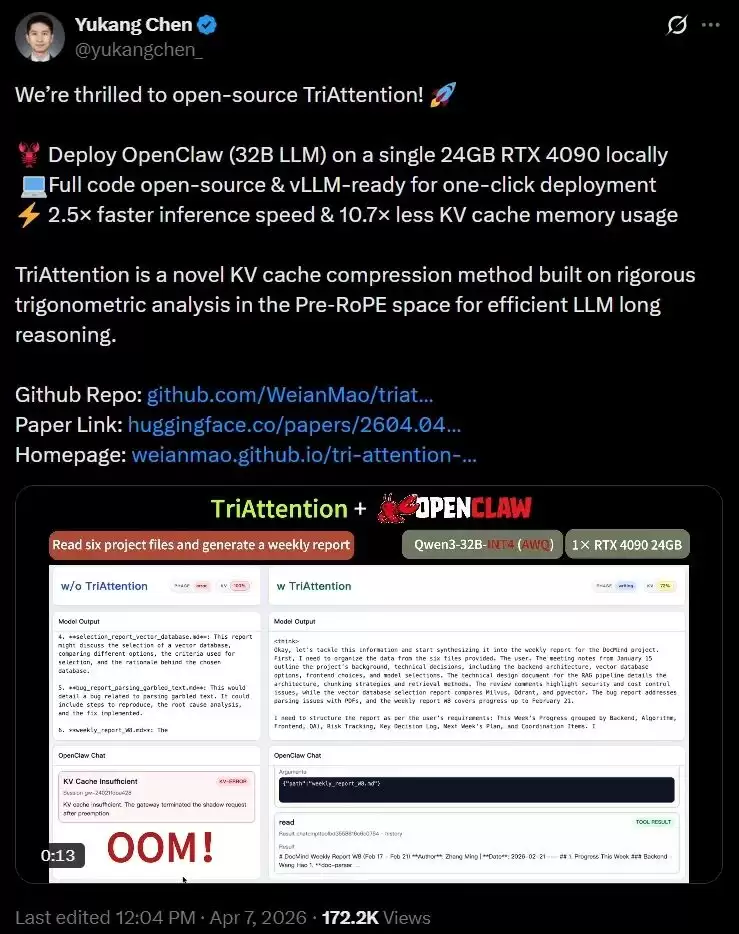

在研究者Yukang Chen分享的演示对比中,左侧未启用压缩的方案因显存不足而报错,右侧启用TriAttention后,智能体则顺畅无阻地完成了整个任务链。

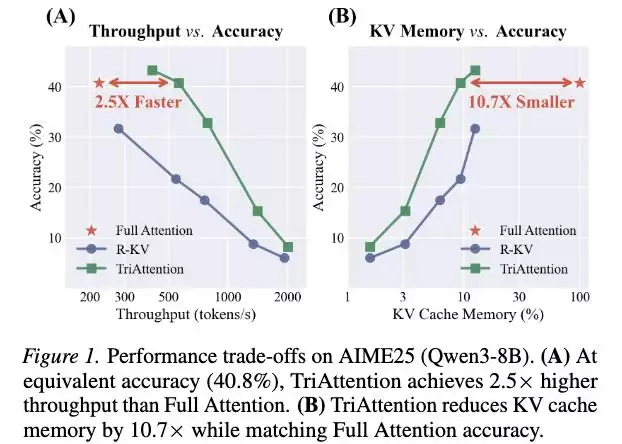

性能飞跃:2.5倍吞吐量提升与10.7倍内存缩减

TriAttention的实际效果如何?数据给出了最有力的答案。

在AIME25数学推理基准测试中,TriAttention在完全保持全注意力机制精度(准确率40.8%)的前提下,将推理吞吐量提升了2.5倍。

更令人瞩目的是内存占用优化:KV缓存的内存消耗被大幅缩减了10.7倍。

需要明确的是,这里大幅降低的是“KV缓存内存占用”,而非显卡的总显存或模型参数本身占用的内存。然而,在长序列推理场景中,KV缓存往往是导致显存溢出的关键瓶颈。减轻这部分负担,常常是决定任务“能否运行”与“无法运行”的根本区别。

论文的主要实验基于Qwen3-8B模型展开,覆盖了AIME24、AIME25、MATH500等多个评测任务。在生成长度达到32K token的严苛条件下,TriAttention几乎未造成任何精度损失,同时将大模型推理效率提升到了新的高度。

消费级硬件突破:单张RTX 4090流畅运行320亿参数模型

更令人印象深刻的是论文附录中提及的真实部署案例。

该场景基于OpenClaw智能体工作流,任务是阅读6份Markdown格式文档并生成周报。使用的模型是经过AWQ INT4量化的Qwen3-32B,硬件平台仅为一张消费级的RTX 4090显卡(24GB显存)。

若不进行KV缓存压缩直接运行,冗长的系统提示词与多轮文档读取将导致缓存急剧膨胀,显存会瞬间崩溃。而在TriAttention的加持下,智能体顺利完成了所有文档的阅读与分析,并输出了完整的报告。尽管此案例使用了量化模型和特定工作流,但它强有力地证明:一个完整的、具备实际应用价值的智能体任务,已经可以在消费级GPU上成功部署与运行。

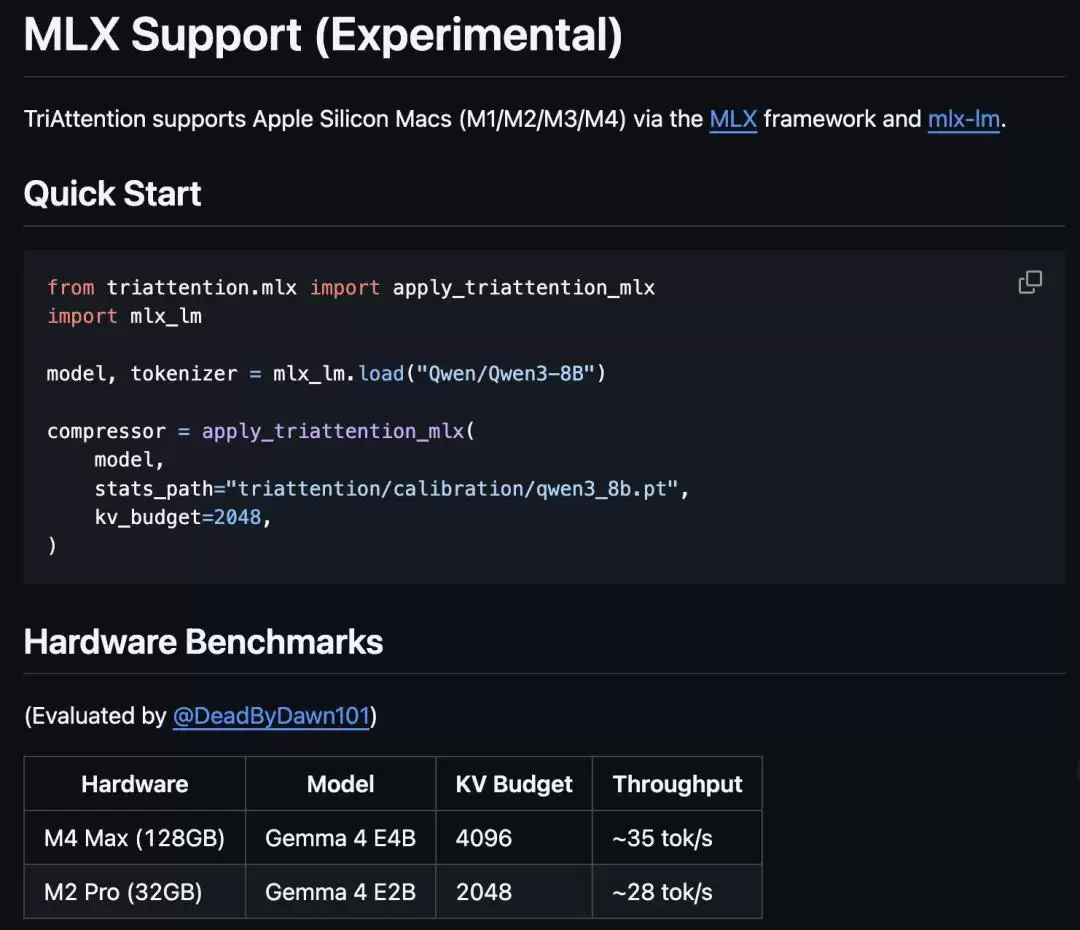

生态集成:vLLM插件已就绪,MLX支持实验性启动

TriAttention的价值远不止于学术论文。研究团队已在GitHub仓库中提供了与vLLM高性能推理引擎的集成方案。README文件明确指出,TriAttention包含一个即插即用的vLLM插件,并详细说明了如何通过OpenAI兼容API的服务端模式、Python API进行调用,以及如何接入OpenClaw智能体框架。

这意味着,开发者无需修改模型架构或重新训练,只需加载此插件,即可在现有的vLLM推理管线中无缝获得KV压缩带来的性能红利,极大降低了部署门槛。

此外,针对Apple Silicon生态,项目仓库最新提供了独立的MLX框架支持文档,覆盖从M1到M4的全系列芯片,并附带了示例代码与硬件基准测试结果。

当然,文档标题也标注了这仍是“实验性支持”,表明团队正处于MLX生态的早期探索阶段,距离成熟的Mac本地部署方案尚有距离,但技术方向已非常清晰。

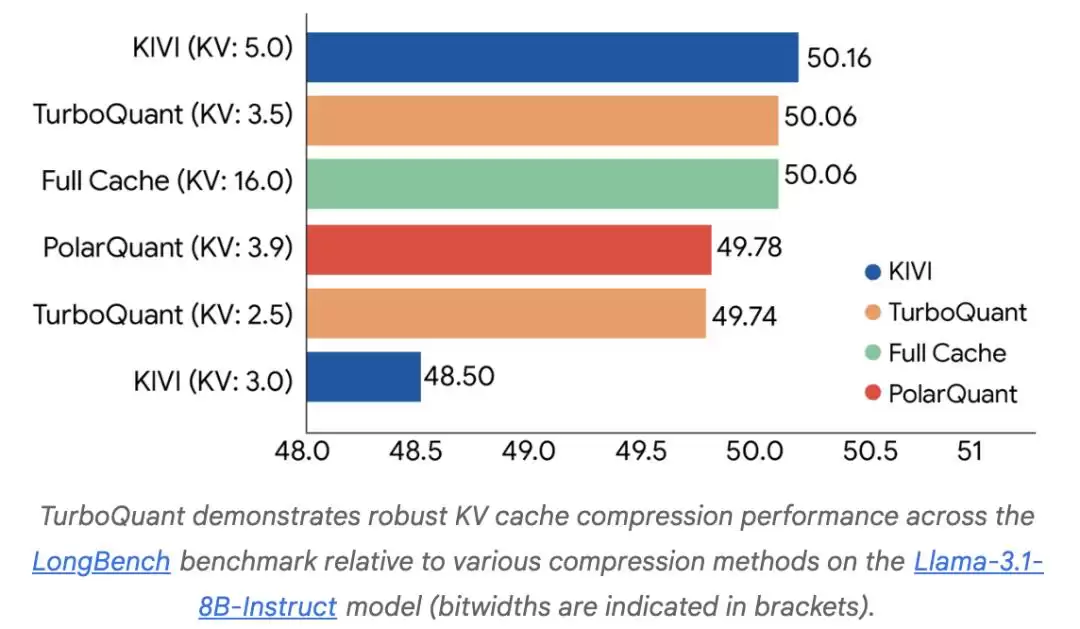

技术路线解析:KV缓存压缩的两大主流方向

当前,KV缓存压缩技术领域主要存在两条并行的技术路线。

一条是“量化派”。以谷歌研究院今年3月发布的TurboQuant为代表,其核心目标是在“零精度损失的前提下实现极致压缩”,专注于将KV缓存及向量搜索的比特数降至极限。

社区已有开发者在Apple Silicon芯片上,借助TurboQuant成功运行了如Gemma 4 31B等大型模型。

另一条则是“选择性保留派”。TriAttention正是此路线的新锐代表。它不追求压缩每个存储单元的比特宽度,而是直接评估并筛选出值得保留的关键token的键值对,丢弃次要部分。

两条路线的终极目标一致:让大模型能在消费级硬件上高效运行,同时避免显存溢出并保持精度。但方法论迥异。量化好比均匀压缩每件行李的体积,选择性保留则类似于直接减少行李的件数。理论上,这两种思路可以结合使用,以期获得更大的效益。

目前,尚缺乏在相同模型、硬件和任务下的严格直接对比,因此断言孰优孰劣为时过早。但可以肯定的是,这两条技术路线都在加速向消费级部署的最终落地迈进。

回想一年前,“本地运行大模型”仍带有浓厚的极客实验色彩,运行一个70亿参数的模型都需大量调试。如今,320亿参数模型已在单张消费级显卡上完成智能体任务,Apple Silicon上的MLX生态每周都有新进展,vLLM插件让KV压缩变成了“一键启用”的便捷方案。KV缓存压缩这条赛道,正迅速从论文中的消融实验,转变为每位开发者触手可及的工程现实。

核心作者简介

Weian Mao

Weian Mao现任麻省理工学院计算机科学与人工智能实验室(MIT CSAIL)博士后研究员,博士毕业于阿德莱德大学AIML,师从沈春华教授。其当前研究聚焦于大语言模型的高效推理,特别是长上下文处理中的KV缓存压缩问题;此前亦从事过计算机视觉与蛋白质设计等相关领域的研究。

Xi Lin

Xi Lin是浙江大学计算机科学与技术专业高年级本科生,研究兴趣集中于高效AI的算法与系统协同设计,尤其关注面向硬件友好的稀疏化与量化模块设计,以及高效推理策略。其工作与高性能计算、机器学习系统等方向紧密相关。

Wei Huang

Wei Huang现为香港大学博士生,研究聚焦于高效AI与大型视觉/语言模型。目前,他在英伟达研究院实习,与Yukang Chen等研究者合作,并在Song Han教授的指导下开展相关研究,参与了QeRL、LongLive等项目。

参考资料:

TriAttention论文:https://arxiv.org/abs/2604.04921

演示对比:https://x.com/yukangchen_/status/2041366586423165152

Google TurboQuant博客:https://research.google/blog/turboquant-redefining-ai-efficiency-with-extreme-compression/

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

节假日商品自动上架排期策略指南

节假日对于电商而言,无疑是销售爆发的黄金窗口。然而,传统依赖人工的商品上架排期,在面对海量商品、复杂规则和短暂的时间窗口时,往往力不从心——上架延迟、库存错配、促销设置错误,任何一个疏漏都可能导致与流量高峰失之交臂。如何实现精准、自动化的节假日商品上架排期,成为提升运营效率和销售转化的关键。本文将围

大模型MoE混合专家系统架构原理与优势详解

混合专家系统(Mixture of Experts,MoE)是一种先进的深度学习架构,它通过集成多个专业化子模型来协同处理复杂任务,从而显著增强大语言模型的整体性能与效率。其核心思想是将一个庞大的计算问题分解,让擅长不同领域的“专家”模型各司其职,再通过一个智能的“门控网络”动态整合它们的输出。本文

媒体内容自动发布平台高效管理多平台分发

想没想过,每天在多个平台手动发布内容、回复评论、同步数据,这些重复性工作到底消耗了多少宝贵时间?对于内容运营和营销团队来说,这不仅是体力活,更是效率瓶颈。如今,通过引入RPA(机器人流程自动化)技术,实现媒体内容的自动发布,已经成为提升运营效率、降低人力成本并确保发布一致性的关键路径。下面,我们就来

大模型混合精度训练方法与优化策略详解

在人工智能模型训练领域,追求更高的效率与更低的资源消耗是永恒的主题。混合精度训练(Mixed Precision Training)作为一项成熟且关键的技术,通过协同使用不同数值精度(如FP32、FP16、BF16),在确保模型性能不损失的前提下,显著提升了训练速度并优化了内存使用。本文将深入解析混

宠物养护实用经验分享与社区交流指南

如今,越来越多的家庭选择饲养宠物,宠物社区已成为“铲屎官”们交流日常养护心得、分享实战经验的重要平台。这些社区积累了海量的宝贵信息,涵盖“如何科学喂养”、“常见疾病应对”等方方面面。然而,信息过载也使得手动筛选和整理变得异常耗时。此时,RPA(机器人流程自动化)技术便能发挥其高效优势,成为宠物主人的

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程

热门话题

热门话题