斯坦福团队新作让Llama1B实现毫秒级推理获Karpathy盛赞

在实时对话、人机交互等对AI响应速度要求极高的应用场景中,大语言模型的推理延迟哪怕只减少几毫秒,用户体验都可能产生质的飞跃。近期,斯坦福大学Hazy Research团队取得了一项突破性优化成果,将开源小模型Llama-3.2-1B的前向推理延迟推向了新的极限——他们通过将所有计算融合进一个名为“Megakernel”的单一CUDA核心中,实现了接近硬件理论极限的极致性能。

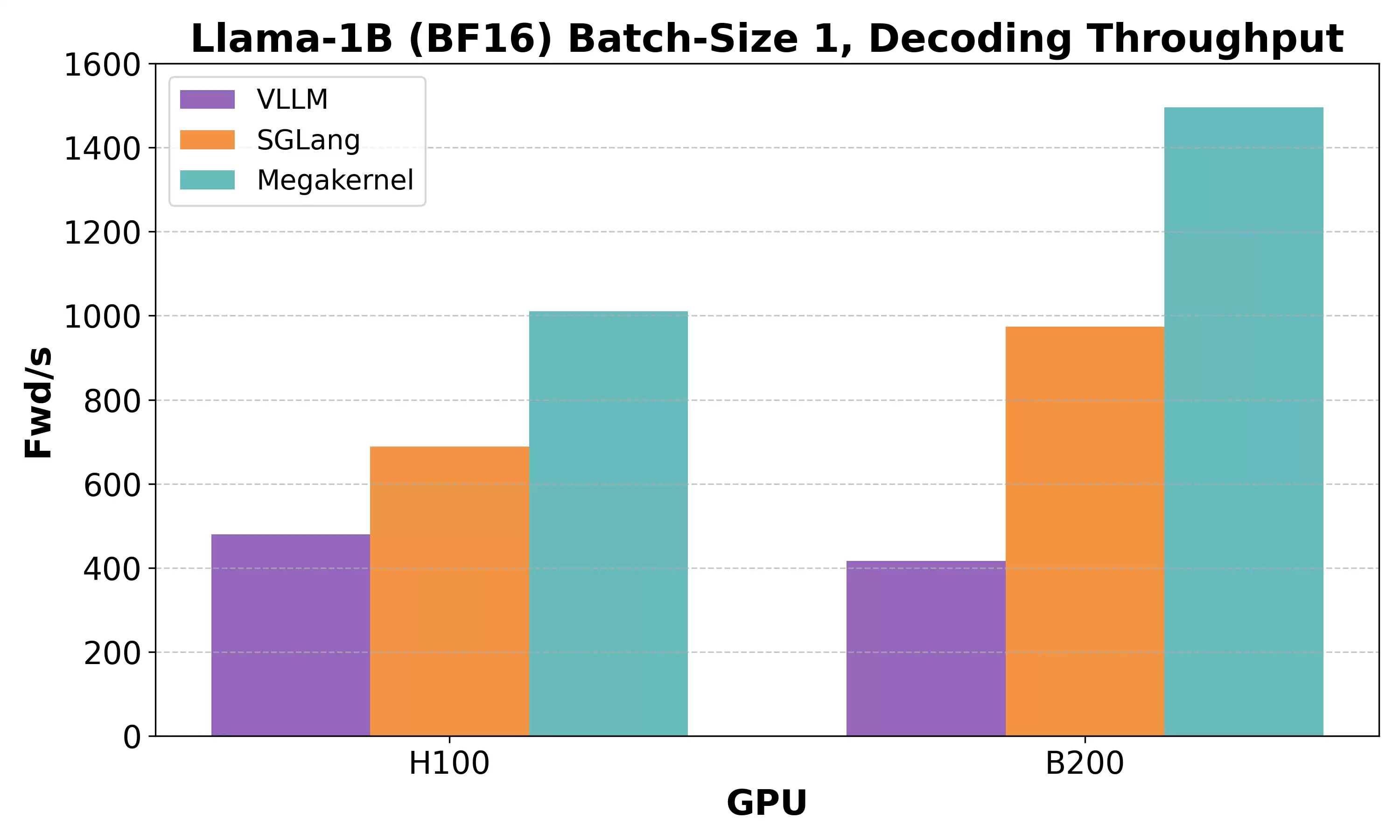

这项研究的动机非常明确:团队发现,当前主流的AI推理引擎在处理极低延迟的单序列生成任务时,效率并不理想。即使在H100这样的顶级GPU上,像vLLM、SGLang这样的先进系统,其显存带宽利用率也常常低于50%。瓶颈究竟在哪里?问题并非出在计算能力上,而在于“等待”造成的资源闲置。

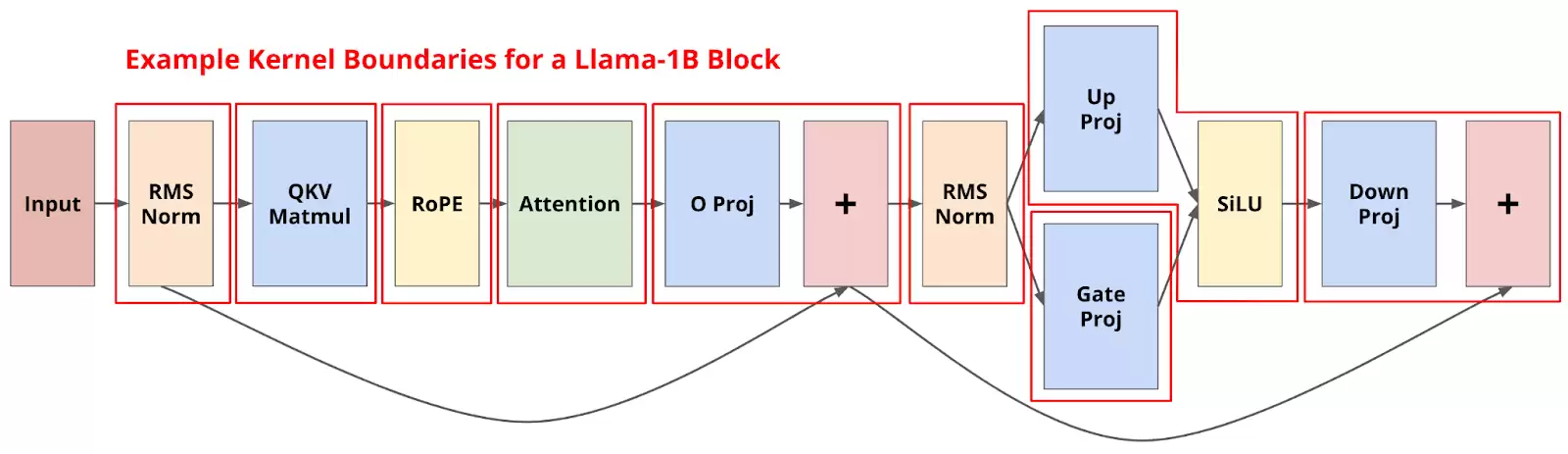

传统方法通常将Transformer模型的每一层分解为几十甚至上百个细小的CUDA内核,分别处理RMSNorm、注意力机制、MLP等操作。这种“微内核”架构虽然模块化清晰,却引入了大量的上下文切换和内核启动开销。更重要的是,在生成单个token的短时任务中,这些内核必须排队执行,后续计算无法提前预加载数据,导致GPU对显存的访问断断续续。大量时间被耗费在“空转”和“等待指令”上,而非用于实际运算,严重拖累了整体效率。

Megakernel:从零设计的深度融合方案

那么,Hazy团队提出的Megakernel方案效果究竟如何?数据给出了有力的证明。在H100 GPU上,他们的Megakernel将推理延迟压缩到了1毫秒以内,显存带宽利用率飙升至78%,相比vLLM提升了2.5倍,相比SGLang也提升了1.5倍。而在更先进的B200平台上,延迟进一步被压低至600到680微秒,几乎触及了硬件理论性能的天花板。

从一次完整推理的时间分解来看,核心计算(如矩阵-向量乘法)仅占约200微秒,而数据加载与同步等“后勤”开销被控制得极低。可以说,通过精密的指令调度与融合,Megakernel几乎榨干了硬件的每一分潜力。

能达到如此惊人的效果,核心在于一个激进的设计理念:彻底抛弃传统的多内核协作模式,将整个模型的前向传播过程,从头到尾整合进一个巨大的、单一的CUDA内核中。

具体是如何实现的?团队基于已有的ThunderMLA架构,开发了一个在GPU上运行的轻量级“指令解释器”。该系统会为每个流式多处理器预先分配一份“执行计划”,计划中按顺序排列着代表Transformer各结构单元的复合指令,例如融合了RMSNorm、QKV投影和RoPE编码的指令,或是专门处理注意力与MLP的指令。

每一条指令都基于统一的模板构建,标准化了数据加载、计算和存储的流程。指令之间的依赖关系在运行前就由解释器静态分析并安排好,完全避免了运行时动态判断的开销。为了进一步提升效率,团队还对GPU的共享内存进行了精细的分页管理,确保不同计算阶段能够无缝衔接,下一个阶段可以尽早预加载权重数据,从而彻底消除了计算流水线中的“气泡”(空闲期)。

当然,将所有计算塞进一个内核也带来了新的挑战——传统的、隐式的内核间同步机制失效了。为此,团队引入了一套基于全局内存的计数器系统。每条指令执行完毕后,会对相应的计数器进行原子加一操作;如果某条指令需要等待前序步骤的结果,它会持续“监听”对应的计数器,直到数值达到预设条件才会开始执行。这种显式的、细粒度的依赖控制机制,避免了粗粒度的全局屏障,使得计算能够最大限度地并发进行。

研究过程中还揭示了一些有趣的发现。例如,即便在“已通过”的状态下,CUDA的异步屏障操作本身也有约60纳秒的固有开销,这在追求纳秒级优化的极致场景下不可忽视。此外,在关键的计算操作上,硬件架构差异的影响非常显著:在Hopper(H100)架构上,使用常规CUDA核心进行矩阵-向量乘法反而比使用专用的张量核心更高效;而在更新的Blackwell架构上,张量核心则重新占据了优势。这提醒我们,极致的性能优化需要针对特定的硬件微架构进行深度定制。

传统推理方式效率低下的根源剖析

在构建Megakernel之前,Hazy团队首先系统地剖析了现有方案为何在低延迟场景下“失灵”。结论指向一个系统性的根本问题:过度分解与模块化。

像vLLM和SGLang这样的系统,其设计初衷是为了追求灵活性和通用性,因此将模型前向过程拆分成大量细粒度的内核。这好比将一项复杂工作分配给几十名工人,每人只负责一道极其简单的工序。然而,在只需要生产一个“产品”(即生成一个token)的情况下,频繁的工人交接、任务派发(即内核启动与上下文切换)所花费的时间,反而远远超过了实际干活的时间。

每个内核启动都有其固定的开销,即便利用CUDA Graph等技术进行优化,也仍需1.3到2.1微秒。在这段时间里,GPU的强大计算单元处于等待状态。更为严重的是,这种串行执行模式导致数据加载无法实现流水线化。GPU计算完一个内核后,必须等待下一个内核启动,才能去加载新的权重和数据,这使得高带宽的显存在长时间内处于闲置状态,利用率自然低下。

这就形成了所谓的“内存-计算流水线气泡”:计算单元和内存控制器都无法持续饱和工作,而是在忙碌与等待之间反复切换,资源无法被充分利用。举例来说,从纯理论带宽计算,H100处理一次Llama-1B模型的前向传播可能非常快,但由于需要经历上百个内核的串行执行,每个内核带来的微小延迟累积起来,就会将实际性能拖慢数倍之多。

因此,问题的根源并非某个单一内核不够快,而是这种“微内核”架构本身在低延迟、单序列场景下,带来了无法通过局部优化消除的系统性开销。Hazy团队的思路清晰而彻底:要打破性能瓶颈,就必须从根本上重构执行模型,减少甚至消除内核间的边界,让GPU能够像处理一个连续任务一样流畅地工作。这正是Megakernel设计哲学的核心——用全局的、深度融合的视角,取代局部的、割裂的优化,从而实现AI推理延迟的极限压缩。

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

零一万物迎来三位新高管 李开复详解一把手工程

零一万物近期完成核心高管团队调整。前百度高管沈鹏飞加盟,统筹国内ToB与ToG业务拓展。同时擢升赵斌强、宁宁为副总裁,分别负责AI模型研发与国际业务咨询。此次布局旨在协同市场、技术与国际三大方向,全面升级企业级大模型解决方案能力,以支撑其“AllintoB”与“一把手工程”战略的落地推进。

MiniMax高级研究总监钟怡然半年前离职独家消息

MiniMax高级研究总监钟怡然半年前离职。他曾主导关键项目MiniMax-01的研发,其创新的LightningAttention架构显著提升了模型的长上下文处理效率。公司对其过往贡献表示感谢并送上祝福。

爱诗科技B+轮融资1亿元 ARR突破4000万美元

爱诗科技完成B+轮1亿元融资,年度经常性收入突破4000万美元。旗下PixVerse平台全球用户超一亿,月活用户达1600万,商业化后收入年增超十倍。其自研视频大模型迭代迅速,通过Agent助手降低创作门槛,并借助社交模板驱动全球增长。平台API生态发展强劲,单月调用量翻倍,推动AI视频从娱乐向产业应用升级。

太初元碁联合产业链伙伴推出AI落地北京方案

在2025人工智能计算大会上,30余家企业联合发布“北京方案”,旨在通过芯片厂商、大模型公司及行业应用方的全链路协作,构建开放标准,整合国产芯片与主流大模型,夯实自主技术底座。太初元碁展示了高性能计算与AI融合的解决方案,并以案例说明AI正从认知引擎转向智能行动主体。

小模型崛起成为AI新战场

AI行业风向正从小模型转向。腾讯、阿里和OpenAI相继推出小参数模型,显示小模型重回舞台中心。如今的小模型专为终端部署设计,称为端侧智能,能在手机等设备本地运行,应用于故障预警、智能座舱等场景。凭借低算力需求和本地化优势,小模型正开辟大模型之外的新战场。

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程

热门话题

热门话题