西交大与A*STAR合作研究:AI多图生成如何保持一致性

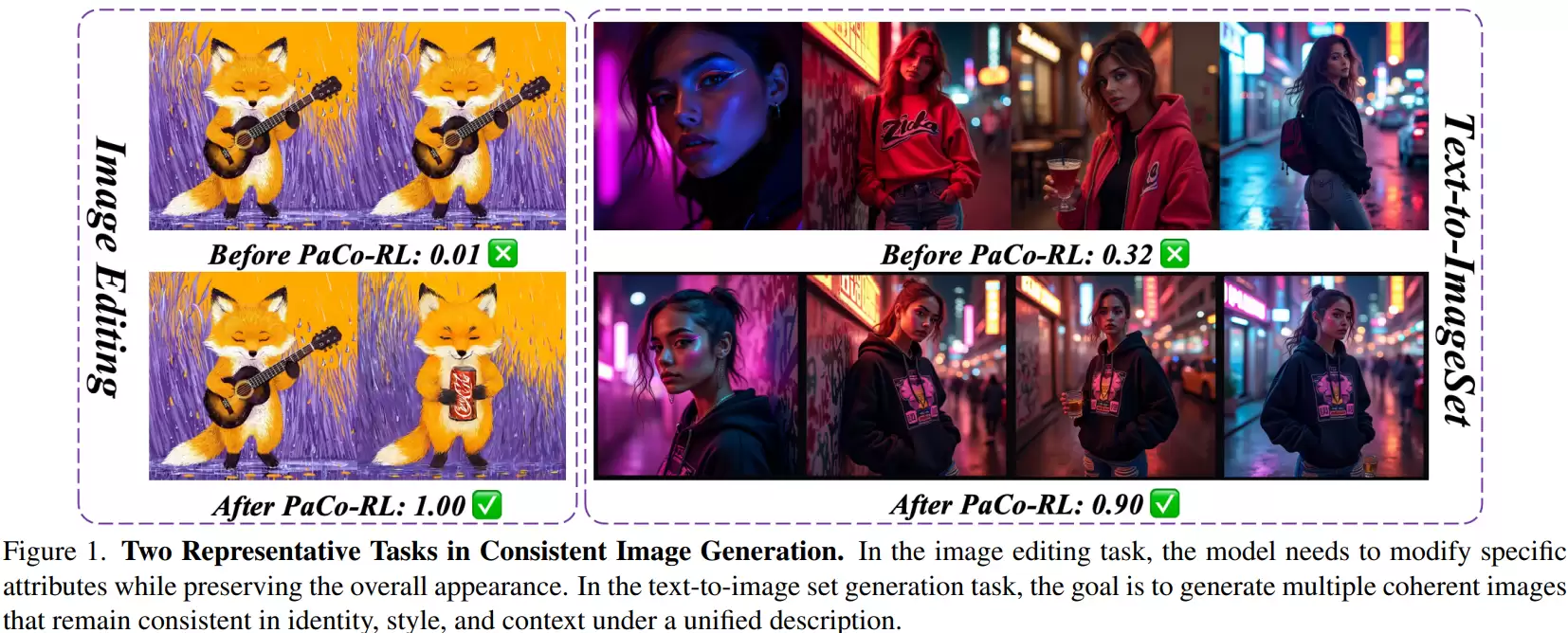

你是否遇到过这样的困扰:用AI生成角色形象时,第一张图令人惊艳,第二张就开始走样,第三张干脆“换了个人”?让它创作一套系列海报,单看每张都不错,但组合在一起却风格各异、难以统一。在绘制故事分镜时,人物形象更是飘忽不定,可能仅仅修改了服装颜色,角色的脸型也随之改变。

这些看似细微的“不一致”问题,在实际的工业化应用场景中却是致命的。无论是IP角色设计、品牌视觉系统构建、系列化内容生产,还是工业设计、医疗影像分析,其核心诉求从来不是某一张图的极致效果,而是整个序列图像在身份、风格、逻辑等多个维度上的高度稳定与统一。

问题的根源在于,当前主流的图像生成模型,其能力范式仍局限于“单次生成优化”。它们擅长将单张图画好,却无法理解哪些核心特征必须在跨图像的序列中保持恒定。简而言之,模型缺乏的不是“绘画技巧”,而是一种对跨图像关系的“稳定建模”能力。这正是生成式AI从单点炫技走向规模化、工业化落地所必须突破的关键瓶颈。

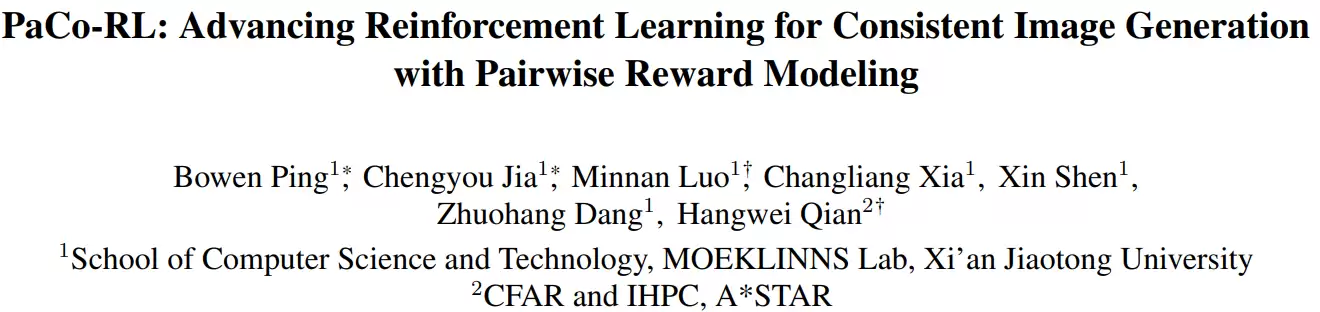

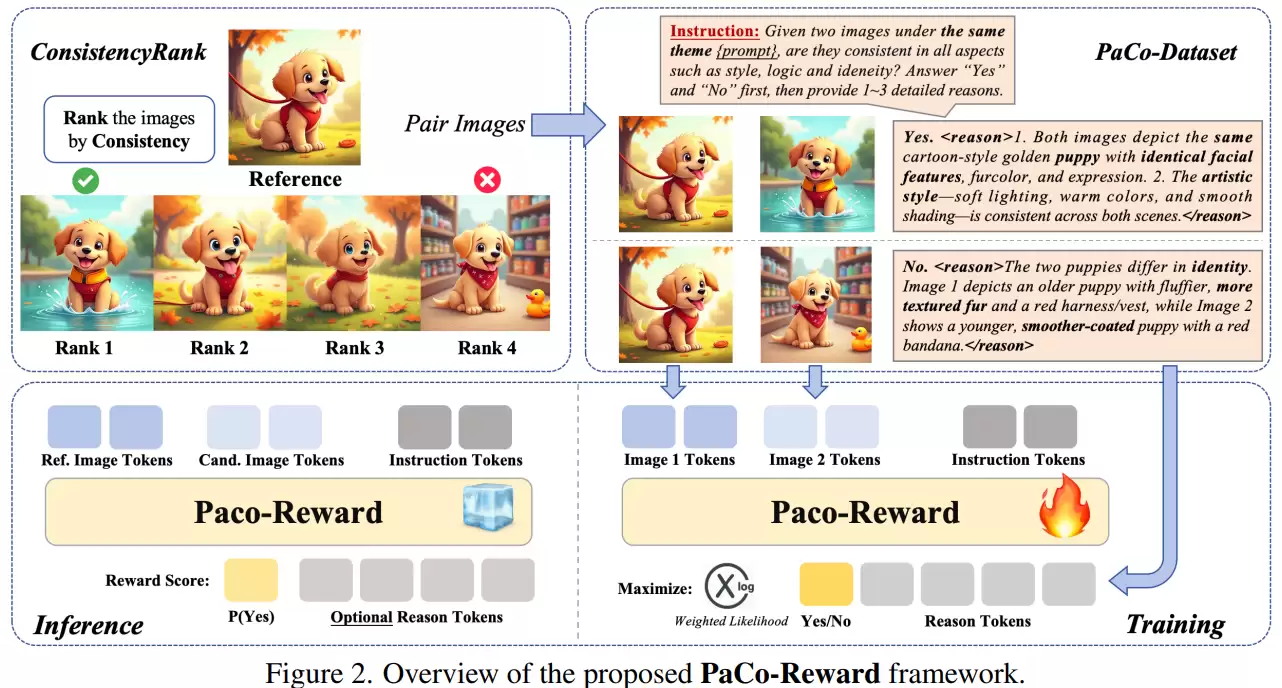

针对这一核心挑战,西安交通大学与新加坡A*STAR的研究团队开创性地提出了一种全新解决方案。他们没有沿用传统的单图评分或图文对齐思路,而是将一致性问题重新定义为“跨图像比较”的学习任务。其核心研究成果《PaCo-RL: Advancing Reinforcement Learning for Consistent Image Generation with Pairwise Reward Modeling》提出,通过构建一个基于成对比较的奖励模型,让AI学习人类在进行一致性判断时所依赖的相对关系和多维标准,再结合强化学习技术,将这种精准的判断能力反向赋能给图像生成过程,从而形成一个从“学会判断一致性”到“实现稳定生成”的完整技术闭环。

从「不会判断」到「稳定生成」:一条完整的技术证据链

整个研究的实验验证,构成了一条逻辑严密、数据扎实的技术演进证据链。

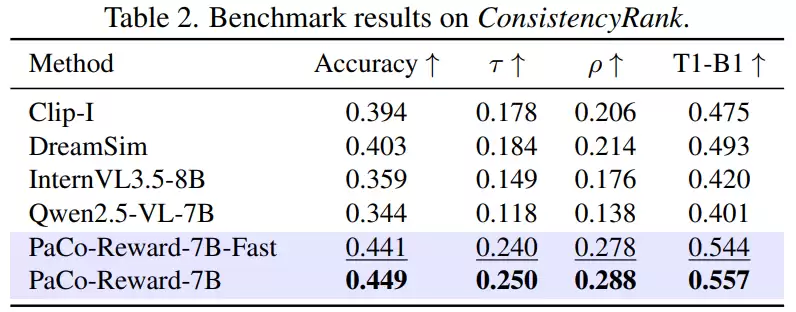

首先,团队通过基准测试对比发现,现有主流模型普遍缺乏真正的跨图像一致性理解能力。在权威的ConsistencyRank基准测试中,大模型Qwen2.5-VL-7B的准确率仅为0.344,甚至落后于传统方法CLIP-I(0.394)和DreamSim(0.403)。这揭示了一个关键事实:通用大模型虽具备强大的图文理解力,但在需要综合比较身份、风格、逻辑等多维因素的一致性判断专项任务上,存在明显短板。一致性,是一种需要专门训练才能获得的专项技能。

基于此洞察,研究团队成功训练了专用的PaCo-Reward模型。测试结果显示,该模型在ConsistencyRank上的准确率大幅提升至0.449,相比原模型提升超过10个百分点,其Spearman相关系数也达到0.288,显著优于所有对比方法。这表明,该模型在排序判断上更贴近人类的视觉直觉和评判标准。

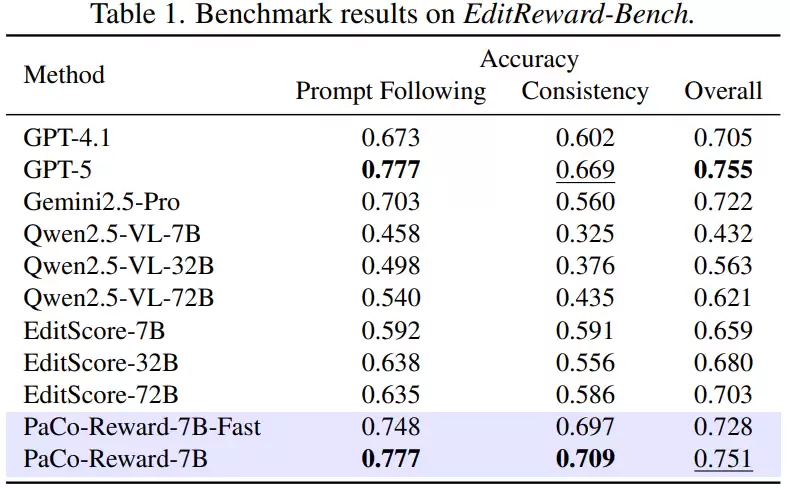

在进一步的EditReward-Bench测试中,PaCo-Reward在一致性指标上达到0.709,整体指标高达0.751,不仅超越了所有开源对比方法,甚至接近GPT-5的顶级表现。这有力证明了该模型具备了优秀的跨任务泛化能力,而非对训练数据的简单记忆。

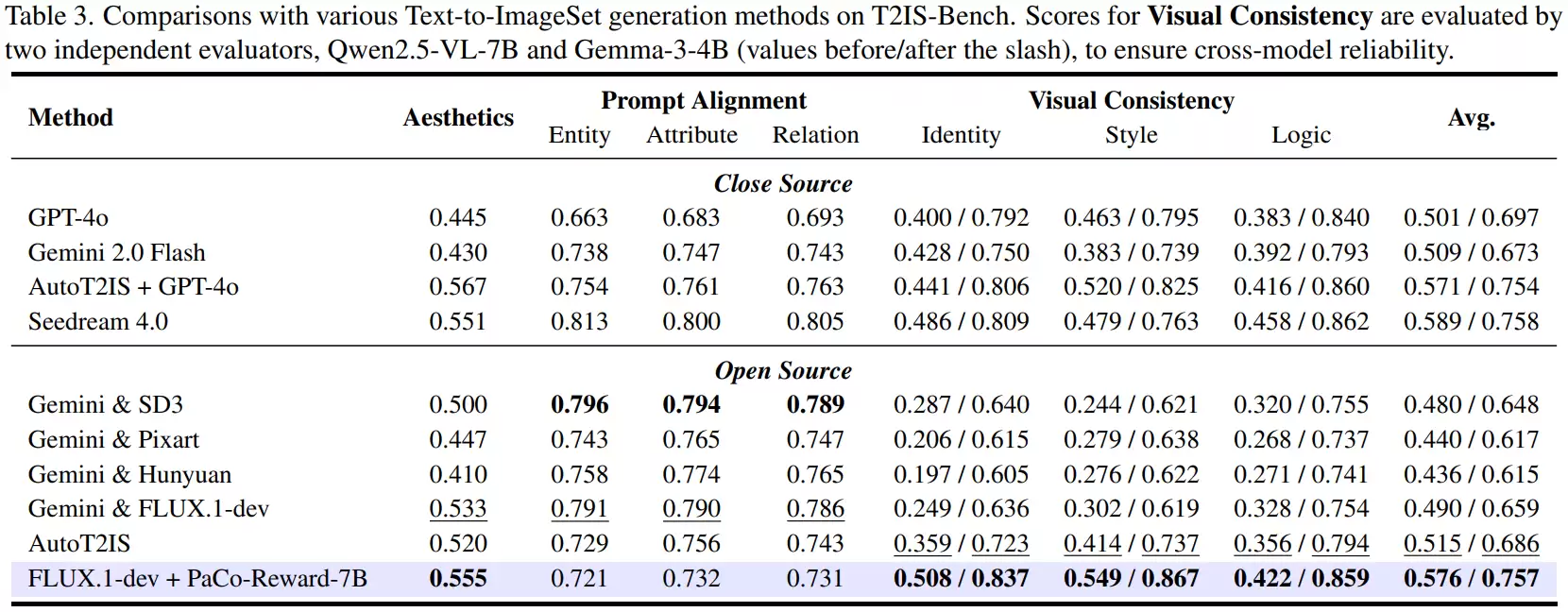

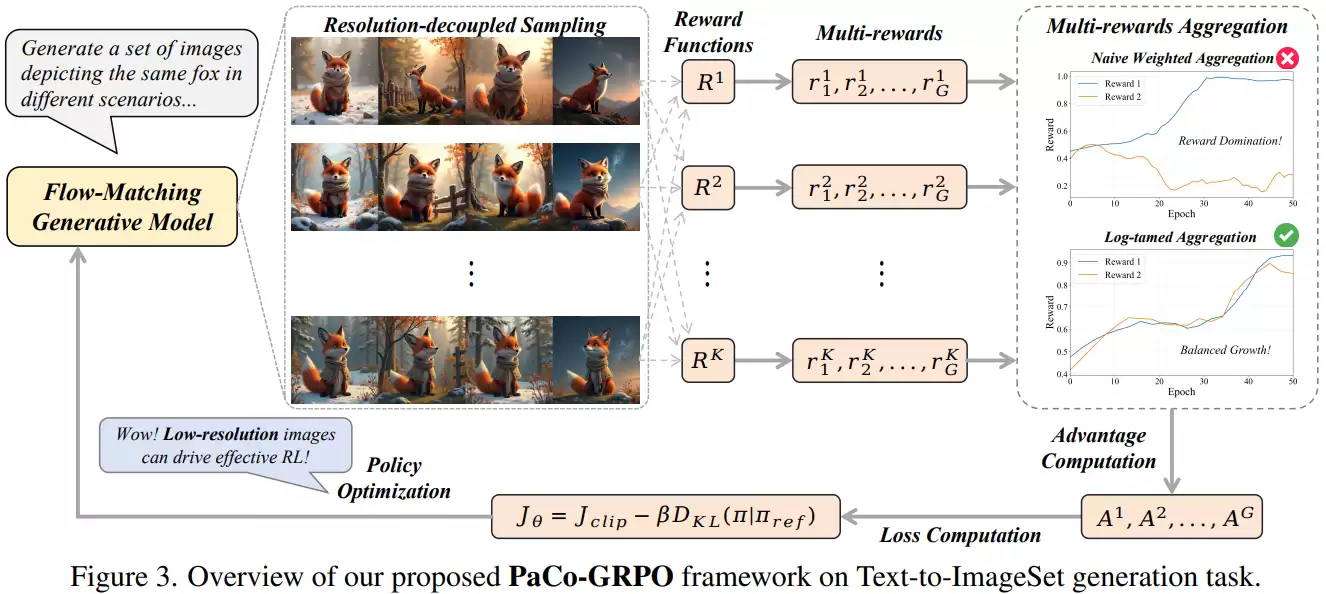

随后,研究人员将这一高性能奖励模型引入强化学习训练框架,在真实的生成任务中验证其效能。在Text-to-ImageSet(文本到图像集)生成任务中,模型的一致性指标整体提升了约10.3%到11.7%,在身份一致性、风格一致性、逻辑一致性等多个细分维度均有显著改善。在GEdit-Bench图像编辑任务中,语义一致性和提示跟随质量指标也持续提升。例如,在Qwen-Image-Edit模型上,整体分数从7.307提升至7.451,且在多语言设置下也表现出一致的改进趋势。这证明,该方法在显著提升生成一致性的同时,并未牺牲单张图像的生成质量。

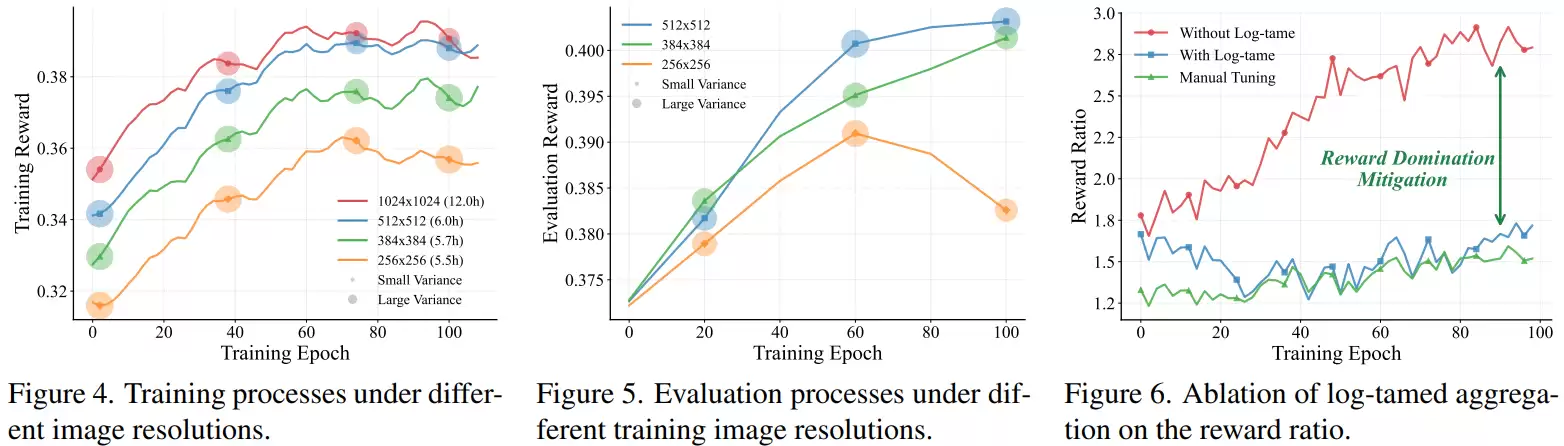

在训练效率与优化稳定性方面,研究也取得了重要突破。采用创新的低分辨率训练策略后,以512分辨率训练约6小时即可达到1024分辨率训练约12小时的效果,显著降低了计算成本。同时,针对传统多奖励加权方法容易导致某一奖励主导优化、破坏平衡的问题,改进后的方法能将各项奖励的比例稳定控制在1.8倍以内,确保了多目标优化过程的平衡与稳定。

综合来看,这项研究不仅成功训练出能精准建模人类一致性判断的专用模型,更将其高效应用于生成模型的优化中,在保证训练效率与稳定性的前提下,实现了生成一致性的显著提升,形成了一个完整、可行且高效的技术闭环。

从可解释判断,到可控生成:分阶段技术路径详解

整个PaCo-RL技术路径可以清晰地划分为两个核心阶段:第一阶段攻克“如何精准判断一致性”,第二阶段实现“如何稳定生成一致性”。

第一阶段的核心挑战在于高质量数据的构建。一致性判断主观性强,涉及身份、风格、构图、逻辑等多个维度,难以用统一、绝对的规则进行标注。为此,团队设计了一套结合自动化生成与精细化人工标注的数据构建流程。

具体而言,他们首先利用现有生成模型构建了约2000条多样化的文本提示词,并筛选出708条具有高度代表性和挑战性的作为核心数据源。基于这些提示词,批量生成包含内部一致性的图像网格。关键创新在于“拆分与组合”策略:将每个图像网格划分为多个子图,并在不同网格的子图之间进行系统性组合,从而构造出海量具有不同一致性关系的图像对。这一方法从708个提示词和2832张基础图像出发,最终高效构造出33984个高质量的排序样本,极大地扩充了数据集规模与多样性。

随后,由6名经过培训的标注人员依据视觉直觉(而非刻板规则)对这些样本进行细致排序标注。为了适配模型训练,这些排序数据被进一步转换为成对比较的形式,即拆解为大量“图像A与图像B是否一致”的二分类判断样本,最终得到超过54624个高质量图像对。每个样本都配有详细的推理解释文本,极大地增强了数据的可解释性和模型的学习深度。

在模型架构设计上,研究团队摒弃了传统的“输入图像输出标量分数”的回归思路,创造性地将一致性判断建模为一个条件生成任务。在PaCo-Reward模型中,输入两张图像及对应文本,模型需要生成“Yes”或“No”的判断,并附上一段完整的推理过程。这种设计巧妙地将复杂的视觉判断问题转化为语言生成问题,既能直接利用视觉语言模型强大的生成与推理能力,也极大地提升了模型决策的可解释性与稳定性——模型必须同时学习判断结果及其背后的逻辑依据。

第二阶段聚焦于“如何生成”。研究引入了经典的强化学习框架:生成模型根据输入提示生成图像集,由训练好的PaCo-Reward模型进行评分,生成模型再根据评分信号(奖励)更新自身参数,形成一个类似人类通过反馈不断学习、迭代优化的闭环过程。

在此过程中有两个关键优化:一是分辨率解耦策略,即在训练奖励模型时使用低分辨率图像进行采样优化,在最终推理生成时再输出高分辨率图像,大幅降低了计算开销。二是奖励平衡策略,通过对波动范围较大的奖励信号进行动态压缩处理,有效解决了多目标优化中因奖励尺度差异而导致的训练偏移问题,确保了整个优化过程的稳定与收敛。

最终,在多图生成和图像编辑等多类任务上的综合验证表明,该方法在身份、风格、逻辑一致性上均有显著提升,并能智能地平衡局部细节修改与整体特征保持之间的关系。

从单点生成到关系建模:AI图像生成的范式演进

这项研究的价值,远不止于论文中技术指标的提升,它正在悄然改变我们使用AI进行视觉创作的底层体验与可能性。

首先,它精准命中了“多图一致性”这一长期制约AI创作实用化的核心痛点。过去,AI或许能生成一张令人惊叹的“孤品”,但无法胜任需要连续、稳定输出的系列化创作任务,如角色设计、品牌视觉系统、漫画分镜或游戏素材生产。这项研究让AI真正具备了“连续创作”和“系列化输出”的能力,推动AI绘画从“炫技玩具”走向“实用生产工具”。

其次,它引入了一种更接近人类认知习惯的学习机制——通过比较来学习,而非直接打分。这意味着模型变得更“懂”人类的审美偏好和主观判断标准,能更自然地理解“像不像”、“统一不统一”、“协调不协调”这类模糊概念,从而生成更符合创作者预期和商业要求的稳定结果。

再者,它通过一系列工程优化,切实推动了强化学习在图像生成领域的实用化进程。低分辨率训练、奖励平衡等机制,在显著提升效果的同时,大幅降低了计算成本和训练难度。这为该项能力更快地集成到实际AI绘画工具、设计软件中铺平了道路,未来普通用户有望直接体验到更稳定、更可控、更一致的图像生成效果。

从更宏观的视角看,这项研究构建了一种“生成-评价-优化”的智能闭环机制。未来的AI图像生成系统不再只是一个被动的、需要反复调试提示词的工具,它能在生成过程中进行“自我检查”、“自我评估”并持续优化。对用户而言,这意味着创作门槛的极大降低,AI能够自动理解并修正系列图像中的偏差,智能地逼近用户的创作意图,实现真正意义上的智能辅助创作。

构建PaCo-RL的研究团队

这篇重要论文的共同第一作者是平博文和贾成铕。贾成铕目前是西安交通大学计算机科学与技术学院的博士研究生(已进入博士阶段后期),师从罗敏楠教授,并与常晓军教授保持紧密合作研究,未来将加入腾讯混元大模型的“青云计划”。他曾在新加坡进行学术访问研究,并在上海人工智能实验室担任研究实习生。其研究方向长期聚焦于计算机视觉与多模态人工智能领域,特别是在视觉生成的一致性、可控性以及AI智能体相关问题上,已在本领域顶级会议和期刊如CVPR、AAAI、ACL等发表多篇学术论文。

论文的通讯作者钱航薇博士,目前在新加坡A*STAR(新加坡科技研究局)下属的前沿人工智能研究中心从事研究工作。她的研究方向广泛涵盖多模态大语言模型、面向科学研究的AI、生成式AI与智能体系统,以及可信与可解释人工智能等前沿方向,并在AAAI、IJCAI、KDD等国际顶级会议和期刊上发表了多项具有影响力的研究成果。

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

大模型与CodeQL代码审计解决方案、技术栈及前沿方向分析

代码审计的格局,正在被大模型悄然重塑。从最初的辅助分析,到如今的规则自主生成、告警智能过滤,乃至专用模型的构建,大型语言模型(LLM)与CodeQL这类传统静态分析工具的结合,正变得前所未有的紧密和高效。 引言 随着软件系统日益复杂,安全漏洞的检测与修复已成为开发过程中的核心挑战。以CodeQL为代

AI全栈开发实践:基于Harness与SDD的多仓库管理模式详解

Harness思维的核心,是引导AI基于现有范例进行模仿与复刻,而非要求其进行无约束的自由创造。这就像指导一位新同事时,最有效的方式是明确指示:“请参考隔壁团队已上线的XX模块,按照其代码风格和架构实现一个类似功能”,而不是模糊地说“你来处理一下”。前者能显著提升产出代码与团队既有规范和项目整体风格

Claude 迁移至 Codex 技能编排实践与经验总结

从Claude迁移到Codex,本应是一次平滑的技术切换,却意外演变成一场关于智能体工作流实战的深度逻辑考验。这背后揭示的行业趋势,远比一次简单的模型选型更值得深入探讨。 在AI工程实践中,我们常有一种误解:只要大模型足够强大,就能自动理解开发者的复杂意图。然而,当你在生产环境中部署一个多阶段、有状

包车收费模式转变从成果付费到用量付费引争议

曾几何时,我们乐观地认为,AI将沿着成熟SaaS的价值路径演进,最终实现公平合理的按效果付费。如今看来,这一愿景已然破灭。当AI行业发现自己无法复制SaaS那套稳固的商业模式基础时,便果断放弃了最初的承诺,转而投身于另一个早已预设好的商业轨道。 近期的行业动态,想必大家已有感知。多家头部AI公司相继

马斯克宣布xAI并入SpaceX并更名为SpaceXAI

今天科技界迎来重磅战略调整。埃隆·马斯克在其社交平台X上正式宣布,旗下人工智能公司xAI将结束独立运营,全面整合进入SpaceX体系,并更名为SpaceXAI。这一举措标志着AI与航天技术的深度融合迈出关键一步。 此次决策源于马斯克对人工智能未来发展的核心判断。他认为,当前地面数据中心面临日益严峻的

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程

热门话题

热门话题