西湖大学王东林团队CVPR论文:机器人如何通古今知未来

想象这样一个场景:机器人伸手去拿桌上的杯子,刚把杯子抬起来,动作却突然停住,随后又把它放回原位,紧接着再次伸手去拿。同一个动作,它重复执行,仿佛完全忘记了刚刚做过什么。这类情况在实际应用中并不罕见:按钮明明已经按下,机械臂却还在反复按压;抽屉明明已经关好,它却还在持续推挤。

这些失败的根源,往往不是“看不清”,而是系统缺少一套能够模拟时空演变的“世界模型”。现有的视觉-语言-行动模型虽然能理解图像与指令,但在连续任务中,决策依然严重依赖当前时刻的观测。一旦任务流程变长——例如需要依次完成拿起、移动、放置、关闭等一系列动作——模型就容易出现动作重复或决策中断。其核心瓶颈在于,缺乏对时间维度的理解与记忆能力。

这正成为具身智能迈向实用化的关键障碍。主流方法基于“看到什么就做什么”的即时反应机制,在短任务中尚可应对,但在长序列任务中,动作不连贯、决策漂移的问题便会凸显。如何让智能体不仅能感知当下,还能记住过去、预判未来,构成了新的核心挑战。

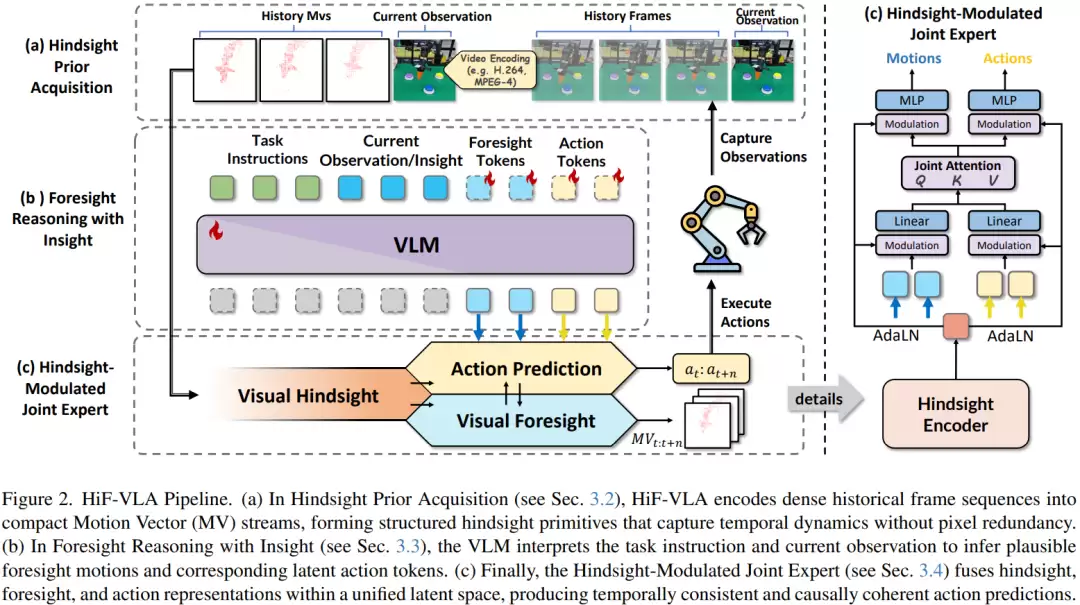

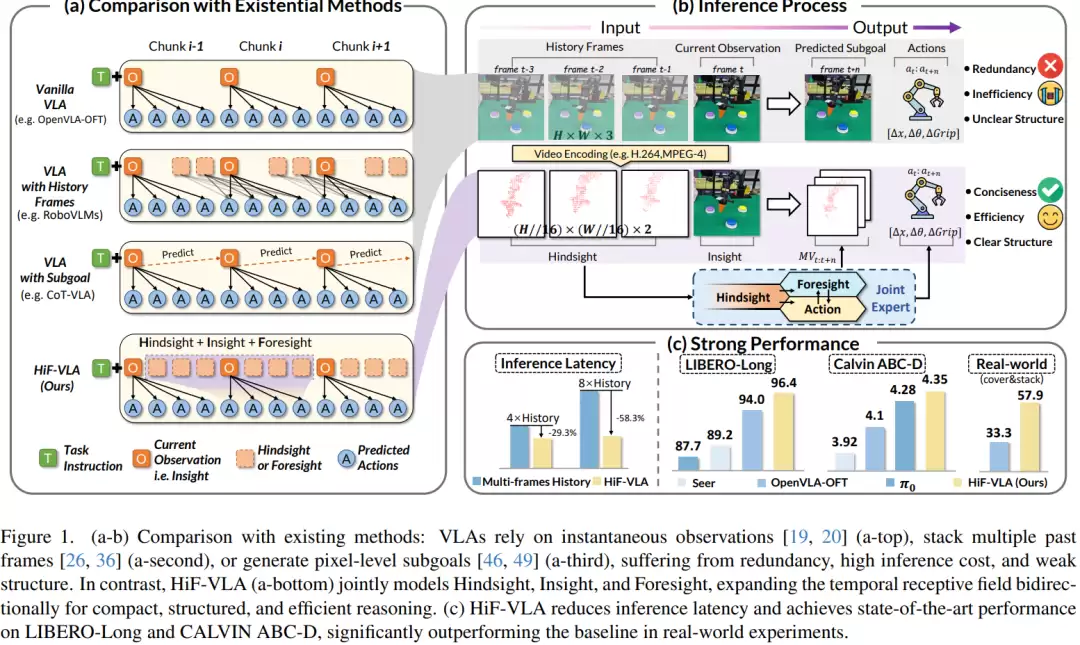

在此背景下,西湖大学王东林团队的最新研究《HiF-VLA:Hindsight, Insight and Foresight for Vision-Language-Action Models》提供了一种新思路。HiF-VLA 不再简单堆叠历史图像或预测未来画面,而是将“运动”本身作为时间信息的核心载体,使模型能够同步建模过去的变化、当前的状态以及未来的趋势,从而实现更稳定、连贯的序列决策。

这项工作的价值,不仅体现在性能指标的提升上,更在于它提出了一种范式转变的可能:让机器人从“被动反应”转向“边思考边行动”。在具身智能逐步走入真实世界的进程中,这种对时间的理解能力,正在成为决定系统是否真正可靠、可用的关键。

机器人不再「忘动作」:HiF-VLA如何提升长序列任务成功率

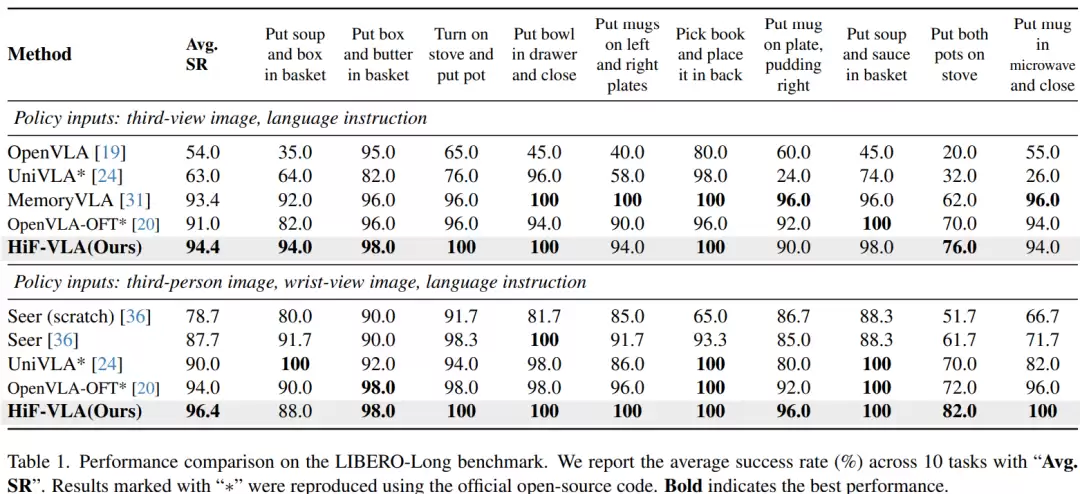

在长序列任务测试集LIBERO-Long上,研究主要评估机器人连续完成多个动作(如拿取、放置、关闭)的能力。结果显示,HiF-VLA在单视角条件下的任务成功率达到94.4%,在多视角条件下达到96.4%。

作为对比,当前表现较强的基线方法OpenVLA-OFT,在单视角和多视角下的成功率分别为91.0%和94.0%。这意味着,新方法在单视角下提升了3.4个百分点,在多视角下提升了2.4个百分点。

深入来看,在测试的10个具体任务中,有多个任务的成功率达到100%,最低的任务也有76%的成功率。这表明其性能提升是整体性的,而非依赖个别优势任务拉高平均。一个值得注意的现象是:该方法在单视角下的表现,已接近甚至达到了其他方法在多视角下的水平。这暗示着,其性能增益主要来源于对时间信息的有效建模,而非单纯依靠更多的视觉输入。

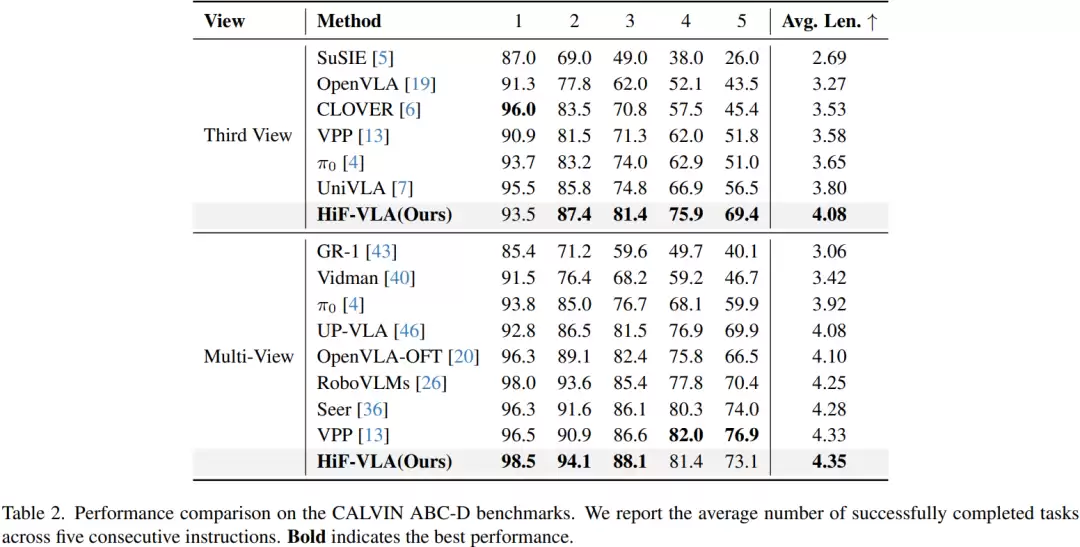

在CALVIN跨环境泛化任务中,研究在A、B、C三个已知环境中训练模型,并在全新的D环境中进行测试。评价指标是“连续成功完成任务数”,即模型能不间断地连续完成多少步操作。结果显示,新方法在单视角下平均完成4.08个任务,在多视角下达到4.35个。而基线方法OpenVLA-OFT约为4.10,Seer约为4.28,RoboVLMs约为4.25。

可以看到,新方法在多视角条件下取得了最高的4.35,相比基线提升约0.25个任务。这个提升颇具意义,因为该指标是累积性的,中间任何一步失败都会导致计数中断。数值越高,说明模型在长序列决策中的稳定性和长期规划能力越强。

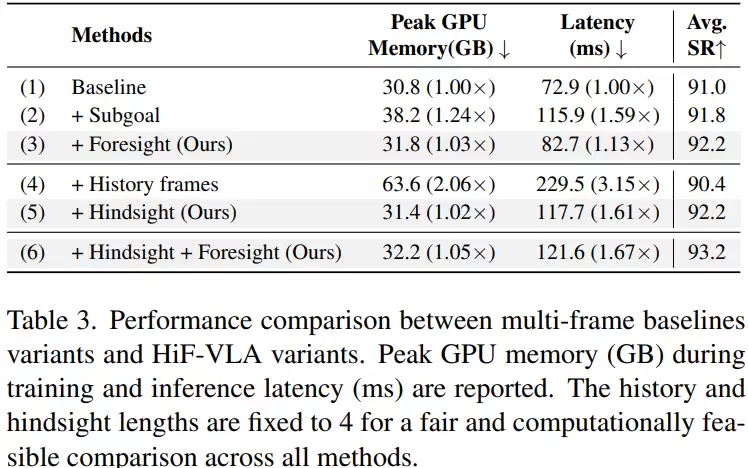

那么,性能提升是否以巨大的计算开销为代价呢?研究进一步分析了效率。当引入基于图像的未来子目标预测时,成功率可达91.8%,但决策延迟增至115.9毫秒,是基线的1.59倍。当采用堆叠历史图像帧的方法时,成功率反而降至90.4%,延迟飙升至229.5毫秒,是基线的3.15倍。这说明,直接处理大量图像信息不仅计算成本高,还可能干扰模型判断。

相比之下,HiF-VLA的方案显得高效许多:仅加入未来推理时,成功率为92.2%,延迟仅82.7毫秒,几乎无额外开销;仅加入历史信息时,成功率同样为92.2%,延迟为117.7毫秒;当历史与未来信息结合后,成功率提升至93.2%,延迟为121.6毫秒。整体来看,新方法在提升性能的同时,计算成本远低于堆叠历史帧的方案,证明使用运动信息比直接使用图像历史更加高效。

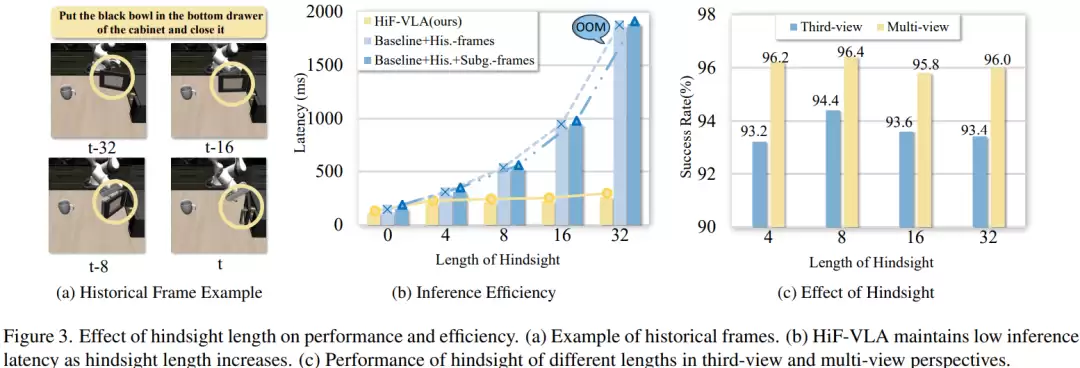

研究还测试了模型对时序长度的扩展能力。随着历史长度从4逐步增加到8、16、32,性能在长度为8时达到峰值(单视角94.4%,多视角96.4%),继续增加长度反而导致性能下降,原因是信息过载带来了冗余和干扰。在延迟方面,传统方法的计算成本会随历史长度线性增长,长度8时延迟增加约4.5倍;而新方法的延迟基本保持稳定,仅轻微增长,展现了在时间维度上更优的可扩展性。

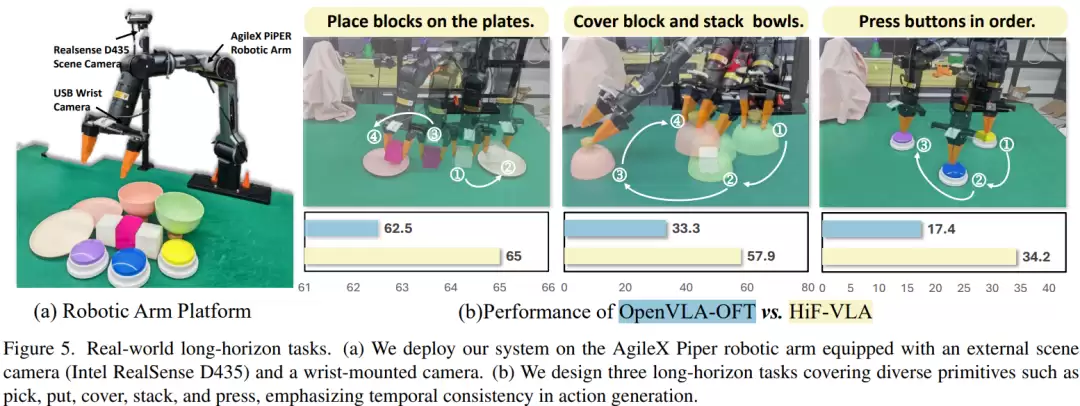

最终,在真实机器人实验中,研究设置了多个长序列任务进行验证。在“按顺序按按钮”任务中,基线方法的成功率为17.4%,而新方法提升至34.2%,接近翻倍。在“覆盖与堆叠”任务中,基线为33.3%,新方法达到57.9%,提升了24.6个百分点。在“放置”任务中,基线约为62.5%,新方法约为65%,提升幅度虽小,但表现更加稳定。

研究人员分析认为,基线方法难以判断按钮是否已被按下,因为状态变化非常细微;而新方法能够利用时间变化信息来捕捉状态转变,因此在复杂任务中优势明显。这进一步证实,引入时间信息能显著增强机器人在长序列任务中的决策鲁棒性。

时间建模方法的系统性对比与实验设计

为了全面评估,研究在实验设计上进行了系统规划。在模拟环境中,采用了LIBERO数据集的10个长序列任务,以及CALVIN数据集的跨环境泛化任务。在真实机器人实验中,每个任务收集了100条示范数据用于训练,并在测试阶段对每个任务执行20次,以评估模型的稳定性和泛化能力。

在输入信息设计上,模型同时接收三类信息:当前画面(感知当前状态)、历史运动(表达过去的动态变化)以及语言指令(提供任务目标)。这种设计使得模型能够在时间维度和语义层面进行联合决策。

研究团队设置了多种基线方法进行系统比较:第一种仅使用当前观测,不含任何时间信息;第二种通过堆叠历史图像引入时间信息,但存在信息冗余和计算成本高的问题;第三种通过预测未来图像作为子目标来引导决策,但容易产生误差且稳定性差。相比之下,新提出的方法用运动信息替代图像来表示时间变化,从而减少了冗余,提高了建模效率。

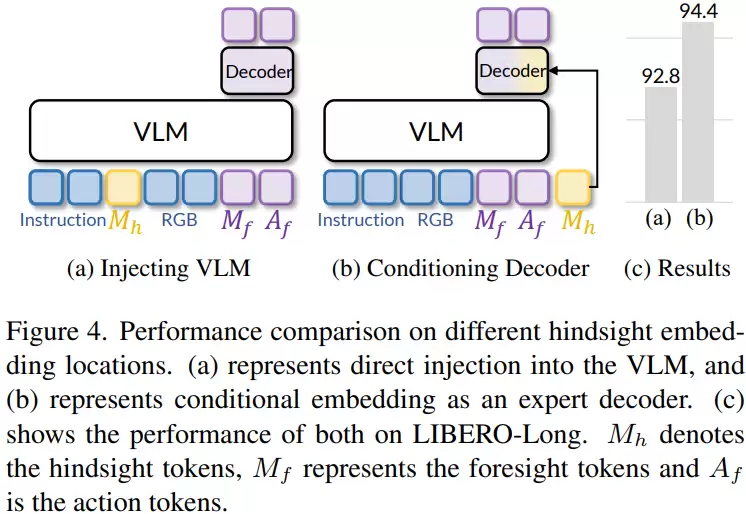

通过消融实验,研究进一步剖析了不同设计选择的影响。首先在历史长度上,实验表明最优长度为8,过短则信息不足,过长则引入冗余干扰判断。其次在历史信息的使用方式上,比较了两种策略:一种是将历史信息直接输入视觉语言模型,此时成功率为92.8%;另一种是将历史信息注入到后续的决策模块中,成功率则提升到94.4%。这一结果说明,将历史信息直接混入前端视觉语言处理流程,可能会干扰其原有的理解能力;而在决策阶段引入历史信息,能更有效地发挥其作用。

从「看到就做」到「边想边做」:具身智能的范式演进

这项研究首先直指一个核心问题:传统模型决策时过度依赖当前观测,忽视时间信息,导致动作不连贯,在长序列任务中易失败。问题的根源并非视觉能力不足,而是缺乏对时间流的建模能力。

基于此,研究提出了一个关键发现:运动信息比原始图像更适合表征时间变化。图像中包含大量静态背景信息,而运动信息则过滤了冗余,只保留真正发生变化的部分,因而更高效、表达力更强。

这一发现带来了直接的影响:机器人的决策过程,从“感知-动作”的单向链条,转变为同时考量过去、现在与未来的综合过程。换句话说,从简单的“看到就做”,升级为基于历史经验、当前状态及未来预测共同驱动的“边想边做”。

在工程价值上,实验数据表明,该方法不仅在性能上取得显著提升(最高成功率96.4%),同时在计算效率上具备优势,避免了传统方法可能带来的数倍计算开销。此外,它在不同环境中展现出更强的泛化能力,并且在真实机器人实验中同样有效,预示着可观的实用化潜力。

更进一步看,这项工作推动了一种智能范式的演进:从“看到就做”的视觉-语言-行动模型,走向“边想边做”的世界-行动模型。HiF-VLA改变的不仅是模型架构,更是在重新定义机器人应具备的能力边界。

过去的系统更像被动的执行者,只对瞬时输入做出反应;而在新范式下,机器人开始具备连续决策的能力,能够在行动中记忆刚发生的状态,判断当前所处的阶段,并预判接下来的步骤。这种转变意味着,机器人不再只是执行孤立的动作,而是能够理解并管理一个完整的任务流程,并在过程中动态调整行为。

这也标志着,具身智能的发展正从“感知驱动的反应系统”,迈向“时间驱动的推理系统”。只有当模型真正掌握这种能力,机器人才能在复杂、动态的真实世界中稳定工作,而不仅仅是在受控的实验室场景中完成预设脚本。

HiF-VLA 背后的科研力量:王东林与黄思腾团队

本论文的通讯作者王东林,现任西湖大学人工智能系副主任,是机器智能实验室(MiLAB)的创始人与负责人,同时也是西湖机器人科技(杭州)有限公司的创始人。

他本科与硕士毕业于西安交通大学电子信息工程专业,后在加拿大卡尔加里大学获得电子与计算机工程博士学位,并在加拿大从事博士后研究。此后,他在美国纽约理工学院任教并晋升为副教授,于2017年回国加入西湖大学,成为工学院首批全职教师之一,创建了机器智能实验室。他还担任国家科技创新2030重大项目首席科学家,并入选国家人社部高层次人才计划。

其研究方向长期聚焦于机器人学习与智能决策,重点关注强化学习、元学习及机器人行为智能,目标是让机器人具备自主学习、快速适应新环境并完成复杂任务的能力。研究不仅关注感知理解,更强调从感知到决策再到行动的完整闭环,尤其是在长序列任务和真实环境中的稳定执行能力。

在学术成果方面,他已发表百余篇论文,活跃于机器人学习与强化学习等前沿领域。其团队是国内最早专注机器人学习的团队之一,提出了国际首个四足机器人VLA大模型、人形机器人VLA大模型、奖励无关人类反馈强化学习等创新工作。其近期合作的AAAI 2026论文斩获最佳论文奖,同时带领研发的通用行为专家大模型GAE也达到了人形机器人运动领域的国际领先水准。

另一位通讯作者黄思腾,现任阿里巴巴达摩院算法专家,博士毕业于浙江大学与西湖大学联合培养项目,在机器智能实验室完成博士研究,师从王东林教授。此前,他于武汉大学计算机科学专业获得本科学位。博士期间,他曾在阿里巴巴通义实验室与达摩院进行长期研究实习,整体经历贯穿学术研究与工业界实践。

其研究方向主要聚焦于具身智能、多模态大模型及高效人工智能,核心关注如何让模型同时理解图像、视频、语言及物理世界中的动态信息,并在真实环境中进行感知、推理与生成。研究不仅涉及多模态理解与生成,还强调模型在数据、计算和存储等方面的效率优化,致力于构建能在现实世界中高效运行的统一智能系统。

在学术成果方面,他已在相关领域发表三十余篇论文,涵盖计算机视觉、多模态学习与机器人方向,并活跃于顶级国际会议和期刊。他参与了多项具身智能与多模态模型方向的研究工作,包括视觉语言行动模型及统一世界模型等,代表性工作涉及HiF-VLA、RynnVLA系列以及WorldVLA等框架,推动了机器人在长序列任务与真实环境中的能力提升。

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

大模型与CodeQL代码审计解决方案、技术栈及前沿方向分析

代码审计的格局,正在被大模型悄然重塑。从最初的辅助分析,到如今的规则自主生成、告警智能过滤,乃至专用模型的构建,大型语言模型(LLM)与CodeQL这类传统静态分析工具的结合,正变得前所未有的紧密和高效。 引言 随着软件系统日益复杂,安全漏洞的检测与修复已成为开发过程中的核心挑战。以CodeQL为代

AI全栈开发实践:基于Harness与SDD的多仓库管理模式详解

Harness思维的核心,是引导AI基于现有范例进行模仿与复刻,而非要求其进行无约束的自由创造。这就像指导一位新同事时,最有效的方式是明确指示:“请参考隔壁团队已上线的XX模块,按照其代码风格和架构实现一个类似功能”,而不是模糊地说“你来处理一下”。前者能显著提升产出代码与团队既有规范和项目整体风格

Claude 迁移至 Codex 技能编排实践与经验总结

从Claude迁移到Codex,本应是一次平滑的技术切换,却意外演变成一场关于智能体工作流实战的深度逻辑考验。这背后揭示的行业趋势,远比一次简单的模型选型更值得深入探讨。 在AI工程实践中,我们常有一种误解:只要大模型足够强大,就能自动理解开发者的复杂意图。然而,当你在生产环境中部署一个多阶段、有状

包车收费模式转变从成果付费到用量付费引争议

曾几何时,我们乐观地认为,AI将沿着成熟SaaS的价值路径演进,最终实现公平合理的按效果付费。如今看来,这一愿景已然破灭。当AI行业发现自己无法复制SaaS那套稳固的商业模式基础时,便果断放弃了最初的承诺,转而投身于另一个早已预设好的商业轨道。 近期的行业动态,想必大家已有感知。多家头部AI公司相继

马斯克宣布xAI并入SpaceX并更名为SpaceXAI

今天科技界迎来重磅战略调整。埃隆·马斯克在其社交平台X上正式宣布,旗下人工智能公司xAI将结束独立运营,全面整合进入SpaceX体系,并更名为SpaceXAI。这一举措标志着AI与航天技术的深度融合迈出关键一步。 此次决策源于马斯克对人工智能未来发展的核心判断。他认为,当前地面数据中心面临日益严峻的

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程

热门话题

热门话题