字节Seed团队发布Ouro语言模型,Bengio签名支持预训练中「思考」

字节 Seed 团队联合多家机构推出了名为 Ouro 的新型预训练模型,它属于循环语言模型(Looped Language Models)类别,名称源于象征循环与自我吞噬的“衔尾蛇”(Ouroboros)神话意象。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

目前主流的大语言模型通常依赖显式的文本生成过程(例如“思维链”)来实现“思维”训练。这种策略将推理任务推迟到训练后的阶段,未能充分挖掘预训练数据中的潜力。

为解决这一问题,字节 Seed 团队联合多家机构推出了 Ouro 模型。这类循环语言模型通过创新架构,在预训练阶段直接构建推理能力。

Ouro 模型通过三个独特路径实现突破:(i)在潜在空间中进行迭代计算,(ii)采用熵正则化目标实现学习型深度分配,以及(iii)将训练数据规模扩展至 7.7T tokens,从而在预训练阶段就植入了推理能力。这些设计使得模型能够在预训练阶段直接学习和构建推理能力,而非仅仅依赖后期微调。

通过对照实验,研究者发现 Ouro 的性能提升并非源于知识存储量的增加,而是得益于其更高效的知识操控与推理能力。进一步分析表明,Ouro 的潜在推理过程相比标准 LLM 更接近真实的人类推理机制。

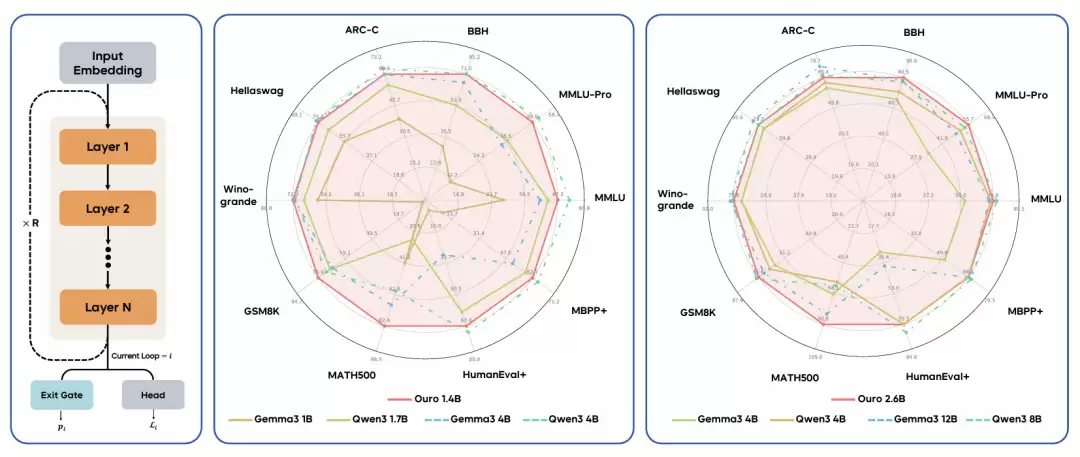

Ouro 循环语言模型的性能表现。(左)参数共享的循环架构。(中与右)雷达图比较了 Ouro 1.4B 与 2.6B 模型(均采用 4 个循环步,红色)与单独的 Transformer 基线模型。我们的模型展现出强劲性能,可与更大规模的基线模型相媲美,甚至在部分任务上实现超越。

最终,Ouro 的 1.4B 和 2.6B 参数规模的 LoopLM,分别能在几乎所有基准测试中达到与 4B 和 8B 标准 Transformer 相当的性能,实现了 2-3 倍的参数效率提升,显示了其在数据受限时代下作为一种新型扩展路径的潜力。

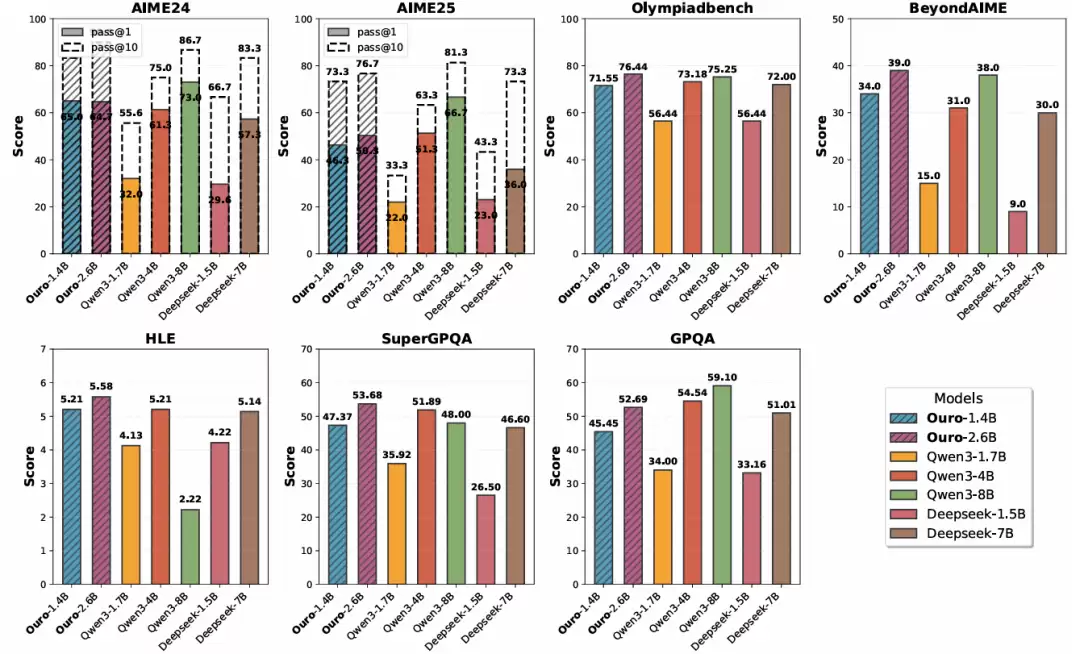

在高级推理基准测试中的表现。Ouro-Thinking 系列模型与强大的基线模型(如 Qwen3 和 DeepSeek-Distill)进行对比。Ouro-1.4B-Thinking R4 的性能可与 4B 规模模型相媲美,而 Ouro-2.6B-Thinking R4 在多个数学与科学数据集上的表现达到或超越了 8B 规模模型。

另外,LoopLM 架构在 HEx-PHI 基准上显著降低了有害性,且随着循环步数(包括外推步)增加,模型的安全性进一步提升。与传统的 CoT 方法不同,研究者的迭代潜变量更新机制产生的是因果一致的推理过程,而非事后的合理化解释。

循环架构

LoopLM 架构的灵感来源于“通用 Transformer”。其核心思想是在一个固定的参数预算内实现“动态计算”。具体而言,该架构包含一个由 N 个共享权重层组成的“层堆栈”。

在模型的前向传播过程中,这个共享的层堆栈会被循环应用多次,即经历多个“循环步”。这种设计将模型的计算规模从“参数数量”解耦到了“计算深度”。

该架构的关键特性是其自适应计算能力。它集成了一个学到的“退出门”,当模型处理输入时:简单输入可能会在经历较少的循环步后就提前退出,从而节省计算资源;复杂输入则会被自然地分配更多的迭代次数,以进行更深层次的处理。

这种迭代重用被视为一种“潜在推理”。与 CoT 在外部生成显式文本步骤不同,LoopLM 是在模型的内部隐藏状态中构建了一个“潜在思维链”。每一次循环都是对表征的逐步精炼,从而在不增加参数的情况下提升了模型的知识操控能力。

训练流程

Ouro 的训练流程是一个多阶段过程,总共使用了 7.7T tokens 的数据。

如图 4 所示,该流程始于一个通用的预热阶段,随后是使用 3T token 的初始稳定训练阶段。在此之后,模型通过“升级循环”策略分支为 1.4B 和 2.6B 两种参数规模的变体。

两种变体均独立经历后续四个相同的训练阶段:第二次稳定训练(3T token)、CT 退火(CT Annealing, 1.4T token)、用于长上下文的 LongCT(20B token)以及中途训练(Mid-Training, 300B token)。

这个过程产生了 Ouro-1.4B 和 Ouro-2.6B 两个基础模型。最后,为了强化特定能力,模型还额外经历了一个专门的推理监督微调阶段,以创造出专注于推理的 Ouro-Thinking 系列模型。

在训练稳定性方面,团队发现最初使用 8 个循环步会导致损失尖峰等不稳定问题,因此在后续阶段将循环步减少到 4,以此在计算深度和稳定性之间取得平衡。

为了让模型学会何时“提前退出”,训练流程采用了新颖的两阶段目标:

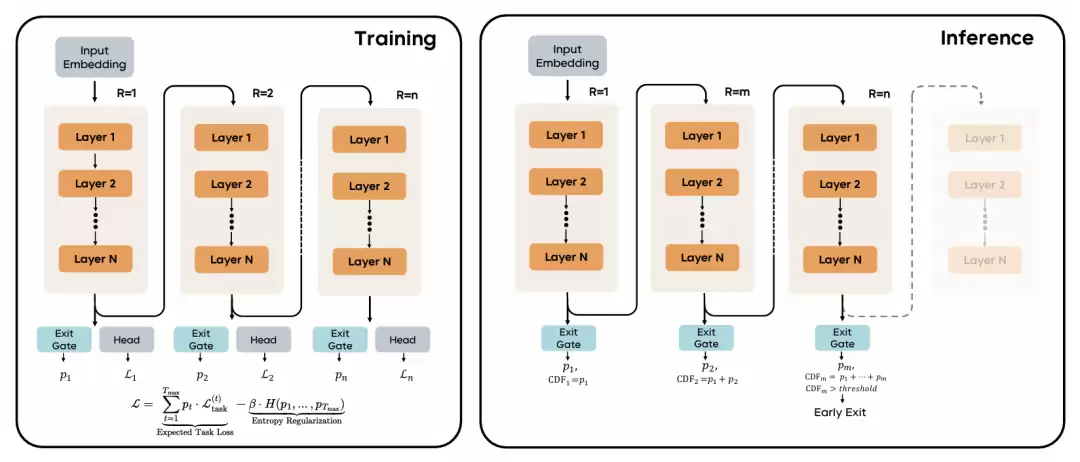

循环语言模型架构概览。

左图为训练阶段。在训练过程中,模型使用共享参数的 N 层堆叠结构,并执行 n 个循环步(R = 1 到 R = n)。在每个循环步 i,一个退出门预测退出概率 pᵢ,而语言建模头 Lᵢ 则计算对应的任务损失。训练目标函数结合了所有循环步的期望任务损失,并加入熵正则化项 H(p₁,…pₙ),以鼓励模型探索不同的计算深度。

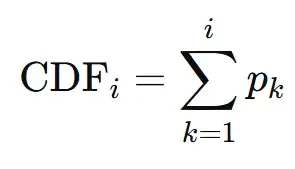

右图为推理阶段。在推理时,模型可根据由退出概率计算得到的累积分布函数(CDF)提前终止。当 超过设定阈值时,模型将在第 i 个循环步停止,从而实现自适应计算:为复杂输入分配更多循环步数,同时在简单输入上保持高效推理。图中的虚线表示模型在提前退出后可能被跳过的后续步骤。

超过设定阈值时,模型将在第 i 个循环步停止,从而实现自适应计算:为复杂输入分配更多循环步数,同时在简单输入上保持高效推理。图中的虚线表示模型在提前退出后可能被跳过的后续步骤。

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

一篇讲透:豆包、元宝、DeepSeek、Kimi、WorkBuddy,职场里到底怎么分工

别再把所有 AI 当成一个东西:WorkBuddy 和豆包、元宝、DeepSeek、Kimi,到底该怎么选? 这一年,AI 的进化速度着实叫人眼花缭乱。 大家的关注点,早就从“这工具能写文章吗”跳到了“它能不能帮我做方案、改稿子、整理会议纪要,甚至把任务往前推一步”。 于是,一个新问题浮出水面。 很

我用WorkBuddy“克隆“了一个我,从此每句话像我自己说的

如何使用WorkBuddy深度学习我的说话方式,让每一份文案都自带个人风格 作为一名企业培训师,每年主讲上百场课程是行业常态。无论是线下公开课、线上直播,还是视频号、公众号的内容创作,每天的工作状态不是在授课,就是在准备各种讲稿的路上。早期借助通用AI工具辅助创作,写作效率确实有所提升,但生成的内容

英国视障跑者挑战马拉松,将借助智能眼镜“看”到赛道、辨别方向

英国视障跑者挑战马拉松,将借助智能眼镜“看”到赛道、辨别方向 最近有一则科技助残的新闻,让人眼前一亮。当地时间4月2日,英国BBC报道称,视障跑者克拉克·雷诺兹正计划借助一项创新技术,参加一场全程马拉松。这项技术的巧妙之处在于,它能让世界另一端有视力的志愿者,实时“看到”雷诺兹眼前的景象,并为他提供

彻底卸载 OpenClaw (龙虾) 指南

彻底卸载 OpenClaw (龙虾) 指南 想把 OpenClaw(大家常叫它“龙虾”)从你的系统里清理干净?这事儿得讲究个章法,胡乱删除往往治标不治本,残留的服务和文件就像散落在角落的贝壳,时不时硌你一下。接下来,咱们就按一套稳妥的流程,帮你把它请走。 卸载原则 核心原则就一句话:先停服务,再卸工

AI 让英国学生“不会思考”,近 6000 名英格兰中学教师表示担忧

AI让英国学生“不会思考”?近6000名教师敲响教育警钟 一项来自英国教育界的深度调查,为当前AI技术涌入课堂的热潮带来了冷静思考。据英国《卫报》4月2日报道,英格兰的中学教师们普遍观察到一种现象:随着人工智能在教育中的应用日益广泛,学生的批判性思维能力与深度思考习惯正面临下滑风险。这项由英国全国教

- 日榜

- 周榜

- 月榜

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程