前沿工程基准测试 Frontier-Eng Bench 实现自动驾驶研发闭环

AI能否真正实现科研全流程自动化?过去两年,“自动化研究”(Auto Research)备受瞩目:从文献阅读、方向探索到代码编写、实验执行,甚至生成新假设——人工智能似乎正朝着全能科研助手的方向迈进。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

然而,真正参与过研究项目的研究者都深有体会,最耗费心智与时间的环节往往并非“让程序运行起来”,而是“如何让它运行得足够出色”。参数调整、代码修改、结果分析,再运行,再优化……每一次性能提升都伴随着琐碎且重复的工作,但这些步骤却几乎无法跳过。

因此,一个更为实际的问题随之产生:能否将这些繁琐的迭代优化过程也交由AI处理?研究员只需提供核心方向与初始构想,后续“观察反馈→调整代码→逼近最优解”的漫长循环,能否完全委托给智能体(Agent)来自主完成?

Einsia AI旗下Na vers Lab发布的最新研究论文《Frontier-Eng》正是瞄准了这一目标。

论文题目:Frontier-Eng: Benchmarking Self-Evolving Agents on Real-World Engineering Tasks with Generative Optimization

项目主页:https://lab.einsia.ai/frontier-eng/

Arxiv: https://arxiv.org/abs/2604.12290

Github repo: https://github.com/EinsiaLab/Frontier-Engineering

这并非又一个仅仅测试“模型能否解题”的基准。恰恰相反,它提出了一个更贴近真实世界自动化研究场景的核心问题:对于一个已经可行的方案,AI究竟能将其优化到何种高度?

从“答题”到“优化”:智能体角色的根本转变

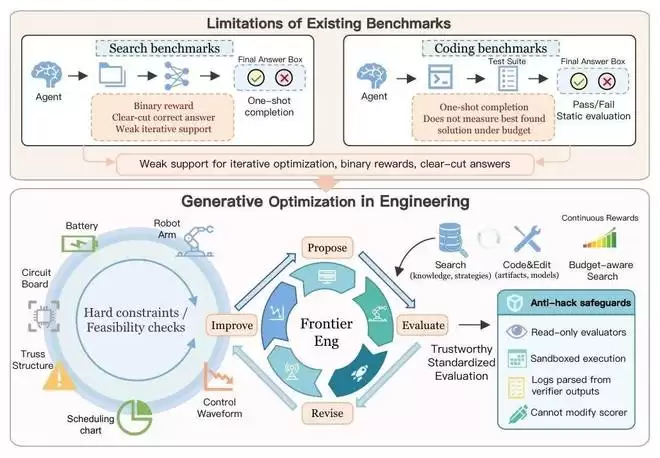

过去两年,我们见证了众多针对智能体的评估基准:有的考察信息检索能力,有的测试代码生成质量,有的仅关注任务是否完成。但这类测试大多仍遵循“非对即错”的二元评估逻辑。

然而,真实的科研与工程实践从来不是非黑即白的。许多情况下,一个方法已经能够运行并产生可接受的结果,但决定其最终竞争力的,恰恰是后续通过持续、精细的迭代所“挤压”出来的那部分性能增益。

实验速度提升一点,意味着研究员能更快获得反馈,加速研究循环;显存占用节省一点,使得尝试更大模型、更长上下文或更复杂设置成为可能;关键指标上涨一点,可能就意味着逼近了领域前沿,决定了论文的学术影响力。

在自动化研究的愿景中,最关键的不是智能体能否一次性给出一个看似合理的答案,而是它能否接管后续漫长的优化迭代流程:持续读取实验反馈、修改技术方案、执行验证实验、并不断压榨性能极限,从而将研究人员从重复性高、耗时费力的调优工作中解放出来。

而Frontier-Eng基准旨在评估的,正是AI接手这一复杂优化过程的能力。

Frontier-Eng总览

该研究将此类问题定义为一种新的评估范式:“生成式优化”(Generative Optimization)。其核心是让智能体不再仅仅“提交一次最终答案”,而是真正进入一个完整的工程优化闭环:提出初始方案 → 在程序或仿真器中运行 → 获取详细的性能反馈 → 基于反馈修改方案 → 在固定的计算或尝试预算内,持续迭代以逼近更优解。

这本质上模拟了科研人员与工程师的日常工作模式:并非一蹴而就给出完美方案,而是在不断试错、调整、接受现实约束反馈,并据此持续改进的过程中前进。

将智能体置于海量真实工程问题中进行锤炼

为了构建一个可靠且具有挑战性的基准,Na vers Lab团队搭建了一套硬核的评测体系。他们邀请了来自多个工程领域的博士、硕士研究人员,贡献了各自领域内经常遇到的实际难题,并将其转化为安全、可复现、可自动化验证的代码任务。这意味着,Frontier-Eng基准中的每一个任务都源于领域专家的第一手经验。

Frontier-Eng v1版本共包含47个任务,横跨五大工程方向:计算与量子信息、运筹与决策科学、机器人/控制/能源系统、光学与通信系统、物理科学与工程设计。

任务类型绝非理论空谈,而是直接将智能体投入多样化的真实工程场景进行测试,具体包括:GPU内核性能优化、电池快速充电策略、机械臂运动时间压缩、量子线路优化、数据中心能耗控制、结构拓扑设计、作业车间调度、光学相位设计、单细胞数据分析、化学反应条件优化等。

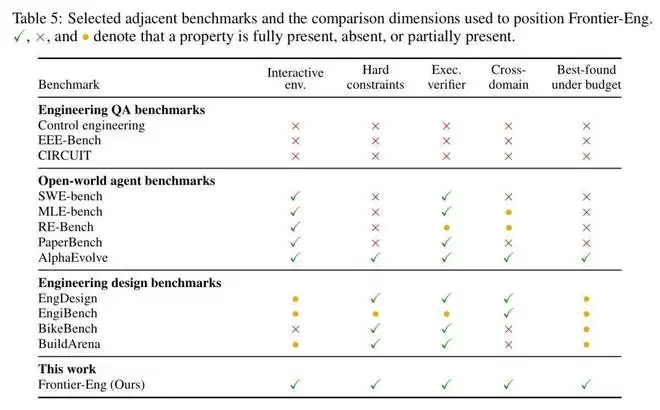

Frontier-Eng基准与已有评测基准的对比

这表明Frontier-Eng测试的不是某个狭窄领域的“技巧题”,而是在深入探究:当智能体面对不同学科背景、不同优化目标函数、不同仿真环境以及不同硬性约束时,其持续进行有效优化的通用能力究竟如何。

一个旨在杜绝“取巧”、纯粹比拼“硬实力”的基准

Frontier-Eng基准的设计明显吸取了以往许多评测易被“钻空子”的教训。其评测机制具备以下特点:评测器与参考数据为只读,智能体无法修改;候选方案在隔离环境中运行,无法直接干预评分过程;最终得分来源于独立验证器(verifier)输出的日志,而非由智能体自行报告。

换言之,想要获得高分,只有一条路径:实实在在地做出更优的解决方案。

为何这项任务如此困难?因为它要求的不再是单一能力,而是多种能力的有机结合。模型既需要理解特定领域的专业知识(例如明白电池为何会析锂、机械臂为何会发生碰撞、库存策略为何会失效),又需要具备编写和修改代码的能力,将优化想法转化为可执行的方案;同时,还必须能够解读复杂的反馈信号,理解仿真器输出结果背后的含义;最后,还需在有限的预算(如计算资源、尝试次数)内做出明智的搜索决策:是进行大刀阔斧的改动,还是进行细微的调整?

论文中列举了一个典型任务:电池快充优化。目标看似直接——充电速度越快越好。但现实约束极为复杂:电压上限、温度控制、析锂风险、电池寿命衰减都是必须严格遵守的硬性限制。智能体不能为了单纯追求速度而盲目激进,必须在充电速度、热安全性和电池寿命之间找到最佳平衡点。

这就不再是“能否编写一个函数”的问题,而是“能否在真实的物理约束和动态反馈中做出序列化优化决策”。这也是Frontier-Eng最具价值之处:它不再追问“答案是否正确”,而是追问“你能否在现实世界的多重约束下持续变得更好”。

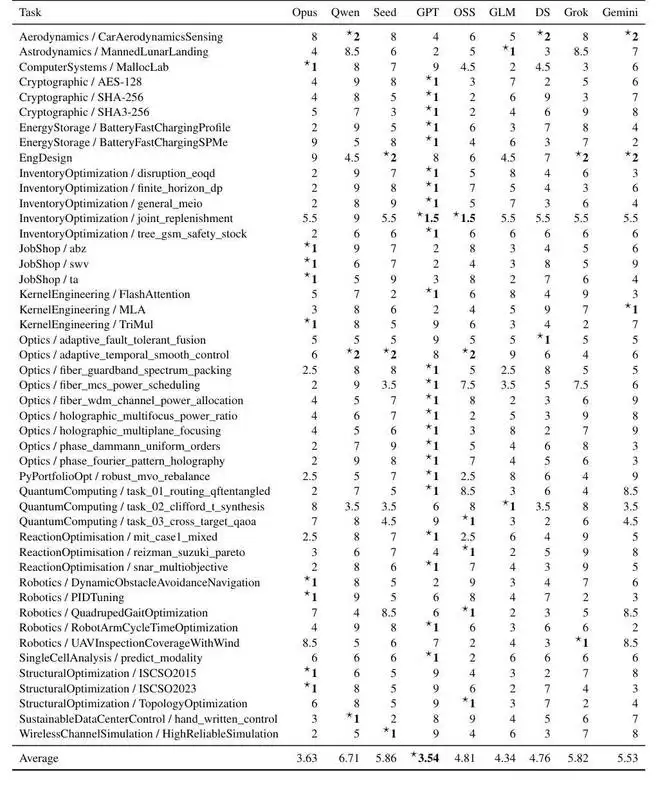

不同模型的详细评测结果

评测结果:GPT-4表现最为稳健,但挑战依然巨大

从评测结果来看,这套基准确实具备足够的难度。论文系统性地评估了多种前沿大模型和代表性搜索框架,结论清晰:GPT-4在整体上表现出了最稳健的优化能力,但对于所有被测试的模型而言,Frontier-Eng基准都远未被“攻克”。

换句话说,当前最先进的一批模型,已经在部分工程任务上展现出了可观的自动化优化潜力,但距离“像经验丰富的工程师一样,稳定地跨多个领域执行复杂优化”,仍有很长的路要走。

比单纯的排名更有趣的,是这项研究同时揭示出的两个重要规律。

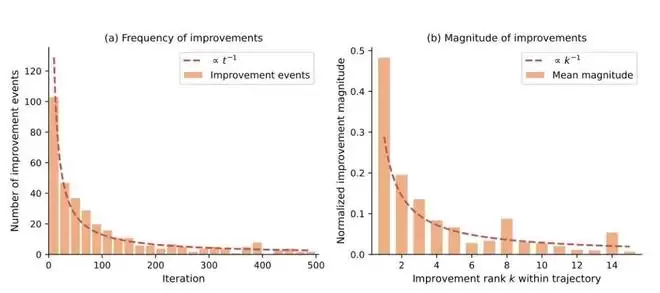

工程优化的双重幂律衰减

第一个规律是:优化进程越深入,提升越困难。论文发现,智能体的改进频率和单次改进幅度均呈现幂律衰减趋势:改进频率与迭代轮数成反比,改进幅度与已实现的改进次数成反比。简单来说,初始几轮优化往往能快速获取显著收益(即“低垂的果实”),但随着优化进程推进,性能提升会变得越来越困难,幅度也越来越小。

这高度模拟了真实的研发与优化过程:初期方案容易获得大幅改进,但后期逐渐逼近性能瓶颈,每一点微小的提升都需要付出极大的努力。

那么,采用并行多路径搜索策略是否会更有优势?答案隐藏在第二个规律中。

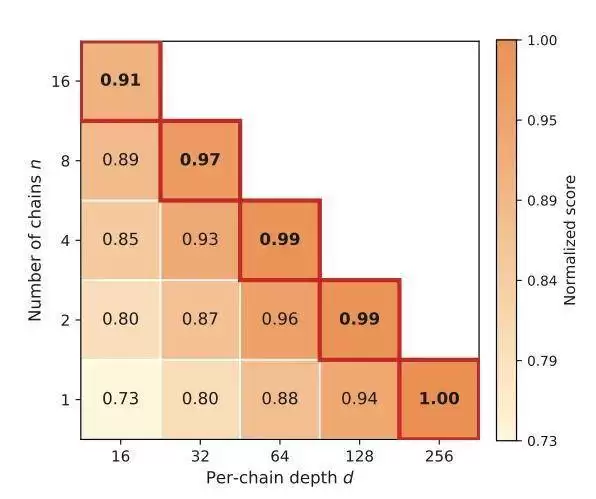

深度 vs 宽度

第二个规律:搜索宽度有益,但搜索深度不可或缺。并行运行多个搜索线程确实有助于避免陷入局部最优解,但在总计算预算固定的前提下,每增加一条并行搜索链,都会相应减少单一路径可探索的深度。许多工程上的突破性进展并非依靠“广撒网”式的多次尝试就能实现,往往需要沿着某个方向持续积累、不断修正,才可能引发结构性的性能跃迁。

这为下一代智能体的发展方向提供了重要启示:其目标不应是追求“一次性给出完美答案”,而应是构建能够在长期、复杂的反馈循环中持续学习、迭代并自我进化的智能系统。

Frontier-Eng基准:其意义远超一份排行榜

Frontier-Eng基准将业界的关注点从“AI能否答对题”拉回了一个更为现实的议题:AI能否替代人类,承担起科研与工程中那些最繁琐、最耗神却又无法绕开的“深度优化”工作?

评估的尺度发生了根本变化——不再是简单的“对或错”,而是“你能将方案优化到何种程度”。从这个视角看,Frontier-Eng基准测试的是:AI在成为协助人类进行工程优化的得力助手这条道路上,已经走了多远?

迭代优化是研究与开发中永恒且无法规避的一环。避开它,任何方案都只能停留在“勉强可用”的水平。如果AI能够可靠地接管这一环节呢?对于科研人员而言,这意味着可以从枯燥的调参和优化工作中解放出来,更专注于高层次的创意与设计;对于整个自动化研究领域而言,则意味着只有将方案的性能优化到极致,才能真正启动研究效率提升的飞轮。

这比单纯产生一组刷榜的分数,更值得整个AI研究与工程社区深入思考和认真对待。

游乐网为非赢利性网站,所展示的游戏/软件/文章内容均来自于互联网或第三方用户上传分享,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系youleyoucom@outlook.com。

同类文章

同类文章

前沿工程基准测试 Frontier-Eng Bench 实现自动驾驶研发闭环

AI能否真正实现科研全流程自动化?过去两年,“自动化研究”(Auto Research)备受瞩目:从文献阅读、方向探索到代码编写、实验执行,甚至生成新假设——人工智能似乎正朝着全能科研助手的方向迈进。 然而,真正参与过研究项目的研究者都深有体会,最耗费心智与时间的环节往往并非“让程序运行起来”,而是

Claude md文件十万星开源项目如何重新定义AI编程

在GitHub上,一个独特的现象正引发全球开发者关注:一个不包含任何实际代码的项目,其星标数量已突破10万大关。项目的核心贡献,仅仅是一个名为CLAUDE md的配置文件。这份由前特斯拉AI总监、OpenAI联合创始人安德烈·卡帕西(Andrej Karpathy)总结的“AI编程四诫”,正在悄然重

Figma多语言界面设计指南:AI与本地变量自动映射

在Figma中完成UI框架设计后,若需同时适配中文、英文、日文等多语言版本,手动逐项替换文本不仅效率低下,且极易出错,同步维护更是难题。这通常源于缺乏系统化的文案管理机制。实际上,通过Figma原生的Local Variables功能,您可以建立起结构清晰的多语言文案管理体系,再结合AI工具进行批量

Superpowers插件185000星却仅10%功能被多数人使用

你有没有遇到过这种情况?让Claude帮你写个功能,几百行代码瞬间生成,跑起来一看,逻辑大体没错,但总有两三成是它自己“脑补”出来的需求。 你说测试没通过,它立刻动手改,结果把原本能跑的部分也改坏了。 这其实不是Claude不够聪明,恰恰相反,是它太“勤快”了——不问清楚、不验证、不收敛,直接上手就

长周期智能体详解从Ralph Loop到可接管Harness

近期,AI Agent 如何实现长时间稳定运行成为技术社区热议的焦点。讨论的核心已从“如何让 Agent 不中途停止”,转向一个更具挑战性的工程问题: 当一个 Agent 持续运行数小时,跨越多个上下文窗口,并将任务分配给多个子 Agent 协同处理后,其最终交付的成果是否仍具备可验证性、可审计性,

- 日榜

- 周榜

- 月榜

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

1

1

2

2

3

3

4

4

5

5

6

6

7

7

8

8

9

9

10

10

相关攻略

相关攻略

2015-03-10 11:25

2015-03-10 11:25

2015-03-10 11:05

2015-03-10 11:05

2021-08-04 13:30

2021-08-04 13:30

2015-03-10 11:22

2015-03-10 11:22

2015-03-10 12:39

2015-03-10 12:39

2022-05-16 18:57

2022-05-16 18:57

2025-05-23 13:43

2025-05-23 13:43

2025-05-23 14:01

2025-05-23 14:01

热门教程

热门教程

- 游戏攻略

- 安卓教程

- 苹果教程

- 电脑教程

热门话题

热门话题